这个技术社区公式排版有点问题,建议观看:机器博弈 (三) 虚拟遗憾最小化算法

虚拟遗憾最小化算法(Counterfactual Regret Minimization)

- 如果不能遍历计算机所有节点的遗憾值,那么可以采用虚拟遗憾最小化算法来进行模拟计算。

假设:

- 集合$A$是博弈中所有玩家所能采用的行为集(如在石头-剪刀-布游戏中出石头、出剪刀或出布三种行为)

- $I$为信息集,包含了博弈的规则以及玩家采取的历史行动,在信息集$I$下所能采取的行为集合记为$A(I)$。

- 玩家$i$在第$t$轮次采取的行动$a_{i} \in A(I_{i})$反映了其在该轮次所采取的策略$\sigma_{i}^{t}$。包含玩家$i$在内的所有玩家在$t$轮次采取的行动$a \in A(I)$构成了一组策略组合$\sigma^{t}$。

- 在信息集$I$下采取行动$a$所反映的策略记为$\sigma_{I \rightarrow a}$。

- 在第$t$轮次所有玩家采取的行动是一条序列,记为$h$。采取某个策略$\sigma$计算行动序列$h$出现的概率记为$\pi^{\sigma}(h)$。

- 每个信息集$I$发生的概率$\pi^{\sigma}(I)=\sum_{h \in I}\pi^{\sigma}(h)$,表示所有能够到达该信息集的行动序列的概率累加。

- 给定博弈的终结局势$z \in Z$,玩家$i$在游戏结束后的收益记做$u_{i}(z)$。

- 在策略组合$\sigma$下,施加博弈行动序列$h$后达到最终局势$z$的概率为$\pi^{\sigma}(h,z)$。

有了这些定义之后,我们现在来计算虚拟遗憾:

- 当采取策略$\sigma$时,其所对应的行动序列$h$的虚拟价值(Counterfactual Value)如下计算(注:行动序列$h$未能使博弈进入终结局势):

$$ v_{i}(\sigma,h)=\sum_{z \in Z} \pi_{-i}^{\sigma}(h)\pi^{\sigma}(h,z)u_{i}(z) $$

我们首先去计算其他玩家在产生行动序列$h$中他们的概率值是多少,乘以在这个策略下,从行动序列$h$进入到终止局势$z$的概率,最终再乘以玩家$i$在终止局势$z$的概率。之后对终止局势做一个遍历,把它的乘积做一个累加。

- 玩家$i$采取行动$a$所得到的虚拟遗憾值:

$$ r(h,a)=v_{i}(\sigma_{I \rightarrow a},h) - v_{i}(\sigma,h) $$

- 行动序列$h$所对应的信息集$I$遗憾值为:

$$ r(I,a)=\sum r(h,a) $$

- 玩家$i$在第$T$轮次采取行动$a$的遗憾值为:

$$ Regret_{t}^{T}(I,a)=\sum_{t=1}^{T}r_{i}^{t}(I,a) $$

- 同样,对于遗憾值为负数的情况,我们不予考虑,记:

$$ Regret_{i}^{T,+}(I,a) = max(R_{i}^{T}(I,a),0) $$

- 在$T+1$轮次,玩家$i$选择行动$a$的概率计算如下:

$$ \sigma_{i}^{T+1}(I,a) = \left\{\begin{matrix} \frac{Regret_{i}^{T,+}(I,a)}{\sum_{}a \in A(I)Regret_{i}^{T,+}(I,a)}& if \sum_{a \in A(I)}Regret_{i}^{T,+}(I,a)>0\\ \frac{1}{|A(I)|} & otherwise \end{matrix}\right. $$

- 玩家$i$根据遗憾值大小来选择下一时刻行为,如果遗憾值为负数,则随机挑选一种行为进行博弈。

例子-库恩扑克(Kunh's pocker)

- 库恩扑克是最简单的限注扑克游戏,由两名玩家进行游戏博弈,牌值只有1,2和3三种情况。

- 每轮每位玩家各持一张手牌,根据各自判断来决定加定额赌注。

- 游戏没有公共牌,摊牌阶段比较未弃牌玩家的底牌大小,底牌牌值最大的玩家即为胜者。

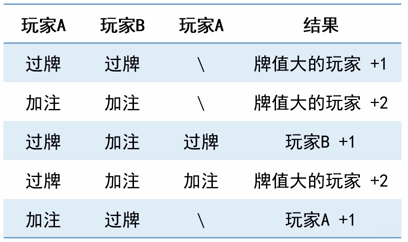

- 游戏规则:

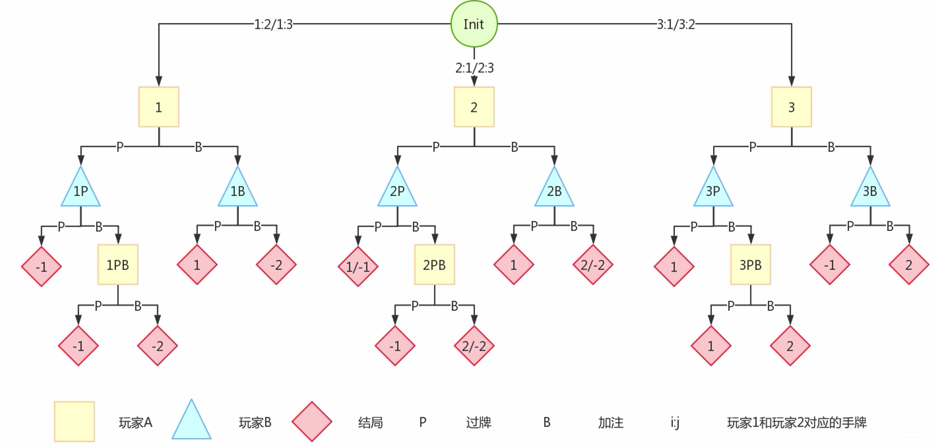

库恩扑克(Kunh's pocker):以先手玩家(定义为玩家$A$)为例的博弈树:

从初始节点开始,1、2、3分别表示玩家$A$手中的牌,当玩家拿了1之后,玩家$B$只能拿2或者3。玩家$A$选择过牌还是加注,玩家$B$也可以选择过牌还是加注。依次进行下去,就构建了博弈树。

- 在这个博弈树里面,总共的信息集与12个:{1,1P,1B,1BP,2,2P,2B,2BP,3,3P,3B,3BP}。

- 每个信息集由不同路径可以到达。如信息集1PB可通过如下路径到达:

$$ 1_{玩家A拿到大小为1的纸牌}\rightarrow 1P_{玩家A采取过牌行动} \rightarrow 1PB_{玩家B采取加注行动} $$

可见信息集$1PB$所对应的行动序列为{P,B}

- 在该问题中,到达每个信息集的路劲均唯一,因此所有信息集仅对应一个行动序列。

有了上述定义之后,我们可以采取如下算法进行策略选择:

- 初始化遗憾值和累加策略表为0

- 采用随机选择的方法来决定策略

- 利用当前策略与对手进行博弈

- 计算每个玩家采取每次行为后的遗憾值

- 根据博弈结果计算每个行动的累加遗憾值大小来更新策略

- 重复博弈若干次

- 根据重复博弈最终的策略,完成最终的动作选择

计算1PB的遗憾值

- 假设初始情况下,两个玩家都以随机选择的策略进行决策,即在任一节点,都以50%的概率分别选择过牌和加注

- 若第一轮中,玩家$A$的博弈过程为$1 \overset{P}{\rightarrow}1P \overset{B}{\rightarrow}1PB \overset{B}{\rightarrow} Z_{2}$,收益为$u_{A}(Z_{2})=-2$。

计算玩家$A$针对信息集$\{1PB\}$选择“过牌”行动的遗憾值:

- 在当前策略下,行动序列$h=\{PB\}$产生的概率:

$$ \pi_{B}^{\sigma}(h) = 1 \times 0.5 = 0.5 $$

由于在 $\{1PB\}$节点选择加注和过牌的概率均为50%,所以当前策略下,从行动序列$h$到达终结状态$z_{1}$和$z_{2}$的概率分别为:

$$ \pi^{\sigma}(h,z_{1})=0.5,\pi^{\sigma}(h,z_{2})=0.5 $$

又已知$u_{A}(z_{1})=-1$,$u_{A}(z_{2})=-2$,可知当前策略的虚拟价值:

$$ v_{A}(\sigma,h)=\pi_{B}^{\sigma}(h) \times \pi^{\sigma}(h,z_{1}) \times u_{A}(z_{1})+\pi_{B}^{\sigma}(h) \times \pi^{\sigma}(h,z_{2}) \times u_{A}(z_{2}) \\ = 0.5 \times0.5 \times (-1) + 0.5 \times 0.5 \times (-2) = -0.75 $$

- 若使用过牌策略,即$\sigma_{\{1PB\} \rightarrow P}$,此时玩家$B$促使行动序列$h=\{P,B\}$达成的概率仍然为$\pi_{B}^{\sigma}(h)=0.5$,由于最终抵达的终结状态只有$z_{1}$,所以$\pi^{\sigma}(h,z_{1})=1$。

- 则最终选择过牌的虚拟价值为:

$$ v_{A}(\sigma_{\{ 1PB\}\rightarrow P}, h) = \pi_{B}^{\sigma}(h) \times \pi^{\sigma}(h,z_{1}) \times u_{A}(z_{1})=0.5 \times 1 \times (-1) = -0.5 $$

- 在信息集$\{1PB\}$上采取“过牌”的遗憾值

$$ r(I,P)=r(h,P)=v_{A}(\sigma_{\{1PB\}\rightarrow P},h)-v_{A}(\sigma, h)=(-0.5)-(-0.75)=0.25 $$

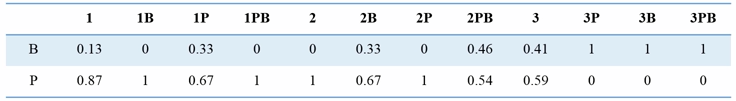

- 库恩扑克的博弈共有12个信息集,对应上图中的正方形和三角形

- 通过反复迭代计算,可以得到到达各个信息集应采取行动的概率:

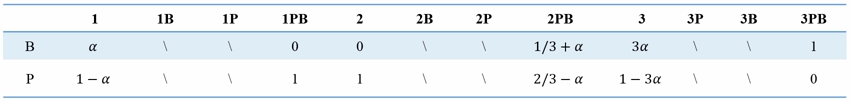

- 对于玩家$A$而言,库恩扑克的混合策略纳什均衡的理论解如下($\alpha \in [0,1/3]$):

可见,算法得到的解与理论得到的解之间较为接近,验证了算法的有效性。

我的微信公众号名称:深度学习与先进智能决策

微信公众号ID:MultiAgent1024

公众号介绍:主要研究分享深度学习、机器博弈、强化学习等相关内容!期待您的关注,欢迎一起学习交流进步!