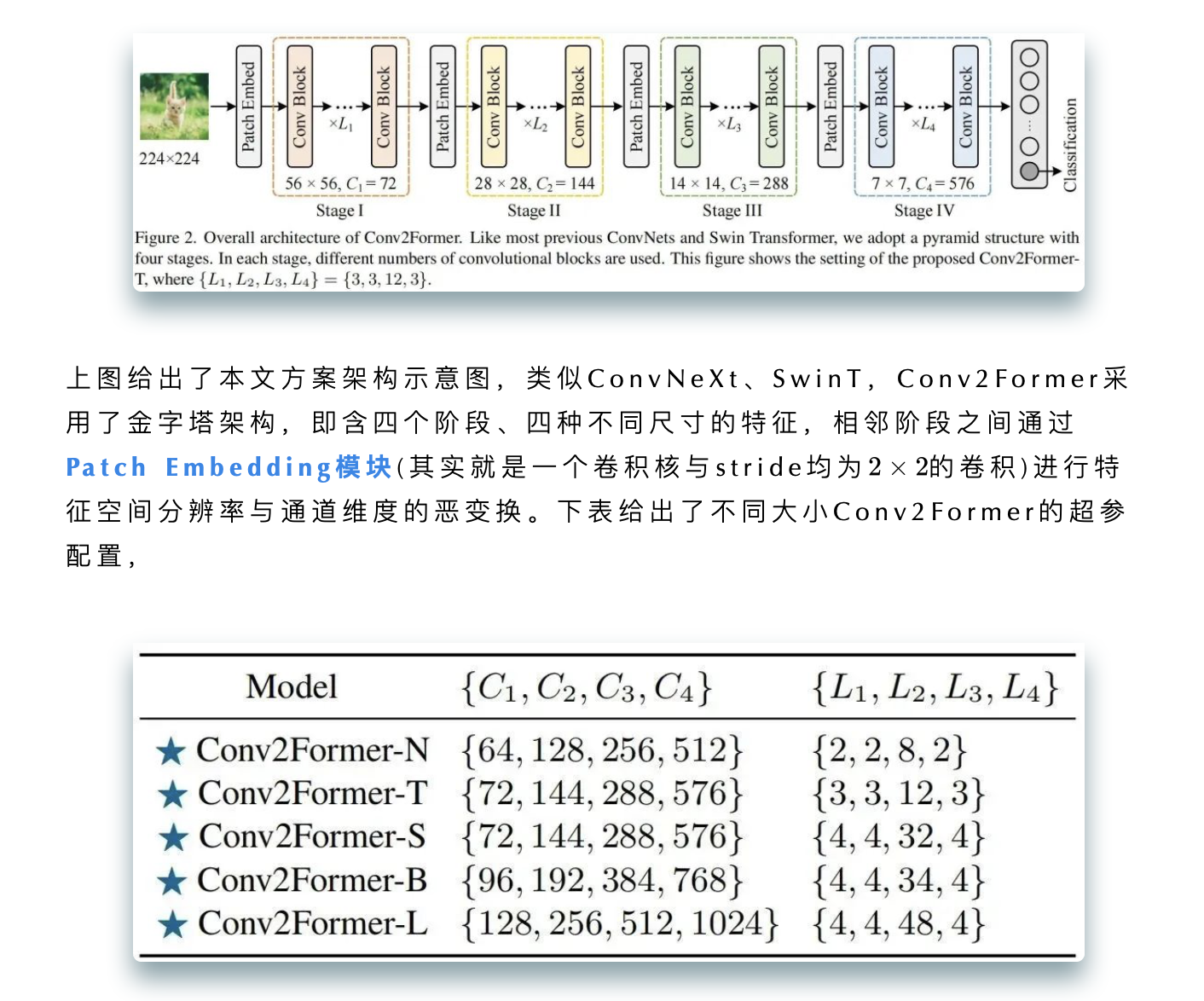

本文旨在通过充分利用卷积探索一种更高效的编码空域特征的方式:通过组合ConvNet与ViT的设计理念,本文利用卷积调制操作对自注意力进行了简化,进而构建了一种新的ConvNet架构Conv2Former。ImageNet分类、COCO检测以及ADE20K分割任务上的实验结果表明:所提Conv2Former取得了优于主流ConvNet(如ConvNeXt)、ViT(如Swin Transformer)的性能。

本文方案

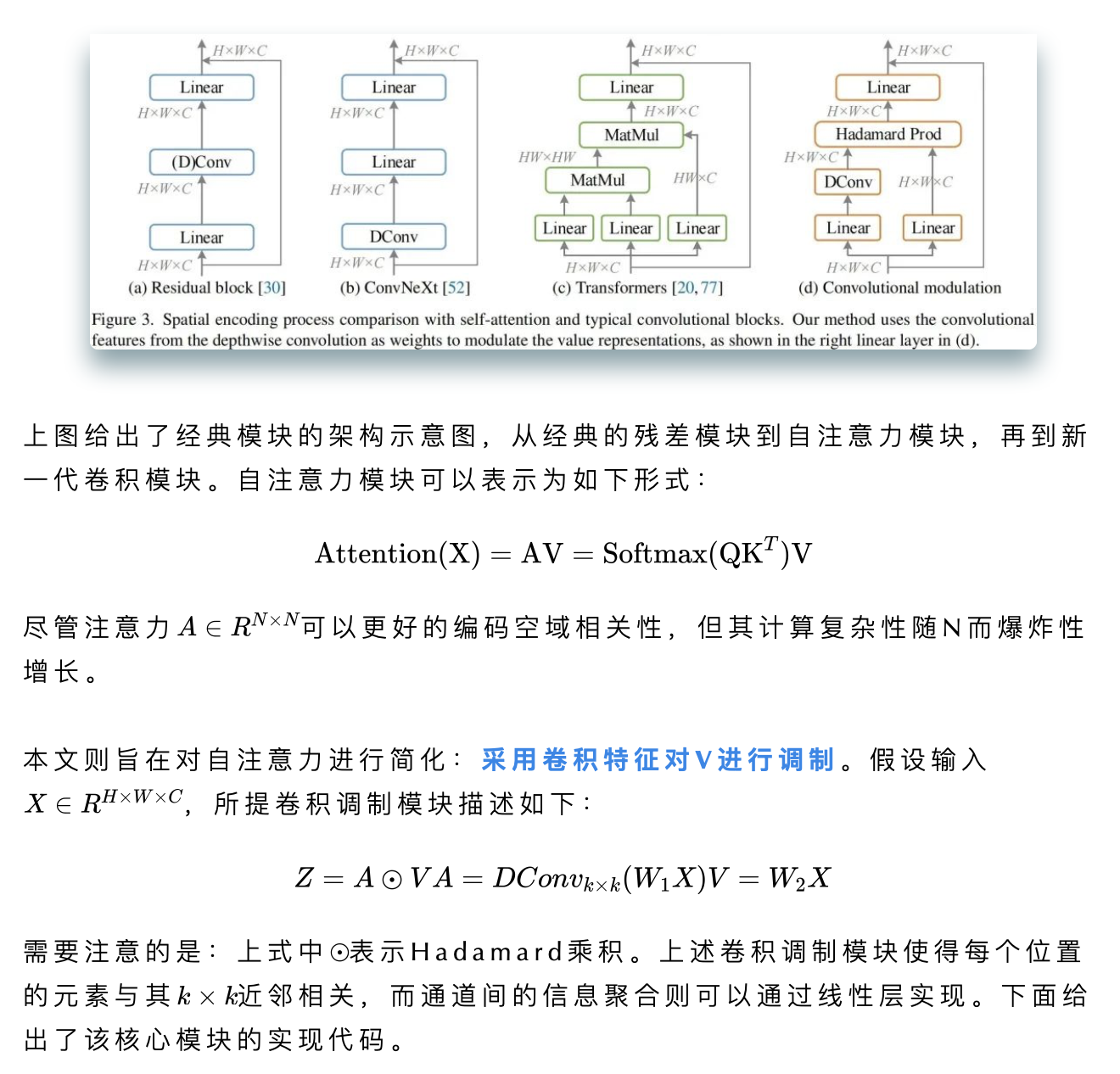

核心模块

class ConvMod(nn.Module):

def __init__(self, dim):

super().__init__()

self.norm = LayerNorm(dim, eps=1e-6, data_format='channel_first')

self.a = nn.Sequential(

nn.Conv2d(dim, dim, 1),

nn.GELU(),

nn.Conv2d(dim, dim, 11, padding=5, groups=dim)

)

self.v = nn.Conv2d(dim, dim, 1)

self.proj = nn.Conv2d(dim, dim, 1)

def forward(self, x):

B, C, H, W = x.shape

x = self.norm(x)

a = self.a(x)

v = self.v(x)

x = a * v

x = self.proj(x)

return x

微观设计理念

本文实验

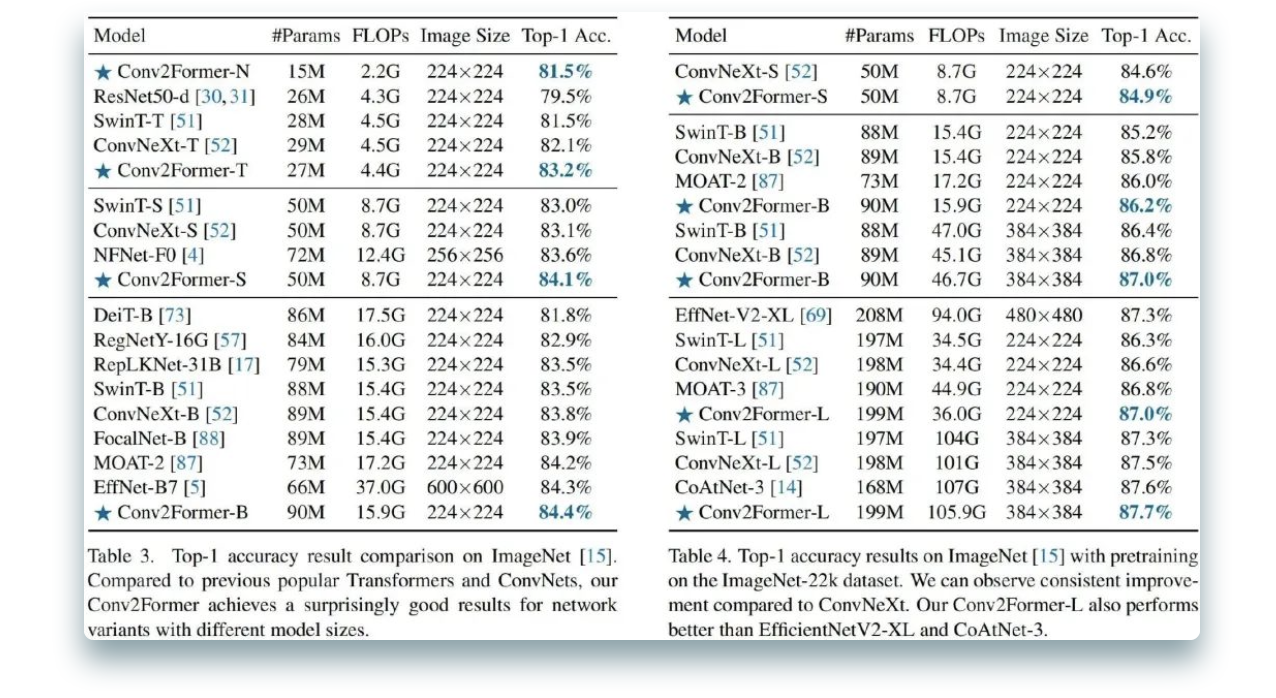

上述两表给出了ImageNet分类任务上不同方案的性能对比,从中可以看到:

- 在tiny-size(<30M)方面,相比ConvNeXt-T与SwinT-T,Conv2Former-T分别取得了1.1%与1.7%的性能提升。值得称道的是,Conv2Former-N仅需15M参数量+2.2GFLOPs取得了与SwinT-T(28M参数量+4.5GFLOPs)相当的性能。

- 在base-size方面,相比ConvNeXt-B与SwinT-B,Conv2Former-B仍取得了0.6%与0.9%的性能提升。

- 相比其他主流模型,在相近大小下,所提Conv2Former同样表现更优。值得一提的是,相比EfficientNet-B7,Conv2Former-B精度稍有(84.4% vs 84.3%),但计算量大幅减少(15G vs 37G)。

- 当采用ImageNet-22K预训练后,Conv2Former的性能可以进一步提升,同时仍比其他方案更优。Conv2Former-L甚至取得了87.7% 的优异指标。

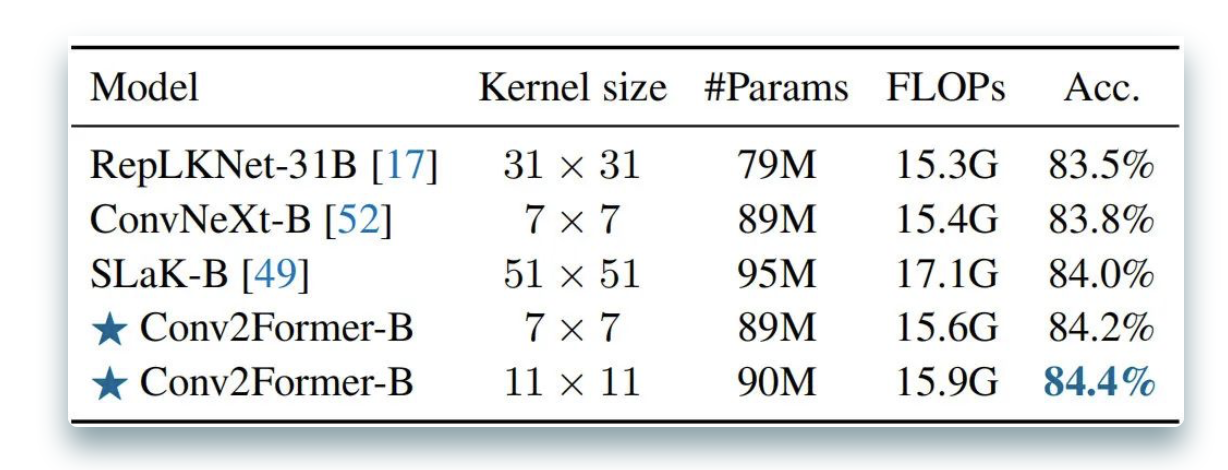

采用大核卷积是一种很直接的辅助CNN构建长程相关性的方法,但直接使用大核卷积使得所提模型难以优化。从上表可以看到:当不采用其他训练技术(如重参数、稀疏权值)时,Conv2Former采用时已可取得更好的性能;当采用更大的核时,Conv2Former取得了进一步的性能提升。

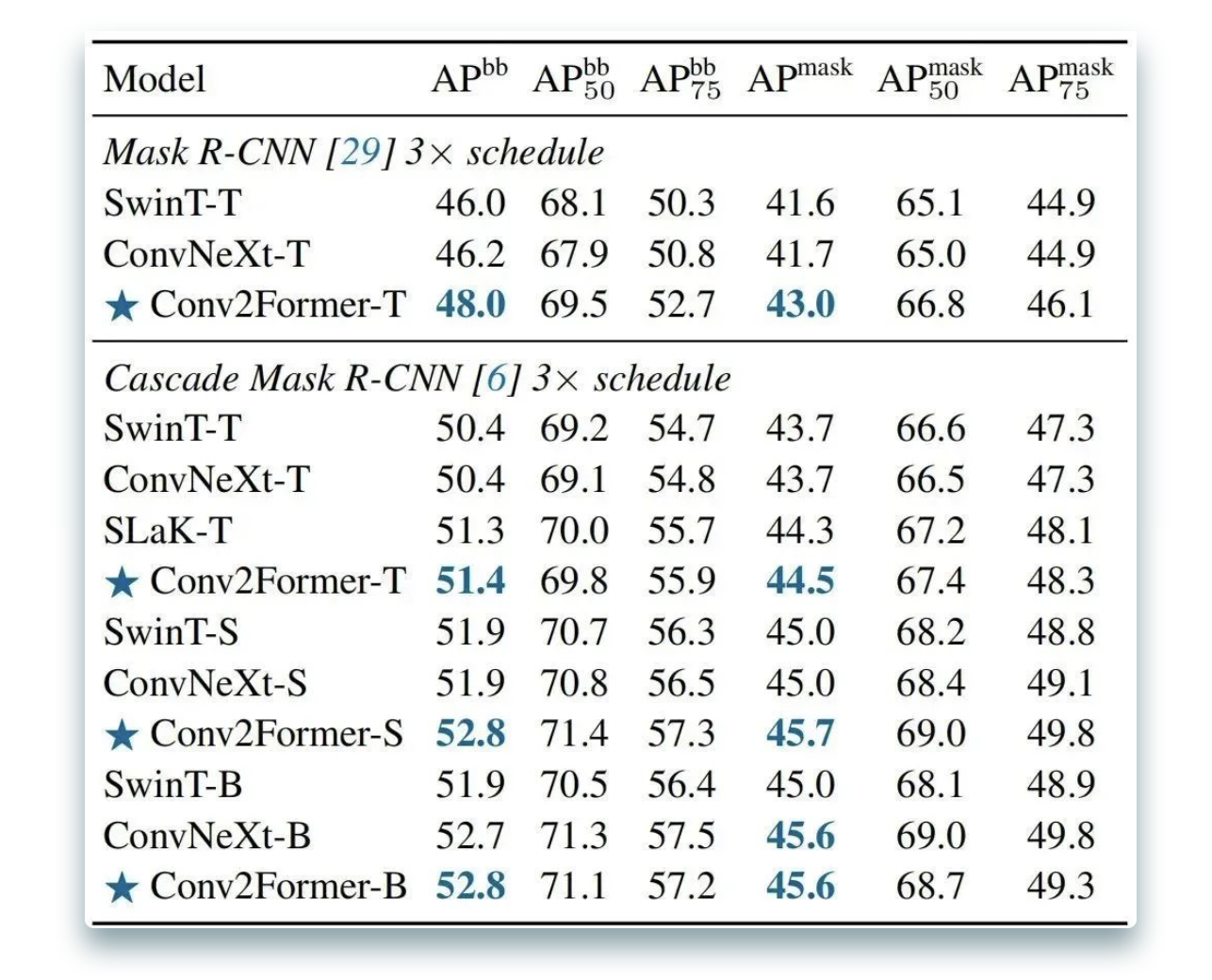

上表给出了COCO检测任务上不同方案的性能对比,从中可以看到:

- 在tiny-size方面,相比SwinT-T与ConvNeXt-T,Conv2Former-T取得了2% 的检测指标提升,实例分割指标提升同样超过1%;

- 当采用Cascade Mask R-CNN框架时,Conv2Former仍具有超1%的性能提升。

- 当进一步增大模型时,性能优势则变得更为明显;

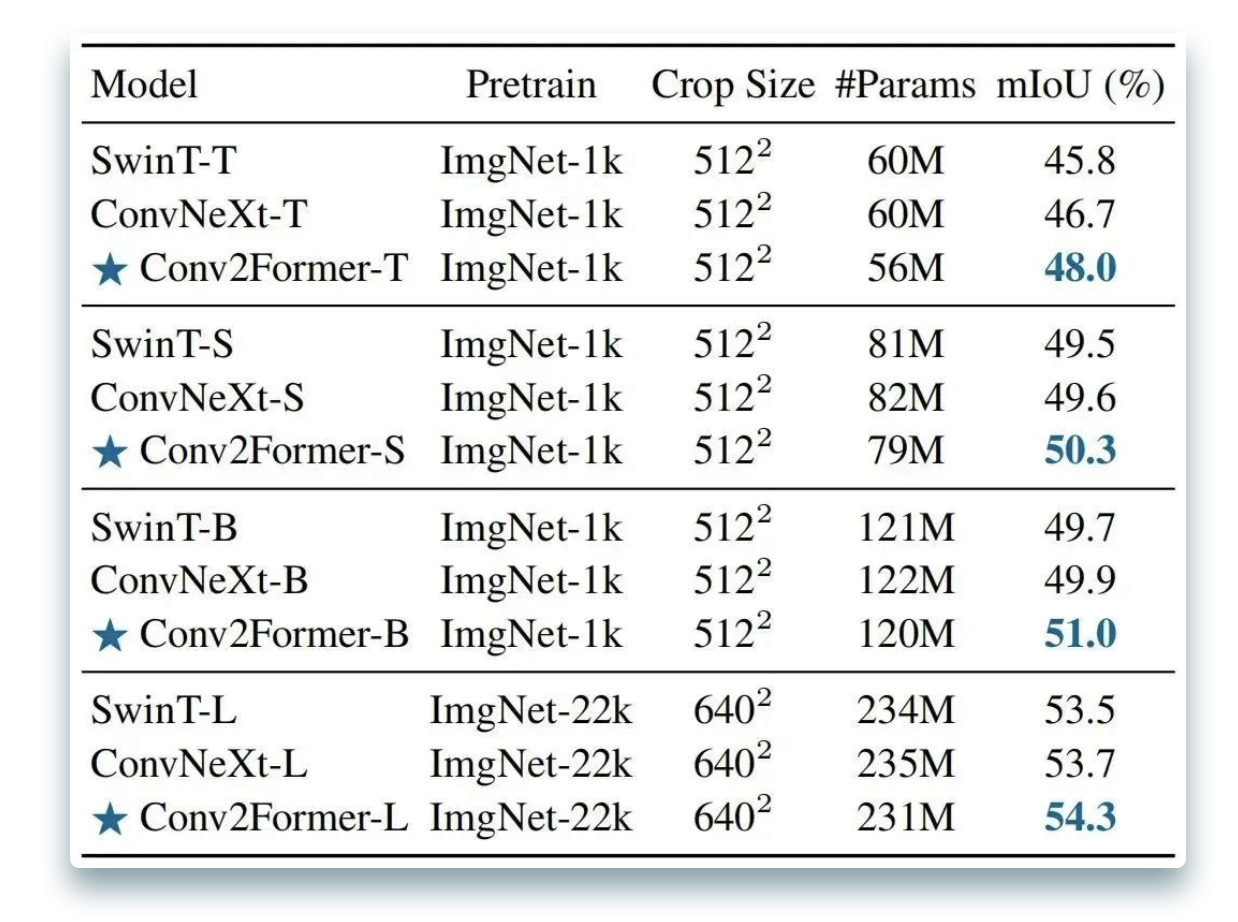

上表给出了ADE20K分割任务上的性能对比,从中可以看到:

- 在不同尺度模型下,Conv2Former均具有比SwinT与ConvNeXt更优的性能;

- 相比ConvNeXt,在tiny尺寸方面性能提升1.3%mIoU,在base尺寸方面性能提升1.1%;

- 当进一步提升模型尺寸,Conv2Former-L取得了54.3%mIoU,明显优于Swin-L与ConvNeXt-L。

一点疑惑解析

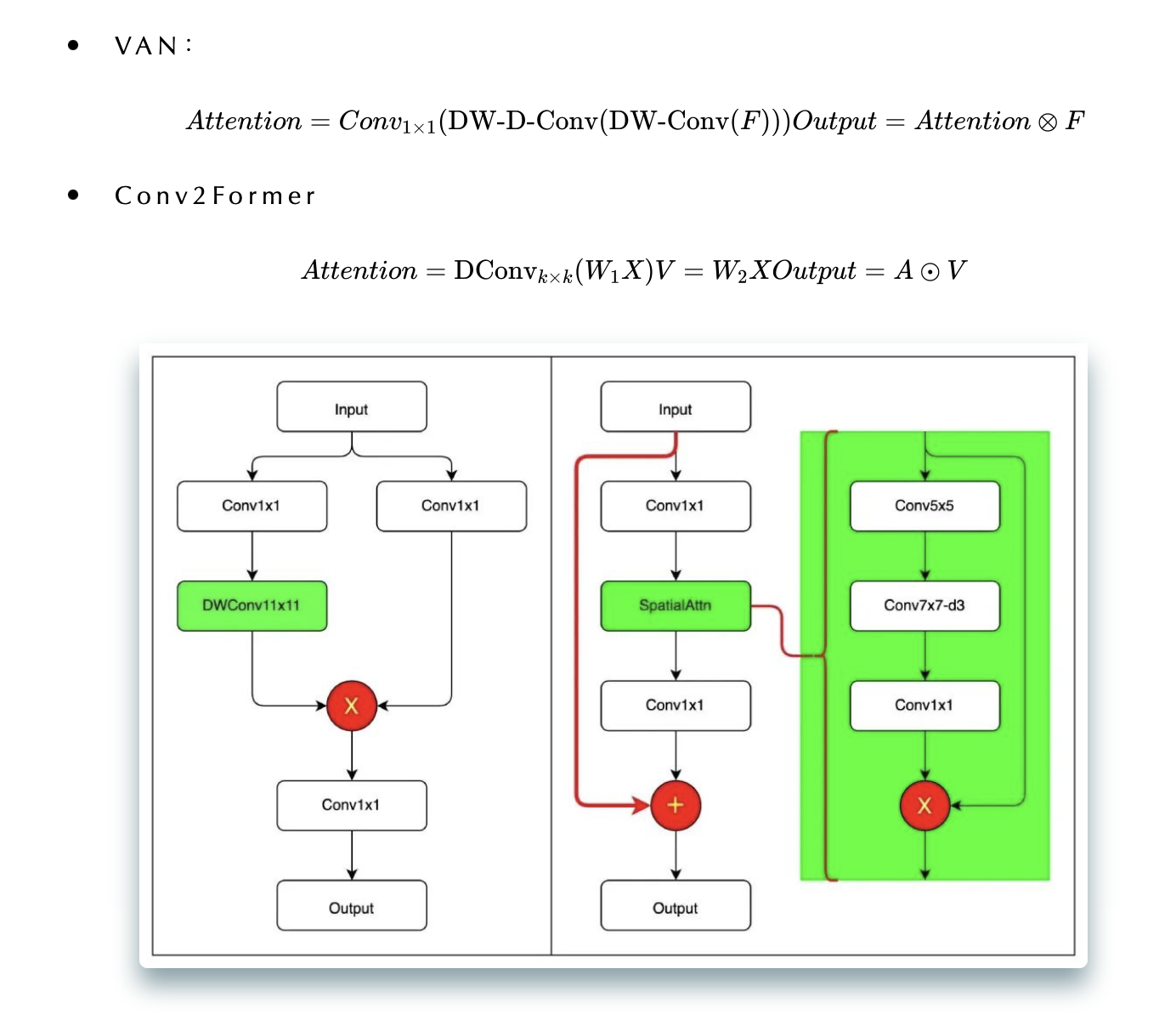

到这里,关于Conv2Former的介绍也就结束了。但是,心里仍有一点疑惑存在:Conv2Former与VAN的区别到底是什么呢?关于VAN的介绍可参考笔者之前的分享:《优于ConvNeXt,南开&清华开源基于大核注意力的VAN架构》。

先来看一下两者的定义,看上去两者并无本质上的区别(均为点乘操作),均为大核卷积注意力。

结合作者开源代码,笔者绘制了上图,左图为Conv2Former核心模块,右图为VAN核心模块。两者差别还是比较明显的!

- 虽然大核卷积注意力均是其核心,但Conv2Former延续了自注意力的设计范式,大核卷积注意力是其核心;而VAN则是采用传统Bottleneck设计范式,大核卷积注意力的作用类似于SE。

- 从大核卷积内在机理来看,Conv2Former仅考虑了的空域建模,而VAN则同时考虑了空域与通道两个维度;

- 在规范化层方面,Conv2Former采用了Transformer一贯的LayerNorm,而VAN则采用了CNN一贯的BatchNorm;

- 值得一提的是:两者在大核卷积注意力方面均未使用Sigmoid激活函数。两者均发现:使用Sigmoid激活会导致0.2%左右的性能下降。

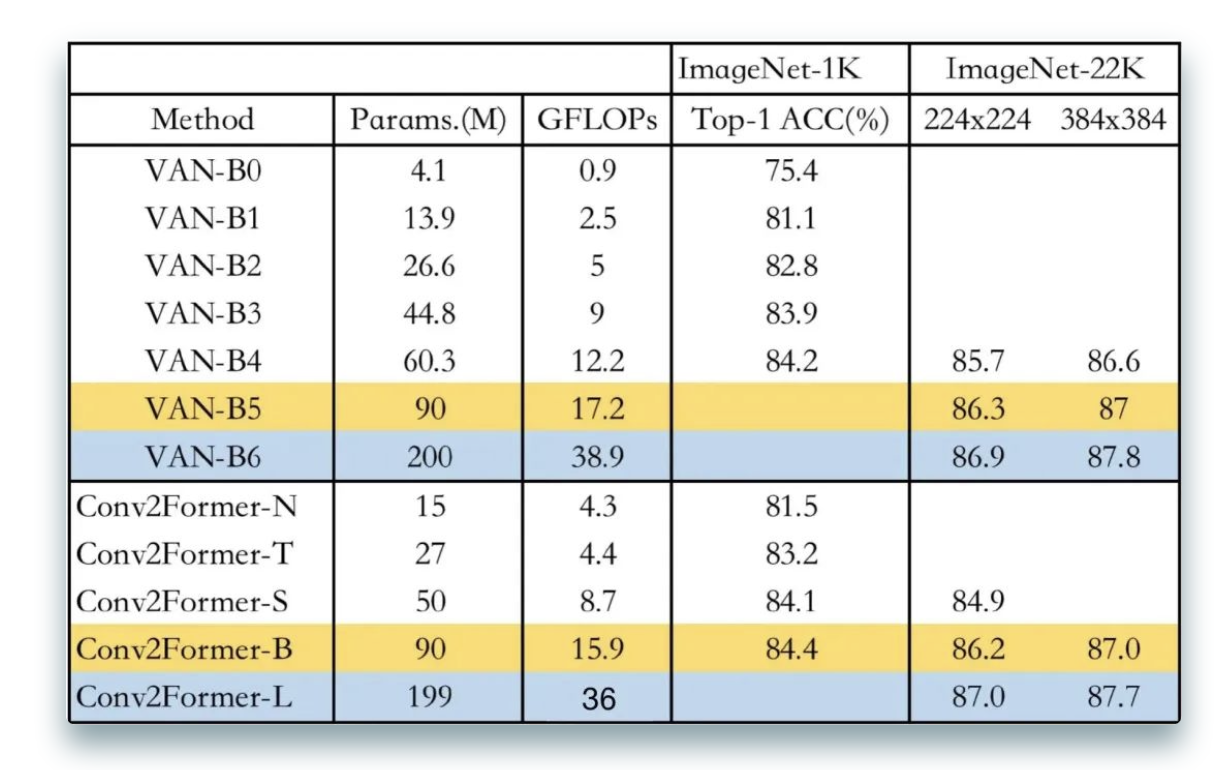

为更好对比Conv2Former与VAN的性能,特汇总上表(注:GFLOPs列仅汇总了)在Image输入时的计算量Net-1K上的指标进行了对比,可以看到:在同等参数量前提下,两者基本相当,差别仅在0.1%。此外,考虑到作者所提到的“LN+GELU的组合可以带来0.1%-0.2%的性能提升”,两者就算是打成平手了吧,哈哈。

来源:AIWalker

作者: Random

推荐阅读

- 端侧高效骨干RepGhost | 重参数赋能GhostNet,达成端侧超高效骨干

- PP-YOLOE-R | 手把手教你将PP-YOLOE用于旋转目标检测,顺带达成SOTA性能!

- 重磅干货|低光图像处理方案

- VapSR | 手把手教你改进PAN,董超团队提出超大感受野注意力超分方案,已开源!

本文章著作权归作者所有,任何形式的转载都请注明出处。更多动态滤波,图像质量,超分辨相关请关注我的专栏AIWalker。欢迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。