作者 | 吴菲凝 李水青

编辑 | 心缘

最近几天,AI新骗局在全国炸开了锅。

前有AI论文造假和新闻造假,后有疑似AI换脸的杨幂、迪丽热巴出现在直播间卖货。昨日内蒙古包头的一起“AI电信诈骗10分钟骗走430万”登上微博热搜,引起全民关注。

就在今早,一组引起美股大跌的五角大楼爆炸图片被官方证实为假,疑似由AI合成。

随着AI技术掀起新一波落地潮,AI深度伪造(DeepFake)内容在全球范围内病毒式传播,引起产业的强烈担忧。

早在2019年,智东西就调查报道过深度伪造AI换脸黑产(《AI换脸黑产:100元打包200部换脸情色片,5张照片就可定制视频》)近年来,深度伪造技术与反深度伪造技术的博弈持续不断,相关部门也逐步完善监管法律法规。当下,随着以GPT-4为代表的AI大模型技术迭代进化,深度伪造内容正卷土重来,从而在全球掀起更大的风浪。

从文章到图片,从人声到视频的动态效果都能被最大程度还原,瞒天过海骗过公众,更有各种诈骗套路层出不穷、防不胜防。这些AI伪造内容对很多年轻人来说都真假难辨,老人、小孩则更容易上当受骗。而一旦他们的信任被不法分子用来违法犯罪,后果不堪设想。

有人工智能技术专家告诉智东西,对于目前这些AI深度伪造技术生成的音视频等内容,普通人用肉眼来鉴别的难度非常之大。

传统骗局换上了一件由AI包裹的“新外衣”,更为隐蔽也更加让人防不胜防。这些AI新骗局是如何骗人的?难辨真假的AI伪造内容需要怎么去识破?产业乱象又有什么样的解法?通过对市面上各种AI新骗术进行梳理分析,本文对这些问题进行了深入探讨。

一、10分钟换脸视频骗走430万,这四大AI新骗局要警惕

今年3月,一份名为《暂停大型人工智能研究》的公开信在未来生命研究所官网上发布,包括特斯拉CEO埃隆·马斯克(Elon Musk)、苹果公司联合创始人史蒂夫•沃兹尼亚克(Steve Wozniak)等人在内的千名科学家、企业高管签字呼吁暂缓GPT-4以上版本的研发,他们矛头所指都是强大AI技术可能的负面用途。

AI负面用途的爆发远快于我们的想象。随着AI技术能力加速迭代和落地,AI伪造变得更加容易、内容也更为逼真,随之而来的是假新闻、假图片络绎不绝,变声、换脸造成的恶性事件引发社会担忧。很多人感到,“有图有真相”、“眼见为实”的常识似乎受到了有史以来最猛烈的冲击。

1、换脸视频:10分钟骗走430万

或许我们的身边已经发生了不少由AI换脸引发的恶性事件,只是我们尚未察觉。

近日,内蒙古包头市自治区公安局网侦部门侦破一起利用AI进行电信诈骗的案件,罪犯假借好友名义称自己急需用钱,并拨打微信视频联系这位受害者郭先生。

出于对于好友的信任,再加上已经视频聊天核实了对方的身份,郭先生放松了警惕,分两笔汇款将430万打到了罪犯的银行卡上,但他万万没想到所谓的微信视频通话中的“好友”是由AI换脸技术制作而成的。罪犯利用AI换脸技术,佯装成好友对他进行电信诈骗。目前在警方拦截下,已追回336.84万元,仍有93.16万元已被转移走。

AI换脸是最容易获取对方信任的一类诈骗手段,诈骗者往往利用AI技术换脸成受害者熟悉的人,并拨打电话和对方确认信息。

面对这类新型诈骗方式,一是需要保护好个人信息,不轻易提供任何涉及个人隐私的信息给他人,不随意点进陌生链接、下载陌生软件;二是要通过各种渠道核验对方身份,对潜在风险保持警惕。

和“AI换脸”功能极为相似的是“AI脱衣”。早在今年3月,一则“女子地铁照被AI一键脱衣传播”的新闻冲上了热搜,一名女性搭乘地铁时的一张照片被人用AI软件“一键脱衣”,遭到恶意传播,罪犯还广泛散步不实信息对该女子进行污蔑。

这样的“一键脱衣”技术早在2019年时就已在国外出现,但因广泛的舆论争议和声讨,项目迅速关闭下架。这股不良之风在今年的AI热中再次吹到国内,在网络上以“AI”、“换装”、“软件”等关键词组合搜索时仍能出现不少隐藏极深的相关软件,有心者甚至用此来制作、传播色情淫秽视频,AI视频变装服务已成为一门链条完整的黑色产业。

“AI换脸”在此前已被大量使用到影视剧二度创作、趣味恶搞视频、表情包制作当中,但其中隐藏的法律风险和侵权纠纷依旧不容忽视。近期,据企查查官网信息显示,上海鱼腥草信息科技有限公司就因旗下一款换脸手机APP而遭多位网红博主起诉。

早些时候,一位名为“特效合成师洪亮”的视频博主在自己的视频中,将电视剧《你是我的荣耀》中男主演杨洋的脸,通过AI换脸技术换成了自己的脸,最终遭到主演粉丝的追打,从而引起了不少网友的注意。

这位视频博主以换脸男明星为噱头,实则是给自己的影视特效制作付费课程引流,但行为上已经给出演电视剧的演员迪丽热巴、杨洋等人造成了侵权。《狂飙》爆火之后,也有不少粉丝将剧情片段与电视剧版《西游记》换脸进行二度创作,在传播度和话题讨论上为电视剧又贡献了一波热度,但却对出演电视的演员造成了一定困扰。

蹭流量的行为,无论是对被换脸的明星,还是对技术充满好奇的公众,都产生了不良的影响和困扰,娱乐和技术之间的界限不应模糊至此。

2、声音合成:复刻人声瞒天过海

前有“AI孙燕姿”爆火,后有AI人声克隆闯入配音圈,AI的声音合成技术被炒得火热,也衍生出不少的恶性事件和相关受害者。

一位网友用美国知名歌手弗兰克·奥什(Frank Ocean)的歌曲片段训练出来仿冒其音乐风格的歌曲,并在地下音乐论坛上发布栏这些“音乐作品”,还将这些歌曲伪造成是在录音时不小心泄露的版本,最终蒙混过关,卖出了近970美元(折合为6700元人民币)的价格。

不久之前,西班牙的一家电影制作公司Peabody Films也遭受了AI电话的诈骗,诈骗者伪装成著名演员“卷福”本尼迪克特•康伯巴奇(Benedict Cumberbatch)向公司称对公司的电影很感兴趣,有合作意向,但需要公司先转20万英镑(折合约170万人民币)的定金,之后再谈具体的合作细节。

电影公司意识到了事情的不对劲,向该演员的经纪公司进行求证才发现从头到尾就是一场AI骗局。

海外还有不少利用AI克隆声音进行诈骗勒索的新闻,部分案件涉案金额令人咋舌,高达百万美金。这类诈骗者往往通过电话录音等素材提取某人的声音进行声音合成,再利用伪造后的声音来骗过熟人,就这需要公众对陌生电话保持警惕,即使是熟人也可能被伪造声音。

美国CBS电视台的电视新闻杂志节目60 Minutes在5月22日的最新一期节目中,现场展示了黑客是怎样克隆声音来骗过同事,并成功窃取护照信息的。

仅用了5分钟时间,黑客就通过AI克隆复制了Sharyn的声音,并通过工具替换了手机上来电显示的名称,成功骗过了她的同事,轻而易举地得到了她的姓名、护照号码等私人信息。

3、伪造照片:特朗普“被捕”,教皇穿羽绒服走秀

在AI换脸视频铺天盖地传播的情况下,AI假照片更是泛滥成灾。

美东时间5月22日,一张五角大楼附近地区发生爆炸的图片在社交媒体上疯传。这张虚假照片的广泛流传,甚至导致标普500指数短线下跌约0.3%至盘中低点,由涨转跌。

随后美国国防部发言人立即证实,这同样是一张由AI生成的虚假图片,这张图具有明显的AI生成特征,比如路灯有些歪,围栏长在了人行道上等。

Midjourney生成的90年代情侣写真已经让网友真假难辨,3月时几张前美国总统特朗普被捕的组图在推特上疯传。

照片中的特朗普被警察包围,又按倒在地,看上去狼狈又慌乱。在听证会上,他掩面痛哭,还在潮湿阴暗的囚房中穿上了狱服。这些图片由公民记者网站Bellingcat的创始人艾略特·希金斯(Eliot Higgins)用Midjounrney制作而成。组图发出后,他的账号也随之被封查。

“特朗普被捕图”发出不久之后,教皇方济各穿着巴黎世界羽绒服走秀的照片在网上引起轩然大波,发出不久后便有了2800多万的点击量,让不少网友都信以为真。

创作者巴勃罗·泽维尔(Pablo Xavier)称,自己完全没想到这组图片居然会走红,自己只是突然想到了巴黎世家的羽绒服、巴黎或者罗马的街道等。

Reddit论坛上的Midjourney板块中,一组“2001年卡斯卡迪亚9.1级大地震,引发的海啸摧毁了俄勒冈州”被大面积传播,照片当中的受灾现场一片混乱,救灾人员、新闻记者、政府官员等人相继出现,人们面带忧虑、惊恐和慌张。但实际上这完全是一张AI引发的“灾难”,历史上并不存在。而这些要素齐全、颜色真实的图片场景让人看上去难辨真伪。

4、编撰新闻:AI成为谣言炮制机

5月7日,甘肃省平凉市公安局网安大队侦破了一起AI炮制虚假信息的案件。

据悉,犯罪利用ChatGPT将自己从全网中搜集而来的社会热点新闻修改编辑,编撰出一条“今晨甘肃一火车撞上修路工人致9人死亡”的虚假新闻,借此来获取网络流量和关注度来变现。

此条新闻一经发布后便获得了超1.5万点击量,好在警方在舆论进一步发酵前介入调查,证实是犯罪嫌疑人利用AI技术进行的新闻造假。

不光是读者们需要鉴别钓鱼网站中的AI假新闻,老牌媒体有时也会被AI虚假新闻蒙骗。

英国《每日邮报》(The DailyMail)曾在4月24日刊登过一则新闻,称“一位22岁的加拿大男子为在韩国以偶像身份出道而整容12次,最终丧命”。

该新闻引起全球多家媒体关注,韩国YTN新闻频道等电视台迅速跟进报道,网友们对此也表示了自己的同情与惋惜。

然而事情在一位驻韩记者以及美国广播电台iHeartRadio提出质疑后全面反转:该男子可能压根就不存在。网友将其照片拿去AI内容检测网站查证后发现,照片有75%的可能性是AI生成的,韩国MBC电视台求证警方后也得到了“未收到类似死亡案例报告”的回复,这则新闻立刻被证实为“AI造假新闻”。

但是事情还未结束,本月初,该男子的家人决定起诉报道过“假新闻”的媒体以及男子所属的经纪公司,还有第一位宣称男子已死亡的记者。言下之意就是,照片并非是AI生成的,男子的确因整容过度而引发的手术并发症而丧命。

多家媒体在未经核实身份,也没手握实质性证据的情况下,称该男子的身份和信息都是编纂的,让一场由AI引发的闹剧彻底变为了一场惨痛的悲剧。

这些由AI编篡出的新闻不仅混淆了大众的视听,更是让本就没有时间和耐心看清事情全貌的路人们失去了分辨真相的能力。

二、被“AI”过的明星们:“AI孙燕姿”翻唱爆火,“AI杨幂”换脸卖货

当AI技术泛滥时,娱乐圈明星成了首当其冲的重灾区。

近日爆火的孙燕姿在昨晚对“AI孙燕姿”的出现发长文给予回应。

她对于“AI孙燕姿”的出现采取了较宽容的态度,并未通过法律手段进行追究。她称:“无法跟一个没几分钟就能推出一首新专辑的‘人’来比。”她认为,虽然它(AI)既没有情绪,也没有音调的变化,但人类再怎么快也无法超越它。

从回应中不难看出,虽然孙燕姿对AI生成的音乐并不欣赏,但人类确实难以在一时之间赶超机器人的学习能力,她选择对这些热歌翻唱视频淡然处之。

最早是因为AI翻唱而重新进入大众视野的歌手孙燕姿,因其独特的音色和唱腔风格和多首热门歌曲都有极高的适配度,在网友的AI技术下,她“翻唱”的《发如雪》《下雨天》《我记得》等歌曲播放量均破百万。

而孙燕姿也并非是唯一一位被“AI翻唱”的歌手,还有AI周杰伦、AI王心凌、AI腾格尔等人陆续出现。

尽管孙燕姿选择不追究法律责任,但当AI技术已经滥用到损害商业利益、触及法律红线时,还需要及时维护自己的正当权益。

据中国新闻网报道,近日,有多个直播间都开始采用AI换脸明星的方式进行直播带货,女明星如杨幂、迪丽热巴、Anglebaby等人成了重点换脸对象,明星脸的带货主播能达到更好的引流效果,并节省广告宣传成本,消费者或明星粉丝可能会冲着明星效应进行消费而被坑骗。

据提供换脸服务的网站介绍,购买现成模型,如果素材充足的话,只用半个小时到几个小时的事件就能直接合成长达几小时的视频,全套模型的购买价格为3.5万元,远低于邀请一位明星本人直播带货的报价。

在几大主流电商平台中,“AI换脸”“视频换脸”等关键词都被平台屏蔽,但通过转换搜索关键词以及其他方式仍能找到不少相关商品。

AI换脸技术并非是近期才兴起。早在2017年,一位名为DeepFake网友将情色电影中的女主角换脸成好莱坞明星盖尔·加朵(Gal Gadot),这是AI换脸技术首次出现在公众视野当中。后来由于大量投诉者表示不满,其账号被官方封禁,而此后的AI换脸技术则以他的名字命名为“DeepFake”。

AI换脸真正在国内火起来是在2019年初,一段通过AI技术将《射雕英雄传》中黄蓉扮演者朱茵的脸替换为杨幂的视频在网络上热传,有网友表示毫无违和感,也有网友提出可能会侵犯原扮演者的肖像权,制作者肖先生对此回应称:主要适用于技术交流,不会用于营利行为。

▲网友将演员朱茵在《射雕英雄传》中扮演的“黄蓉”一角替换为演员杨幂的脸

这也成为国内使用AI进行影视剧二创的的早期开端。

AI技术如今早已被不法分子盯上,并用于各类层出不穷的换脸花样上,不止是娱乐圈明星,也有不少普通人被所谓的“私密照片”敲诈勒索。多位网络安全部门的民警称,AI深度合成技术在之前因为缺少监管,造成了不少信息安全隐患和网络传播乱象,甚至间接导致了刑事案件的发生。

三、一场大型AI普法运动兴起,哪些行为侵权违法了?

很多人的肖像、声音在未经允许的情况下被传播,影音产品在未谈版权的情况下被拿来使用牟利,更有甚者是违法分子利用伪造信息进行财产诈骗甚至绑架勒索,损害人们的人身及财产权益。

面对这些更加恶劣的情况,人们需要拿起法律的武器保护自己,由此而来的将是一场有利于产业发展的大型AI普法运动。

面部和声音的伪造横行,首先面临的是个人隐私侵权问题。根据《民法典》第一千零一十九条:“任何组织或者个人不得以丑化、污损,或者利用信息技术手段伪造等方式侵害他人的肖像权。未经肖像权人同意,不得制作、使用、公开肖像权人的肖像,但是法律另有规定的除外。”同时,“对自然人声音的保护,参照适用肖像权保护的有关规定。”而让人们更担心的是,伪造信息如果落到不发分子手里,可能会进一步利用信任侵害人们的财产权甚至是健康权。

除了人身权利,AI伪造内容涉及的影音素材的版权侵权问题也备受关注。近期,歌手孙燕姿发文称表示了对“AI孙燕姿”淡然处之,但更多的被伪造的人选择拿起法律武器保护自己,比如据媒体报道,上海鱼腥草信息科技有限公司因某款换脸手机APP被多位网红博主起诉。

上海大邦律师事务所高级合伙人、知识产权律师游云庭撰文称,根据知识产权法律,用真人语音训练人工智能并生成歌曲,如果不做商用,大概率不侵权,但发布在网上还是应当先拿到相关的词曲著作权、伴奏音乐、视频使用素材的授权。人工智能生成的作品有先天的版权瑕疵,不应当享有著作权并收取授权费用。用户使用人工智能生成的作品如果被他人侵权,可以依据《反不正当竞争法》维权。

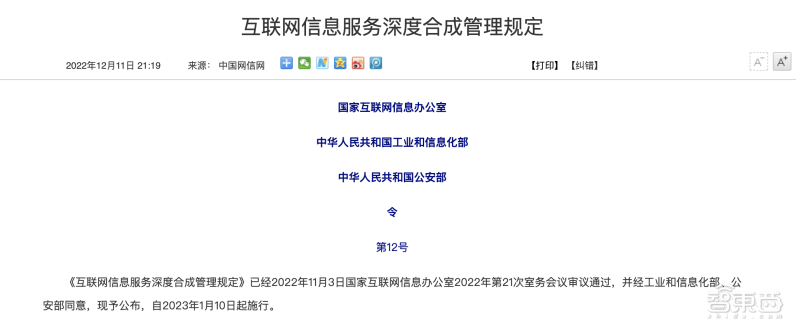

实际上,我国一些人工智能领域的专门法规也已有规定。国家网信办等部门已经在2022年12月颁布《互联网信息服务深度合成管理规定》,用25条规定划定深度合成技术使用规范,包括不得利用深度合成服务侵犯他人合法权益等法律、应用程序分发平台应当落实上架审核、服务提供和技术支持者应当加强技术管理等规定。

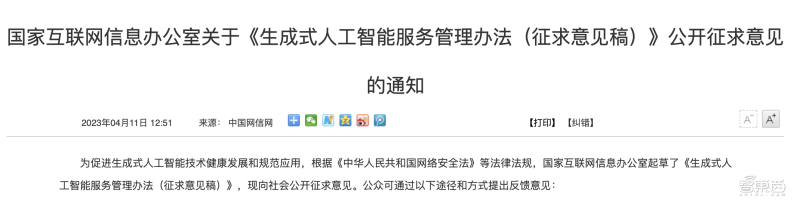

就在4月11日,国家互联网信息办公室又迅速起草了《生成式人工智能服务管理办法(征求意见稿)》,涉及的生成式人工智能包括基于算法、模型、规则生成文本、图片、声音、视频、代码等内容的技术,可以说对当下的AI伪造进行了全面的规定。(《重磅!首个国家AIGC监管文件,生成式AI服务管理办法公布征求意见稿》)

此外,我国颁布的《中华人民共和国网络安全法》、《中华人民共和国数据安全法》、《中华人民共和国个人信息保护法》、《互联网信息服务管理办法》等法律、行政法规度都对此有所规定,可以成为维护合法权益的相关依据。

四、普通人有AI内容识别“防御术”,平台要负起责任

“造假”和“打假”并不是因AI而产生,但今天的AI技术让“造假”变得更容易且更难以分辨。面对铺面而来的AI伪造内容,人们自己有没有能够去识别的技巧?

知名安全公司瑞莱智慧RealAI联合创始人、算法科学家萧子豪告诉智东西,目前深度伪造技术在不断进化,生成的声音和视频越来越逼真,普通人肉眼鉴别的难度非常大。

“普通人如果遇到这类情况,可以在视频时有意识地引导对方做一些动作,如:大幅度的摇头或张嘴。如果骗子技术手段较弱,那么我们有可能发现对方面部边缘或者牙齿的瑕疵,从而识别出AI换脸。不过,这个方法对于识别出‘高水平’的诈骗分子,还存在难度。此外,还可以追问几个只有你与借款者之间才知道的私密信息,来核实对方身份。”

“在防止自己上当受骗的同时,还要注意保护好个人图像,尽量避免在公开平台大量晒自己的照片和视频,给不法分子提供便利。因为,深伪视频制作的原材料是个人图片、视频,这些数据越多训练出的视频也就越逼真、越难以鉴别。”萧子豪补充说。

AI让骗局和错误信息变得更加难以被发现,科技公司及内容分发平台的审核把关变得更加重要。

苹果公司联合创始人史蒂夫·沃兹尼亚克(Steve Wozniak)近日在一次采访中警告称,AI内容应该被明确标记,并且需要对该行业进行监管。任何由AI生成内容都应该由发布者来承担责任,但不代表大型科技公司可以逃脱法律制裁,沃兹尼亚克认为,监管机构应该追究大型科技公司的责任。

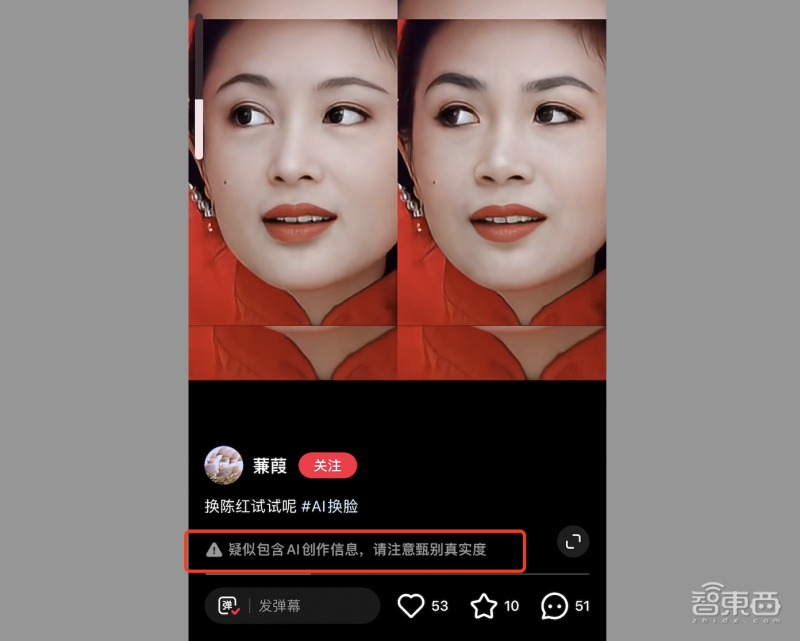

根据我国颁布的《互联网信息服务深度合成管理规定》,内容提供者需要按照对生成的图片、视频等内容进行标识等。实际上,我们已经看到小红书等国内社交平台标记了疑似AI生成内容,能起到一定预防作用。但AI生成内容的最后一个关口还在用户自己,媒体平台只能起一个过滤作用。

结语:抵制负面应用,AI攻防战打响

不断进化的AI技术让文字、图像、视频的生成变得更加容易和逼真,与此同时深度伪造内容也随之泛滥。深度伪造内容轻则混淆视听、被有心者用以谋利,重则可能被不法分子利用进行诈骗甚至勒索犯罪,引起了人们对AI生成内容监管的迫切关注。

随着AI诈骗新套路引起社会问题,产业中的用户、技术提供者和运营商、内容分发平台及内容生产者都需要加强自律。实际上,我国已经提前颁布了一系列相关法律法规,AI负面应用问题的暴露有望带来一场全民的技术普法运动,从而促进产业更健康发展。