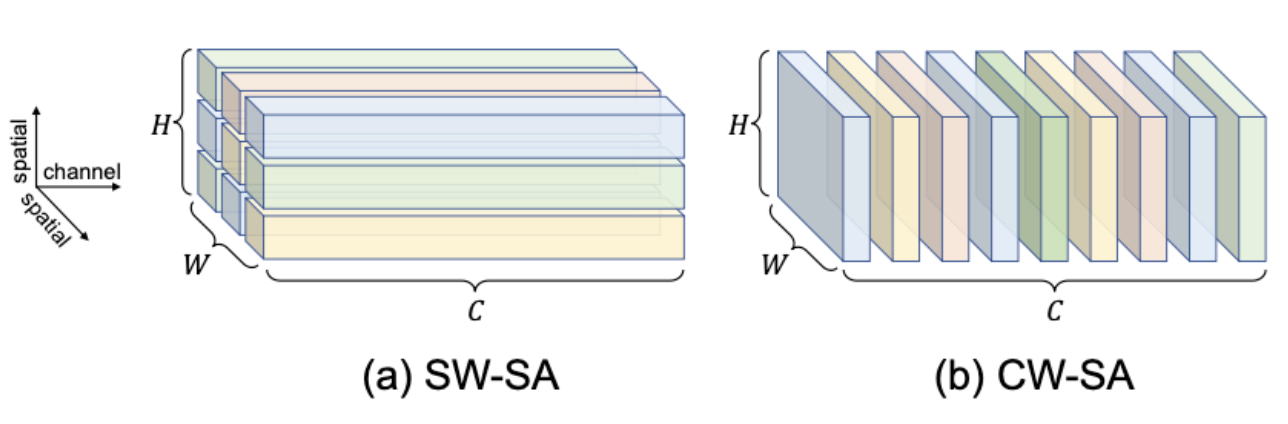

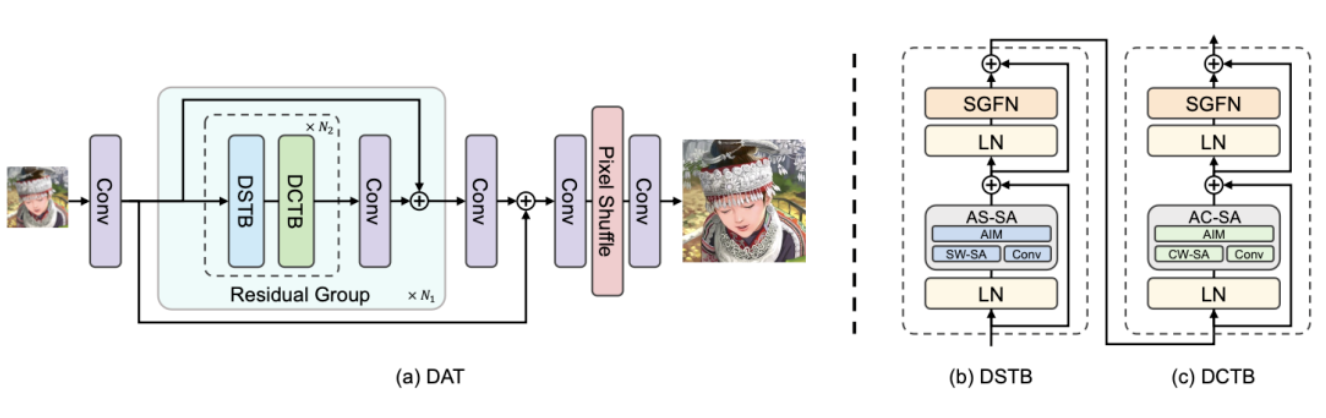

本文提出一种同时利用图像空间和通道特征的 Transformer 模型,DAT(Dual Aggregation Transformer),用于图像超分辨(Super-Resolution,SR)任务。DAT 以块间和块内的双重方式,在空间和通道维度上实现特征聚合,从而具有强大的图像表示能力。具体来说,DAT 在连续的 Transformer 块中交替应用空间和通道自注意力,以实现块间聚合。同时,本文还提出自适应交互模块(Adaptive Interaction Module,AIM)和空间门前馈网络(Spatial-Gate Feed-forward Network,SGFN)来实现块内特征聚合。AIM 从空间与通道为徒改进现有注意力机制,SGFN 在前馈网络中引入了非线性空间信息。实验证明,DAT 实现目前最先进的图像超分辨率性能。

论文链接:

https://arxiv.org/abs/2308.03364

代码链接:

https://github.com/zhengchen1999/DAT

一、 研究问题

图像超分辨率(Image Super-Resolution,简称图像 SR)是一种图像处理技术,旨在通过增加图像的细节和清晰度,将低分辨率(LR)图像转换为高分辨率(HR)图像。简单来说,就是将一张小尺寸的模糊图像,变成大尺寸的清晰图像。图像超分辨率技术在实际应用中具有广泛的用途,包括高清电视、监控摄像头、医学影像、卫星图像等。现如今,随着人工智能、机器学习的发展,使用深度学习技术的图像超分辨率成为主流。

二、 方法动机

目前,Transformer 在 SR 任务中表现出色。其核心是自注意力(Self-Attention,SA)机制,能够建立全局依赖关系。而全局关系的建立,对于高分辨率图像的重建尤为重要。然而,全局SA的计算复杂度与图像大小成平方比,这极大的限制了其在高分辨率图像上的应用(这在图像 SR 中很常见)。考虑到这个原因,一些研究人员提出更加高效的 SA,以有效利用 Transformer。总的来说可以分为空间与通道两个方面:

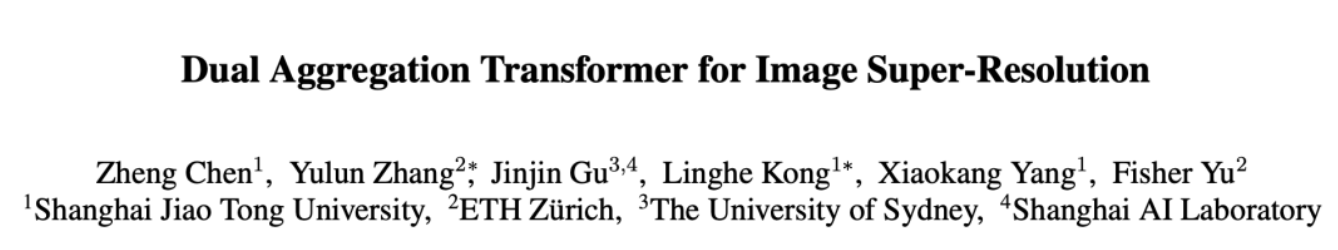

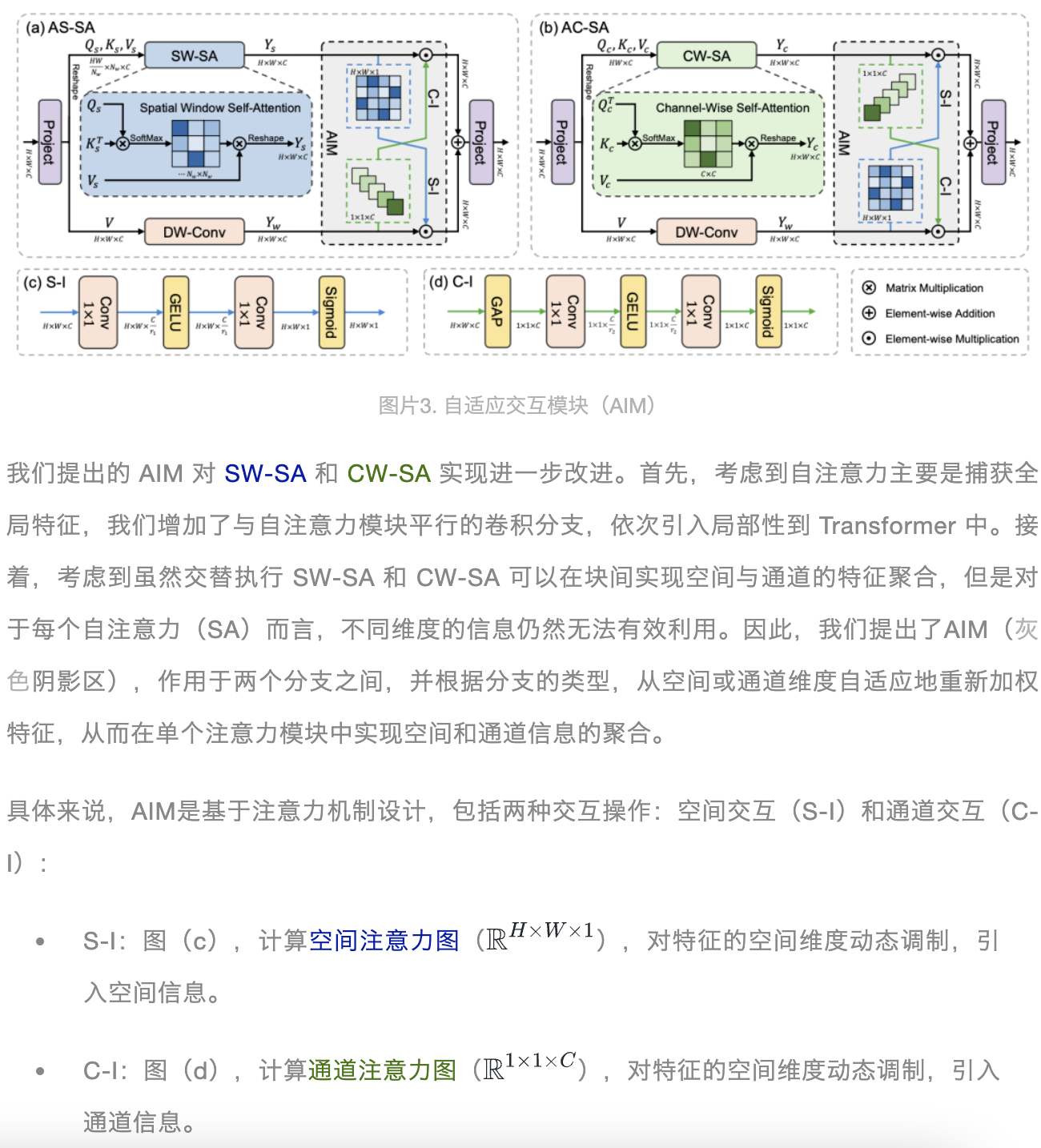

- 空间方面,局部空间窗口被提出来限制全局 SA 的应用范围,从而提出局部窗口注意力(Spatial-Window Self-Attention,SW-SA)。如图(a),空间维度 被划分为多个窗口,注意力在每个窗口中被执行。

- 通道方面,提出通道自注意力(Channel-Wise Self-Attention,CW-SA)。如图(b),注意力沿着通道维度 计算。也就是图中每一个独立的块都作为一个 。

图片1. 不同自注意力机制示意图

这些方法都在降低计算复杂度的同时,实现优异的性能。同时这两种方法对于图像特征( )的建模,是针对不同(空间与通道)的维度的。那么,是否可以同时考虑两个维度,在现有方法的基础上,进一步提高Transformer的建模能力,实现更加出色的超分辨率性能呢?

受以上发现的启发,我们提出 DAT(Dual Aggregation Transformer),通过块间和块内双重方式,实现空间和通道特征有效融合。具体来说,我们在连续的 Transformer 块中交替应用 SW-SA 和 CW-SA 。通过这在交替的方式,DAT 能够同时捕获空间和通道信息,实现块间特征聚合。同时,为了实现块内特征聚合,我们还提出自适应交互模块(Adaptive Interaction Module,AIM)和空间门前馈网络(Spatial-Gate Feed-forward Network,SGFN)。AIM 对 SW-SA 和 CW-SA 建模单一维度进行改进,SGFN 则在前馈网络中引入非线性空间信息。

总体而言,我们的贡献可以总结为以下三点:

- 设计了一种新的图像超分辨率模型:DAT。该模型以块间和块内双重方式聚合空间和通道特征,增强 Transformer 的建模能力。

- 交替应用空间和通道自注意力,实现块间特征聚合。此外,还提出 AIM 和 SGFN 来实现块内特征聚合。

- 进行了大量实验,证明提出的 DAT 实现最先进的图像超分辨率性能,同时保持较低的复杂性和模型大小。

三、方法介绍

在本节中,我们首先介绍 DAT 的架构。随后,我们详细阐述自适应交互模块(AIM)和空间门前馈网络(SGFN)两个组件。

3.1 模型架构

图片2. 模型架构

3.2 自适应交互模块(AIM)

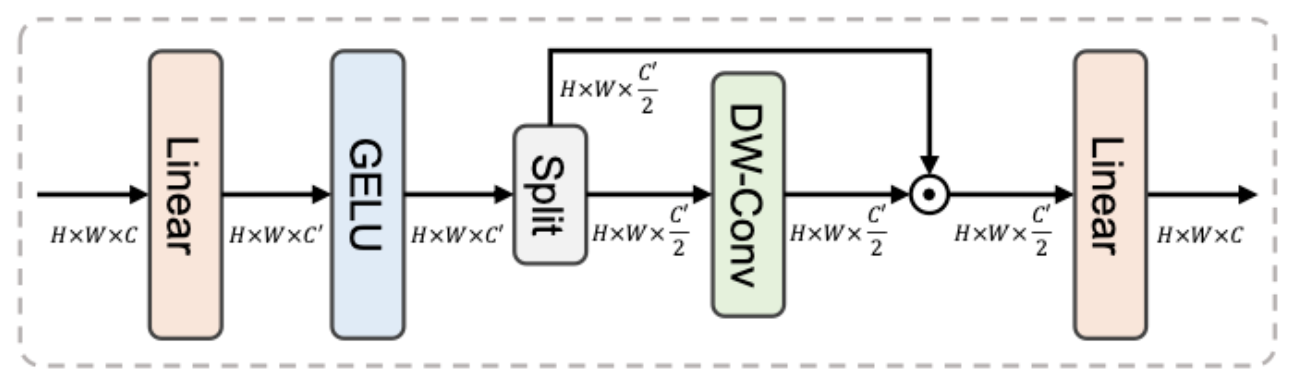

3.3 空间门前馈网络(SGFN)

图片4. 空间门前馈网络(SGFN)

传统的前馈网络(Feed-Forward Network,FFN)有线性层和非线性激活组成。只能够对特征通道进行建模, 但忽略了建模空间信息。此外,FFN会通过线性层在内部对特征通道进行放大,这导致通道之间存在冗余,从而阻碍了特征表达能力。

为了克服上述问题,我们提出了 SGFN:将空间门控(Spatial-Gate,SG)引入到 FFN 中。SG 是一个简单的门空机制,由深度卷积和逐元素乘法组成。同时,我们将特征图沿着通道维度,均匀的分为两个部分,分别送入卷积和乘法旁路中,以此来降低通道冗余性。并且该操作也能有效降低计算复杂度。

整体来看,AIM 和 SGFN 是 Transformer 块的两个主要组成。通过这个两个模块,我们实现块内的特征聚合:

- AIM 从通道维度增强 SW-SA,并从空间维度增强 CW-SA。

- SGFN 将非线性空间信息引入仅建模通道关系的 FFN 中。

四、实验结果

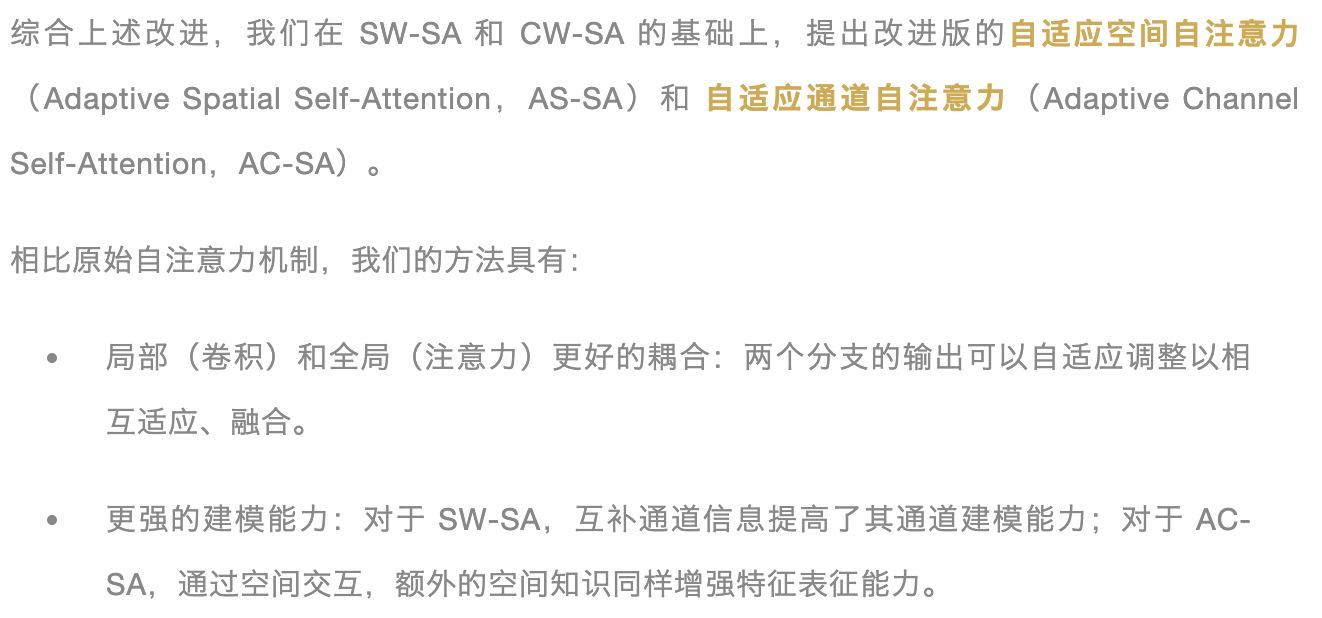

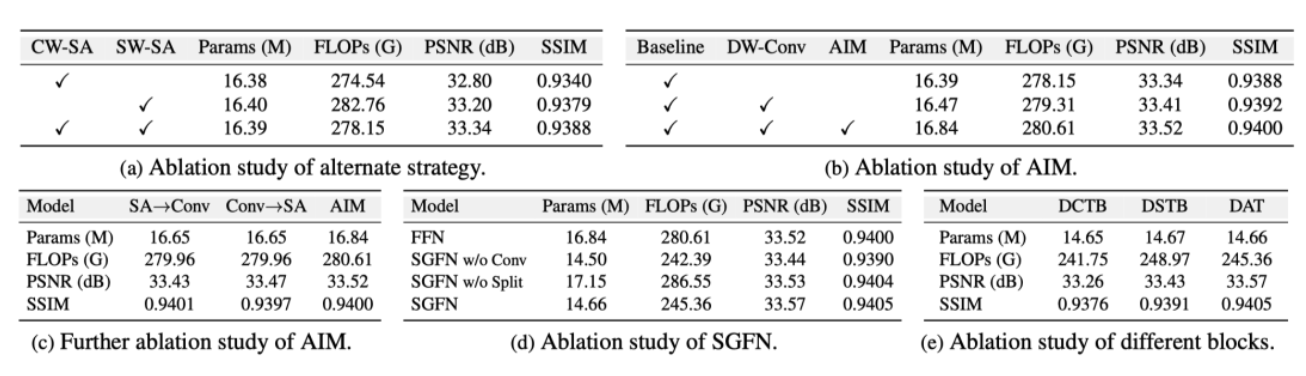

消融实验:我们对提出方法的各个进行详尽的消融实验,证明了方法的有效性。

图片5. 消融实验

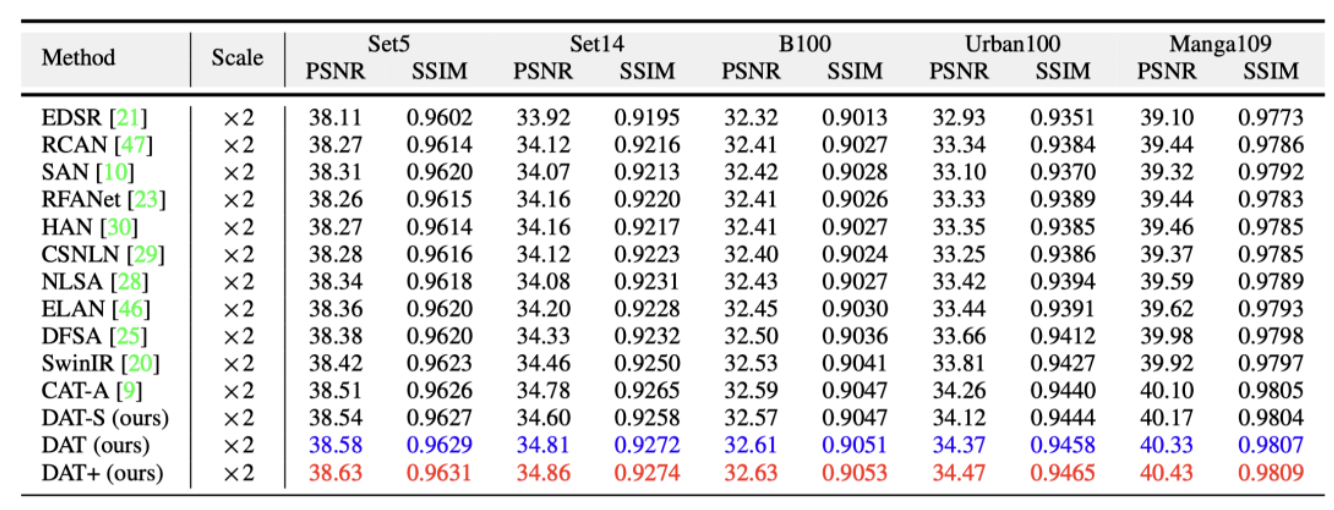

定量对比:我们提出了2个不同大小的模型变体(DAT-S、DAT),与目前最先进的图像超分辨率方法,在5个基准数据集上进行对比。如下表所示,我们的方法取得了最先进的结果。

图片6. 定量对比,最优结果着红色,次优结果着红色

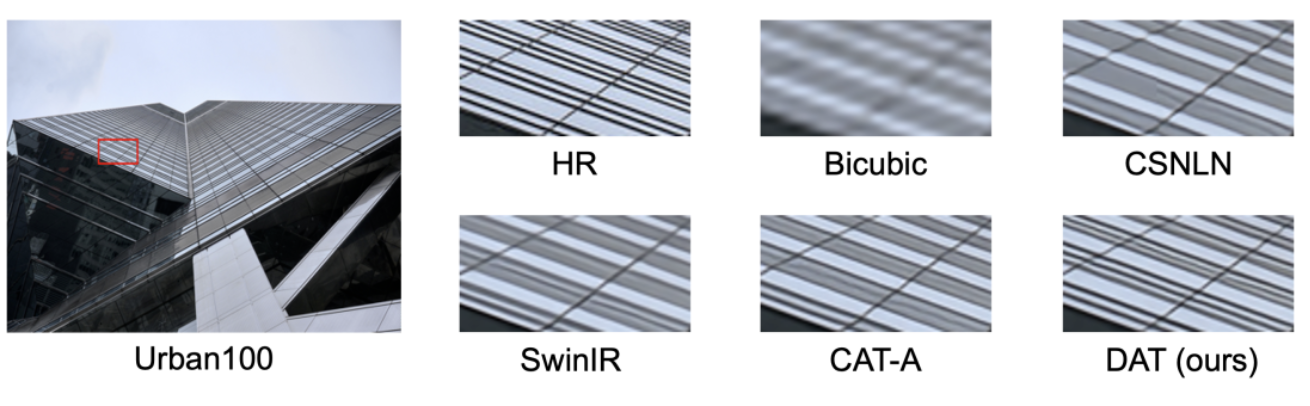

视觉对比:我们在下图中展示了视觉效果的对比结果。可以发现,我们的方法在细节的重建上具有明显的优势。

图片7. 视觉对比

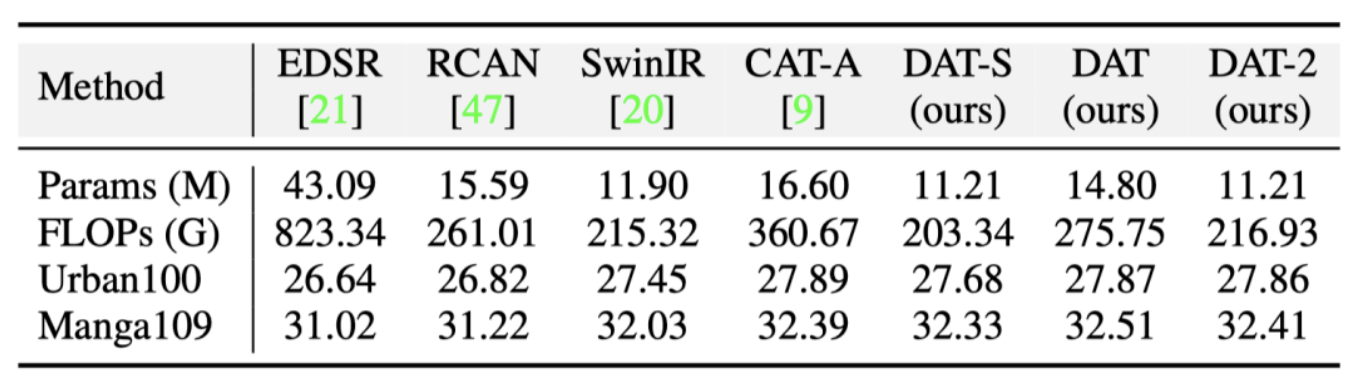

模型大小:我们还提供了模型大小(Params)、复杂度(FLOPs)、性能上的综合对比。我们的方法在实现性能提升的同时,也保持了较低的复杂性和模型大小。

图片8. 模型大小

五、结论

本文提出了 DAT(Dual Aggregation Transformer),是一种用于图像超分辨率 Transformer 模型。DAT 以块间和块内双重方式,聚合空间和通道特征,实现强大的建模能力。具体来说,连续的 Transformer 块交替应用空间窗口和通道自注意力,并实现了空间和通道维度在块间的特征聚合。此外,本文还提出了自适应交互模块(Adaptive Interaction Module,AIM)和空间门前馈网络(Spatial-Gate Feed-forward Network,SGFN),以在两个维度上实现块内特征聚合,从而增强每个 Transformer 块。AIM从两个维度增强自注意力机制的建模能力。而 SGFN 用非线性空间信息补充前馈网络。实验证明,DAT 实现目前最先进的图像超分辨率性能。

作者:陈铮

来源:AIWalker

推荐阅读

- ICCV2023 | 将隐式神经表征用于低光增强,北大张健团队提出NeRCo

- NTIRE2023-RTSR-Track2 冠军方案详解

- AsConvSR | NTIRE2023-RTSR-Track1冠军方案

- YOLO-NAS | YOLO新高度,引入NAS,出于YOLOv8而优于YOLOv8

- ChatGPT是如何看待YOLO系列算法的贡献呢?

本文章著作权归作者所有,任何形式的转载都请注明出处。更多动态滤波,图像质量,超分辨相关请关注我的专栏AIWalker。欢迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。