在分子世界里,蛋白质与核酸、有机及无机小分子、金属离子的相互作用对生命功能至关重要,它们的每一次识别、每一次结合,都可能影响生物功能,决定药物的疗效,甚至影响新型酶的设计成败。然而,对这些相互作用及其构象异质性的原子级建模仍是业界极具挑战性的课题。

2025 年 10 月 27 日,硅谷创投圈被一则消息彻底点燃:成立仅两年半的 AI 初创公司 Mercor 官宣完成 3.5 亿美元 C 轮融资,投后估值飙升至 100 亿美元,较今年 2 月的 20 亿美元估值实现 5 倍暴涨。

人脑如何通过数百种神经元构成的复杂回路塑造认知功能,至今仍是生命科学中一个深奥难解的谜题。过去十年来,随着电生理、形态学与转录组学等多模态数据的积累,科学家逐步揭示了人类神经元在基因表达、形态结构和电生理特性上的显著异质性。然而,这些差异究竟如何影响大脑的信息处理过程,例如特定基因表达与神经系统...

传统的高质量 TTS(文本转语音)模型一直以来都面临着几个核心困境:它们往往对计算资源和云端服务有较高要求,由此产生的高昂成本使得小型企业和个人开发者难以承担;更进一步,这些模型大多需要输入数十分钟甚至数小时的音频数据进行训练。这些部署和运行要求不仅提高了模型的使用门槛,还限制了 TTS 在隐私敏感场景下...

2025 年 10 月,《时代周刊》发布 「TIME100:影响世界的 100 人」 年度榜单,Google DeepMind 首席执行官 Demis Hassabis 登上封面。 在以「Preparing for AI’s Endgame」 为题的专题报道中,《时代周刊》表示,在 AI 的演进浪潮中,Demis Hassabis 作为将深度学习引入科学研究的代表性人物,正影响着全球 AI 技术与未...

2025 年春,一则令人震惊的离职公告传出:曾任 OpenAI 研究副总裁,负责后训练(post-training)工作的 Liam Fedus 决定离开。 他在一条推文中写道,他对 「AI 在科学中的应用」怀有「最具战略意义的兴趣」——那是他将要探索新征程的方向。

次季节至季节(Subseasonal-to-seasonal, S2S)尺度天气预报介于短期天气预报与长期气候预测之间,聚焦未来 2 周至 6 周的天气演变,精准填补了中远期气象预测空白,为农业规划、灾害防御等提供关键依据。但 S2S 天气预测既难依托快速衰减的大气初始信息(中短期预报条件),又难捕捉尚未充分显现的慢变边界信号(气候预...

美国东部时间 10 月 28 日下午 12:00,英伟达 CEO 黄仁勋在华盛顿举行的 GTC 大会上发表主题演讲。这是继今年 3 月圣何塞主会后的又一场区域性 GTC,地点首次来到美国政治中心华盛顿, 会议包含 70 多场,涵盖 Agentic AI、机器人技术、量子计算和 AI 原生电信(AI-native telecom networks)等议题,一度被外界视为英伟...

过去,在反应器工程中,3D 打印技术能够精确制造出具有规则孔洞的「周期性开孔结构(POCs)」,构建「网格状」反应器让气体、液体和热量在其中顺畅流动,为反应效率提升创造了可能。而人工智能的加入,则让实验室进一步具备了「自我调节」能力:自动化平台能够实时监测温度、流速和反应进程,并根据数据自主优化实验方案...

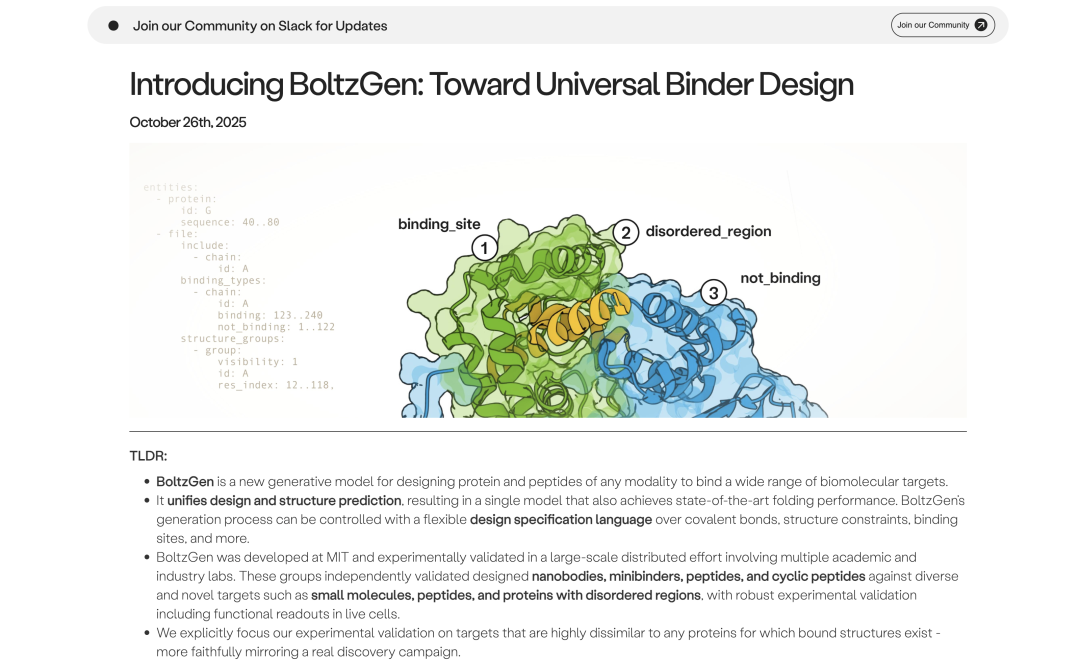

在药物研发和生物分子工程领域,「De-novo 蛋白设计(De-novo Binder Design)」是药物研发自动化的核心方法之一。研究人员能够借助计算模拟与深度学习,在特定靶点上生成具有结合能力的肽链或蛋白结构,抗体、纳米抗体、环肽等新型药物形态的开发也因此成为可能。

人类对地球时空规律的探索,始终是推动环境科学与地理学发展的核心动力。从依赖自然现象的经验总结,到计算机技术赋能天气预报,人类对地球系统的认知实现了从定性到定量的跨越。21 世纪以来,卫星遥感、地面传感网络与全球人口统计数据库等技术日趋成熟,催生了地理空间数据的爆发式增长。这些数据覆盖地球物理环境、人...

人工智能的加入,为材料科学领域带来了新进展。借助 AI 的力量,科研人员能以前所未有的速度设计出更多新型材料,但是「快」也成了一种烦恼。

2025 年 10 月,诺贝尔物理学奖的揭晓为全球科技界投下重磅消息 —— 瑞典皇家科学院将这一荣誉授予 John Clarke、Michel Devoret 与 John Martinis 三位物理学家,以表彰他们在量子力学领域的开创性贡献,其发现的电路中宏观量子隧穿与能级量子化现象,为现代量子计算技术筑牢了理论根基。

在生命体系中,蛋白质很少单独发挥其生物学功能,而是依赖于蛋白质-蛋白质相互作用(PPI)来执行复杂的生物学过程。因此,设计能够特异性靶向和调控 PPI 的蛋白质结合物具有巨大的治疗和生物技术潜力。 然而,传统的蛋白质结合物生成方法,例如免疫接种、抗体库筛选或定向进化,通常费力费时,并且对靶位的控制有限。

中期天气预报(≤15天)是科学界长期面临的重大挑战。大气作为典型的混沌系统,对初始条件极为敏感,微小误差会迅速放大,导致预报偏离实际。虽然集合数值天气预报通过多组扰动模拟来估计不确定性,已成为主流方法,但其计算资源随精度与时效要求的提升呈指数增长。 这一瓶颈正推动学界转向数据驱动的新途径寻求突破。

2025 年 10 月 8 日,诺贝尔化学奖在瑞典揭幕。瑞典皇家科学院决定将 2025 年诺贝尔化学奖授予日本京都大学教授北川进、墨尔本大学教授 Richard Robson 和加州大学伯克利分校教授 Omar Yaghi,以表彰其在「金属有机框架」(MOF,Metal–Organic Frameworks)领域的研究贡献。 这个经历了超过 30 年市场验证的研究领域,此...

直接提起「托卡马克装置」,你可能觉得陌生。如果这样去介绍:托卡马克装置是通向最理想能源——核聚变能的重要技术之一, 或许会有「原来是你」的感悟。不过这里的「核能」并非核电站的核裂变,而是更高能、清洁、安全、几乎无放射废料的核聚变。

精准调控特定细胞的基因表达对于基因治疗、合成生物学等领域的进展至关重要,此过程依赖于被称为「顺式调控元件(Cis-Regulatory elements, CRE)」的一类 DNA 序列,如启动子(Promoter)、增强子(Enhancer),它们就像基因的「开关」一样,决定基因在目标细胞中「启动」或「关闭」,同时避免在其他正常细胞中异常激活...

2025 年 9 月,苹果公司推出了轻量级蛋白质折叠预测 AI 模型 Ml-simplefold 。作为第一个基于流匹配的蛋白质折叠模型,在 CAMEO22 和 CASP14 等权威基准测试中,SimpleFold 在降低计算成本后,仍显示出与 AlphaFold2、RoseTTAFold2 等顶尖模型相当的性能。 同时其小规模版本 SimpleFold-100M 的表现同样具有竞争力。

在人工智能的诸多应用中,OCR(Optical Character Recognition,光学字符识别)无疑是最为成熟且贴近实际场景的技术之一。顾名思义,OCR 的核心目标是将图片、扫描文档、街景、票据甚至手写文本中的字符,自动转化为可编辑、可检索的数字文本。 早期的 OCR 多依赖规则与模板,功能单一,往往只能识别印刷体字符;随着深...