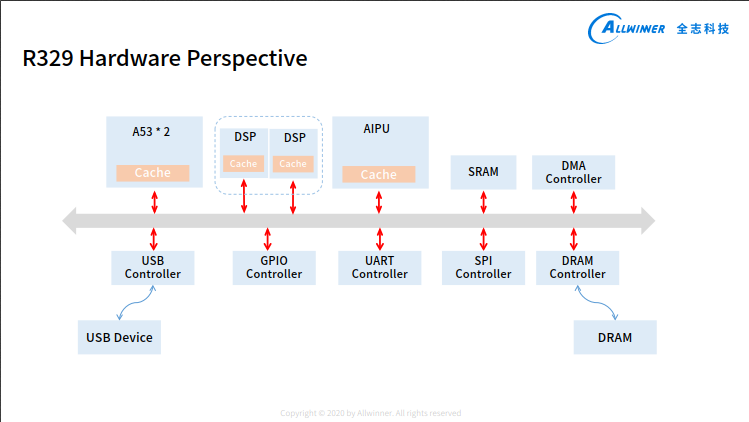

全志R329智能语音处理器,搭载了包括通用Arm核、周易AIPU、DSP三种处理器核心,那么软件上如何保证异构运算单元高效、协同工作?

周易"AIPU"系列第三期

全志Tina-Linux软件平台及R329应用开发介绍

分享内容

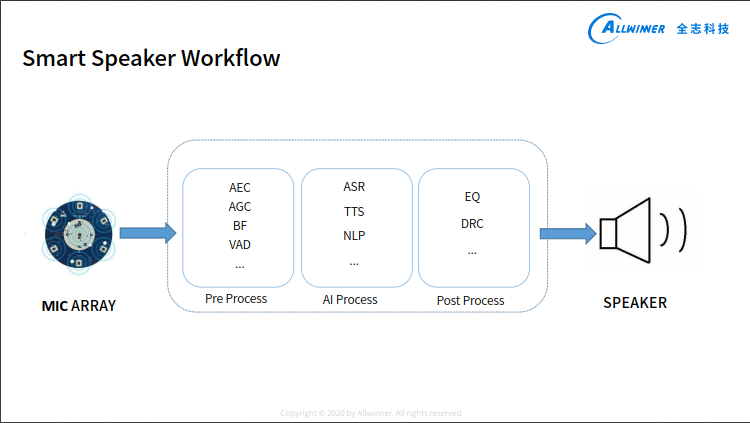

AI语音交互是智能音箱应用的核心技术,实际使用环境往往制约着云端支持能力的发展,如网络带宽、私密与安全等,越来越多设备强化端侧运算能力,如全志R329智能语音处理器,搭载了包括通用Arm核、周易AIPU、DSP三种处理器核心,那么软件上如何保证异构运算单元高效、协同工作,本课程将为您介绍全志科技Tina-Linux软件系统平台,并详细阐述基于R329语音芯片,如何进行DSP/AIPU应用开发。

端侧运算是AI语音交互的新方向,我们将通过此次课程为您详细分析全志R329语音芯片的DSP/AIPU 应用开发情况,进一步揭示这款搭载通用Arm核,周易AIPU和DSP三种处理器SoC的奥秘

大纲如下:

- Tina-Linux平台介绍

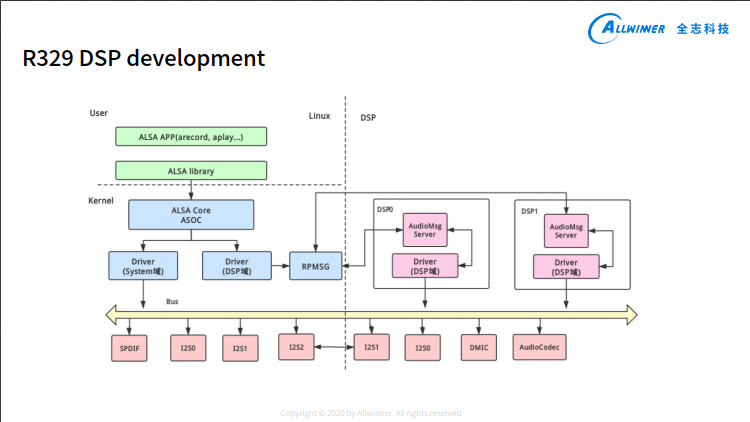

- R329 DSP开发及AIPU开发介绍

视频及PPT

- 视频观看地址:https://aijishu.com/l/1110000000114303

- PPT部分预览(文末提供下载)

Q&A精选

1.全志R239语音芯片中,异构运算单元是怎样交互的?

异构运算单元根据自身算力特性,支持不同业务, 借助周易提供的运行时库ARM CPU可轻易在AIPU上部署任务,通过一套核间通信机制,ARM CPU完成与DSP之间的控制转移与数据共享。

2.全志R239语音芯片中有两个dsp,那dsp0及dsp1做的东西有差异吗?分别用来做什么?AI核,dsp怎么分工的?

使用DSP在部分场景可获得更好的能耗比,DSP上具体业务可根据场景部署,通常AI核用来做语音识别模型推理,DSP用来做语音前后处理。

3.全志R239语音芯片中,DAC 做的20bit是有什么考量?

20bit是指数据位宽,性能能满足产品基本要求,在SOC上不容易做到更高性能,设计时通常需要综合考虑成本和性能等因素。

4.全志R239语音芯片中,周易AIPU支持哪些神经网络模型?

目前支持Tensorflow模型,未来还会有更多主流AI框架支持,另外也支持第三方运行时库,如借助OPENAILAB Tengine运行时框架,可以支持TensorFlow/Caffe/ONNX/MXNet等模型。

5.全志R239语音芯片中,为啥有的音响可以更改关键词,天猫精灵不行?关键词需要做哪些预处理呢?

端侧关键词识别模型的部署,需要综合功耗、内存、性能等因素,解决能耗与效果的矛盾,不同厂家的侧重点不同。

如果大家还有对全志R329处理的问题,欢迎在此提问 https://aijishu.com/t/aipu/questions。

嘉宾简介

黄少锐,全志科技产品研发中心高级软件技术经理

多年ARM软件及嵌入式系统开发经验,负责全志产品软件系统平台研发,擅长嵌入式LINUX/RTOS系统设计与产品开发,对智能硬件技术产品化落地有深入的理解与丰富的经验。

周易"AIPU"系列

第一期Arm中国周易“AIPU”初探

第二期|快速贯通全志智能语音技术,R329专用处理器大剖析欢迎关注周易"AIPU"专栏获取周易"AIPU"更多技术干货等。

| 文件名 | 大小 | 下载次数 | 操作 |

|---|---|---|---|

| 全志Tina-Linux软件平台及R329应用开发-20200521.pdf | 805.25KB | 152 | 下载 |