元宇宙太太太火了,以至于还没来得及认真聊一聊技术本身,各种炒房团、割韭菜、融资潮、付费课……就纷至沓来,我看不懂但大受震撼。

吃多了瓜,颇有一种“累了毁灭吧”的虚无感。不过,元宇宙的技术体系,其实还有很多值得探讨的地方。

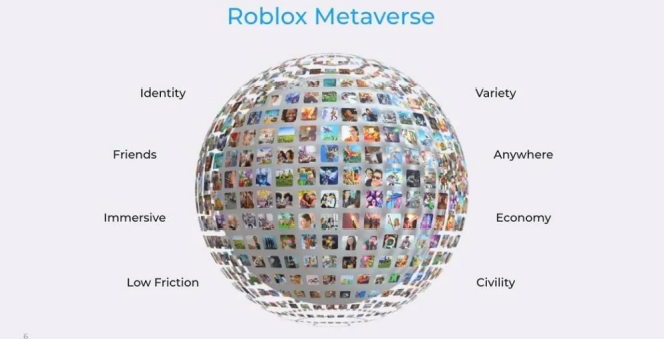

用美国科技评论家Benedict Evans的话来说,“元宇宙”这个新词,描述了一组明显不相关的趋势,将它们概念化并捆绑成一个单一的叙事。元宇宙概念上市公司 Roblox 的定义中,元宇宙应具备身份、朋友、沉浸感、低延迟、多元化、随地、经济系统、文明等八大要素。每一种还包含着一连串解释。

模糊且抽象的概念,让元宇宙看起来无所不包,又说不清楚,给浑水摸鱼留下了余地。不过,也有不少技术方向是扎扎实实、值得长期投入、对人类社会来说意义非凡的。

所以,我们决定还是严肃地聊一聊支撑元宇宙的技术本身。

元宇宙到底是什么?一个共识是,足够真实的“虚拟世界”。

无论是1981年美国数学家和计算机专家弗诺·文奇在小说《真名实姓》中构想的虚拟世界,还是普遍认为1992年“元宇宙”一词诞生的科幻小说《雪崩》中,与真实世界平行的虚拟空间;2003年宇宙学家保罗·戴维斯(Paul Davies)提出的“无限的虚拟多元宇宙塔”,抑或是Facebook的扎克伯格计划用VR/AR复刻的数字场景,本质上都指向了——模拟现实。

“硅谷钢铁侠”埃隆·马斯克(Elon Musk)也在一档播客节目中提出,未来游戏将与现实无法区分,人类将处于模拟之中,你不妨称它们为现实,或者也可以称它们为多元宇宙。

元宇宙的载体与内容,最终都要能够模拟现实。那么,有哪些感官需要被模拟呢?

佛教认为,人有六根,即:眼、耳、鼻、舌、身、意,这些被认为是心与物的媒介的根本。

那么我们分别从这些感官版图中,聊聊元宇宙来临时,人如何重新认知世界,有哪些技术路径是值得期待的。

元宇宙之眼

元宇宙的热度,许多科技企业都想蹭,但没有一个像Facebook这么彻底,直接连名字都改成了Meta“元”。这种孤注一掷的操作,很大程度上源自于Facebook在AR和VR上押下了很大的赌注,至少在视觉技术上模拟人类之眼,提供沉浸式的体验,无人可出其右。

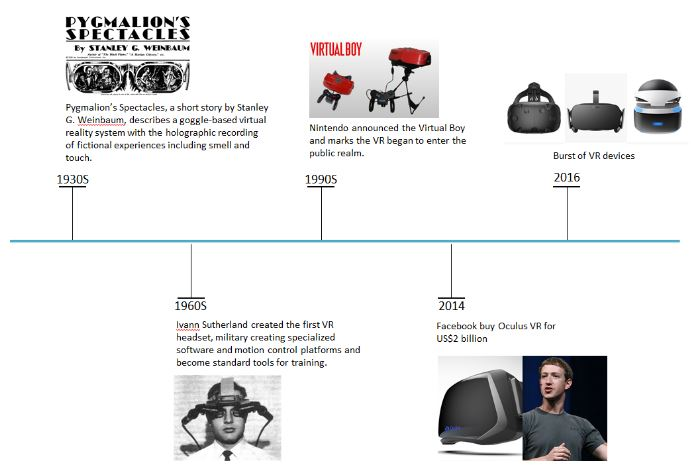

在元宇宙所涵盖的诸多高新技术中,VR/AR是被认为短期内能够成立并见到回报的。小说《雪崩》中也需要首先“戴上耳机和目镜”才能以虚拟分身的方式进入虚拟世界。

模拟视觉,带来的“真实感”体验,是元宇宙体验的第一道关卡,而Facebook(现更名为Meta)则独擅战场。

关于Facebook通过收购Oculus等公司,在AR / VR技术上投入大量资金的历史,我们就不赘述了。Meta在“模拟视觉”上的差异化优势在于:

首先,成本足够低。元宇宙的困境之一是VR 头显的渗透率不足,能破解这一问题的厂商自然能够率先拿到船票。

Meta在全球运营着五个研究机构,支持VR/AR的研发。从目前的市场表现来看,Meta旗下的Oculus已经成为头号选择,其中Oculus Quest 2更是在今年迎来了一波销售热潮,预算友好的同时,支持Steam 平台的绝大多数VR应用,这也使得Meta能快速进入规模化增长空间。

其次,硬件的终极价值要靠体验来兑现,这要求VR/AR厂商能够建构起足够庞大的内容和社交平台,为用户提供和现实中别无二致的工作、娱乐和生活体验,目前只有Meta能够将社交优势与VR技术优势叠加在一起,产生1+1>2的效果。比如Facebook的虚拟会议,就用了两年多时间,让多达16人(以化身为代表)一起坐在虚拟会议桌旁开会。此前,Meta还展现了一些全新的技术硬件,比如AR眼镜Horizon Home,允许用户邀请他们的朋友进行虚拟社交聚会,并且随时随地可穿戴,让虚拟现实的交互无处不在。

硬件+生态这条路背后,是沉淀多年的技术优势。比如强大的人工智能模型,来理解用户手势指令的上下文逻辑,最终确定需要执行的操作;再比如情境感知,理想情况下,用户只需要单击一次,即可执行任何想做的事情;提升佩戴舒适度,也需要降低VR头显的“运动病”发生概率,增加AR可穿戴设备的柔软度和舒适度,让它们尽可能被全天候使用。

模拟视觉的软硬件能力,是一项艰巨的长期任务,还有多年的研究要做。短期内,元宇宙还是聚焦于VR/AR。

更早播下种子的Meta,确实有可能率先收获,从元宇宙上赚到钱,这也就不难理解它孤注一掷拥抱元宇宙的决心了。

元宇宙之体

要让用户在数字世界里有更丰富的感觉,来自身体的触觉交互和动态感知,是元宇宙的核心挑战之一。

最近,Meta的Reality Labs Research实验室,就发布了两个重要的产品。

一是可穿戴手套,可以在虚拟的 VR 空间感受真实的触觉。

想象一下,当你在元宇宙咖啡馆里工作时,虚拟键盘每一次击键的触感都能被完美感受;在元宇宙游戏中,你可以感受到木质桌面的粗糙和书本表面的光滑……是不是体验感会大大提升?是不是比在VR里简单地看到自己拿起来了更有趣味、获得更多信息?

而Meta这次发布的触觉手套,就在手套上安装数百个气动装置,遍布整个手部,可以在佩戴者做出触摸动作时协同改变形状,通过气压来呈现逼真的触觉感觉。

这种装置使得研究人员不得不转向软体机器人等新兴领域,来规避传统机械耗电、僵硬、体积过大等问题。

同时,为了精确地知道用户的手在虚拟场景中的位置,是否与虚拟物体接触,产生的作用力多大,还需要研发新型的触觉渲染系统,根据手的位置、对虚拟环境的理解、虚拟物品的重量纹理和刚度等等,向手套的气动装置发送正确的指令,需要构建相应的软件和算法建模。

为了达到真实的触觉模拟,2017年Reality Labs Research团队就开始尝试,将不同材料(木材、大理石、泡沫)制成的虚拟球体与单个振动触觉设备建立关联线索。

除了手部跟踪,身体动态也能给虚拟世界增加不少体验感。如何让身体数据能够输入系统并被模拟呢?

Meta的研究团队将手腕智能设备与AI相结合,进而感知动态环境。

相比手套、VR、语音等输入方式,手腕设备更适合全天无感知佩戴及交互。但技术挑战在于,如何将运动信号准确地转换为数字指令。

Facebook在2019年收购CTRL实验室使用传感器,尝试通过神经信号让用户直接控制机器。通过手腕的肌电图信号,系统可以理解哪怕一毫米的手指运动,进而转换为数字命令发送到设备上,实现数字交互与控制。

举个例子,你可以在远处控制虚拟对象,仿佛拥有了原力一般的超能力;未来还可以无需键盘,在桌子或膝盖上打字就能输入;当你穿着鞋子离开家,设备就会询问你是否需要播放音乐……

人类在婴儿时如何感知世界,靠的正是一次次抓握,一次次爬行。身体知觉的模拟,能够让我们在虚拟空间里和世界再次对话、重新成长。

元宇宙之声

你戴着一副AR眼镜和一个柔软的腕带,决定去元宇宙里的虚拟会议室开个会,突然发现,设备里传来了嘈杂的音乐和其他人讨论的声音,让你很难集中注意力。

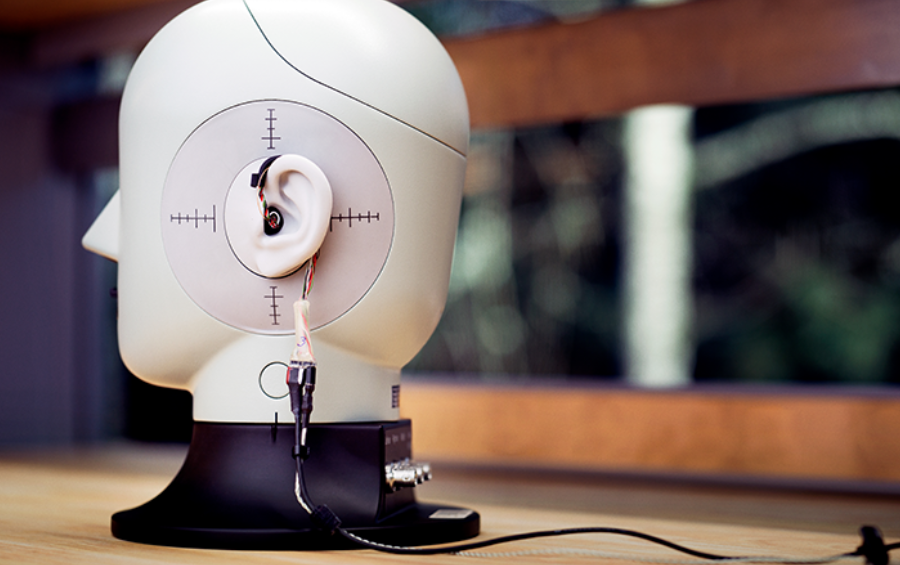

事实上,大脑不会对耳朵传来的所有声音照单全收,我们总是会对一些特殊词汇(比如自己的名字)特别敏感,在有必要时也能主动屏蔽外界噪声。如果要在虚拟世界里复制真实的声音体验,不仅需要声学设备本身的高性能,也要对声音如何与真实环境相互作用进行建模。

就拿Meta的研究方向来说,在3D打印眼镜上使用多个麦克风,捕捉周围的声音,然后通过眼动追踪设备,感知头部和眼睛运动的轨迹,AI系统可以找出你最感兴趣的声音中的哪一个,增强正确的声音。

这样在嘈杂的虚拟会议室或咖啡厅里对话,也不必特意提高声音才能被听到。

当用户的眼神转向旁白的电视或视频时,里面正在播放的内容又会变得更响亮,身边其他声音则变得更安静。

除了模拟大脑认知,空间音频技术和声学仿真技术,能够模仿现实生活中不同方向来源的声音,营造一个更加真实的虚拟空间,用户使用Oculus Quest等设备在空间中移动时,设备模拟出的声音和房间里真实的听觉效果几乎没有差别。

举个例子,当大家都在使用Meta的元宇宙会议系统时,麦克风阵列可以捕捉各个角度的声音并传送到耳机里,用户可以很自然地判断发言者所在的位置并转向TA,这种体验感简直就像自己真的在房间里一样。

再想象得多一点,空间音频结合实时动画化的超逼真虚拟人,可能会彻底改变视频通话的感觉,让远程社交不再是线下的“替代品”,真的能够提升沟通效率。

听觉模拟,不仅改变着元宇宙中的沟通方式,也可能提升听觉障碍人群的社交参与度。

如果说元宇宙和现实世界相比有什么吸引力,那么降低生理性差别及其限制,或许会让许多人都感觉到更加幸福。

元宇宙之意识

你可能会问,除了眼耳手,还有哪些方式进入元宇宙?在1981年出版的小说《真名实姓》中,美国数学家和计算机专家弗诺·文奇教授,就提出了通过脑机接口进入并获得感官体验的虚拟世界。

意识进入人造现实,这不正是黑客帝国中“缸中之脑”的情节吗?但要实现这一点并没有那么简单。

事实上,Meta的Facebook Reality Labs也在进行脑机接口(BCI)的相关研究,希望给VR系统和AR眼镜提供一种全新的交互方式,但至今并没有可规模化商用的案例。至于埃隆马斯克那种直接给大脑做手术的介入式方案就更加遥远了。

脑机接口BCI的问题主要在于,非侵入性的、基于脑电图EEG的交互速度非常慢,有时患者需要70分钟才能输入一个句子,并不具备使用价值。此外,现有脑机接口设备的体积也很大,无法长时间佩戴。

目前,Meta的研究团队希望测量血管和神经元的运动,创建小型、方便的BCI设备,进而帮助实现无声语音输入。

进步总是发生在一点一滴地寸进当中,哪个科技公司更了解这项技术,就距离元宇宙更进了一步。

元宇宙之味

元宇宙技术体系中,Meta没有提到的感觉是气味和味道。至少目前在VR/AR中,鼻子和舌头似乎都有点不太必要存在——但视觉、听觉、触觉一旦得到完善,就需要开拓其他感官了。

我们常说“闻香识人”,真实世界里人的气味、空间的气味、食物的味道,都是自然界提供给我们的重要信息。没有它们,VR将永远是对现实的乏味模仿。

但嗅觉和味觉所代表的化学感官,数字化的尝试出人意料地缓慢。

一方面,源自现实的技术挑战。嗅觉是与杏仁核直接相关的感觉,这也为什么气味可以唤起强烈的情感记忆,但将嗅觉整合到VR中,在味道调制上选择十分有限,无法模仿出现实世界中的数千种气味。同时也给硬件设计提出了极大挑战。

2015年在Kickstarter上推出的FeelReal面具,声称可以发出气味,并制造出冷热雾气的感觉。但这款面具并不成功,The Verge将佩戴FeelReal口罩描述为“在炎热的天气里将空气清新剂放入车里,把脸埋在汽车的塑料座椅上,然后跟随司机经历一轮高速急转弯”——想想都要窒息了。

曾有日本实验室提出了一个原型嗅觉机,可以挂住Oculus Rift上,放在鼻子底下,通过声波将液体雾化,向上飘入鼻孔。但这一设计无法让机器在不应该闻到的时候停止释放气体。

味觉感官也同样,曾有日本研究人员开发了一种食品模拟器,让用户有咀嚼的感觉,配合适当的噪音(比如吃饼干的咔嚓声),来产生味觉。但这种味道模拟的工作推进缓慢,需要大量的味觉数据,食物风味来自嗅觉,食物质地则依赖触觉,实现起来十分困难。

(数字味觉界面,一种模拟味觉的方法,通过电和热刺激来驱动人类舌头。)

另外,消费者的需求不强烈也是延缓商业化的重要原因。

相比技术挑战,体验数字化嗅觉与味觉的心理障碍可能更高。人类进化得来的生理机制是,专注于其他事情时,往往无法检测到香味,即使感受到化学感官刺激,也更倾向于认为其中包含着危险,

曾有一个实验让参与者通过VR感知到虚拟厨房里的尿液气味,结果受试者经常错误地将尿液气味误认为是其他味道,比如鱼或者垃圾、尸臭味等等,甚至有人认为这是一种令人愉快的气味,因为它唤起了好的回忆(属实大受震撼了家人们)。

总而言之,人类对特定气味和味道的反应,依赖于背景或以前的经历,相比视觉线索,化学感知的商业化价值并不明显。

这也是为什么在人机交互、多感官融合领域,对化学感官的研究普遍会被忽视。看来要在元宇宙办公室里和同事们一起喝虚拟咖啡,还有好长一段路要走了。

写在最后

说到这里,会发现关于元宇宙想要模拟现实中的人类感知,还需要较长的时间。在技术与商业上都相对成熟的只有Meta长期押注的VR/AR 视觉体验。

但是,任何单一技术的短板都有可能限制元宇宙“真实”的效果,给其发展带来不确定性。

但换个角度,眼耳鼻舌身意的每一项感官模拟,都能带来建构虚拟世界之外的奇效。比如帮助身体残障人士重新听到视觉、尝到味道、闻到花香;再比如更轻盈、精准度高的可穿戴设备,为智能消费硬件市场带来变化。

从这个角度看,最终元宇宙是否实现并不重要,至少在向目标前进的过程中,互联网乃至整个世界,都已经变得更好了。而科技巨头或初创企业想要抓住元宇宙的机会,唯一的选择只能是走在坚实的技术道路上。