前天刚跟大家分享过支持PCIe Gen5的主机平台(以“小”见大:从Precision 3660看工作站技术发展趋势),适逢NVIDIA GTC大会,又有更多新品、技术资料出来了。其中最引人注目的应该是H100 GPU,其中也包括对PCIe 5.0的支持(当然“原Tesla系列”GPU计算卡主要是针对服务器设计,像H100这样的不适用在工作站上)。

《NVIDIA H100 Tensor Core GPU Architecture》要问下载链接在哪里,请移步文末,或者可以从NV官网找。

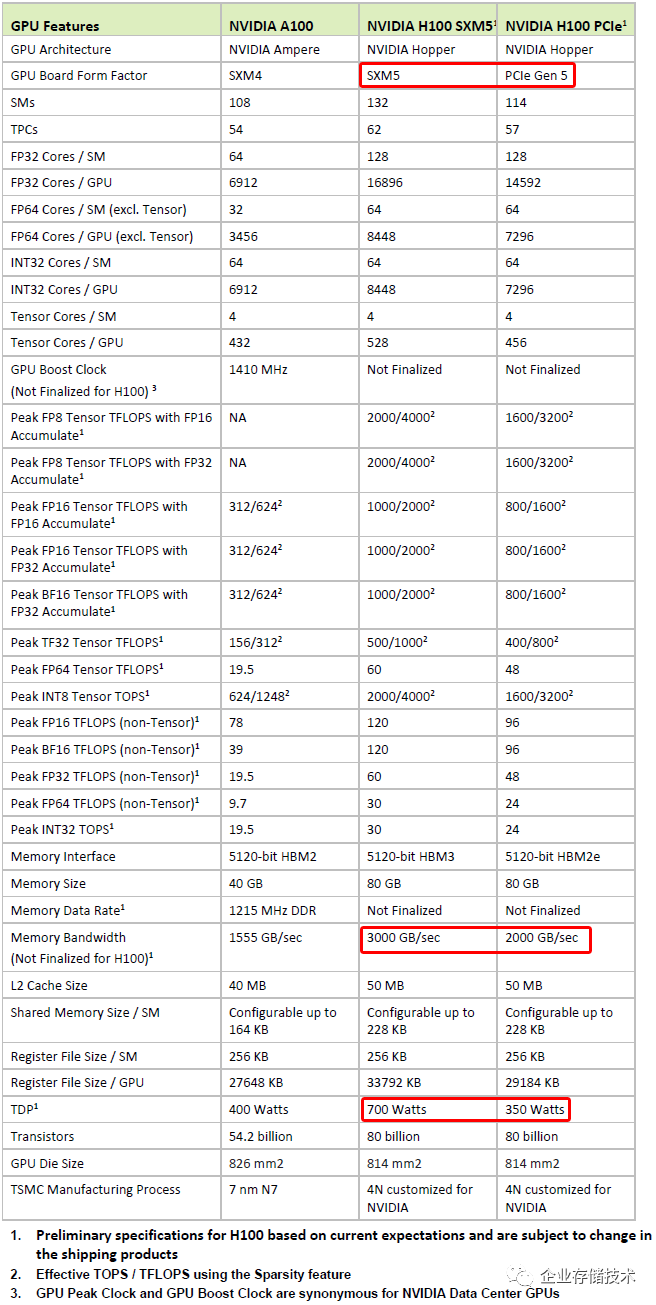

SXM模块的H100 GPU设计功耗高达700W,散热设计有点难度吧?

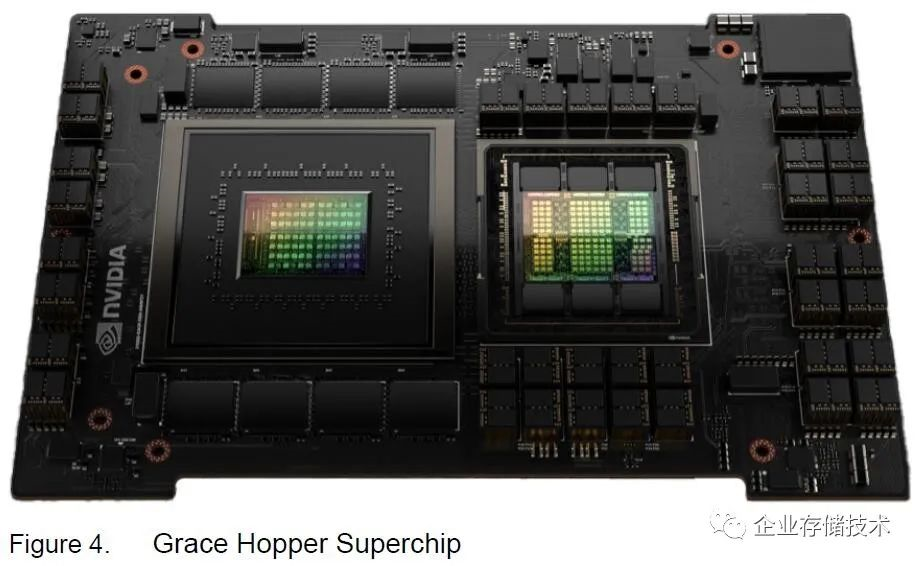

这个Grace Hopper“超级芯片”,是把Arm CPU + H100 GPU放在一起,芯片间互连的带宽高达900GB/s。

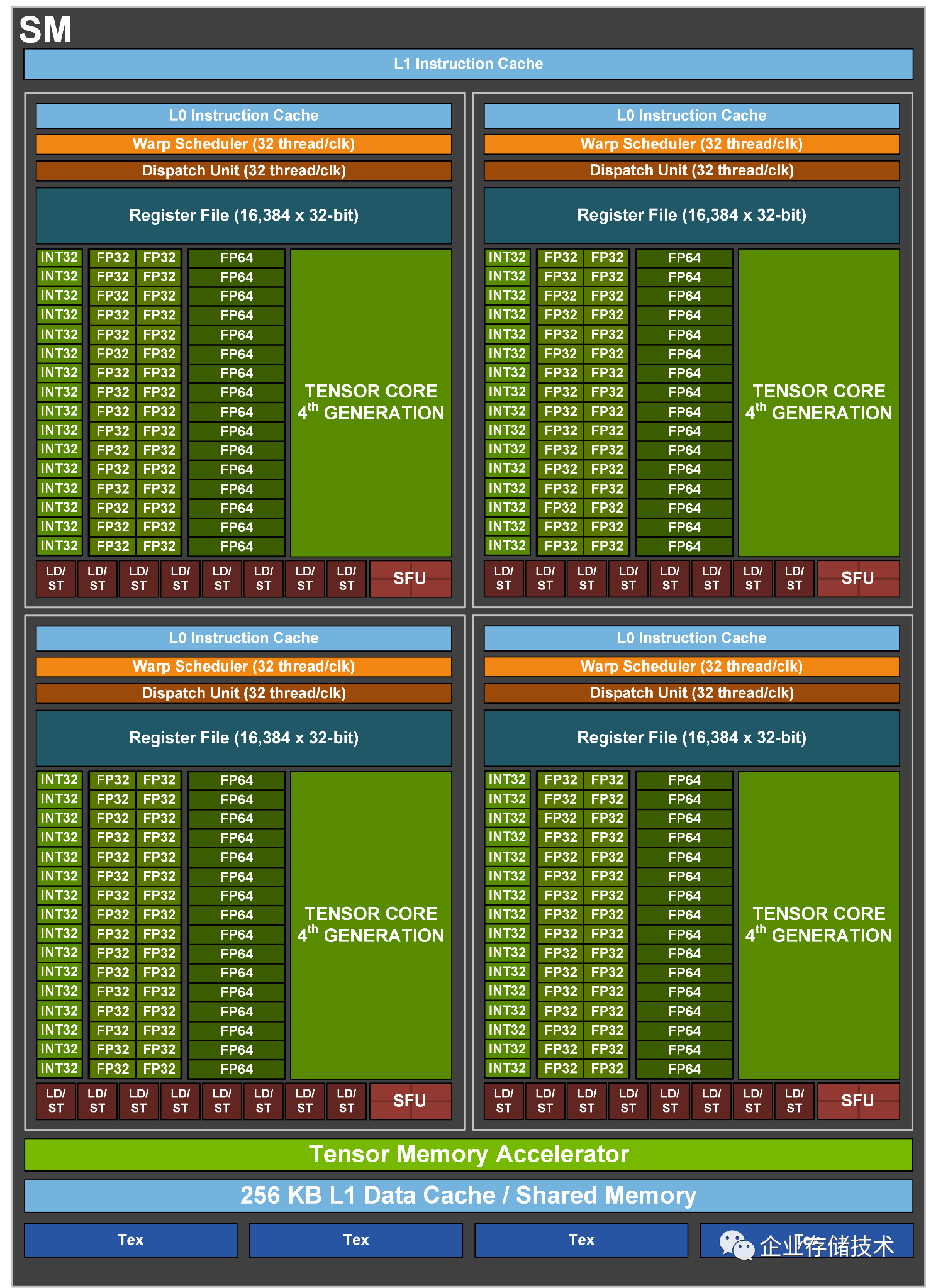

H100 1个SM流处理器单元的结构。

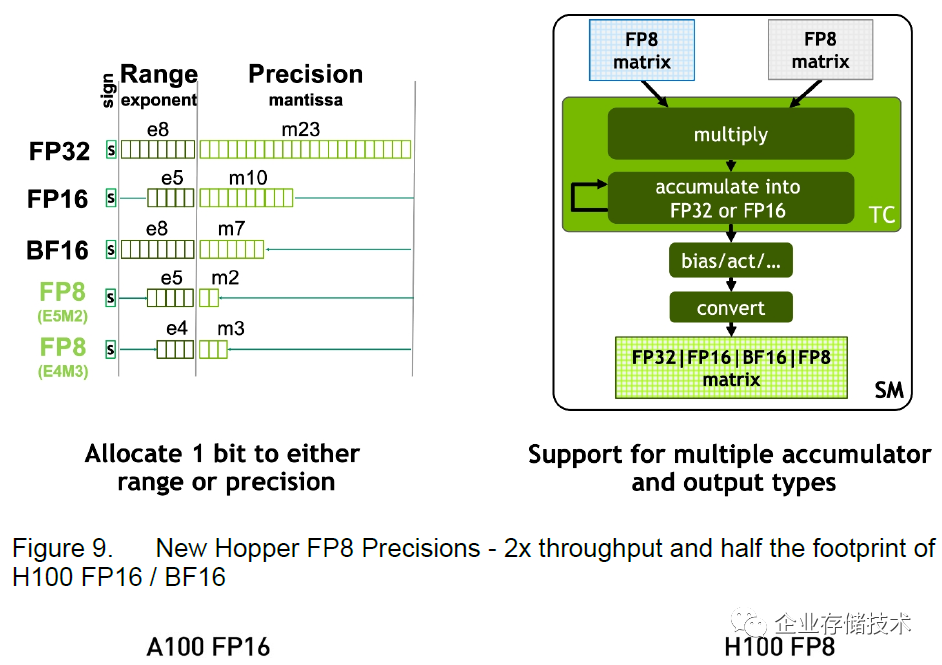

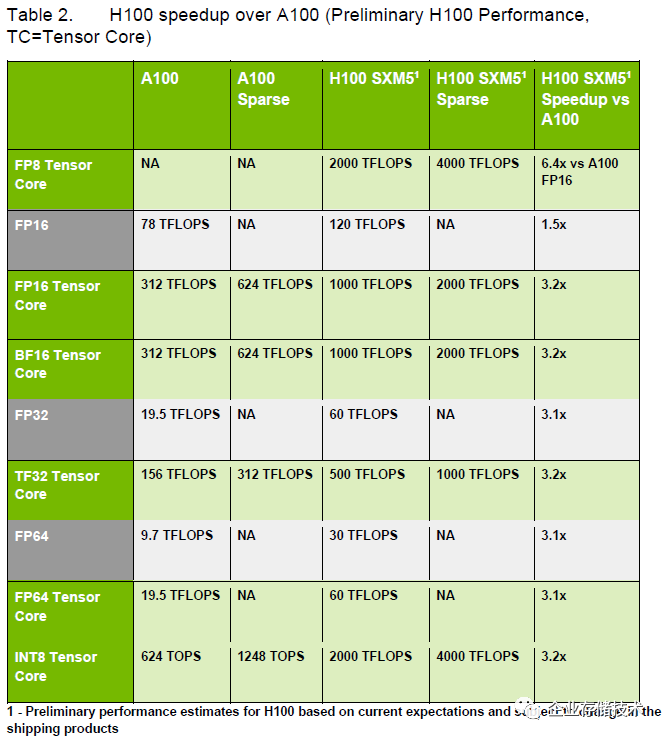

H100这一代特别加强了FP8浮点计算。

如上表,H100和A100在支持稀疏精度时的性能,都是常规Tensor Core性能的2倍。

我们看到,NVIDIA能把PCIe 5(插卡形态)H100的TDP功耗控制在350W;而700W的SXM模块的H100,在性能上只领先PCIe插卡版本25%。

功耗问题应该还是出在高速I/O上,SXM支持的NVLINK控制器通道显然要多不少。上一代A100在性能接近的情况下,也是SMX的功耗400W而PCIe只有250W。

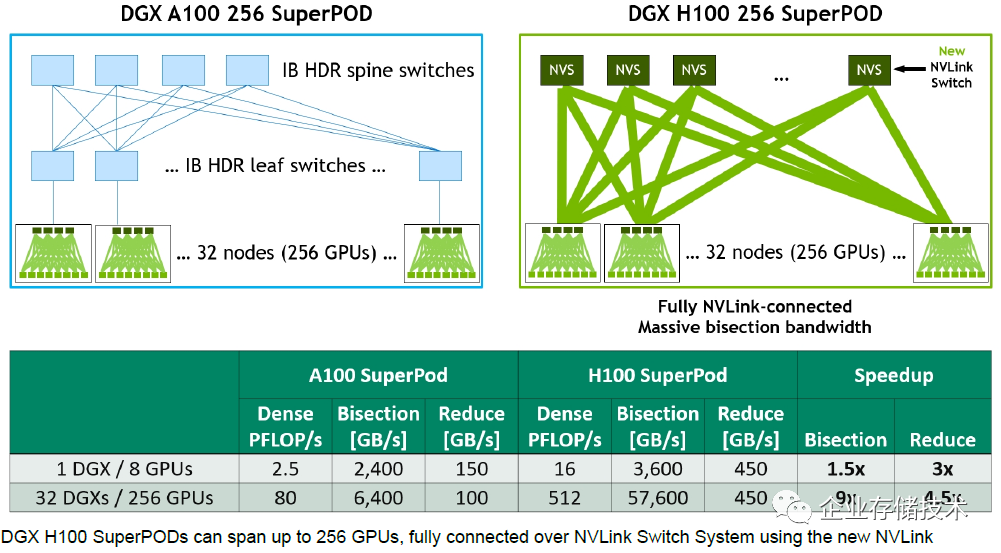

关于DGX系统中的互连我就不多聊了,有兴趣的朋友可以细读资料。NV以外搞AI的小伙伴们,还要不要更新一版产品ppt呢:)

NVIDIA H100 GPU架构白皮书分享:https://nvdam.widen.net/s/9bz...

作者:唐僧 huangliang

原文:企业存储技术

推荐阅读

欢迎关注企业存储技术极术专栏