https://www.arm.com/blogs/blueprint/neoverse-nvidia-grace

作者:Chris Bergey,Arm高级副总裁/基础设施产品线总经理 2022年3月22日

人工智能(AI)将改变世界。但要实现其潜力,我们必须改变设计计算系统的方式。

在云中训练神经网络或在边缘实时执行模式识别等任务将需要专门的片上系统(SoCs),最终需要针对AI和机器学习(ML)独特的功率、性能和数据吞吐量需求进行优化的服务器和数据中心。否则,人工智能所需的成本、功率和碳排放将开始超过收益。

NVIDIA率先使用GPU来提高数据中心HPC和AI的性能、生产率和效率,今天在其GTC活动上宣布了基于Arm Neoverse的NVIDIA Grace CPU超级芯片计划背后的细节。

NVIDIA Grace CPU的亮点:

. NVIDIA Grace CPU基于我们的下一代Armv9架构,将首先作为Grace CPU超级芯片和Grace Hopper超级芯片的一部分上市。Grace系列处理器的设计目的是在人工智能最苛刻的任务中提供高达10倍的性能飞跃,例如使用超过一万亿个参数训练NLP模型,同时显著提高每瓦功耗的性能。

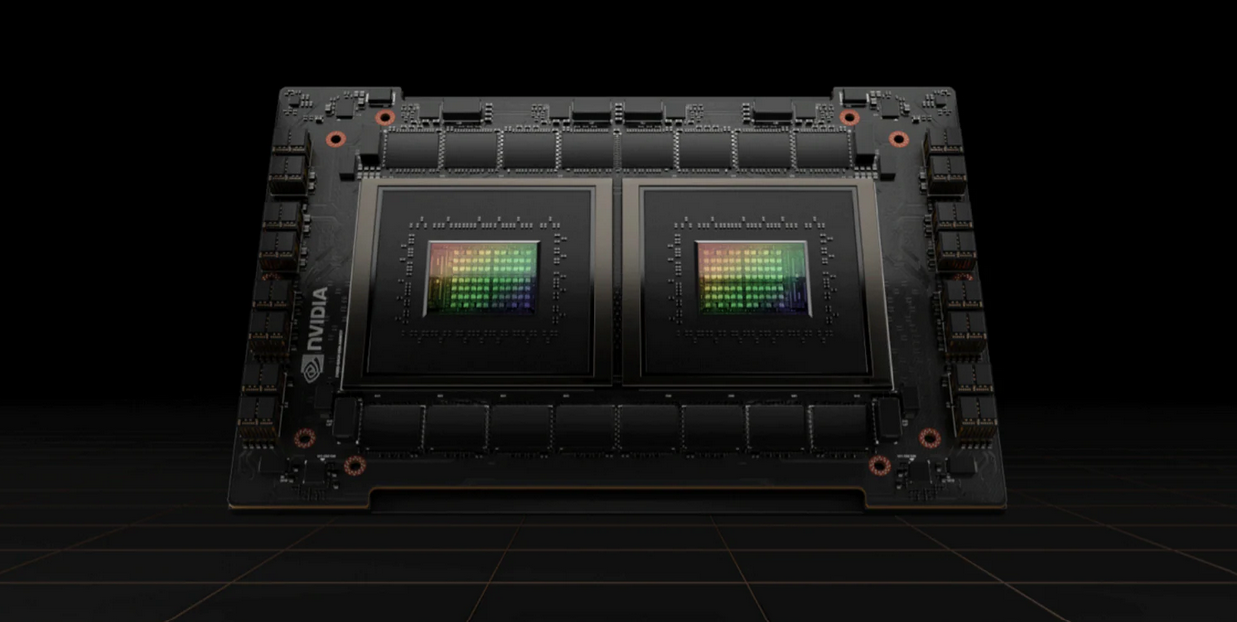

. NVIDIA Grace CPU超级芯片将包含两个Grace CPU,总共有多达144个ARM Neoverse 内核,以及模块内的高达960GB的LPDRD5X内存,用于AI、HPC和超规模工作负载的海量数据吞吐量需求1 TB/秒内存带宽。

. NVIDIA的基准测试显示,Grace CPU超级芯片在SPECrate®2017_int_base 基准测试上的估计性能为740。

. NVIDIA Grace CPU超级芯片结合了一个单一的Grace CPU与NVIDIA Hopper-based GPU,这是NVIDIA最新的GPU架构。它还将配备16个通道的PCIe Gen5和高达960GB的LPDDR5x内存。

. 超级芯片内的CPU和GPU将由NVIDIA的新NVLink-C2C连接,芯片间的带宽为900 GB/秒,比NVIDIA上的PCIe Gen5高7倍。与当今领先的服务器相比,GPU的聚合系统内存带宽将提高30倍。

. NVIDIA NVLink-C2C将支持Arm的AMBA-CHI协议,实现芯片间的直接连接,以便在同一SoC内基于Arm的CPU之间实现更快的通信,以及基于Arm的SoC(如Grace CPU超级芯片)与其他基于Arm的设备(如NVIDIA Bluefield data processing units(DPU))之间的通信,或与NVIDIA合作伙伴开发的定制ASIC之间的通信。

Grace Hopper超级芯片将是Alps的处理器,这是一台由瑞士国家超级计算中心(CSCS)和惠普公司(Hewlett-Packard Enterprise)开发的超级计算机,预计将于2023年用于气候建模、计算流体力学和其他任务。Grace Hopper超级芯片也被选为美国能源部Los Alamos国家实验室和HPE正在开发的超级计算机。

这里有很多首次披露的东西。Grace CPU超级芯片是NVIDIA的第一款离散数据中心CPU。Grace CPU超级芯片也是第一款专为AI、HPC和超大规模工作负载设计的基于Arm Neoverse的设备,展示了Neoverse CPU以及高性能加速器和内存系统的紧密耦合所带来的可能性。Grace CPU还标志着NVIDIA基于Armv9的首款芯片,因此将能够利用许多下一代功能。最后,新产品极大地促进了改善互连性能的努力。

人工智能的蓝图

过去的十年是关于人工智能能够实现什么的十年。展望未来,科技行业、我们的客户,甚至广大公众都希望更多地了解我们是如何做到这一点的,即无线网络、数据中心架构或设备设计中需要的变化,以使自动驾驶汽车、预测性医疗保健或其他人工智能应用成为可能。

实现人工智能的承诺将吸引整个Arm生态系统的人才,从系统和芯片设计师到开发人员,优化神经网络以实现速度、准确性和效率。我们要感谢NVIDIA为我们设定了方向。