【嘉勤点评】科大讯飞发明的车内含噪语音数据生成方案,只需结合成熟的语音合成技术就可以实现人声素材资源的拓展,无需如现有技术重新反复进行实地录制数据,实现了对预先创建的语音素材资源的复用。解决了当前实车实景人工录制方式费时、费力、高成本等弊端,并有效提升了车用交互语音数据样本的制作效率。

集微网消息,随着人工智能的兴起,车载、教育、医疗都渗透了人工智能技术。其中,智能语音作为人机交互的重要手段被广泛应用于各个领域。

在车载场景下,由于其不同于家居、医疗、客服等场景,该环境中的噪音更具多样性、不稳定性等特点,且车载场景涉及人身安全因素,对语音识别等效果要求较高。因而在优化语音识别等语音处理效果时,需要大量含噪声及不含噪声的测试语音音频数据作为支撑。

其中,车内含噪语音数据集的构造往往需要实车在不同场地、环境条件下进行反复、多次实地采录。这种条件的制作要求相对较高,也导致整体成本也较高。此外,目前现有的车内含噪语音数据的制作方式通常只适用于单次目标效果的评估,也就是说经过反复多次在某一个场景中采集车内含噪语音数据完毕后,该数据集很难在更多的场景中重复使用。

因此,如果期望采录的车内含噪语音数据能够覆盖全场景,则必然要耗费大量的时间和人力从海量车内含噪语音数据中进行甄别、挑选、归类等繁琐工作。为了达到具有上述优良效果的语音数据集,科大讯飞在2021年6月22日申请了一项名为“车内含噪语音数据生成方法、装置以及设备”的发明专利(申请号:202110694011.4),申请人为科大讯飞股份有限公司。

根据该专利目前公开的相关资料,让我们一起来看看这项技术方案吧。

如上图,为该专利中发明的车内含噪语音数据生成方法的流程示意图,这些含噪语音数据可以帮助开发人员实现更加优秀的用户语音识别算法及模块。首先,开发人员在系统中预先内置创建好的语音素材库,该素材库主要包含两类音频数据,分别为:纯人声音频数据和实车纯噪音音频数据。这是由于车内交互的含噪语音数据主要是由主说话人声源、环境噪声、干扰源构成。

主说话人声源就是指语音处理的对象,主要用于识别、唤醒、意图分析、指令操控等操作环节。而环境噪声主要是指行驶时的风噪及胎噪、车外噪音、空调噪、车载播放器输出声音以及其他杂音等。

其次,接收并解析用户输入的数据需求。例如,主说话人声源为男性、中文普通话以及50db,假设主说话人声源能量与车噪能量比例5:3。基于这样具体且明确的数据需求,可以直接执行后续步骤。

最后,根据解析后的数据需求,从语音素材库中分别匹配出与用户需求对应的纯人声音频数据以及实车纯噪音音频数据。并将匹配到的纯人声音频数据以及实车纯噪音音频数据进行混音处理,生成车内含噪语音数据。

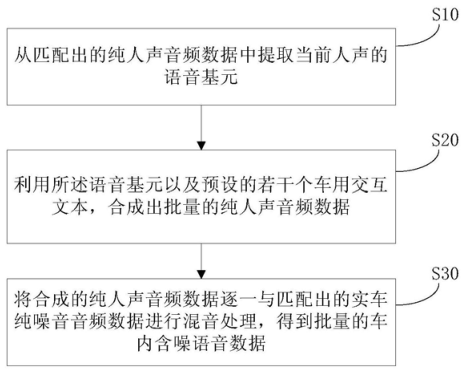

如上图,为该专利中发明的语音数据扩方法的流程示意图,首先,从匹配出的纯人声音频数据中提取当前人声的语音基元。再利用语音基元以及预设的若干个车用交互文本,合成出批量的纯人声音频数据。最后,将合成的纯人声音频数据逐一与匹配出的实车纯噪音音频数据进行混音处理,得到批量的车内含噪语音数据。

因此,可以发现,该专利主要的目的在于预先采集纯实景车噪和纯人声声源以构造出车用语音素材库。该车用语音素材库中的音频资源用于与用户所提需求结合,分别得到符合用户期望的车内含噪语音数据的纯人声声源以及纯实景车噪。然后将匹配出的纯人声声源以及纯实景车噪进行通道融合,生成用户所需的目标车内含噪语音数据。

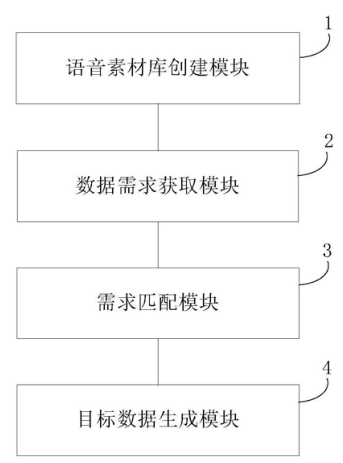

最后,如上图,为这种含噪语音数据生成系统的硬件装置模块,该系统中主要包括有:语音素材库创建模块1、数据需求获取模块2、需求匹配模块3以及目标数据生成模块4。

语音素材库创建模块可以预先创建语音素材库;数据需求获取模块用于接收并解析用户输入的数据需求;需求匹配模块用于根据解析后的数据需求,从语音素材库中分别匹配出与用户需求对应的纯人声音频数据以及实车纯噪音音频数据;最后,目标数据生成模块用于将匹配到的纯人和实车纯噪音音频数据进行混音处理,生成车内含噪语音数据。

以上就是科大讯飞发明的车内含噪语音数据生成方案,该方案只需结合成熟的语音合成技术就可以实现人声素材资源的拓展,无需如现有技术重新反复进行实地录制数据,实现了对预先创建的语音素材资源的复用。解决了当前实车实景人工录制方式费时、费力、高成本等弊端,并有效提升了车用交互语音数据样本的制作效率。