本文内容非商业用途可无需授权转载,请务必注明作者及本微信公众号、微博 @唐僧\_huangliang,以便更好地与读者互动。

《PowerEdgeMX SAS存储交换应用:类ODA数据库一体机,还有啥?》

最近比较忙,不过之前说过要写的东西还是尽量去兑现。另外就是之前写出一点错误和不足之处也想在本文中补充交代下。

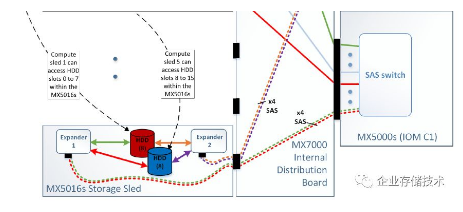

首先是上一篇中提到的PowerEdge MX7000模块化服务器SAS交换的“驱动器分配模式”,应该是只能用PERC H745P MX RAID卡,而不能用HBA330 MMZ。

根据我对这一块设计的理解,当一个MX5016s“存储刀片”中的HDD/SSD允许分配到不同服务器节点时,默认要使用RAID卡来保证可靠性。而SAS HBA卡主要针对软件定义存储(SDS)使用场景,比如vSAN分布式存储/超融合,计算刀片分别连接不同存储模块中的盘,在此基础上跨Storage Sled利用多副本保护数据。

无中板设计:区别于传统刀片服务器

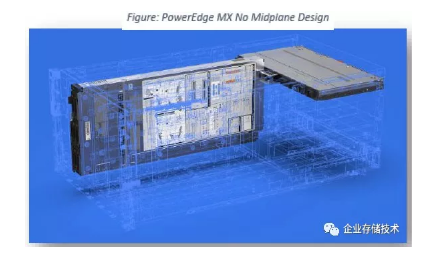

之前我留意到PowerEdge MX前后风扇不同风道的散热设计,但忘了跟大家讲一点前提。就是传统刀片服务器在前端计算刀片和后端网络交换模块之间,通常是有中板转接的,这也可能制约到机箱后续的网络带宽升级。

比如之前的PowerEdge M1000e的网络应该就没有升级到100GbE,相比较下MX7000的7U机箱规模要小一些,采用了简洁的无中板设计(如上图)。这样同时也优化了散热气流,因为中间少了阻隔。

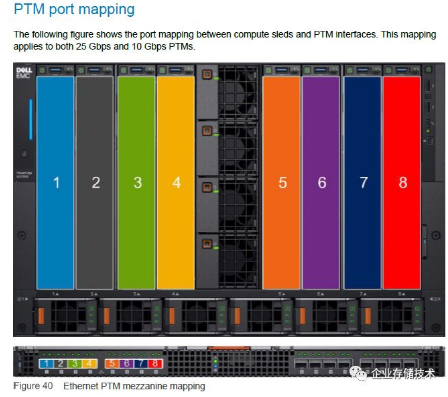

对于PowerEdge MX7000而言,最基础的网络模块是直通(pass-through modules)。上图可以看到计算刀片与PTM上面的端口对应关系,这里支持25Gbps和10Gbps网卡接口。

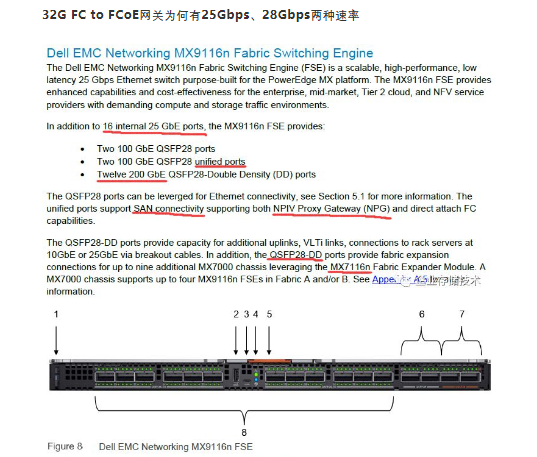

32G FC to FCoE网关为何有25Gbps、28Gbps两种速率

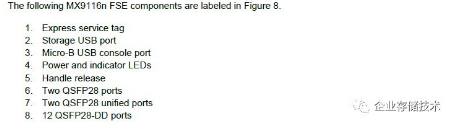

对于MX7000模块化服务器中最高端的Dell EMC Networking MX9116n FSE(Fabric Switch Engine)网络模块,除了16个25GbE内部接口,还有2个100GbE QSFP28接口、2个100GbE QSFP28 unified ports,以及12个200GbE QSFP28-DD(双倍密度)接口,后者可以用来连接不同MX7000上的MX7116n Fabric扩展模块,下文中我再详细解释。

首先我们来看看unified ports(统一接口)的工作原理,它能够提供FC SAN存储下行连接能力,支持NPIV代理网关(NPG)和直连FC功能。也就是让服务器可以用FCoE来连接光纤通道阵列,提供除了MXG610 FC交换机模块之外的另一种选择。

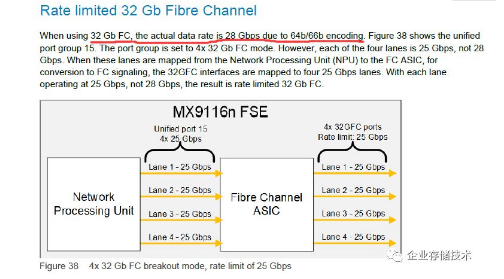

由于32Gb FC__的64b/66b__编码,实际有效数据__传输速率为28Gbps__。

上图是unified ports底层的芯片设计。一种选择是MX9116n的NPU(网络处理单元),可以用Unified port 15的4个25Gbps Lane连接到Fibre Channel ASIC桥接芯片,然后提供4个速率限制为25Gbps的32G FC接口。

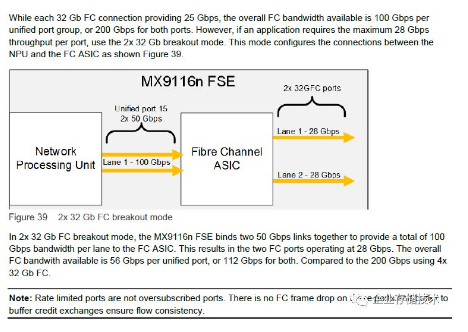

如果用户想要无折扣全速的32G FC,还有下面这种选择。

这个模式是把NPU到FC ASIC之间的100Gbps Lane配置为2个50Gbps,如此就能提供2个28Gbps全速的32G FC接口。

QSFP28双密度连接器:从MX9116n FSE扩展到MX7116n FEM

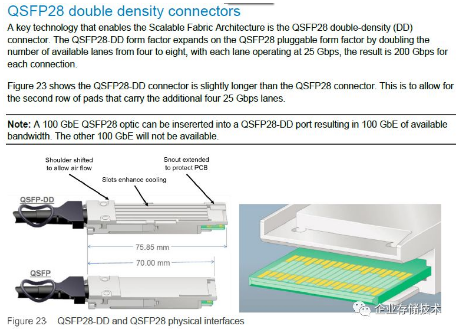

能在一个QSFP28-DD接口上跑200Gb双向带宽的秘密,就是那2排金手指触点,这样就将25Gbps lane从4个翻倍达到8个。该模式应该是只用于MX9116n到MX7116n之间的连接,如果在同一接口中插入普通的100GbE QSFP28光纤,则只能用到一半也就是100GbE的带宽。

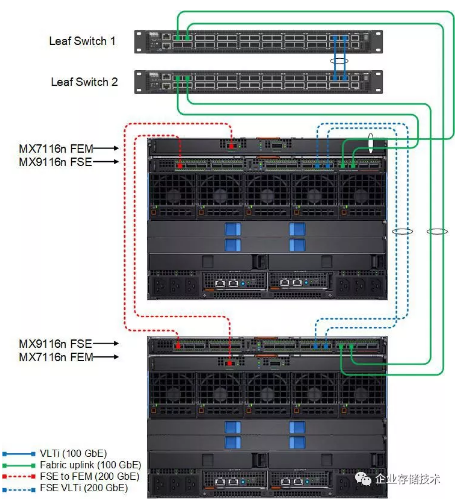

如上图,在2个MX7000机箱(刀箱)中各配有1个MX9116n Fabric交换机和1个MX7116扩展模块,每个MX7116n分别通过200GbE(红色虚线,QSFP28-DD)连接到另一个MX7000上的MX9116n上面。根据我有限的网络知识,此二者之间的关系是不是有点像Cisco Nexus 2000和7000系列那样?MX7116n并不是完整功能的独立交换机,就是专用于多套MX7000机箱扩展的SmartFabric组网。

蓝色虚线的FSE VLTi(200GbE)是MX9116n FSE交换机之间互连的200GbE(2条100Gb);绿色实现就是普通的Fabric uplink 100GbE上行连接了,比如南北向接口上方的Leaf Switch可以用Dell Z9100-ON。

Dell EMC Networking MX9116n、MX7116n,以及MX5108n这几款交换机,应该都是由当初收购Force10技术发展而来的。比如SmartFabric模式,支持的也是OS10EE系统命令行。

可视化管理界面、模块化服务器的客户心声

刀片类服务器的一大优势,或者说重要价值点就在于集中管理系统。用过Dell服务器的朋友,估计不少都知道Open Manager(OME)管理软件。本次针对PowerEdge MX7000新型号,特别推出了OpenManage Enterprise– Modular Edition(OME-M)模块化版本。

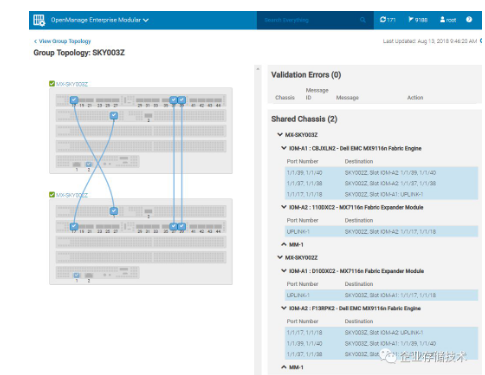

如上图,MX9116n和MX7116n之间网络连接的可视化效果,还是很容易理解吧?

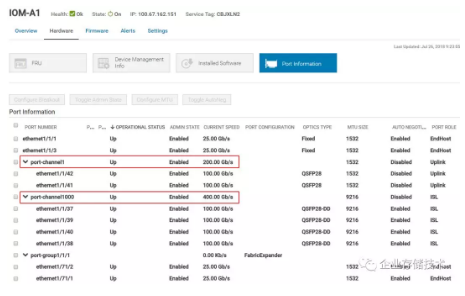

再来看下上面这个示例:IOM-A1槽位中的MX9116n有2个QSFP28网口组成200 Gb/s的Uplink port-channel;另有4个QSFP28-DD(此时未工作在双倍密度模式)网口配置为另一个400 Gb/s ISL port-channel。

上图节选自Dell EMC中文网站PowerEdge MX7000网页的客户证言。华大基因生物计算HPC平台高级工程师李焱对之前一代模块化服务器FX2的管理程序、包括CMC和iDRAC给出了满意的评价。

如今除了更新的管理软件,CMC(机箱管理控制器)在MX7000上也已经升级到下一代模块,希望青出于蓝能够胜于蓝吧。

至此,本文系列3篇就先告一段落了,有没有朋友想亲眼看下PowerEdge MX7000的实物呢?据说今天在北京国家会议中心举行的2018戴尔科技峰会上要展出一台样机。如有想在现场聊下的朋友,也可以给我发消息哦:)

推荐阅读

本文转载自企业存储技术微信公众号原文链接点这里

注:本文只代表作者个人观点,与任何组织机构无关,如有错误和不足之处欢迎在留言中批评指正。 进一步交流技术可以加我的微信/QQ:490834312。

尊重知识,转载时请保留全文,并包括本行及如下二维码。感谢您的阅读和支持!《企业存储技术》微信公众号:HL_Storage,也欢迎关注企业存储技术极术专栏,定期更新。