从互联网、智能硬件到行业应用系统,计算正在成为数字化的能量之环和核心推动力,各类应用场景对算力的需求每年成倍增加,尤其进入5G时代,新增数据类型80%以上都是图片、视频、文本与语音等非结构化数据,对这些数据处理需要更高的算力。

通用计算的性能增长乏力,人工智能对算力的需求却越来越高。于是,FPGA、GPU以及NPU等新计算组件纷纷加入战阵,从通用计算转向异构计算。华为基于昇腾芯片的训练与推理类服务器,形成覆盖端边云全栈全场景的产品与解决方案,对AI类应用带来强劲的性能提升。

为了探寻昇腾芯片以及Atlas系列产品在AI类应用的加速作用,探究最强AI算力平台究竟“强”在哪儿?E企研究院针对训练场景,实测Atlas 800训练服务器,体验到超乎想象的性能。

实测前重点:选择主流模型

AI的实现包括两个核心环节:训练(Training)和推理(Inference)。根据承担任务的不同,训练场景中要通过大数据训练出一个复杂的神经网络模型,即用大量标记过的数据来“训练”相应的系统,使之可以适应特定的功能,这意味着,训练需要极高的计算性能、较高的精度、能处理海量的数据,还要有一定的通用性,以便完成各种各样的学习任务。

因此,实测Atlas 800服务器的具体性能之前,需要选取目前业界主流的训练模型,从AI2的ELMo,到OpenAI的fine-tune transformer,再到BERT,在这些预训练的语言模型中进行初步筛选。

1、选择AI领域最主流、最强大的训练模型

在人工智能领域,对于自然语言处理(Natural Language Processing 以下简称“NLP”)的研究也是充满魅力和挑战的,目前NLP领域最主流的训练模型是Google Research提出的BERT(来自Transformers的双向编码表示,Bidirectional Encoder Representations from Transformers的缩写)模型,作为一种新型的语言模型,BERT推出后就横扫包括语言问答、理解、预测等各项NLP指标的桂冠。

除了在模型结构和训练目标上的创新,BERT的成功还来自于模型的体量以及训练的数据量,BERT预训练模型有BERT-Base和BERT-Large之分,主要是训练参数的数量不同,比如BERT-Base总计约1.1亿个参数,而BERT-Large则有3.4亿个参数。

算法/模型的突破离不开数据,但更离不开算力,BERT预处理模型功能需要建立在极强的计算力基础之上,训练的代价是不菲的。

由于公认通用处理器并不适合支撑AI训练场景,除有实力自己研发AI专用芯片的互联网巨头外(比如谷歌用了16个自己的TPU集群来训练BERT-Large模型),行业内广泛使用GPU为AI训练应用提供算力,诸多提供AI解决方案的公司利用BERT训练模型来展现其性能。

在实测前,E企研究院就选取了NLP领域的主流模型:BERT预处理模型。

2、选配置,搭平台

E企研究院根据业内某主流AI供应商公开的硬件配置,选择一个与Atlas 800服务器配置相似的GPU服务器性能结果作为参照组,来验证运行相同BERT-Large模型时的性能。

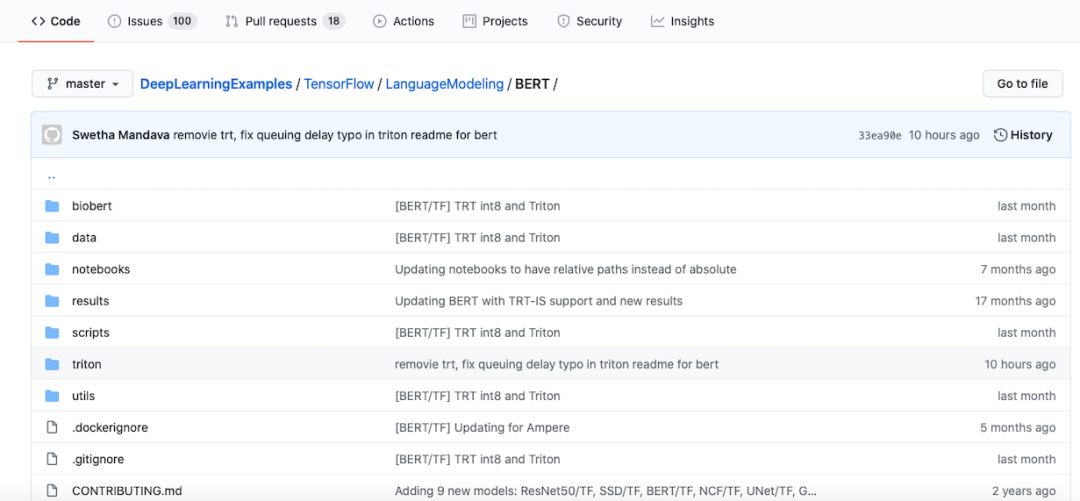

在GitHub官网上,可以看到某AI供应商用8张GPU卡运行BERT-Large预训练模型,其结果与代码公布均在GitHub上(点击查看链接:https://github.com/NVIDIA/Dee... )。

E企研究院验证的单台华为Atlas 800训练服务器内正好配备了8张昇腾910扣卡,提供AI算力的芯片数量也相同,工程师在下载此AI供应商发布在Github上的BERT-Large模型代码后,移植到Atlas 800训练服务器上,来验证Atlas 800训练服务器在进行BERT-Large模型的性能。

3、构建模型超参 快速部署

超参数,是除了算法内部本身参数以外,其他需要设置的外围参数统称。E企研究院工程师除了保证其可正常运行在Atlas 800训练服务器上的必要代码修改之外,不做其他超参变动,以此来评估在近似相同条件下,Atlas 800训练服务器在运行BERT-Large预训练模型时所发挥的性能。

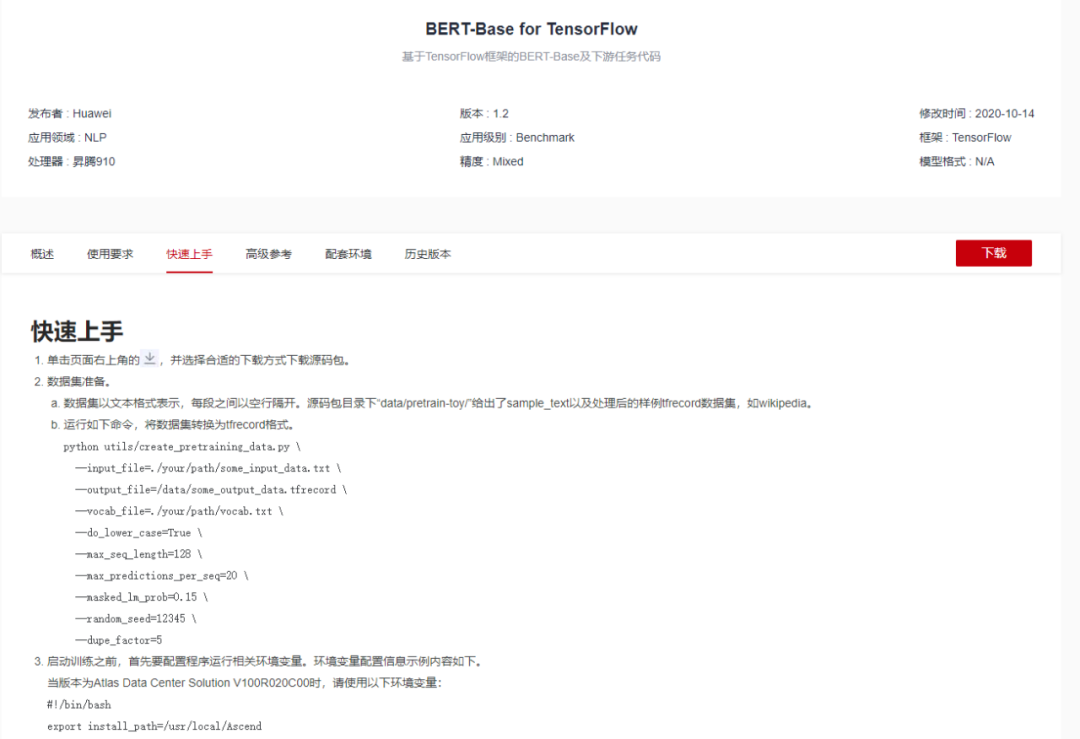

图注:在华为网站昇腾开发者社区的ModelZoo中,提供如何将基于TensorFlow框架的BERT模型转换到Atlas平台上的方法

此次工程师测试使用的是BERT-Large模型,本质上与BERT-Base是同一个模型,只是训练时的层数不一样(前者24层,后者12层)。

从TensorFlow转换到昇腾平台运行的过程非常简单,只需三步即可。

第一步:将指定训练用的数据集转换为tfrecord格式, 这次工程师测试使用的是维基百科英文版(这是Google论文中的举例,也是某AI供应商使用的数据集,其测试结果可在GitHub官网中可查);

第二步:更改环境变量,将提供算力的硬件改为昇腾910芯片;

第三步,指定单卡/多卡进行训练任务,工程师采用Atlas 800训练服务器,指定8卡进行训练。

25小时持续训练结果:性能领先业界3倍以上

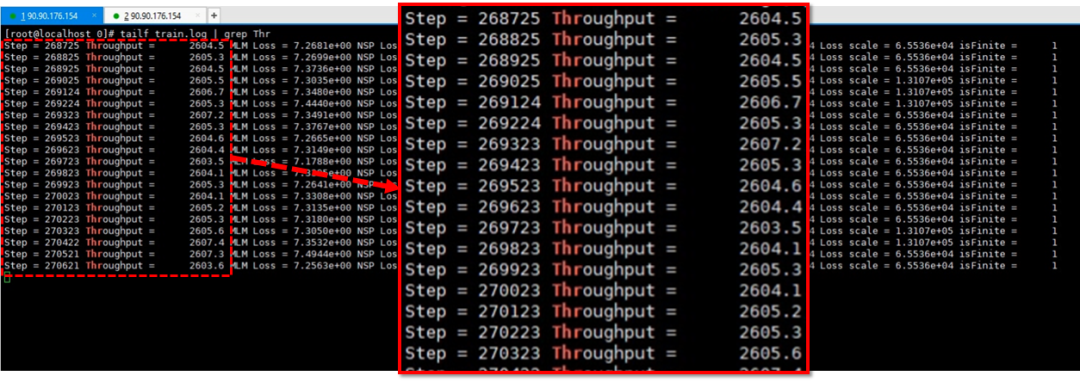

一切准备就绪后,工程师们开始BERT-Large模型训练,训练时间大约持续了25小时左右。在训练过程中,通过命令行方式可以获取实时训练进度,每30秒更新一次,以此评估Atlas 800训练服务器的性能,具体如下图所示:

图注:Atlas800训练服务器正常运行BERT-Large模型24小时之后,进度大约在27万步前后,工程师通过命令行获取其运行日志,并进行截图,红框中即为体现算力性能的训练表现。

从上图显示的数值进行平均计算,每一步(Step)的吞吐量约为2605,输出数值表现也非常稳定,是采用某AI供应商所使用GPU训练成绩的3倍以上。

同时从这家AI供应商在其官网中公布的性能来看,在序列长度(Sequence Length)为128、批处理(Batch size)超过64时,其解决方案就会因为内存不足导致结果不可用,而Atlas 800训练服务器则无此情况,其批处理甚至可以达到96,从上图也可以看出,批处理数量越高,在进行BERT训练时的性能越好。

解构Atlas 800训练服务器:高性能背后的奥秘

在实测中,Atlas 800训练服务器发挥出了超乎我们想象的性能,高性能背后的硬件平台是怎样的呢?经过体验后,E企研究院得出以下结论:

1、创新架构新高度

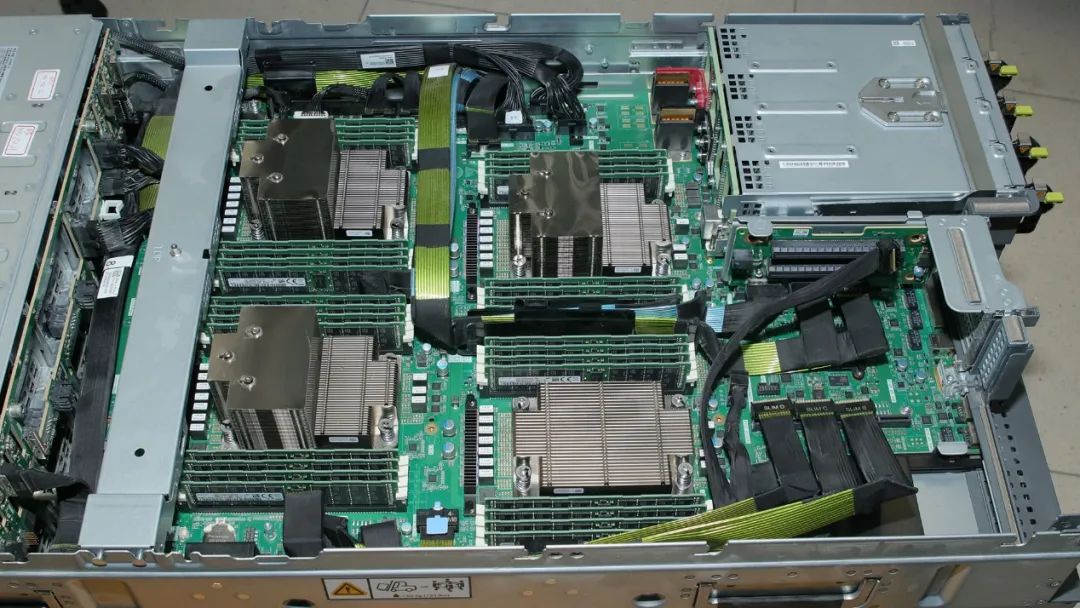

Atlas 800训练服务器采用4U标准设计,内部分为上下两层,上层主要是CPU及其主板,下层是8个扣卡(Mezzanine)式的昇腾910处理器及其主板。

图注:Atlas 800训练服务器内部,从上层的四路布局,可以看出是使用鲲鹏920处理器的9000型,因为采用Intel处理器的型号(9010)为双路配置。使用鲲鹏920处理器的一大优势在于支持PCIe 4.0通道,能够更充分的发挥出昇腾910芯片的性能,而Intel平台则要到2021年推出的下一代处理器才能支持

图注:Atlas800训练服务器内部的下层设计,8个金属散热片下面是8个扣卡式昇腾910处理器;图中的线缆主要用于连接上层的CPU,这也使得Atlas 800训练服务器有一种粗犷的暴力美

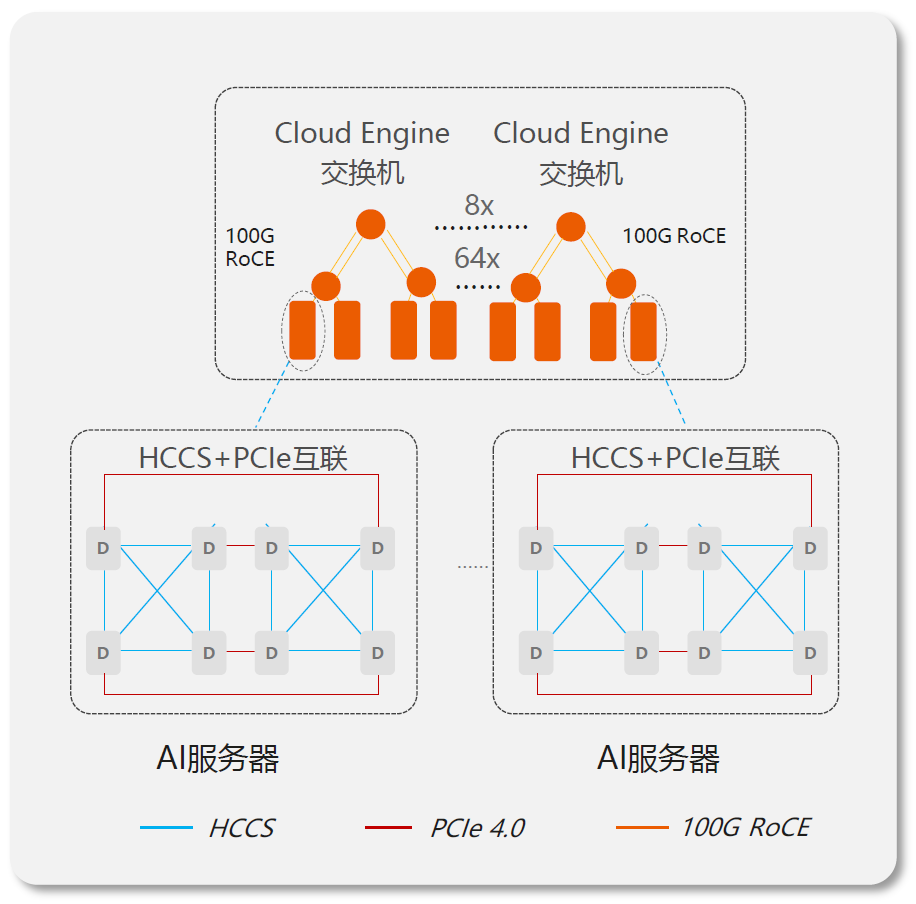

之所以说扣卡式的昇腾910在训练场景中所能发挥的性能更高,原因在于,昇腾910芯片一共有三种高速接口,即PCIe 4.0通道、支持RoCE v2的100GbE、以及HCCS(Huawei Cache Coherent System,华为缓存一致性系统)高速互连。PCIe 4.0用于与CPU连接,100GbE用于集群组网,带宽最高的HCCS则用于昇腾910芯片间互连。

以上图为例,Atlas 800训练服务器内部下层的8颗昇腾910芯片分为两组并列,每组4颗,组内4颗昇腾910芯片使用HCCS互连,两组之间再使用PCIe 4.0互连;由于HCCS的存在,即使使用相同数量的昇腾910芯片,Atlas 800训练服务器的性能要高于相同数量的Atlas 300T中心训练卡组网。

图注:三种互连技术的作用范围

单颗昇腾910芯片TDP可达350W,Atlas 800训练服务器内一共部署了8颗,再加上CPU及其他配套周边,整台服务器的功耗高达5.6KW,当然性能也非常出众,单台Atlas 800训练服务器最高可提供2.56 TFLOPS的AI算力。

同时,Atlas800训练服务器也需要强大的散热能力,Atlas 800训练服务器支持风冷和液冷(其实是风液混合散热,即通过冷板式液冷将昇腾910处理器发出的热量带走)两种散热方式,这可以根据数据中心条件进行选择。

比如E企研究眼体验的这台Atlas 800训练服务器就采用风冷散热的方式。

图注:Atlas800训练服务器,前面几乎被8组硕大的对旋风扇占满,其中5组都位于下层,为8个昇腾910芯片吹风。右下角的“Model9000”表示其内采用的是(4路)鲲鹏920处理器+(8颗)昇腾910芯片。如果是英特尔平台的处理器,那型号就是9010)

以上是Atlas 800训练服务器系的性能实测及创新架构解析,华为Atlas服务器在AI应用中表现出的强大算力,将成为千行百业从数字化向智能化转型的新动能。

**E企研究院致力于“降低用户对新技术和新方案的接受成本“,聚焦云计算、AI、数据中心等新型基础设施领域的技术和趋势研究,拥有专职的技术咨询团队、分析师团队和专家顾问团队,解析新产品新技术,向厂商提供顾问服务,为用户提供咨询服务。