首发:AIWalker

作者:HappyAIWalker

标题&作者团队

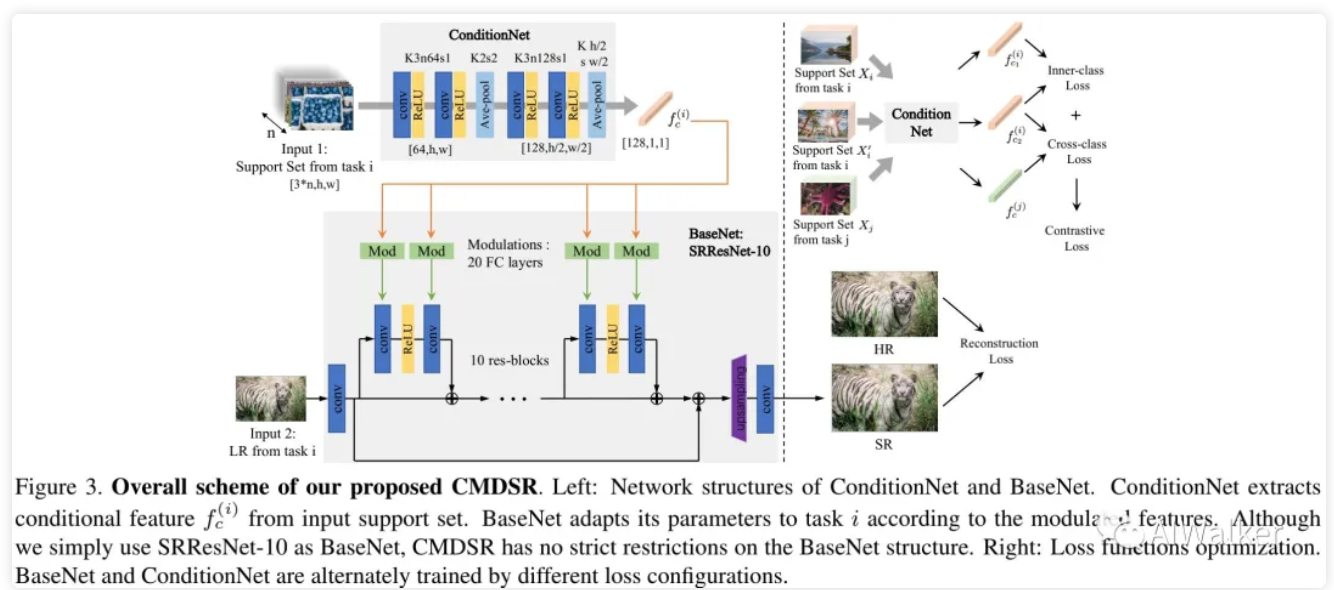

本文是浙江大学&字节跳动在多退化盲图像超分方面的一次尝试。针对训练与测试时不同的退化偏移导致的模型性能下降问题,本文采用ConditionNet从输入图像提取关于退化信息的条件特征,然后根据该特征对后续的超分网络BaseNet的参数进行调整,最后参数调整后的BaseNet对输入图像进行处理得到最终的超分图像。无需关于退化的先验信息,所提方法可以自适应从不同退化数据中提取合适条件特征并生成令人满意的超分结果。

Abstract

尽管图像超分在单一退化(比如Bicubic、Blur-down)方面取得极大成功,但是,当面对真实场景的复杂且多样退化时,模型的性能会出现严重的下降。近来也有一些针对多退化问题的盲/非盲图像超分,然而这些方法在训练数据与测试数据分布存在偏差时仍会出现性能的下降。

为解决上述问题,我们首次提出一种条件元网络框架:CMDSR,它有助于SR模型学习如何针对输入分布进行自适应调整。具体来说,ConditionNet首先从支撑集(由相同任务的不同退化图像块构成)中学习退化先验信息;然后根据ConditionNet所提取的先验信息自适应调整BaseNet的参数。更进一步,为更好的提取退化先验信息,我们提出了一种任务对比损失减小同任务退化先验信息的距离,提升不同任务退化先验信息的距离。

无需预定义退化映射关系,所提盲超分方案可以通过单模型自适应生成相当好的超分结果。我们通过充分的实验验证了所提CMDSR的有效性与灵活性。

本文的主要贡献包含以下几点:

- 提出首个条件元网络框架用于盲图像超分,它可以自适应的进行多种退化类型的图像超分;

- 提出一种任务对比损失用于特征提取,即退化先验信息;

- 所提方案是一种通用框架,具有盲、快速以及灵活等特性。

Method

本文的主要目标:仅仅利用少量样本,开发一种可以自适应的覆盖多种退化的框架。为此,我们需要寻找一种可以刻画退化先验信息的表达并用于指导模型对该退化模式进行自适应调整。

考虑到这样一个事实:相同任务的LR图像具有相同的退化模式,我们从任务(而非图像)这个更粗的维度来看到退化问题;然后,所提取的关于退化的特征用作超分模型的先验信息并用于调整模型参数。

在该框架中,我们提供两种配置访问训练数据:

- 训练数据按照不同任务分组。假设多任务,每个任务包含LR-HR数据对;

- ConditionNet从LR图像块提取任务级特征,BaseNet则对图像进行超分。

CMDSR

framework

Species of Loss Functions

CMDSR训练与测试流程

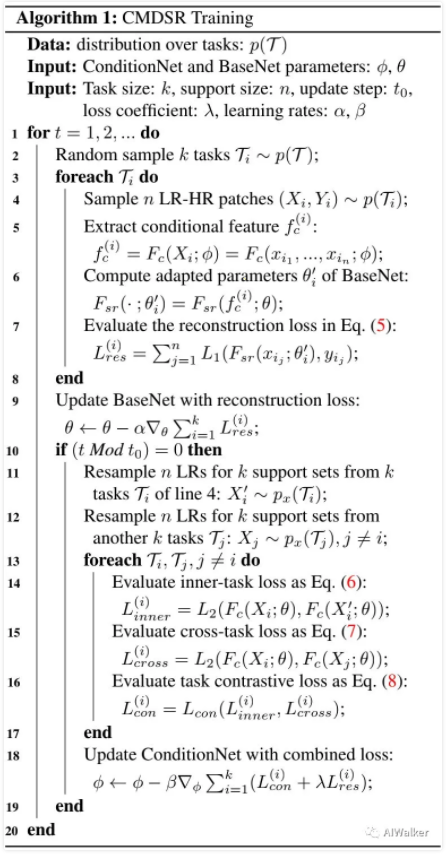

Training 下图给出了CMDSR的训练流程:ConditionNet与BaseNet交替训练直到两者达到收敛。在每次迭代时,从退化分布中随机采样k个任务;然后对BaseNet进行自适应调整与训练。此外,每次迭代对ConditionNet进行一次联合优化。

training

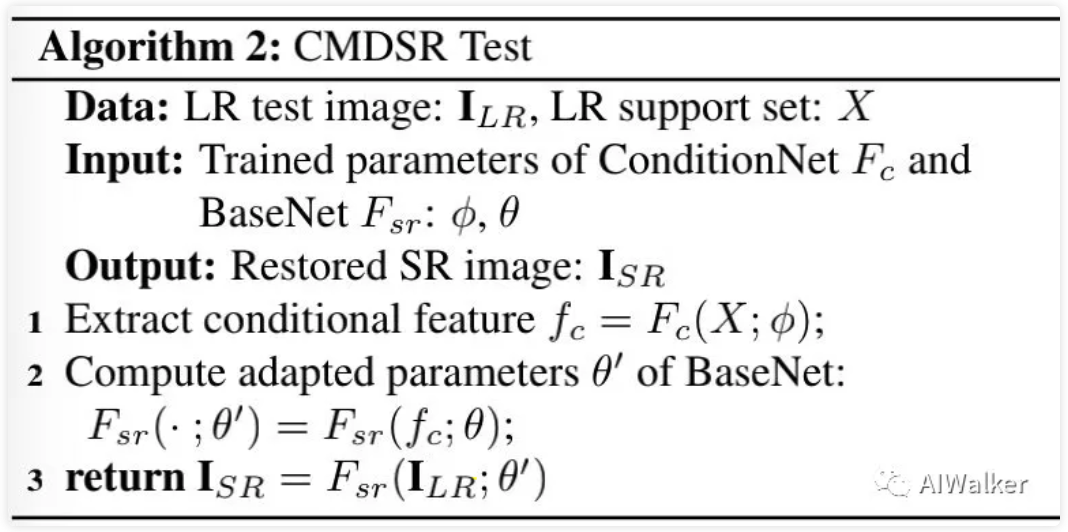

Test 下图给出了测试阶段的流程。对于测试集X,我们从其他LR图像块(或者自身图像块)中提取条件特征;然后再采用BaseNet对测试集图像进行超分重建。

test

Experiments

在训练过程中,任务数量,每个任务的支撑集,图像块为,更新迭代:这意味着BaseNet训练9次后再进行ConditionNet的联合训练。损失函数系数,BaseNet与ConditionNet的初始学习率分别为0.001与0.0001,优化器为Adam。

训练数据采用了DIV2K,不同的退化方式选用了不同的各向同性高斯模糊(各项同性高斯模糊,核宽范围)以及加性高斯噪声(噪声水平)。

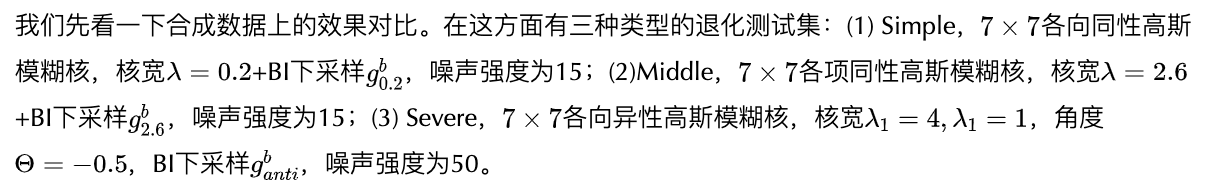

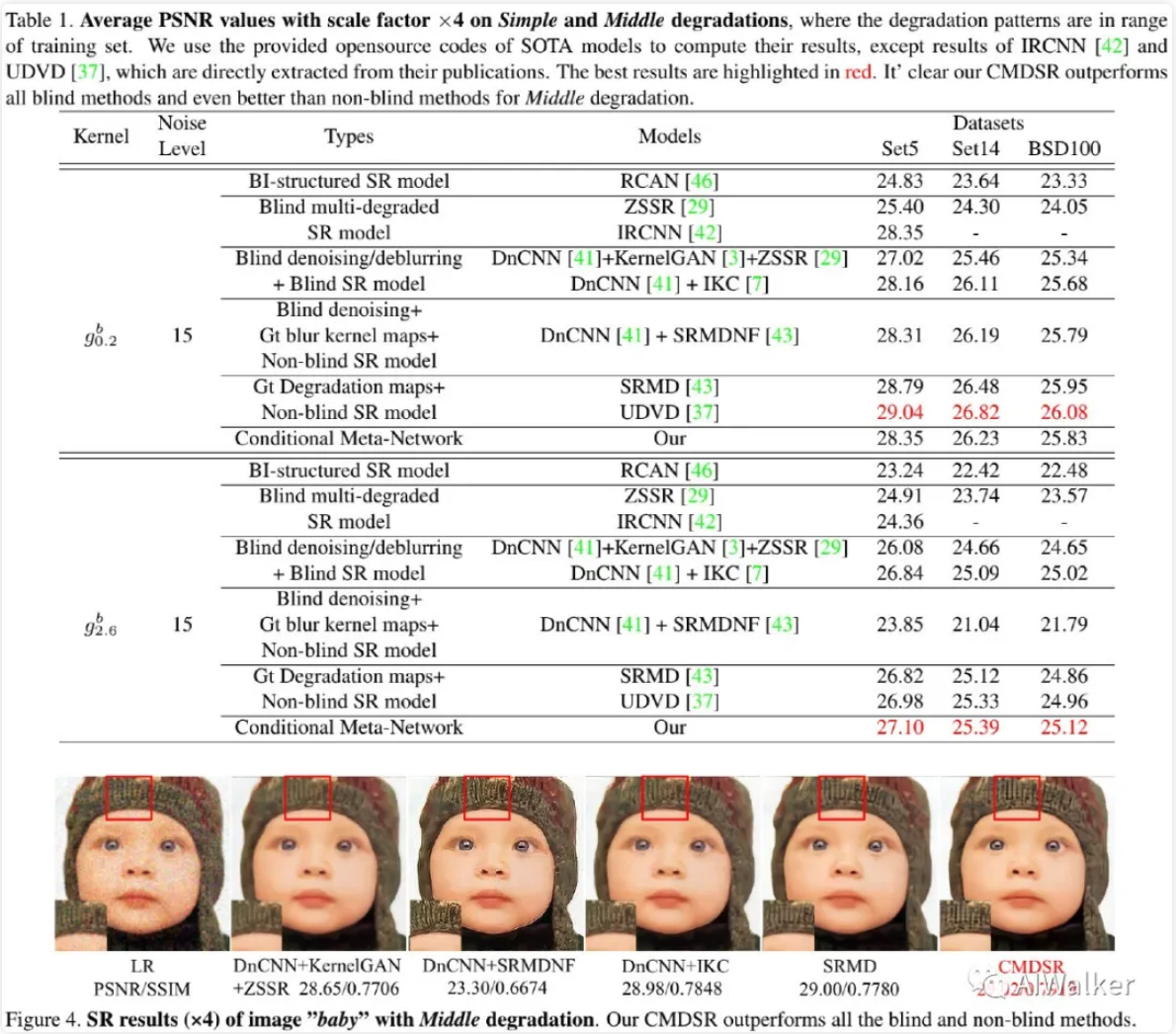

Synthetic Images

simple&middle

上图给出了Simple与Middle测试数据方面的指标与视觉效果对比,从中可以看到:

- 由于退化的未知性,BI退化的RCAN导致了比较差的PSNR指标;

- DnCNN+SRMDNF的组合出现了PSNR的严重下降与过度锐化问题;

- 在Simple退化方面,本文所提CMDSR取得了盲超分中的最佳PSNR指标,但稍差于非盲方案。

- 在Middle退化方面,本文所提CMDSR取得了最佳的PSNR指标,且优于非盲方案。这说明:当退化变得复杂后,所提方案的泛化性能变的更为重要。

- 在视觉效果方面,CMDSR生成了更为锐化和清晰的超分结果。

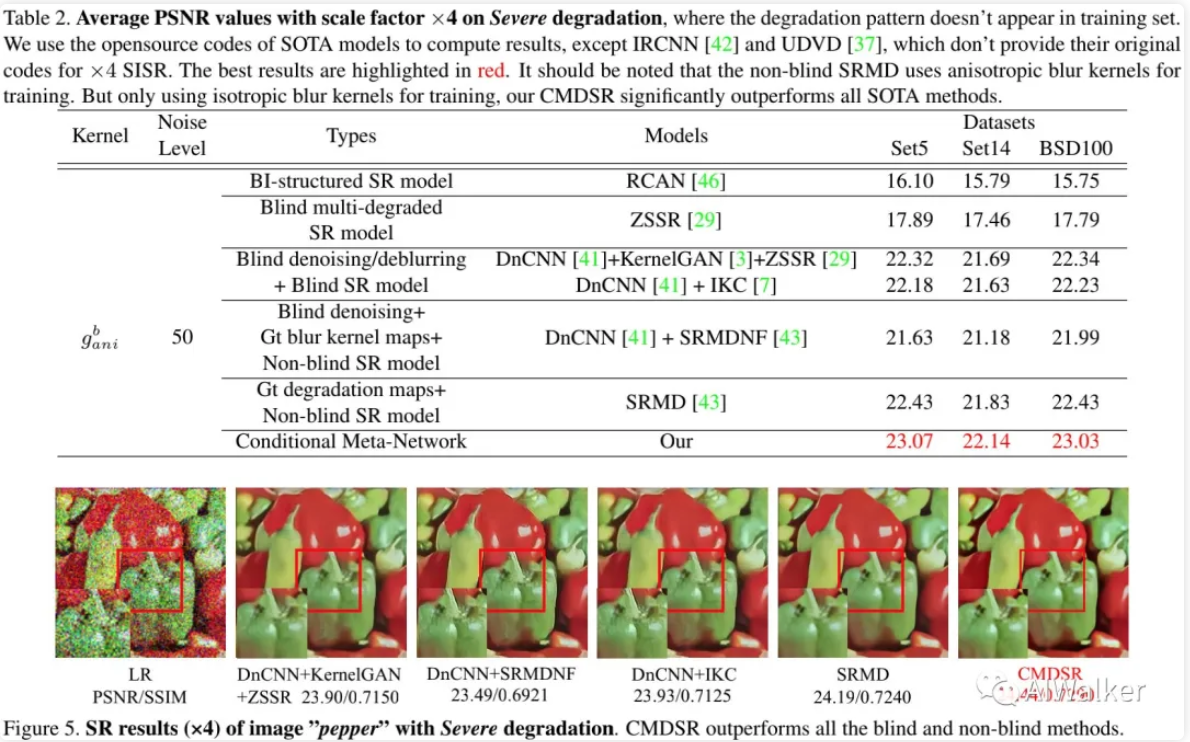

severe

上图给出了Severe退化方面的性能与视觉效果对比,从中可以看到:CMDSR以较大优势超过了其他盲与非盲超分方案。此外需要注意:SRMD采用各向异性与各向同性高斯模糊同时进行训练,而本文所提CMDSR仅仅采用了各向同性高斯模糊进行训练。这进一步说明:本文所提方法在处理分布偏移方面的泛化性能。

Real Images

RealDataset

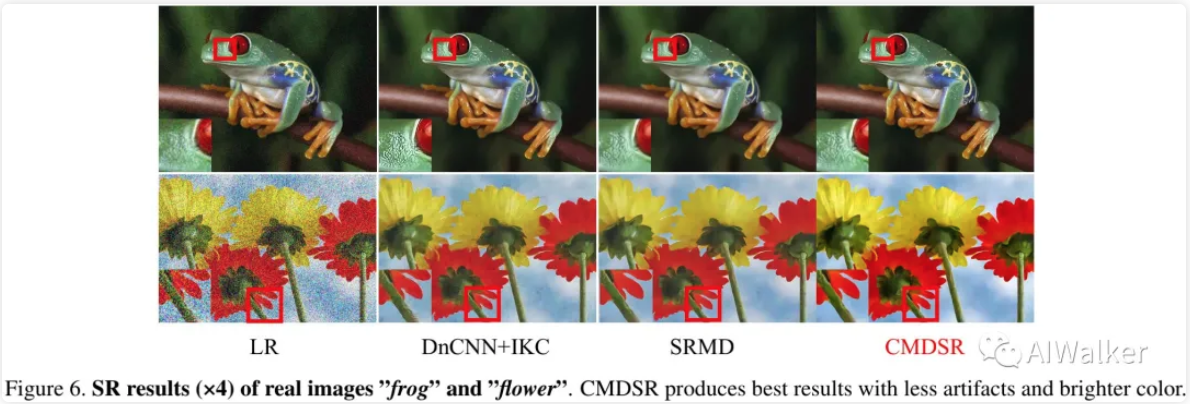

我们再来看一下真实数据上的对比,结果见上图。可以看到:

- DnCNN+IKC生成了过度锐化的超分结果;

- SRMD难以重建锐利边缘;

- CMDSR则生成最佳的视觉效果:更少伪影、更锐利边缘、更亮丽色彩。

Ablation Experiments

为更好地说明本文所提方法不同模块的作用,我们进行了不同的消融实验分析。

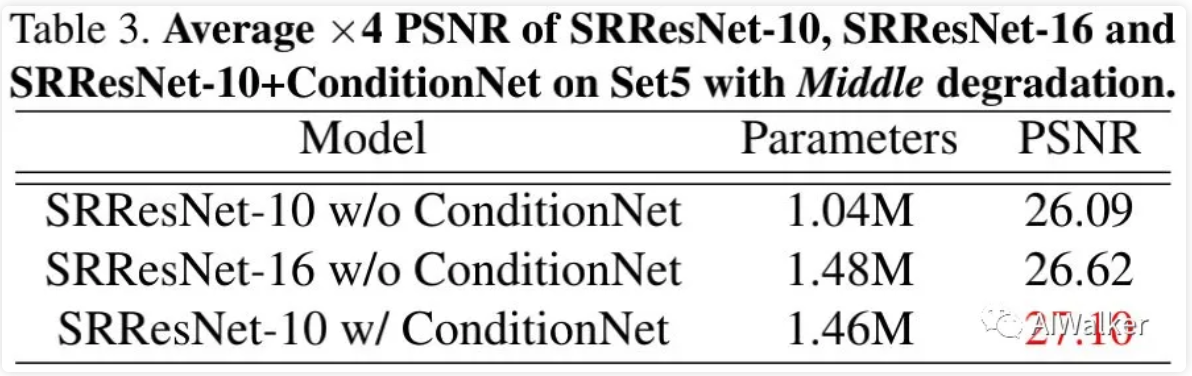

conditionnet

上表对比了ConditionNet的作用。尽管ConditionNet并不直接用于超分,但它却是引入了更多的参数。为公平对比,我们将其与同参数量的SRResNet16进行对比。可以看到:CMDSR的PSNR指标更高,证实了ConditionNet的重要性。

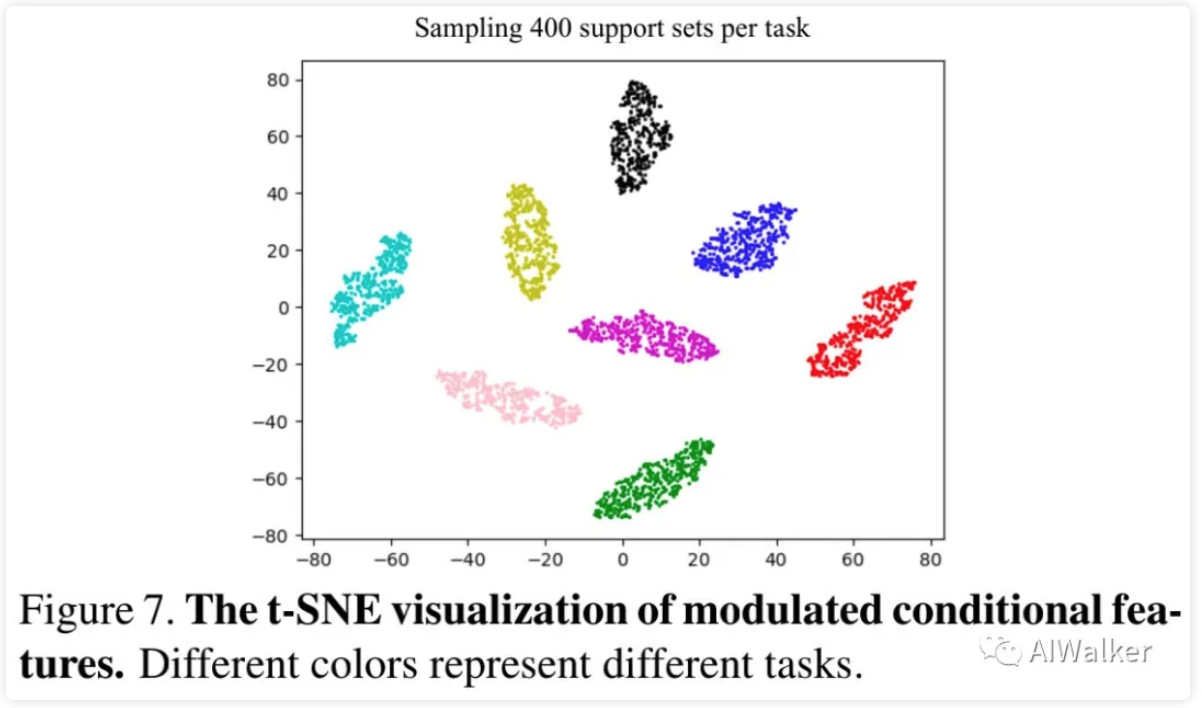

ConditionalFeature

为说明ConditionNet可以有效提取任务级特征,我们对齐所提取的特征进行了可视化,见上图。很明显:相同退化数据提取的条件特征具有强相似性;不同退化数据提取的条件特征具有不相似性。

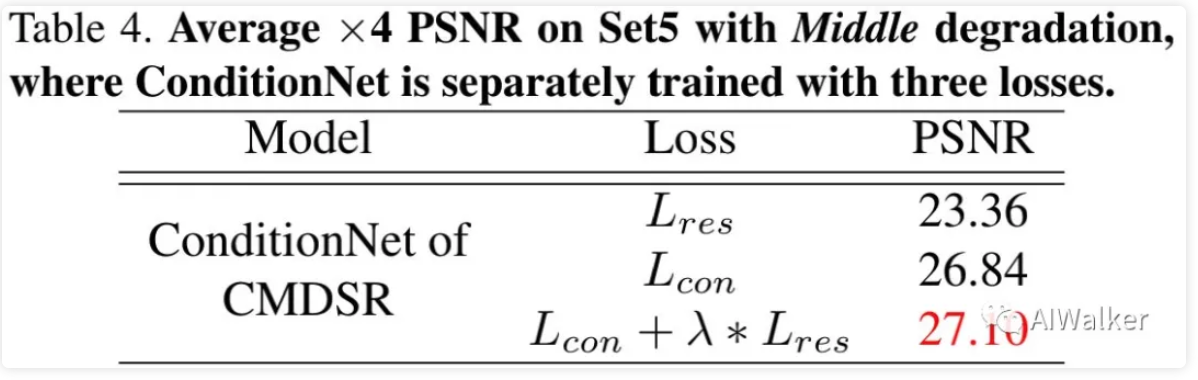

loss

上表给出了不同损失函数的重要性。可以看到:

- 如果ConditionNet采用进行训练,此时模型会出现性能崩溃,甚至比单一BaseNet还差;

- 当ConditionNet仅仅采用进行训练时,模型性能还可以接受;

- 当ConditionNet采用组合损失进行训练时,模型取得了最佳PSNR指标,这是因为模型在特征提取与超分重建方面取得了最佳均衡。

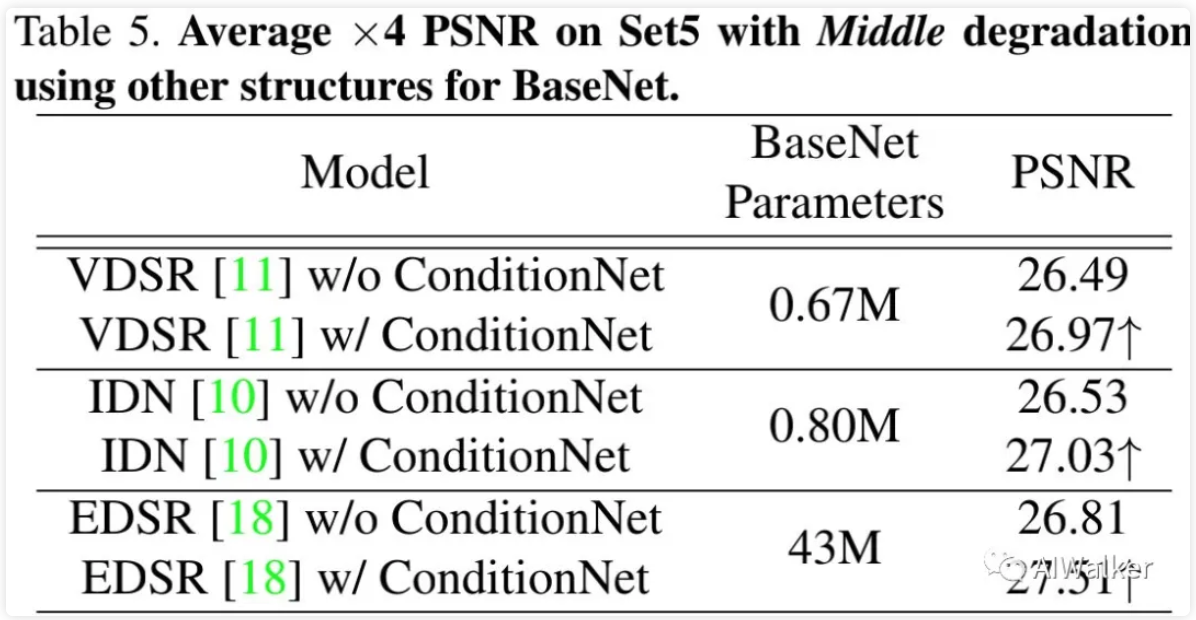

extend

上表给出了所提方案采用其他架构的超分模型时的性能对比。可以看到:替换为其他超分架构后仍可以取得了显著的性能提升;EDSR以更多的参数量取得了更佳的PSNR指标。

推荐阅读

- CVPR2021|单个网络支持sRGB渲染与RAW数据重建,港科大陈启峰团队提出可逆ISP

- “无痛涨点”的ACNet再进化,清华大学&旷视科技提出Inception类型的DBB

- 南京大学&港中文提出首个支持超高分辨率(10000x10000)图像风格迁移方案

本文章著作权归作者所有,任何形式的转载都请注明出处。更多动态滤波,图像质量,超分辨相关请关注我的专栏深度学习从入门到精通。