1:人工智能的兴起

很多人接触到人工智能这个名词,是从2016年3月15日,AlphaGo 4:1战胜李世石开始的;仿佛一夜之间,在全球传媒的狂轰滥炸下,AlphaGO的这只人工智能“狗”,名扬天下;人工智能第一次如此近距离的来到了人们的身边;此后,各种人工智能的初创公司,算法,产品蜂拥而至,机器学习,图像语音识别,智能驾驶一波又一波AI浪潮扑面而来,将人类裹挟着进入人工智能的科技时代。

实际上,早在在4年前的2012年,在一个学术界盛会上——大规模视觉识别挑战赛上(LSVRC),AlexKrizhevsky、Ilya Sutskever和Geoff Hinton提交一篇论文的结果以惊人的优势获得第一名,把图片分类错误率减少到16%,比前一年提高了10%,让整个学术界看到了AI的巨大潜力,要知道过去两年的进步只有2%;10%足以是一个跨时代的成果;GeoffHinton后来也被人称为AI教父;他亲手打开了AI的应用的大门,也不断催生者类似AlphaGo这样的新AI应用;

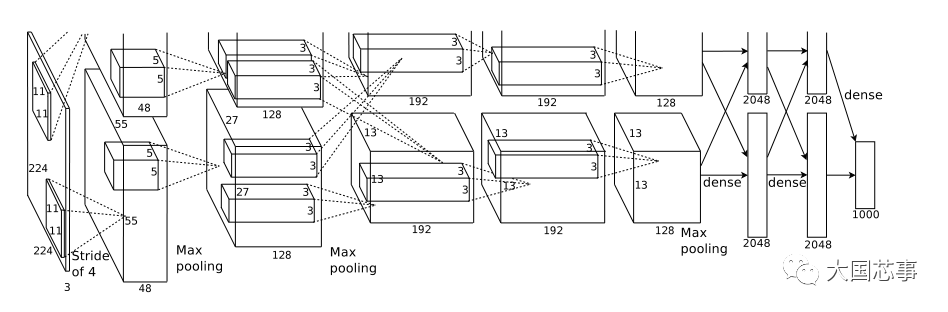

所有的设计都写在这篇划时代的文章之中,《ImageNet Classification with Deep ConvolutionalNeural Networks》用卷积神经网络对ImageNet进行分类;ImageNet是斯坦福大学的李飞飞团队创建的一个图片数据库;所有挑战者都用自己的算法来对数据库里的图片进行分类;下图都是ImageNet标记的图片,人类是很容易识别这些图片(例如,花朵,大象,航母,仔细想想人类的智能还是很奇妙,就像是在12306买票时选同一类图片,毫不费力就是做出识别);那么通过卷积神经网络,现在机器也可以做同样的事情了,采用CNN算法的机器也可以在很高的正确率上来分类这些图片(达到了人类同样的水平),这个CNN架构后来被称之为ALEXNET,用首作者的名字来命名;

卷积神经网络是一个提出很久的概念,ALEXNET带入他们进入实用阶段,卷积神经网络和AI就结下了不解之缘;ALEXNET有8层,分别是5个卷积层和3个全连接层;图像从一端进去然后到另一端的输出分类结果,最终得出结果;简单来说(实际过程要更复杂的多),就是图片像素点和相应的权重进行卷积等一系列复杂运算,运算的结果就识别到的结果,这个过程叫做推理;那么如何来设定这些权重?怎么保证设定这些权重就能得把想要的结果计算出来,比如说图片画着一只大象,如何设定这些权重,使得被计算出来的结果只有大象,那么获得这些权重的过程就是训练;

模型训练的本质就是使用大量带有标签的样本数据找到相对比较合适权重参数,之后这些参数可以作用于样本之外的数据。深度学习大部分还是靠经验,比如到底多少层合适,怎样做效果更好,很多时候针对不同的数据集可能有不同的答案,例如图片是一类,语音就是另一类。由于缺乏理论的指导,因此也被业界人调侃为“炼金术”;

中世纪的“炼金术”从来没有练出金子,但是这篇文章描述的“炼金术”却是实实在在的把AI的曙光带到了我们的身边,同时还带火了一个行业,就是机器学习的芯片;而NVIDIA正式是最大的受益者;

2:无心插柳柳成荫;

NVIDIA的看家本领是做GPU,最早的电脑是没有GPU的,只有CPU,所有的输出输出通过命令行交互就行了,时至今日,linux命令行式的交互仍然是服务器端主流的操作方式;但在个人PC领域,随着更复杂的实时图形和视频的应用,则需要更强大的适配图像计算的硬件单元来做这些渲染,纹理压缩,贴图,高清视频编解码的工作,单靠CPU很难来完成,GPU应运而生。

NVIDIA瞅准这个先机,在1999年推出了大名鼎鼎的Geforce系列,一直延续至今;GPU与CPU不同是,GPU有非常多的流处理器;例如TU102 GPU的手册中:4608个CUDA核心,每个都可以简单类比成为一个小CPU独立工作,可以用CUDA语言来编程。

真是无心插柳柳成荫;AlexKrizhevsky、Ilya Sutskever和Geoff Hinton那篇跨时代的文章中,就使用了2块GTX 580的GPU来做AI的训练;这个文章开启了AI时代,也开始了NVIDIA的AI霸主之路;后续蜂拥而至的学术界和企业界的AI探索中,不约而同的使用了NVIDIA的GPU来加速他们的AI应用;因为相对CPU来说,更适合AI运算这种大数量并行计算的场景,例如矩阵乘法和矩阵加法;

顺便说一下:GPU就是为图像的计算而生的,天生支持一些像素点的各种并行运算,AI的早期应用全部都是针对图像的像素点的矩阵计算,因此AI采用GPU是再自然不过的事情了;就好比你要在墙上钉一个钉子(AI),恰好,手头有一把锤子(GPU),就这么随手钉了几下,发现真是好用又顺手,简直好用的停不下来;天不生我GPU,AI万古长如夜;

3:NVIDIA的野望

AI眷顾了NVIDIA,NVIDIA也赋能了AI的应用;针对越来越大量的AI计算的趋势,NVIDIA顺势推出了更适配AI运算的新一代AI运算芯片;2020年5月份,英伟达GTC 2020的发布场地被挪到了黄仁勋自家厨房,在这个被成为厨房发布会上,NVIDIA推出了首款基于安培架构的A100GPU,台积电7nm工艺制造,集成多达542亿个晶体管,核心面积达826平方毫米,内置6912个FP32CUDA核心,最高加速频率1.4GHz,搭配512-bit 40GB HBM2显存,带宽达1.6TB/s;相比上代伏特架构的V100核心,它的INT8推理、FP32训练性能提升20倍,FP64计算性能提升2.5倍,是历史上进步最大的一次。

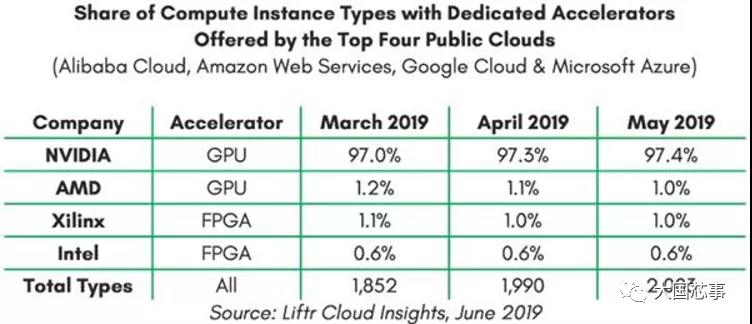

这些酷炫指标可不是单单是为了炫耀肌肉,作为这个蓝星上性能最强的AI芯片,可以完成2000多种AI应用,包罗万象,从图像语音识别,智能驾驶,决策管理,生物信息识别,自然语言处理,内容创作,智能营销等等方面,从GPU公司成功转型成为人工智能芯片公司;NVIDIA一度占据着四大云厂的AI加速的97%的份额;基本上是赢者通吃;这些份额就是市场对NVIDIA的褒奖和认可;

AI这个炼金术,对于NVIDIA就是新金矿;NVIDIA正是通过在AI领域的表现,在2021年股价达到3184亿美元,超过intel,登顶IC产业第一宝座;

作者:歪睿老哥

来源:https://mp.weixin.qq.com/s/3jBwNWP7OhChTf2F\_d70Fw

作者微信公众号

相关文章推荐

更多IC设计技术干货请关注IC设计技术专栏。