首发:AIWalker

作者:HappyAIWalker

本文是深圳大学&西安交大在注意力机制方面的探索,在通道注意力的基础上,引入多尺度思想,构建了本文所提的即插即用EPSA模块。相比其他注意力机制(比如SENet、FcaNet等),所提EPSANet在图像分类、目标检测以及实例分割任务上均取得了显著性能提升。原文链接:arxiv.org/abs/2105.14447

Abstract

已有研究表明:将注意力模块嵌入都现有CNN中可以带来显著的性能提升。比如,知名的SENet、BAM、CBAM、ECANet、GCNet、FcaNet等注意力机制均带来了可观的性能提升。

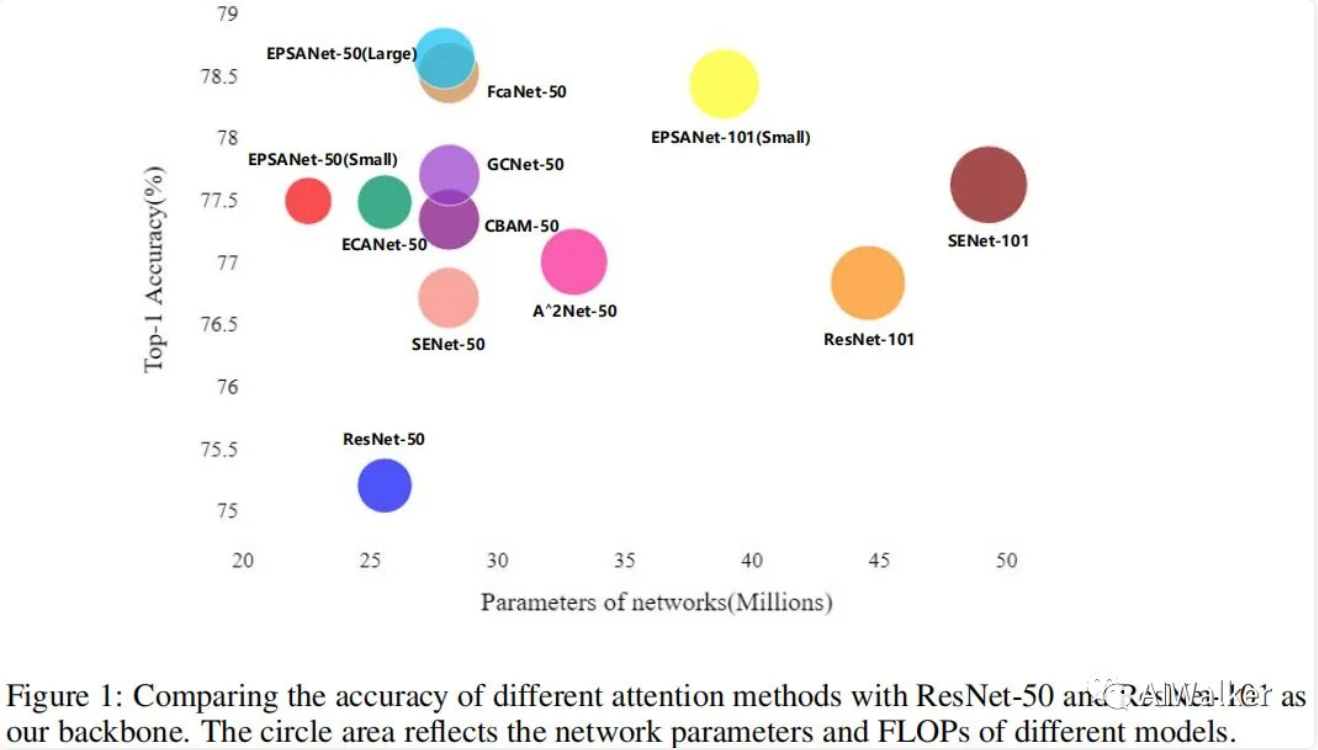

本文提出了一种新颖的轻量且高效的注意力模块PSA,采用所提PSA替换ResNet网络Bottleneck中的卷积得到了新的模块EPSA,所得EPSA可以作为一种“即插即用”模块用于现有骨干网络并显著提升性能。由此构建的骨干网络称之为EPSANet,它可以提供更强的多尺度特征表达并服务于下游任务,比如图像分类、目标检测、实例分割等。

无需任何技巧,所提EPSANet取得了优于其他注意力模型的性能。相比SENet50,所提方案在图像分类任务上取得了1.93%的精度提升,在目标检测任务上取得2.7boxAP指标提升,在实例分割任务上取得了1.7mAP指标提升。

Method

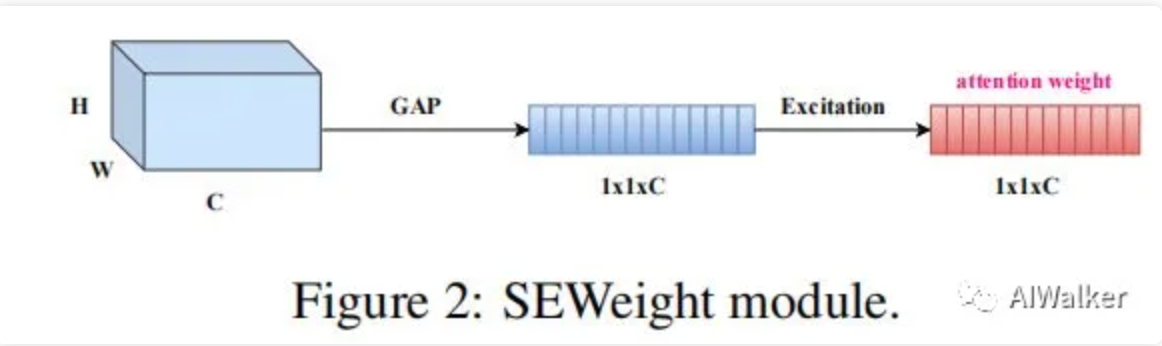

Revisiting Channel Attention

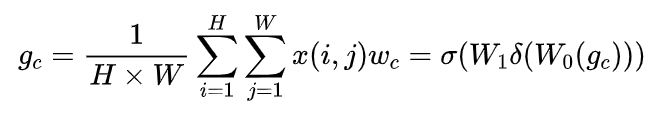

上图给出了通道注意力的结构示意图,它包含GAP+两个全连接层,可以描述如下:

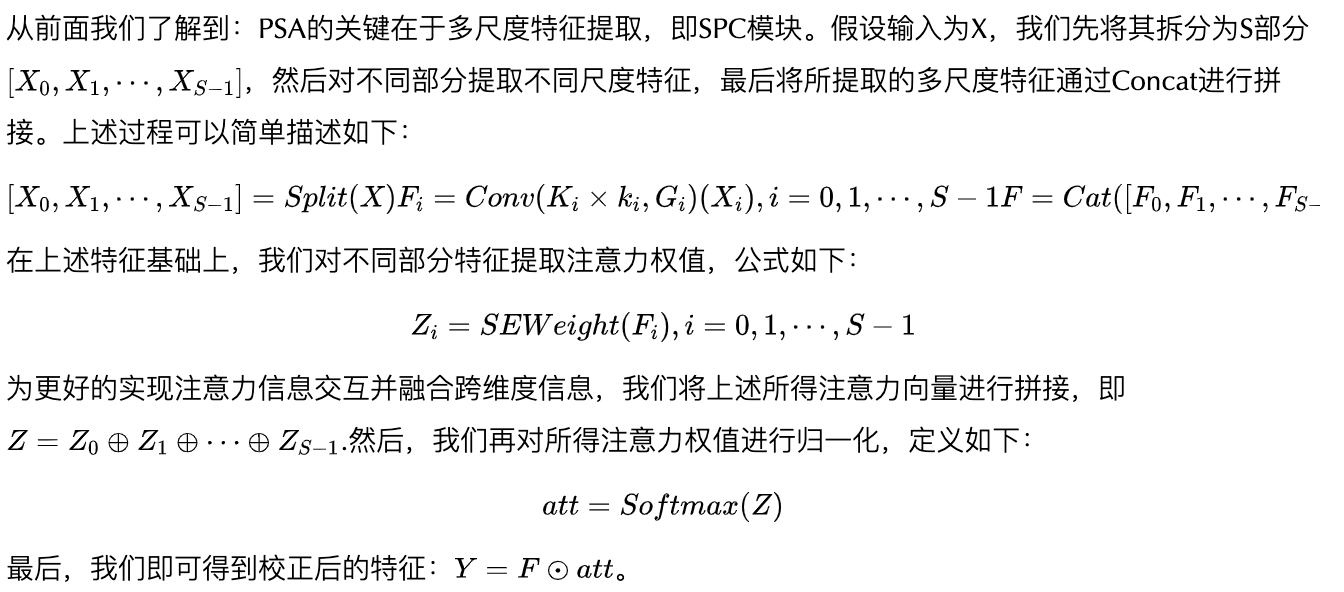

PSA Module

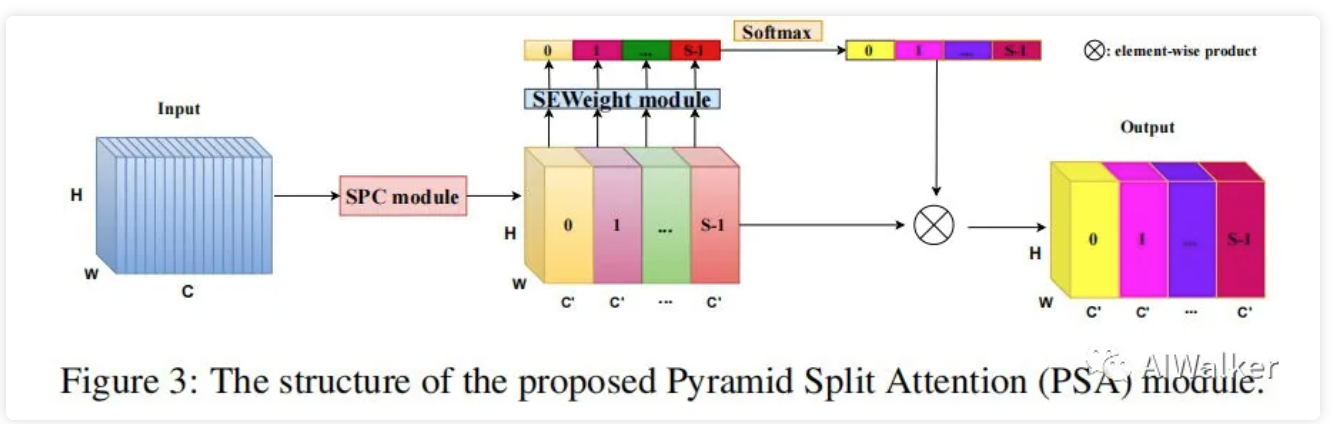

本文旨在构建一种更高效且有效的通道注意力机制,提出了一种新的金字塔拆分注意力模块(Pyramid Split Attention, PSA),见上图。处理流程描述如下:

- 先,我们通过所提SPC(Split and Concat)模块构建多尺度特征;

- 然后,通过SE方式得到通道级注意力向量以提取不同尺度特征;

- 其次,采用Softmax对上述所得通道注意力向量进行重校正;

- 最后,将校正后注意力向量作用于多尺度特征图并将结果作为输出。

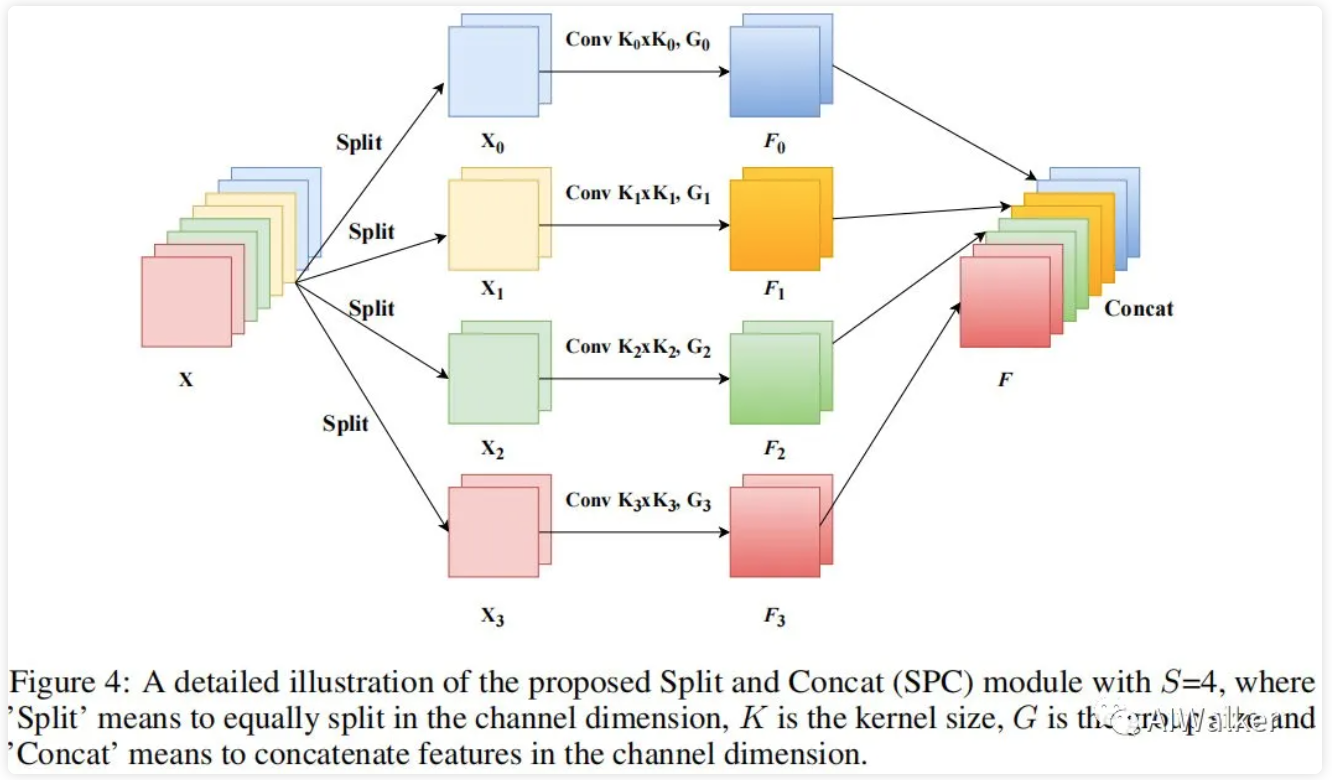

最后所得输出具有丰富的多尺度信息。那么,SPC是个什么鬼呢?看下图。

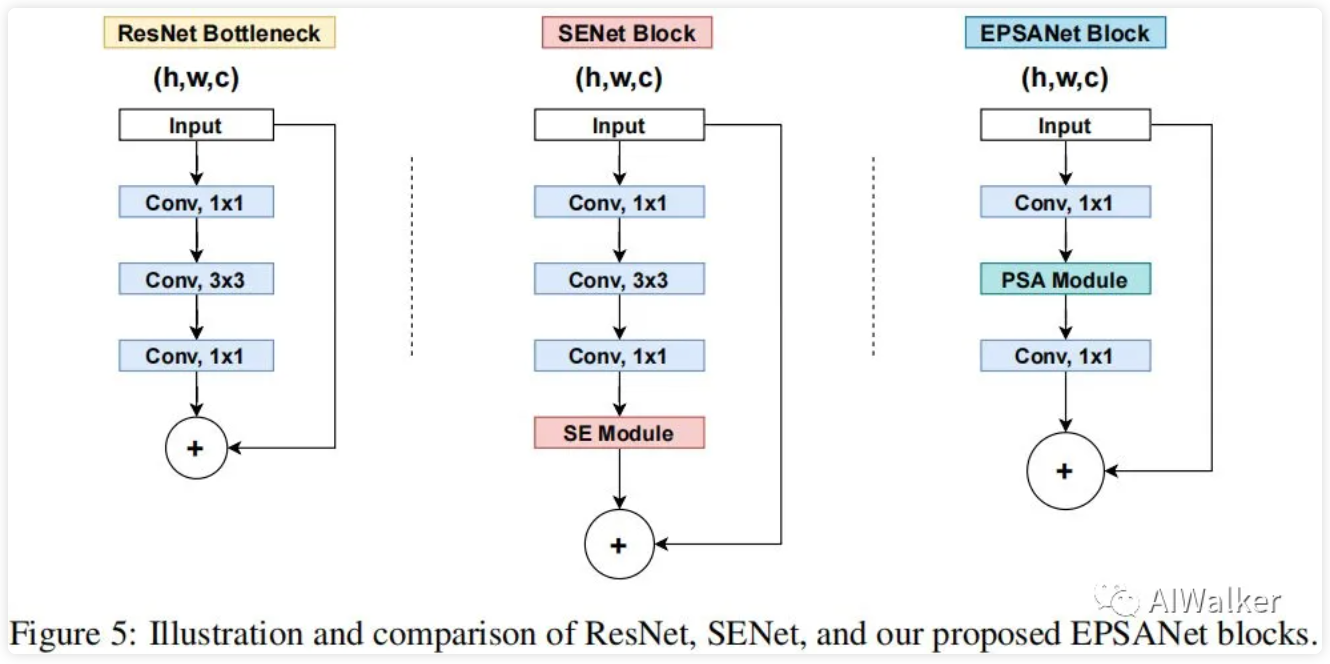

Network Design

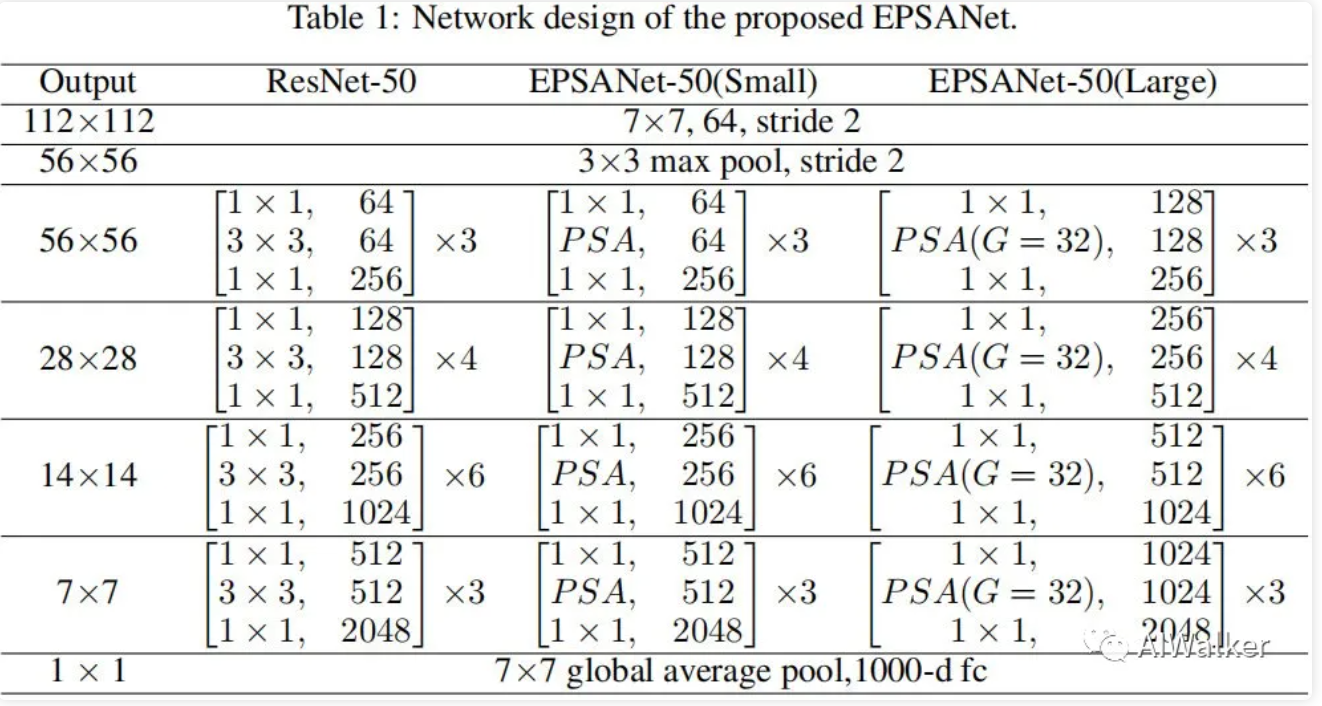

上图给出了所提EPSA模块架构示意图,并将其与SENet、ResNet等进行了对比。EPSANet的网络结构配置信息见下表。

Experiments

Image Classification on ImageNet

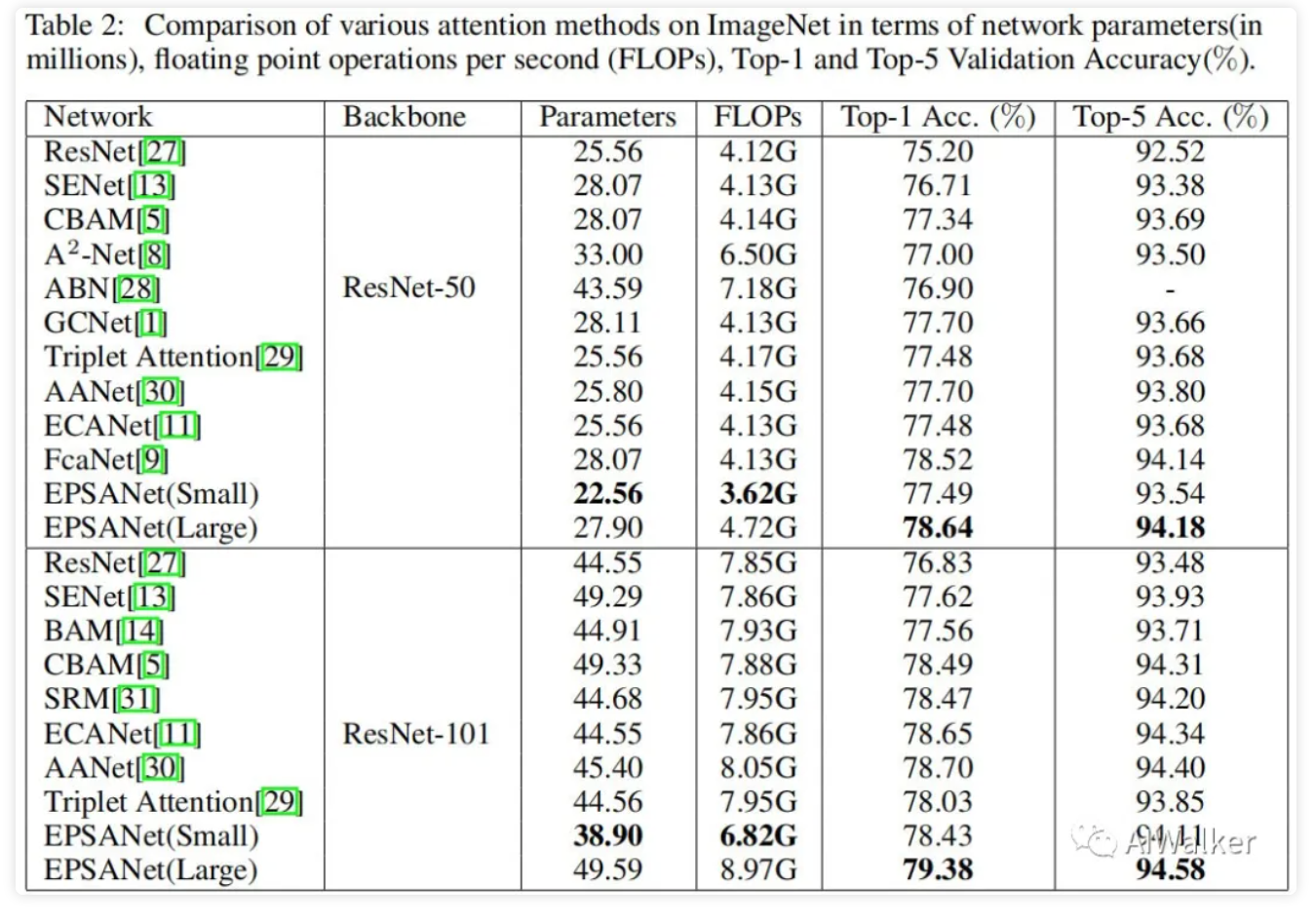

上表给出了ImageNet上的性能对比,从中可以看到:

- 相比ResNet50,EPSANet50-Small取得了2.29%精度提升,且参数量少11.7%,计算量少12.1%;

- 相比SENet101,EPSANet50-Small取得了相当精度,二参数量节省54.2%,计算量节省53.9%;

- 相比ResNet101,SENet101,EPSANet101-Small分别取得了1.6%和0.81%的精度提升,并分别节省12.7%与21.1%的计算资源;

- EPSANet50-Large与EPSANet101-Large分别取得了各自领域的最佳性能。

Object Detection on MS COCO

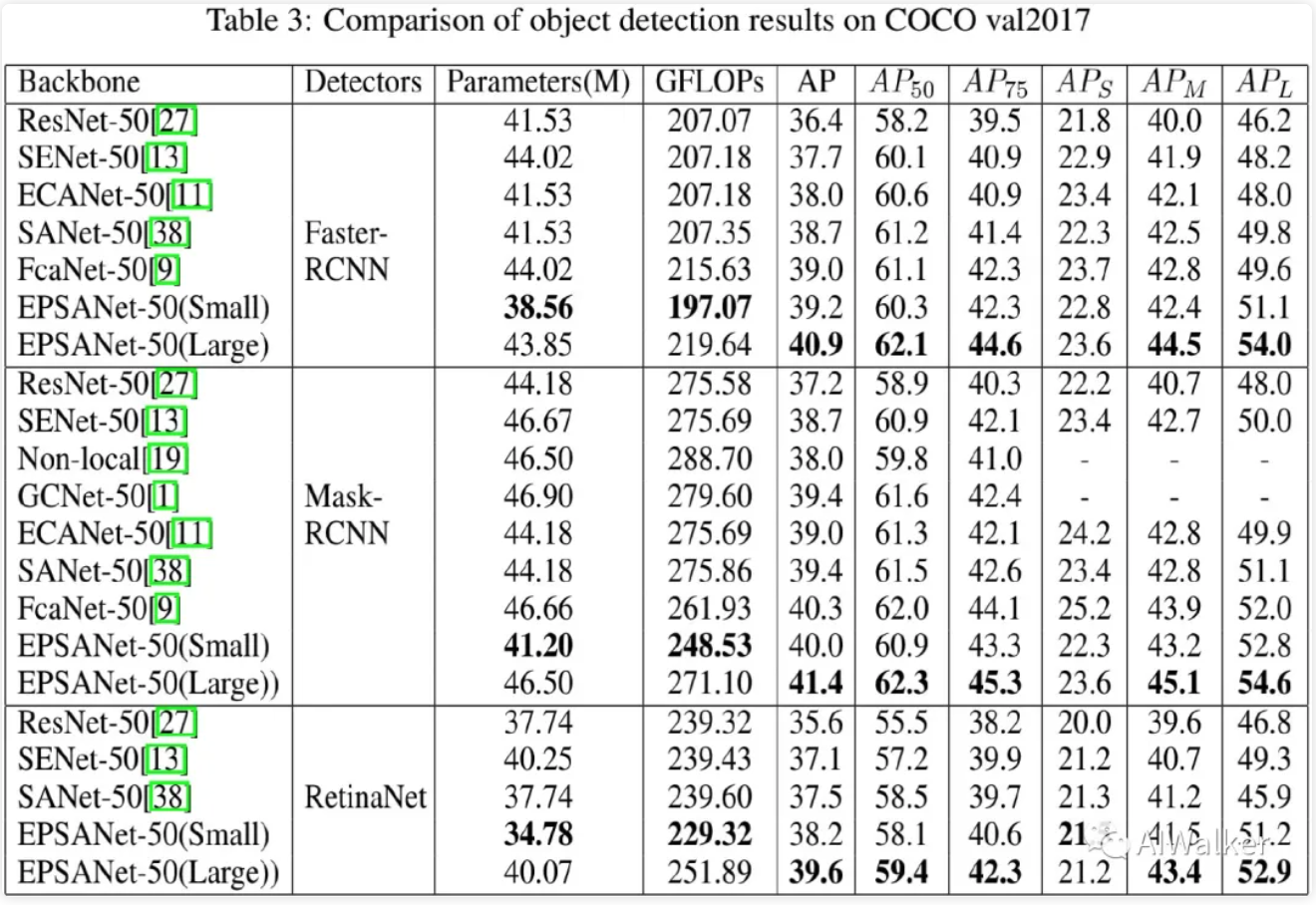

上表给出了不同方案在COCO数据集上目标检测的性能对比,从中可以看到:

- 所提方法取得了最佳检测性能;

- EPSANet50-Small以更少的参数量、更低的计算量超过了SENet50;

- 相比FcaNet,所提EPSANet50-Large取得了更高的AP指标。

- 上述实验结果表明:EPSANet具有很好的泛化性能,可以非常容易应用到其他下游任务。

Instance Segmentation on MS COCO

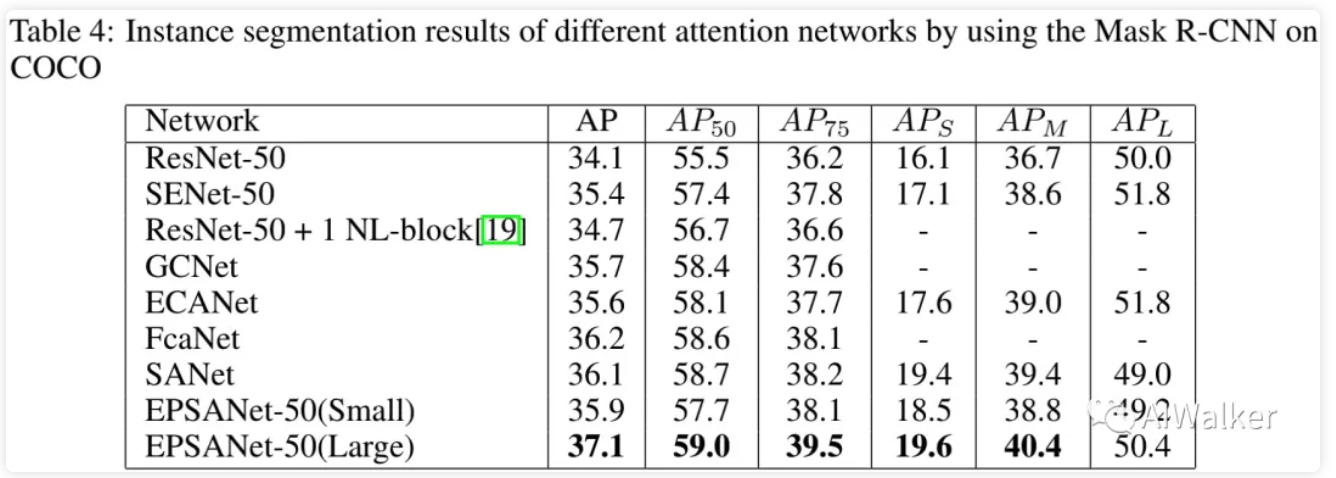

上表给出了COCO数据集上实例分割的性能对比,很明显:

- EPSANet再一次超越了其他注意力方案。

- 相比FcaNet,EPSANet50-Large具有更高的AP指标。

推荐阅读

本文章著作权归作者所有,任何形式的转载都请注明出处。更多动态滤波,图像质量,超分辨相关请关注我的专栏深度学习从入门到精通。