在计算机视觉中,知识蒸馏是一项无损增强模型的技术手段,除了最开始的上游分类任务,近年来也逐步用于重要的下游任务如目标检测当中。而以往的检测蒸馏均依赖强预训练教师网络的知识,我们在现实应用中未必能如期获得这样的教师。因此我们提出了首个用于通用目标检测的自蒸馏框架。

我们的方法受启发于旷视研究院在 ECCV 2020 提出的 LabelEnc[1]方法,它提出了一种基于类标正则化的补充监督方式。本文将以介绍和分析 LabelEnc 方法的一些不足来引出 LGD 方法。

LabelEnc 框架

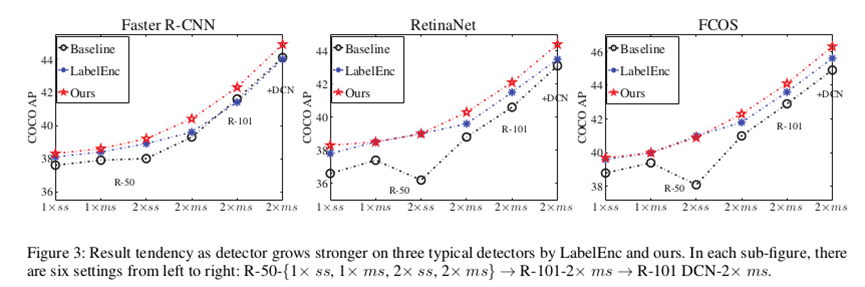

不同于原始的分类问题的标签平滑(label smoothing)[2] 方法,LabelEnc (Hao et al.) 结合检测任务的定位特性,通过把物体标注构造成色块张量,输入到辅助编码网络中获取标签的中间表征。以此表征去监督学生网络的中间表征。虽然效果比较拔群,但我们发现当检测器变得更强 (更大的 backbone,更强的训练增广如多尺度训练)时,LabelEnc 带来的增益开始饱和。如下图所示: 我们在三种经典的目标检测器上做了这种分析。

我们猜想这是由于类标标注本身仅仅是独立地描绘每个物体的位置和类别信息,没有考虑到同样也是很重要的物体间的关系信息 [2]。对于 capacity 比较小的检测器而言,尽管没有关系信息,LabelEnc 方法仍提供了很强的辅助监督信号。而对于本身较强的检测器来说,他们本身就能较易地从标注信息中充分挖掘独立的逐物体监督信号。施加 LabelEnc 增益寥寥,反而可能略微有害 (见上图对 Faster R-CNN 的实验)。这可能归因于 a. 学生网络和 LabelEnc 辅助网络的异构输入(图片 vs. 标注色块)以及 b. 辅助网络和学生网络的独立建模。

LGD: Label-guidedSelf-distillation for Object Detection

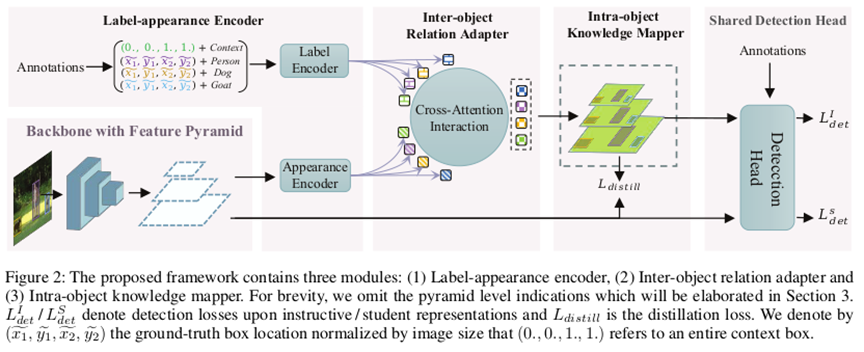

由此启发,我们提出了首个用于通用目标检测的自蒸馏框架,如下图所示:

该框架包含三个模块: 1. 标签与外观编码器 (Label-appearance Encoder);2.物体间关系适配器 (Inter-Object RelationAdapter);3. 物体区域内嵌入映射器(Intra-Object Knowledge Mapper)。

它通过标签与外观编码器获取的跨物体(1) 标签嵌入(label embedding)和 (2) 学生网络特征 (appearance embedding)输入到物体间关系式配器中进行异构模态关系交互。把关系交互之后的嵌入通过物体区域内映射器渲染出具有空间拓扑结构的特征图,作为蒸馏知识。整个过程只需常规监督训练标签。因此被称为标签引导自蒸馏 (Label-GuidedSelf-distillation, LGD)。

LGD 在多种检测器/数据集下均取得明显提升,相比经典预训练教师蒸馏模型FGFI 节省 51%的相对时间(除学生网络固有训练时间), 和 34%的绝对时间,且效果更佳。

来源:旷视研究院

作者:R

专栏文章推荐

欢迎关注旷视研究院极术社区专栏,定期更新最新旷视研究院成果

加入旷视:career@megvii.com