研究动机

光流可以表达视频两帧图像之间的像素级对应关系,它是视频理解和分析领域中的一项基本任务。尽管基于深度学习的方法展示了强大的帧间匹配能力,但现有方法都存在一个明显的问题,即这些方法主要侧重于解决两帧图像的特征之间的匹配相似性,缺乏对给定场景的全局性运动情况进行分析。因此,由运动模糊、遮挡和大运动引起的匹配困难的情况严重影响了当前模型的精度。

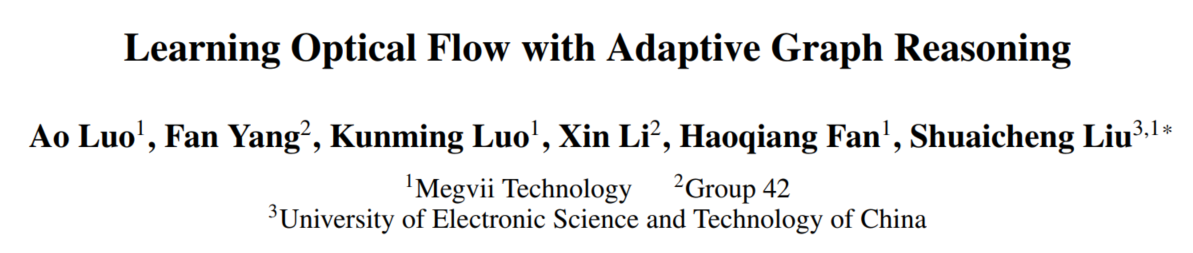

图 1 展示了一组具有强烈运动模糊的困难样本示例,可以明显看出,现有前沿方法 RAFT[1]和 SCV[2]受到运动模糊的严重影响而得到误差较大的光流估计结果。

图1 一组来自 Sintel(finalpass)数据集的具有强烈运动模糊的困难图像示例

仔细分析现在的前沿的光流方法[1,3],它们的成功主要归功于一个重要的模块--四维关系体(4D correlation-volume),用该关系体对帧间图像特征之间的相关性进行建模。此外,为了更好地利用图像场景信息对运动场进行约束,现有方法[1]通过引入额外的卷积分支对场景信息进行编码,再利用简单的级联操作将其融入运动特征进行最终的流场估计。

基于该框架,可以分析现有方法难以得到图像中的全局性运动情况的原因:

第一,现有的方法仅通过简单的操作(例如特征叠加)来使用场景信息,并没有显式建模此类过程的方法;

第二,它们的操作都受限于原始坐标(网格)空间和卷积的局部操作,不但需要依赖大量的计算资源来获得足够的感受野,并且缺乏对给定场景的全局情况进行分析;

第三,它们忽略了“域差异”带来的影响,即场景内容特征(context feature)和运动特征(motion feature)之间的差异。

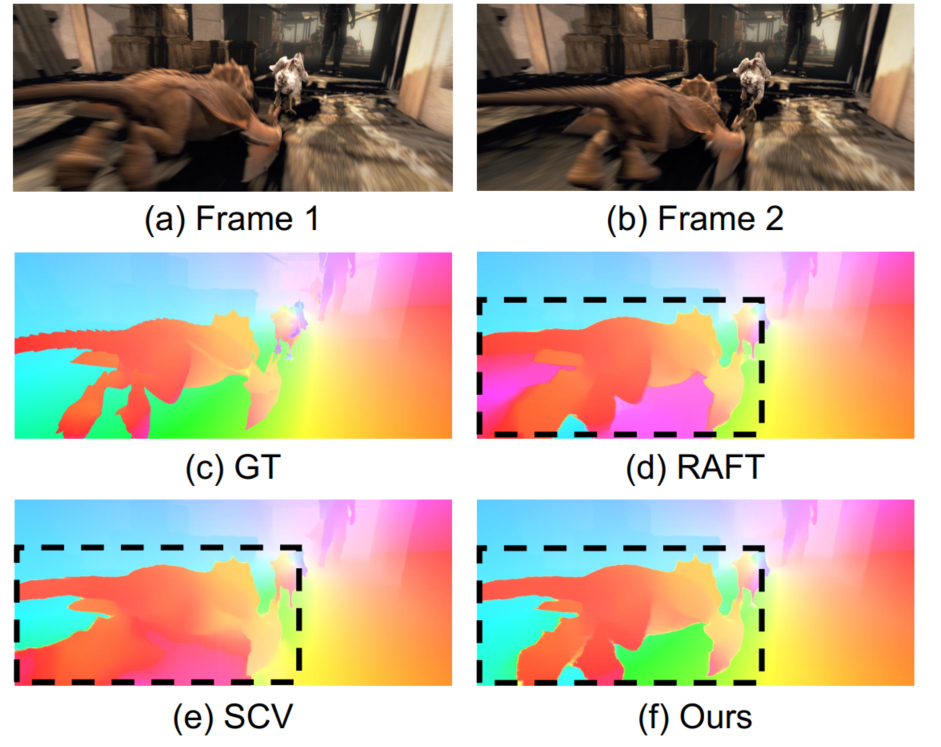

为了解决以上问题,本文提出了一种新的基于图模型的方法,即自适应图推理光流模型(AGFlow),如图 2 所示,将图模型技术融入到光流估计网络中,以实现有效的场景内容特征推理和运动特征交互,从而降低了模糊匹配的不确定性对光流估计的影响。

图2 本文提出的自适应图推理光流模型的整体框架

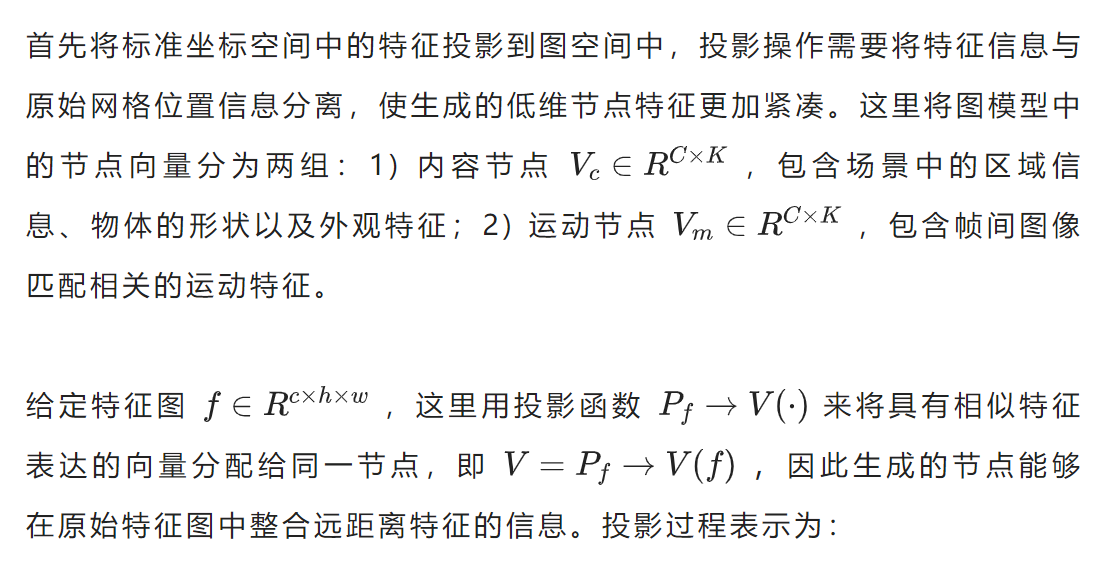

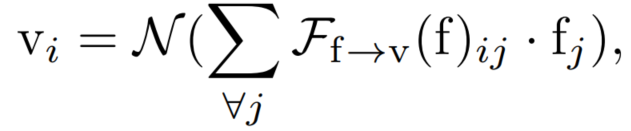

节点生成

自适应图推理

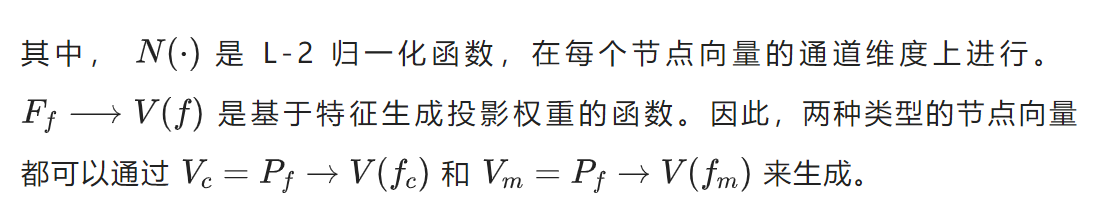

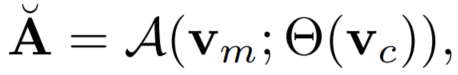

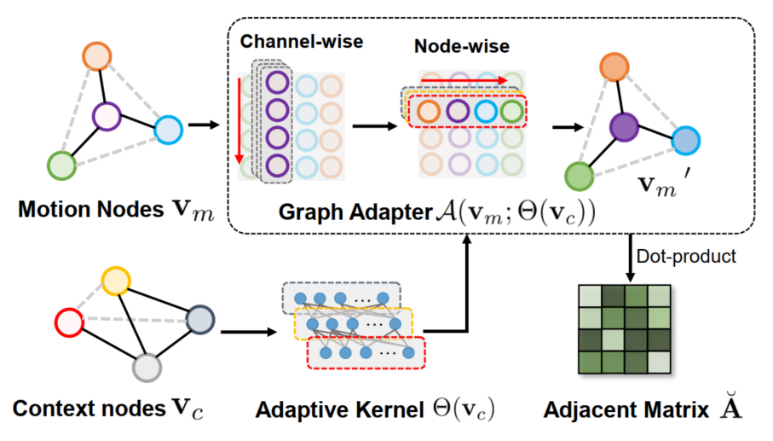

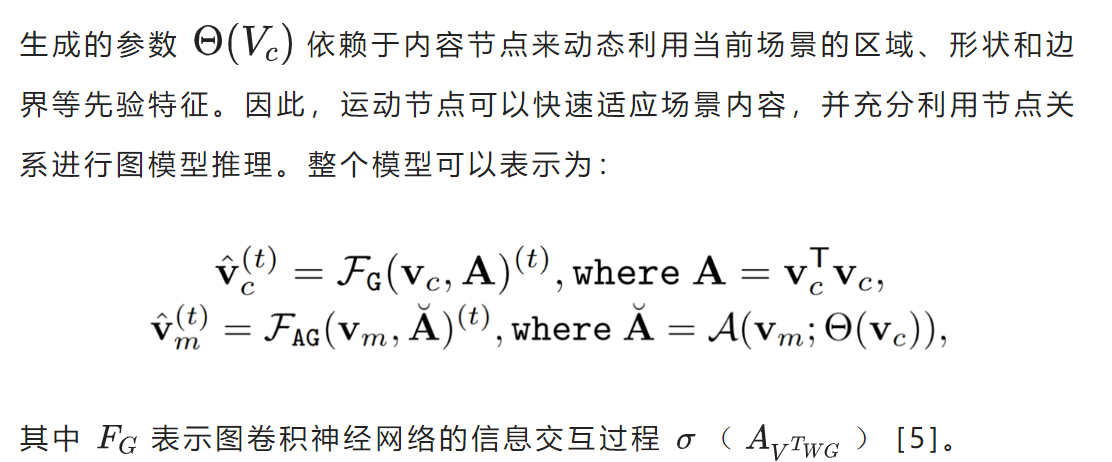

首先从特征属性角度分析场景内容节点和运动节点的差异。运动节点主要对帧间图像之间的像素级对应关系进行编码,而忽略在两帧中对各自图像像素之间的内部关系进行分析;相反,场景内容节点只捕捉形状和区域边界的判别性特征。因此,这里需要解决两个困难:1) 场景内容和运动节点之间不可避免地存在特征表达的差异,这可能会阻碍直接进行全局性图模型推理的有效信息传递;2) 运动节点缺乏对潜在位移场的形状或分布的约束,因此其节点特征之间无法产生足够的信息来支撑准确的特征交互。

本文提出自适应图推理模块来解决这些问题,其核心思想是利用全局环境中的形状和区域的判别性特征表达来引导具有自适应参数的动态邻域矩阵的学习。本文参考引导学习[4]的方法,设计了一种学习邻域矩阵的自适应过程,可以根据当前图像特定的场景内容来预测动态参数并进行运动关系建模。自适应邻域矩阵可以表示为:

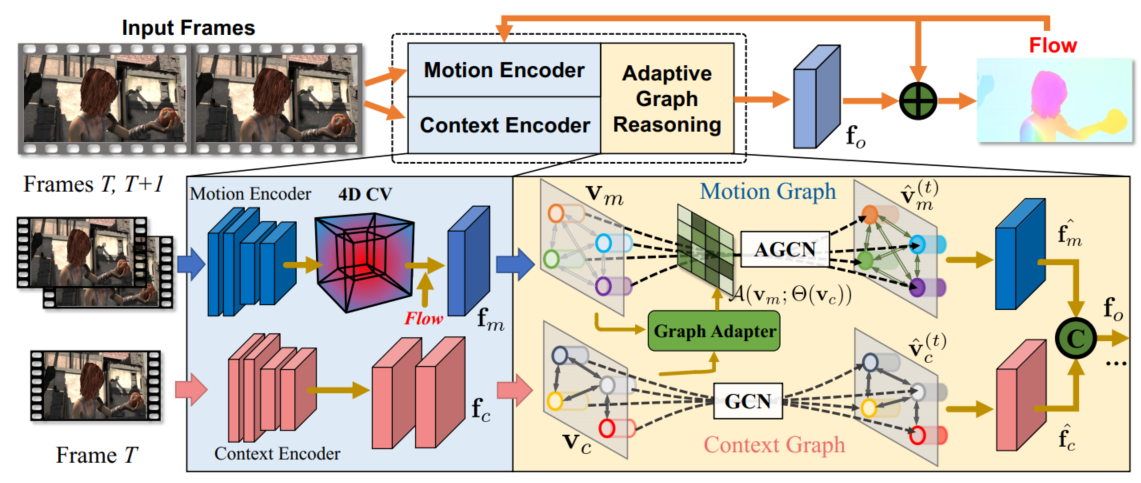

图3 自适应图推理中的图适应模块

实验分析

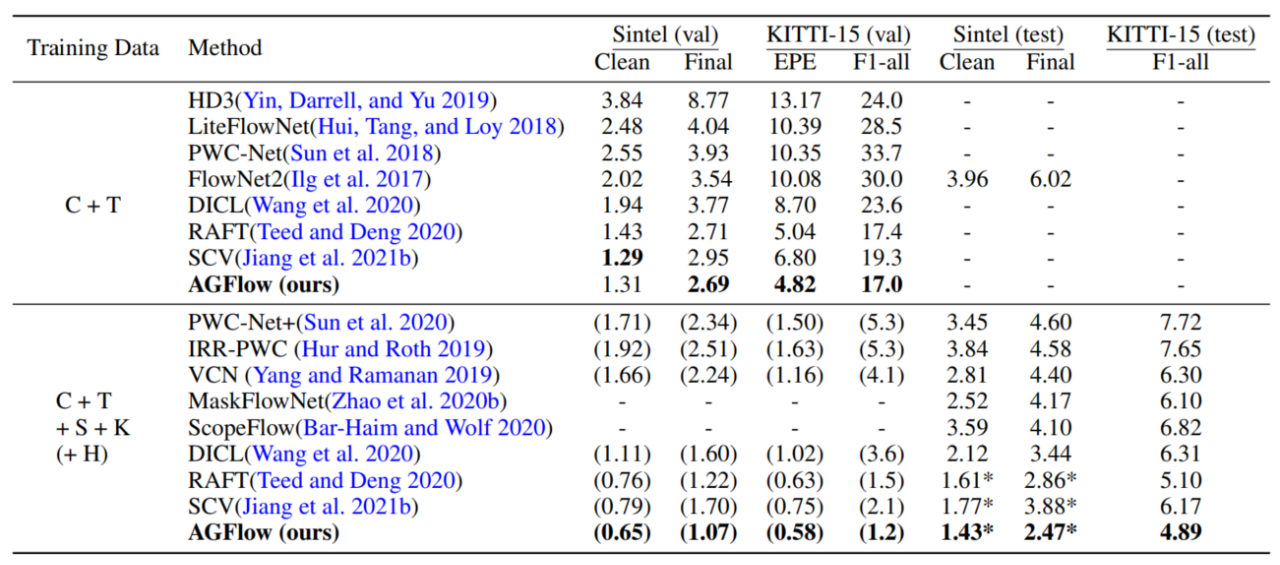

图4 本文方法与前沿方法在光流估计标准数据集上的对比

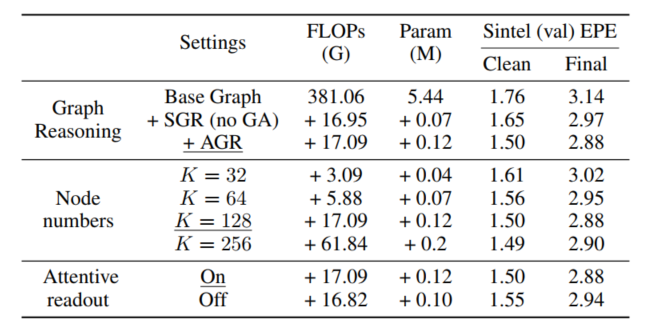

本文提出方法与前沿方法在光流估计标准数据集上的对比如图 4 所示,AGFlow 在 Sintelclean pass 上可以达到 1.43 EPE 的效果,在 finalpass 上创造了 2.47 EPE 的新记录,分别比之前的最好结果提高 11.2%和 13.6%。在 KITTI2015 测试集上,AGFlow 实现了 4.89% F1-all 的最好效果,分别比之前的方法 SCV 和 RAFT 高出 20.7%和 4.1%。更多的消融实验如图 5 所示。

图5 自适应图推理的模块消去实验

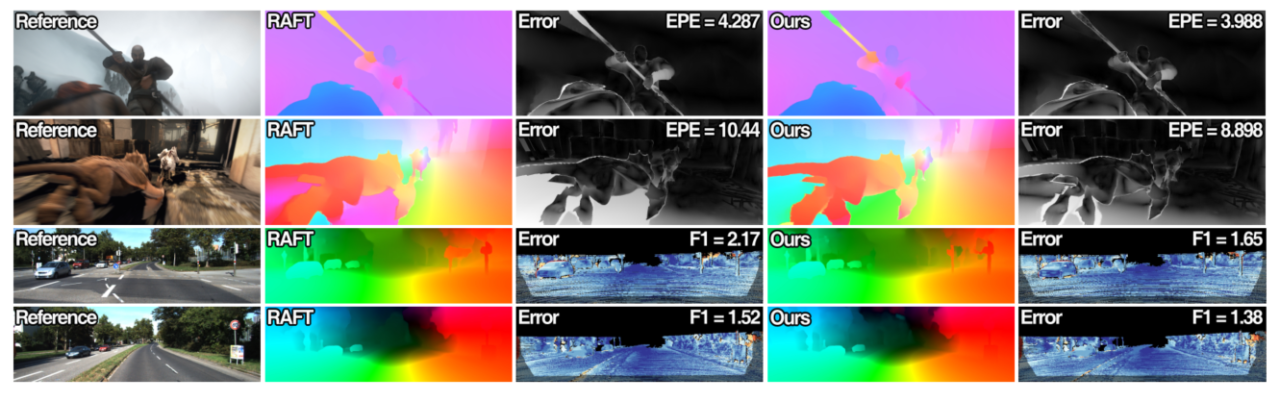

图 6 展示了 AGFlow 与 RAFT[1]在充满挑战的 Sintelfinal pass 和 KITTI 数据集上的定性对比结果,可视化结果表明了本文方法能够充分利用场景内容信息,有效地利用形状和区域约束等信息来辅助运动估计,从而得到更精确的流场和清晰的运动边界。

图6 本文方法与 RAFT 在光流估计标准数据测试集上的可视化结果对比

总结

1.本文提出第一个使用图模型技术来显式利用场景内容信息辅助光流估计的模型,它可以打破图像常规网格结构的限制来进行图空间上的信息交互,以实现更好的全局性运动理解;

2.本文设计的图适应模块可以充分利用场景内容特征,以学习适应机制来引导全局运动信息在图模型中进行信息交互;

3.AGFlow 在Sintel 和 KITTI 基准上以明显的优势超过了前沿方法。

来源:旷视研究院

作者:R

专栏文章推荐

欢迎关注旷视研究院极术社区专栏,定期更新最新旷视研究院成果

加入旷视:career@megvii.com