近日,计算机视觉国际顶级会议 CVPR 的 AI City Challenge 挑战赛(以下简称 AICity)落下帷幕,来自旷视研究院的代表队荣获 Tracked-Vehicle Retrieval by Natural Language Descriptions 赛道冠军。AICity 由 NVIDIA 公司主办,先前已成功举办过五届,AICity 旨在利用 AI 技术来提升城市空间的运营效率。第六届 AICity 挑战赛主要关注计算机视觉和人工智能交叉领域两个具有巨大潜力的问题 - 智能交通系统 (ITS) 和实体零售业务。

1 赛题介绍

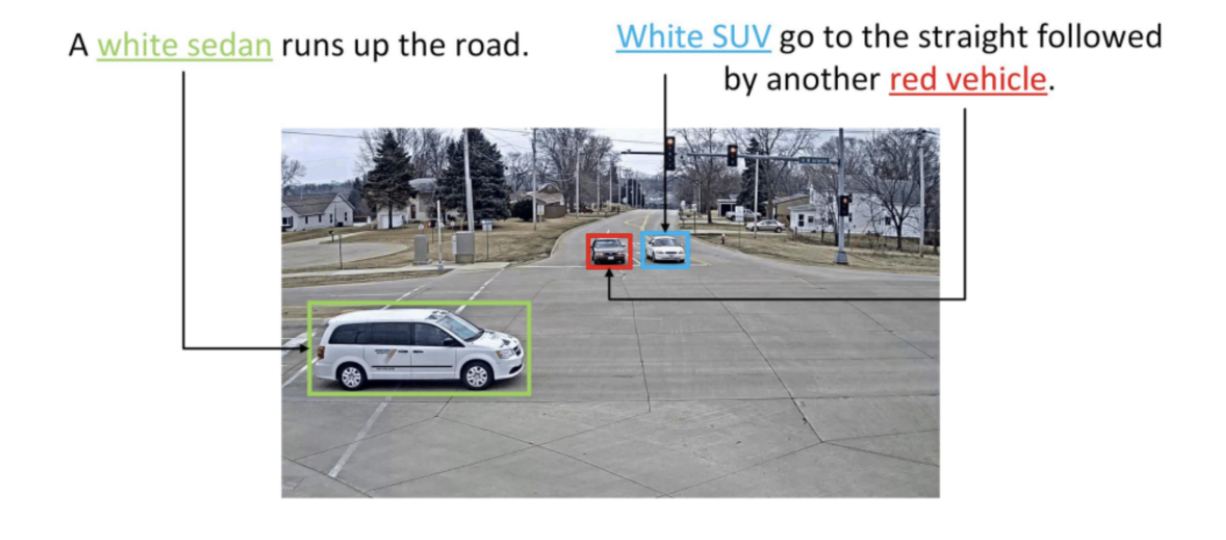

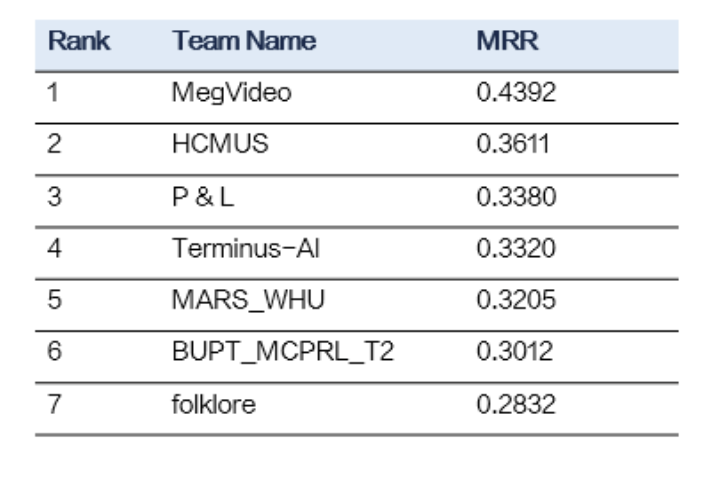

自然语言描述也是一种有效的车辆检索特征。对于给定的目标车辆,本赛道提供了车辆的轨迹视频以及描述了该车辆轨迹的动态属性(运动方向、和其他车辆与环境的关系)和静态属性(车辆的大小、颜色和类型)的自然语言描述。参赛团队要使用这些数据训练一个基于文本的车辆轨迹检索系统。主办方将根据各队伍提交算法的 MRR (Mean Reciprocal Rank) 进行排名。

2 旷视夺冠算法介绍

旷视研究院参赛团队针对赛题的特点,在数据增强、多模态表征学习、空间关联建模方面进行创新和改进,最终取得了本赛道的冠军[1]。

在数据增强方面,我们分别对提供的图像数据和文本数据进行了增强。通过将不同帧的车辆图片拷贝到背景图片上,并通过计算连续图片之间的 IoU 来过滤重合度高的图片,我们将视频处理问题转化为了图像处理问题。

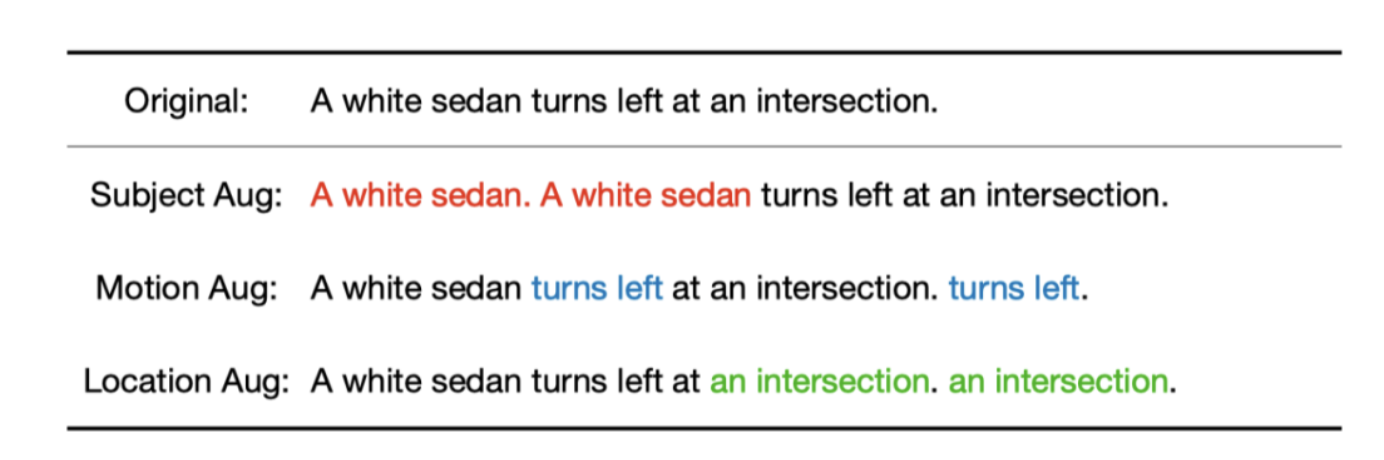

在文本特征方面,通过对文本对语法分析,我们使用主语强调、运动特征强调、地点特征强调等方式来增加这些文本的重要性。

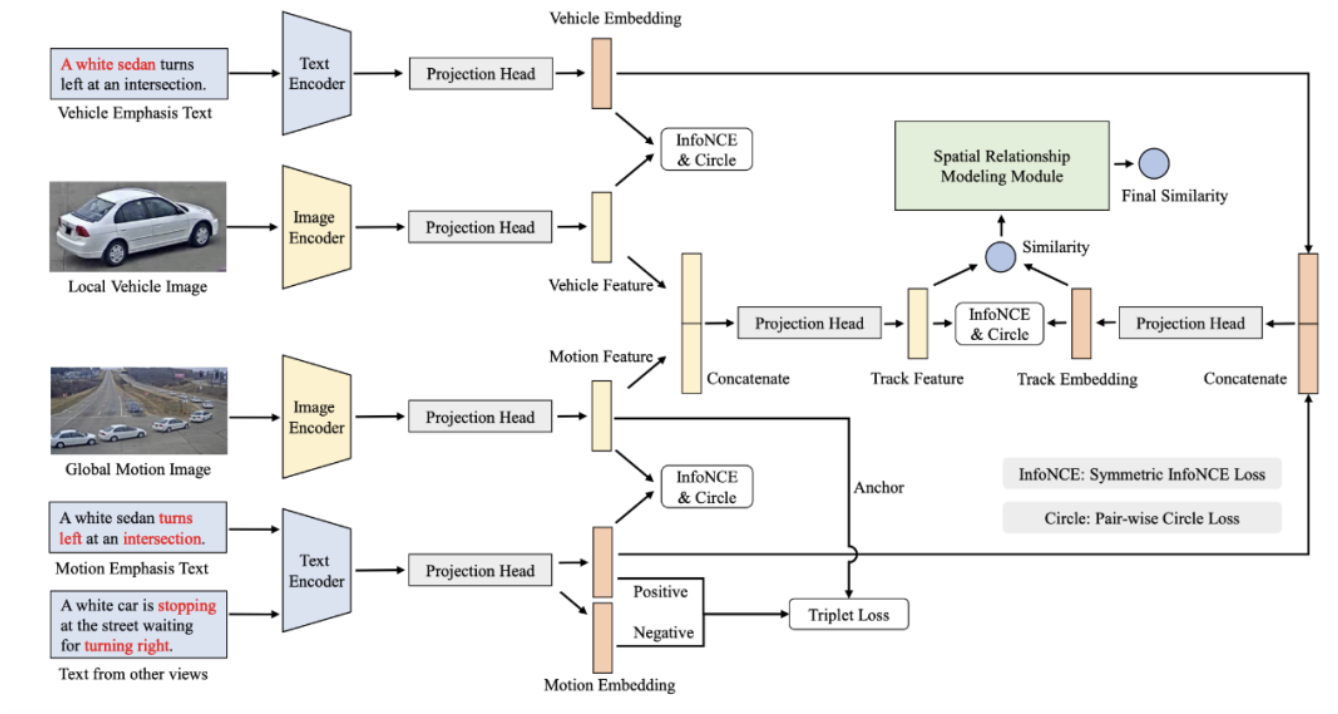

在表征学习上,我们使用对称网络来学习不同模态的特征。我们的网络由四个分支组成,两个分支用来提取文本特征,两个分支用来提取视觉特征。为了使最终学习到的特征可以同时关注到局部和全局信息,视觉分支的输入分别是车辆图片和增强后的轨迹图,文本分支的输入分别是描述车辆静态特征的文本和增强后的文本。在损失函数方面,我们分别采用 InfoNCE Loss[2] 和 Circle Loss[3] 来融合视觉和文本特征。

除此之外,我们提出了空间关联建模方法来进一步规约相似的视觉和文本特征,长距离关系建模 (Long-distance Relationship Modeling) 旨在根据文本和图像的位置关系增大同一地点的特征之间的相似度。短距离关系建模 (Short-distance Relationship Modeling) 旨在利用文本中的多车辆关联信息,提升与相似图像之间的相似度。

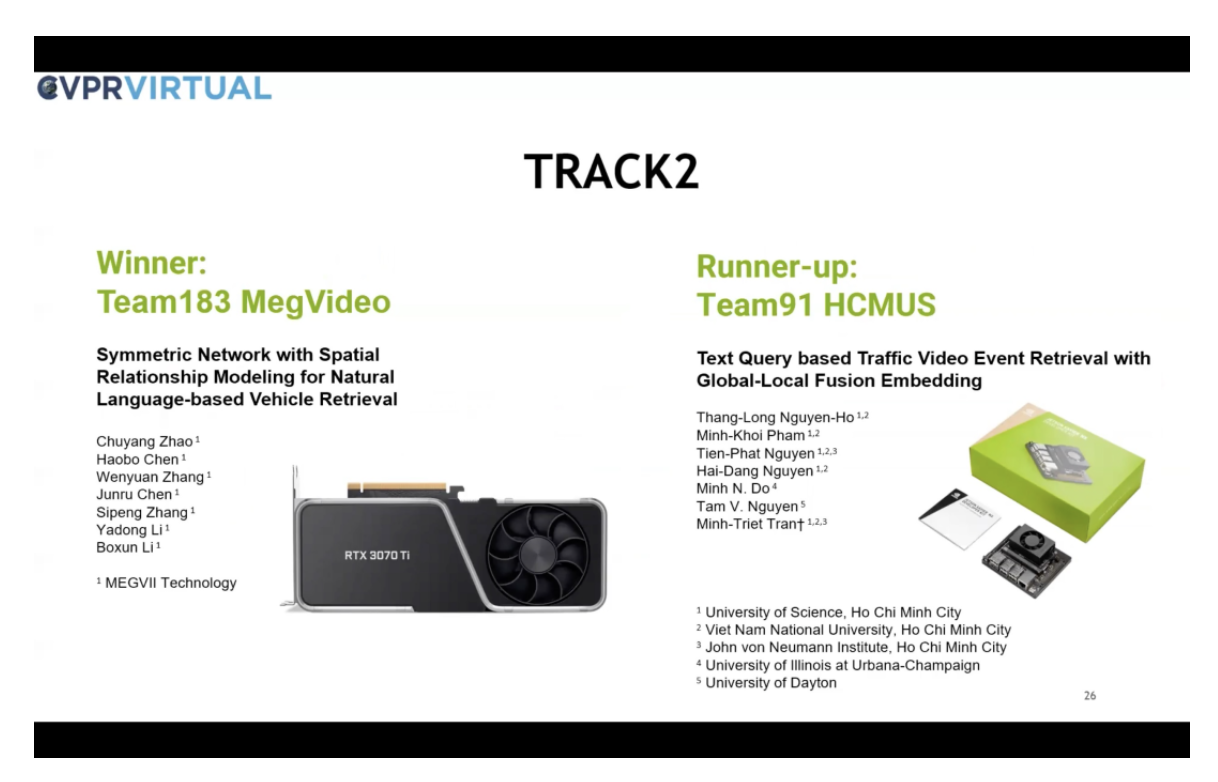

我们的算法可以有效提升基于文本的车辆检索系统的准确率和召回率,在官方公布的 CityFlow-NL[4] 数据集上取得了 0.4392 的 MRR,远远领先第二名的成绩。

来源:旷视研究院

作者:旷视研究院

专栏文章推荐

- MegEngine Inference 卷积优化之 Im2col 和 winograd 优化

- 旷视研究院荣获 CVPR 2022 NTIRE RAW 图像多帧超分-真实世界数据赛道比赛第一!

- 技术的真相 | 机器学习在仓库控制中的探索:以某场景的排序问题为例

- MegPeak——让你更懂你的处理器

欢迎关注旷视研究院极术社区专栏,定期更新最新旷视研究院成果。欢迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。

加入旷视:career@megvii.com