Title: SNet: Multi-scale in Multi-scale Subtraction Network for Medical Image Segmentation

Paper: https://arxiv.org/pdf/2303.10894.pdf

Code: https://github.com/Xiaoqi-Zhao-DLUT/MSNet

导读

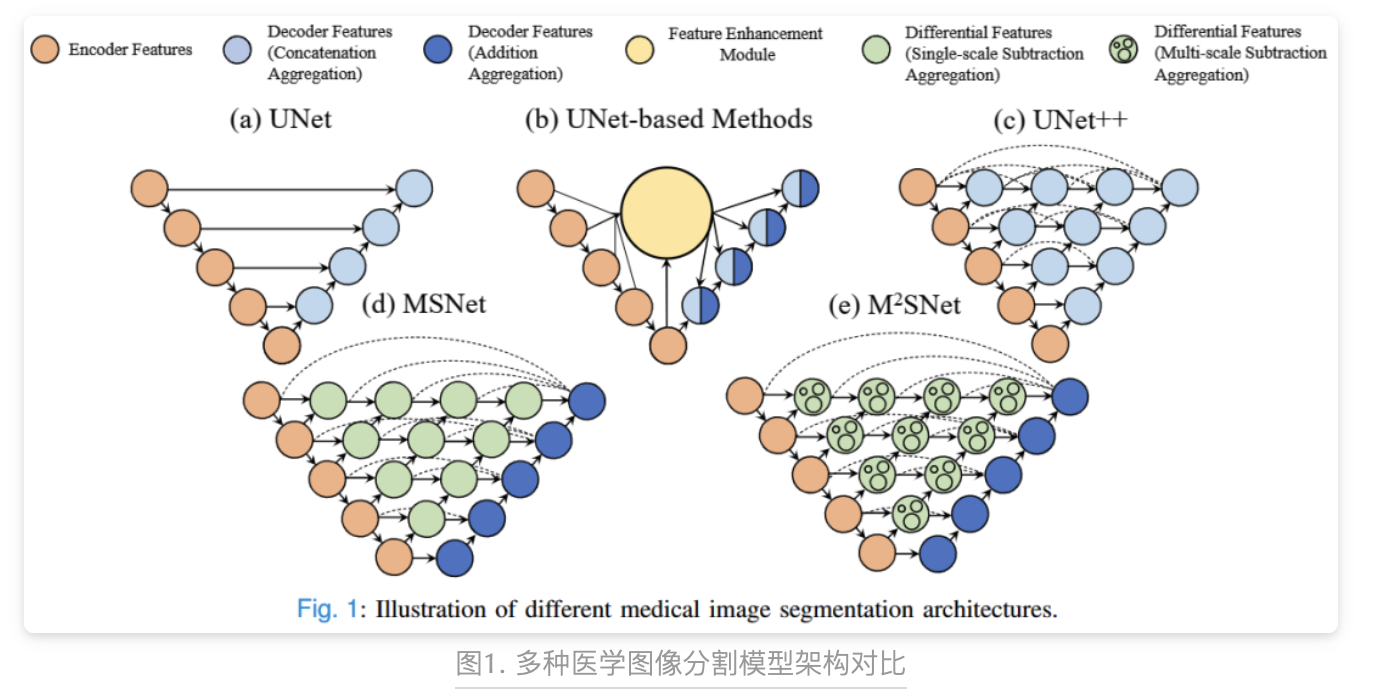

医学图像分割领域的著名网络 U-Net,相信大家没用过也听说过。这是 2015 年提出来网络,其基于 U 型结构,并使用相加或拼接的方式,逐步融合解码器中不同级别特征,直到现在依然有许多工作都是这种结构进行改进创新。

然而,这两种操作容易生成大量冗余信息,这将削弱不同级别特征之间的互补性,导致很难准确地定位病变目标以及导致病变目标的边缘模糊。

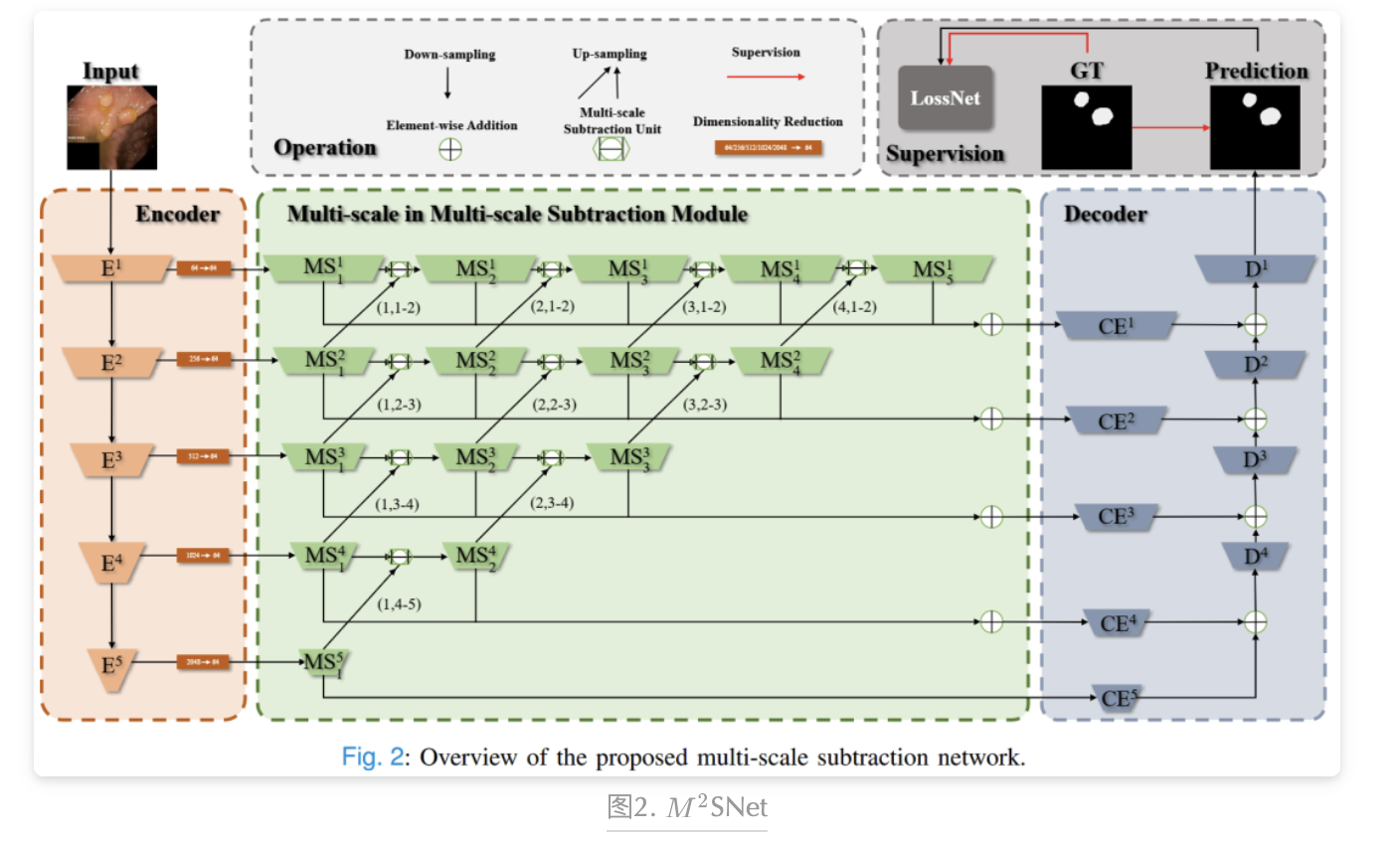

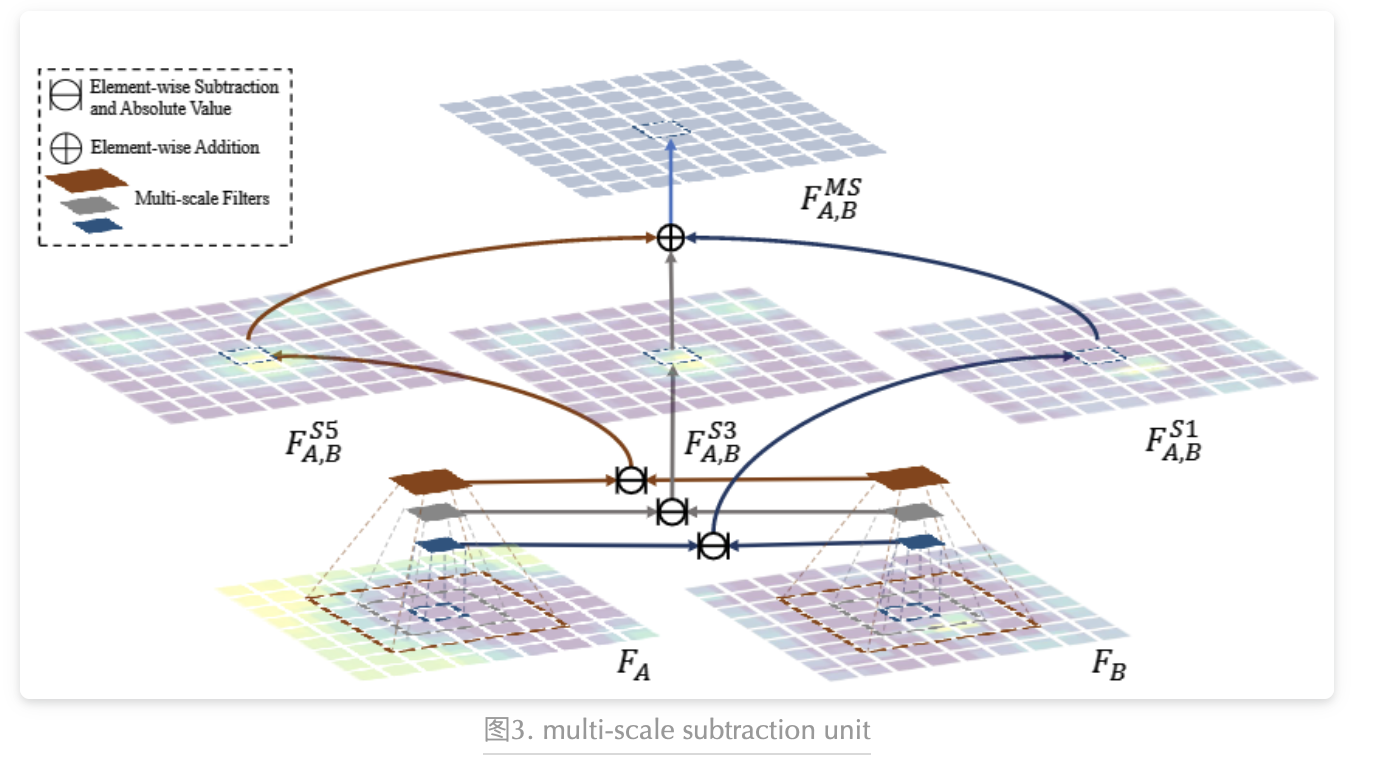

针对上述的难点,本文介绍了一种针对医学图像的多尺度减法网络(multi-scale subtraction network, M2SNet),旨在解决现有方法在融合不同级别特征时产生冗余信息的问题,从而导致病灶定位不准确和边缘模糊的情况。

本文设计了基本的减法单元 (subtraction unit, SU) 来产生编码器中相邻级别之间的差异特征,并将单一尺度的 SU 扩展到内层多尺度 SU ,提供像素级和结构级别的差异信息给解码器。此外,还使用具有不同感受野的金字塔多尺度 SU 在不同级别上进行特征聚合,从而获得丰富的多尺度差异信息。最后,构建了一个无需训练的网络 LossNet,从底层到顶层全面监督任务感知特征,从而驱动多尺度减法网络同时捕捉详细和结构性提示。该方法在不同的评估指标下,在包括彩色结肠镜成像、超声成像、计算机断层扫描 (CT) 和光学相干断层扫描 (OCT) 在内的四种不同医学图像分割任务的十一个数据集上获得了惊艳的性能表现。

创作背景

文章列举了医学图像分割的三大挑战:

U 形网络结构

UNet、UNet++、attention U-Net

直接使用元素加法或拼接来融合来自编码器的不同层级特征,没有更多地关注不同层级之间的差异性信息,导致生成冗余信息并削弱了层级特征的特点,从而无法平衡精确的定位和微妙的边界细化。

感受野受限

单一尺度的卷积核难以捕捉大小不同的物体的上下文信息。虽然 ASPP、DenseASPP 等多尺度模块能提取多尺度信息,但同时也会产生许多额外的参数与计算量。

手工设计损失函数的局限性

L1 loss、CE loss、SSIM loss

虽然这些基本的损失函数及其变体具有不同的优化特性,但是设计复杂的数学形式对于许多研究来说真的很耗时。

为了解决上述问题,本文提出了一种新的多尺度减法网络 用于医学图像分割:

- 采用了减法聚合的方法代替传统的加法或串联特征融合,从而提高了特征的有效性和鲁棒性。减法聚合通过对相邻层特征进行差分运算,突出有用的差异信息并消除冗余部分的干扰。

- 采用了多尺度信息提取的策略,通过金字塔式地连接多个减法单元以获取跨层级别的信息,实现了全方位的多尺度信息互补。此外,通过改进单尺度减法单元,使用具有不同卷积核大小的一组滤波器来实现自然的多尺度减法聚合。

- 提出了一种名为

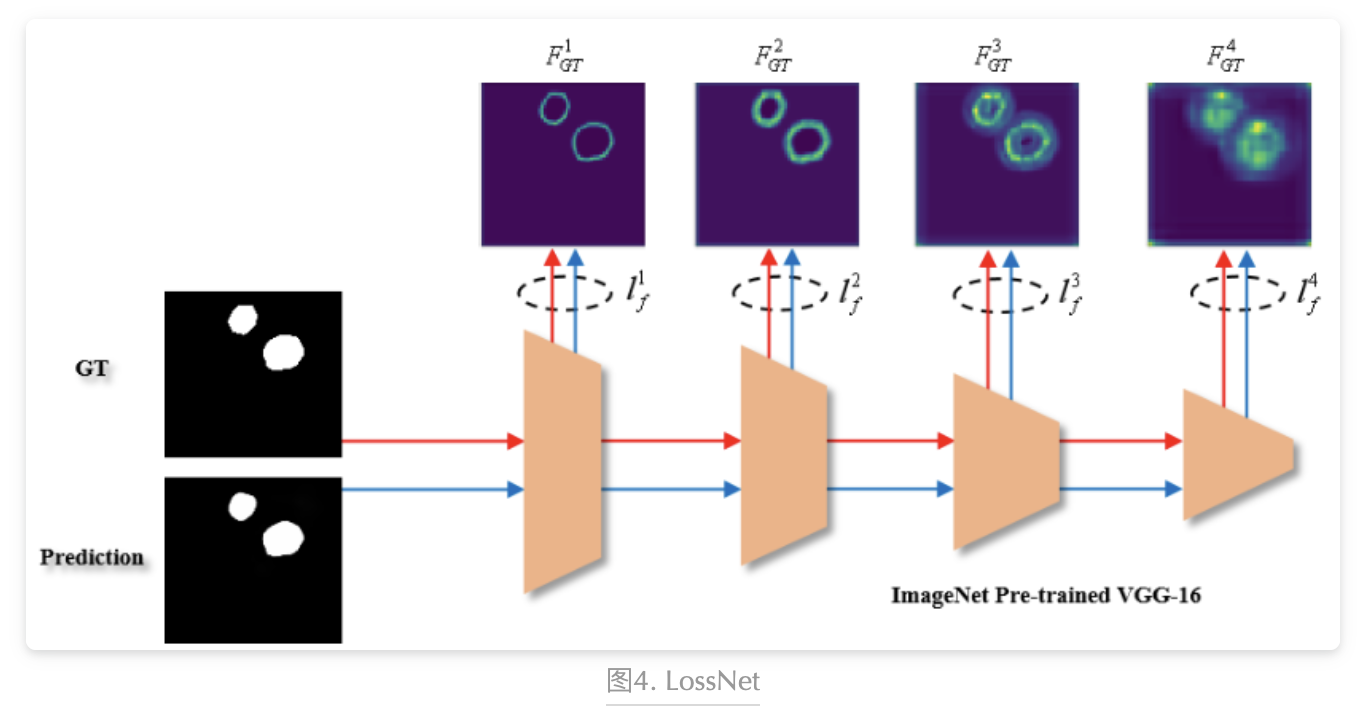

LossNet的智能损失函数,能够从细节到结构地优化特征图的分割结果,提高了分割精度。同时,LossNet的设计简单且通用,无需复杂的手动数学形式,降低了研究人员的训练难度。

最后,本文还通过四个医学图像分割任务的实验验证了 的有效性,分别是息肉分割、乳腺癌分割、COVID-19 肺感染和 OCT 层分割。此外, 还在 MICCAI 2022 GOALS 国际眼科挑战赛中获得了第二名的好成绩。

方法

概述

多尺度减法模块

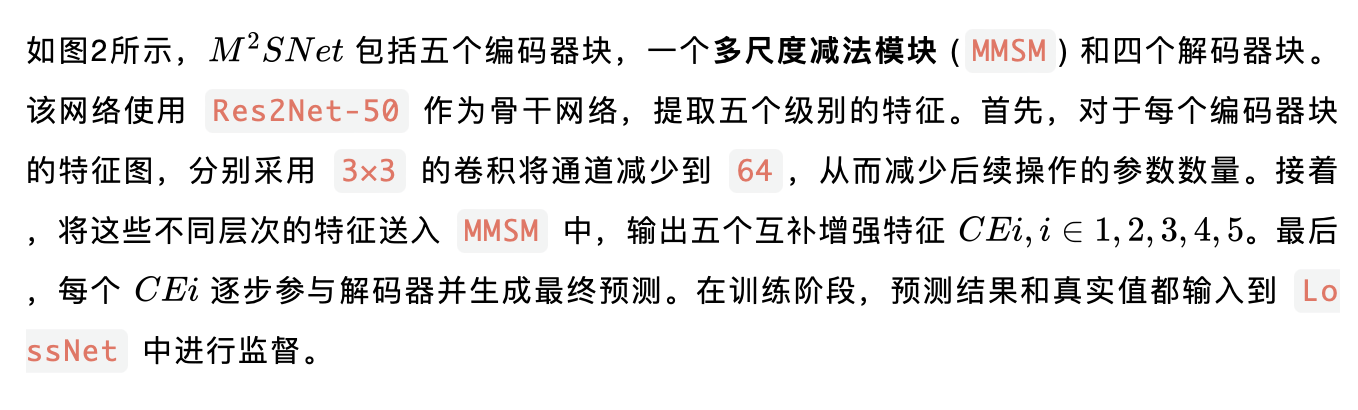

的关键在于多尺度子网和多尺度差分模块,它们能够更好地捕捉初始特征图之间的差异信息,从而提高分割精度。

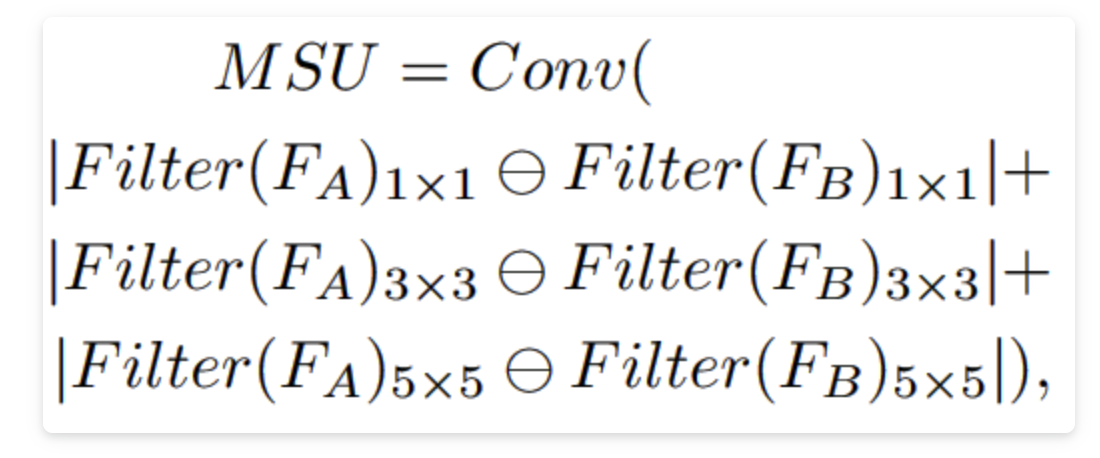

在多尺度差分模块中,本文采用了多尺度卷积滤波器,包括大小为 1×1、3×3 和 5×5 的固定全一权重滤波器。这些滤波器用于计算像素对和区域对的详细结构差异值,能够更好地捕捉结肠息肉的区域特征。与单一尺度的差分模块相比,多尺度差分模块能够提取更多的信息,从而提高模型的准确性。

另外,多尺度子网能够提取高阶互补信息,进一步提高模型的精度。具体来说,首先水平和垂直地连接了多个多尺度差分模块,用于计算具有不同顺序和感受野的一系列差分特征。然后,对每个尺度的特征进行汇聚,生成互补增强特征,最终用于解码和结肠息肉区域的分割。

智能损失函数

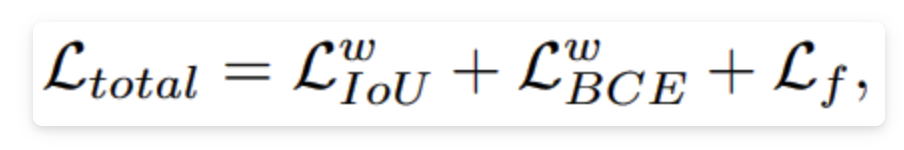

本文设计了一个总训练损失函数,包括加权的 IoU loss 和 BCE loss,以及一个称为 LossNet 的网络来进一步优化分割细节和结构。

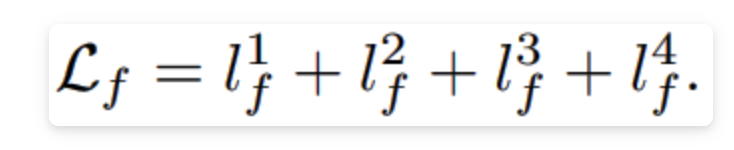

其中,IoU loss 和 BCE loss 在分割任务中被广泛采用并已被验证有效。LossNet 使用一个 ImageNet 预训练分类网络(如VGG-16)提取预测和实际值的多尺度特征,并计算它们之间的特征差异作为损失函数Lf 。

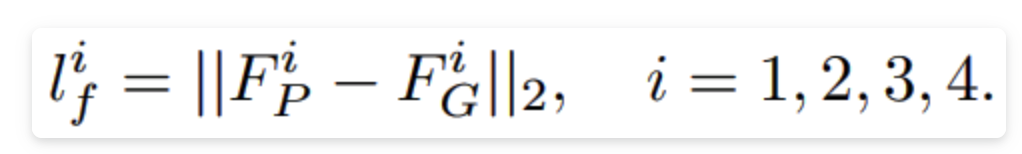

损失 通过像素级别的欧几里得距离 L2 loss 进行监督。该模型可以在特征级别生成全面的监督,低级特征图包含丰富的边界信息,而高级特征图则描绘位置信息。

实验

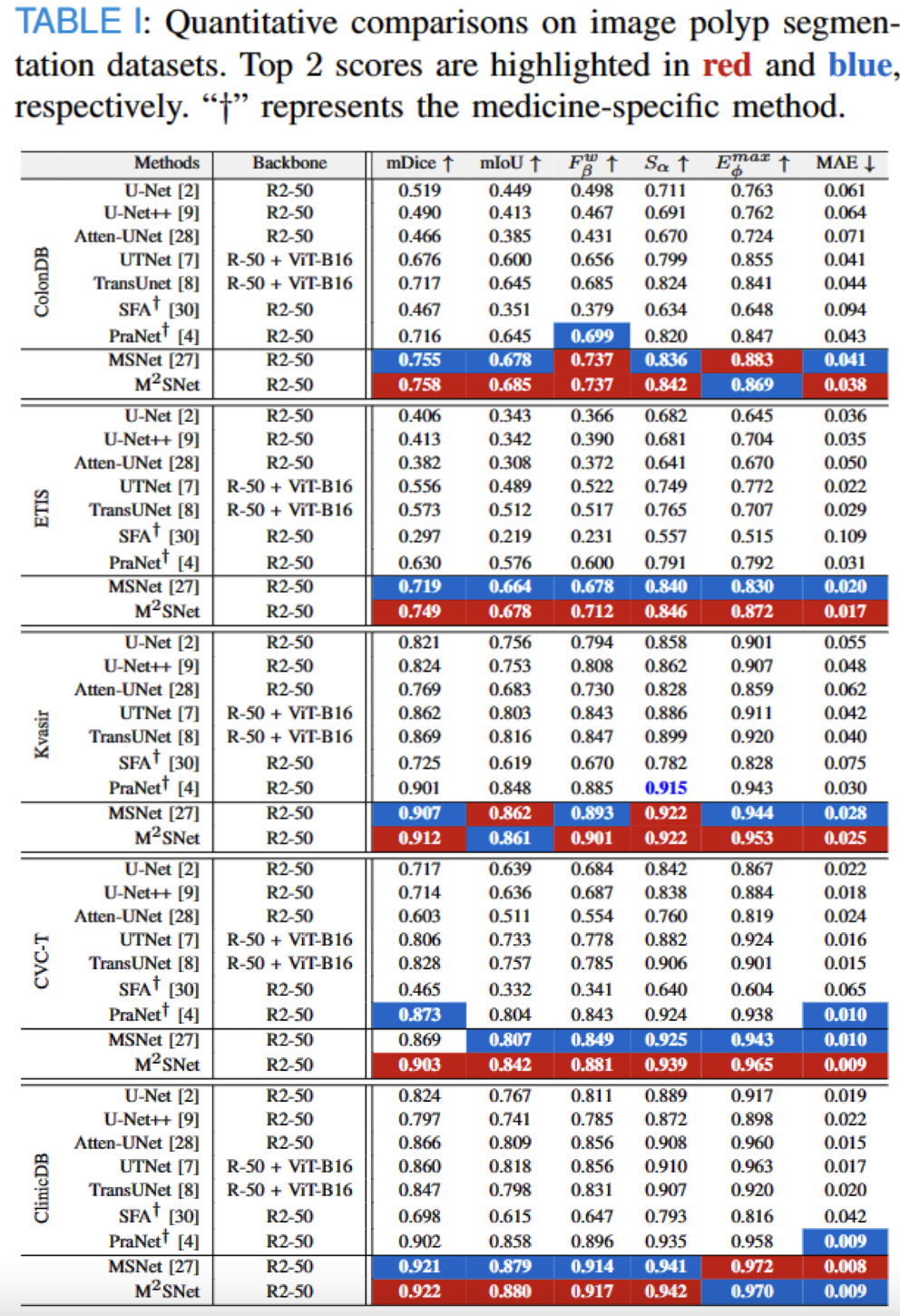

在5个息肉数据集上与其他 SOTA 方法对比,SNet在关键指标 mDice 上均获得了第一名。

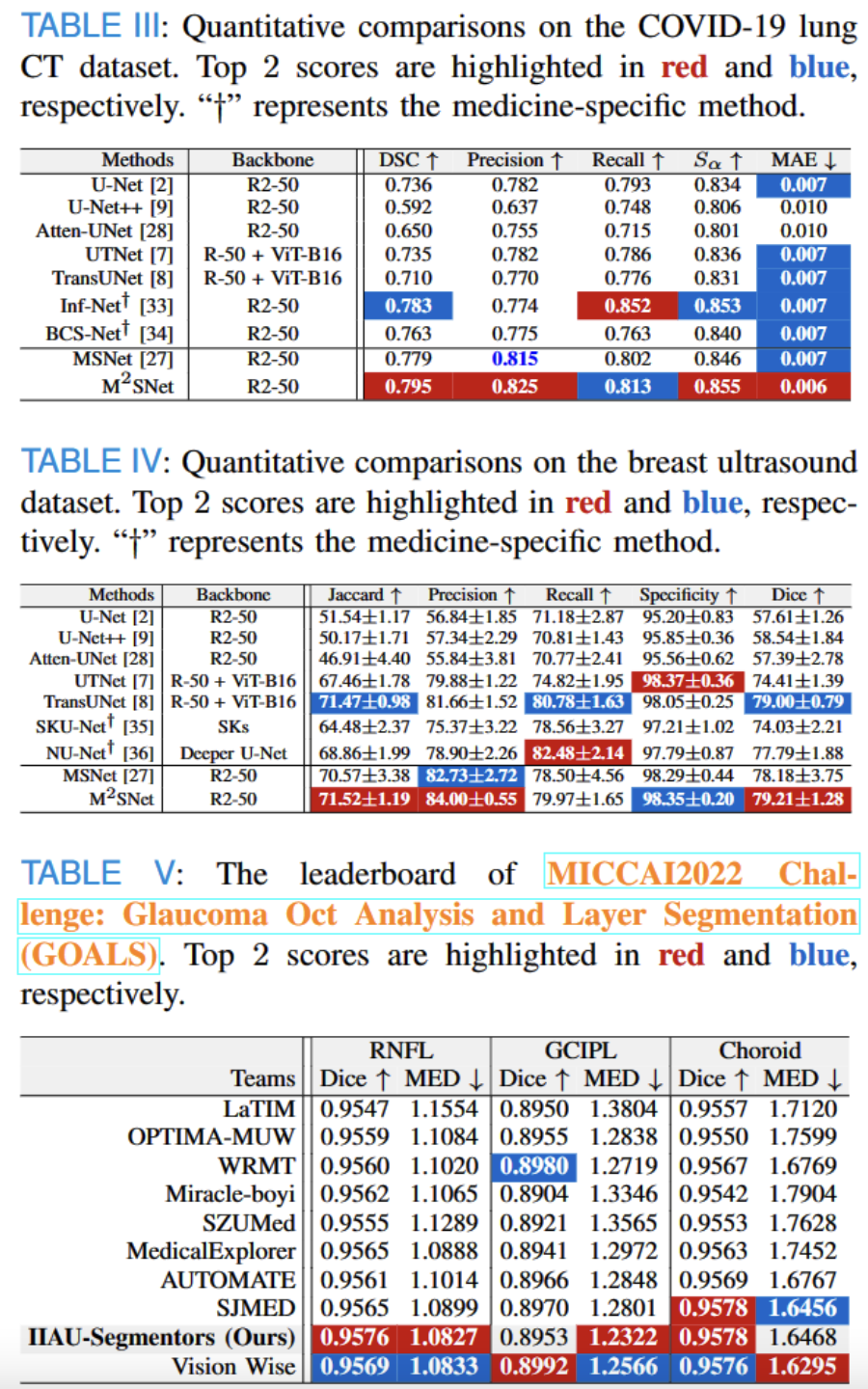

在 COVID-19 CT 和 breast 超声数据集上,SNet 在 Dice 精度也是第一。在 MICCAI 2022 OCT (GOALS) 公开挑战赛中,与100支队伍同台竞争荣获第二名!

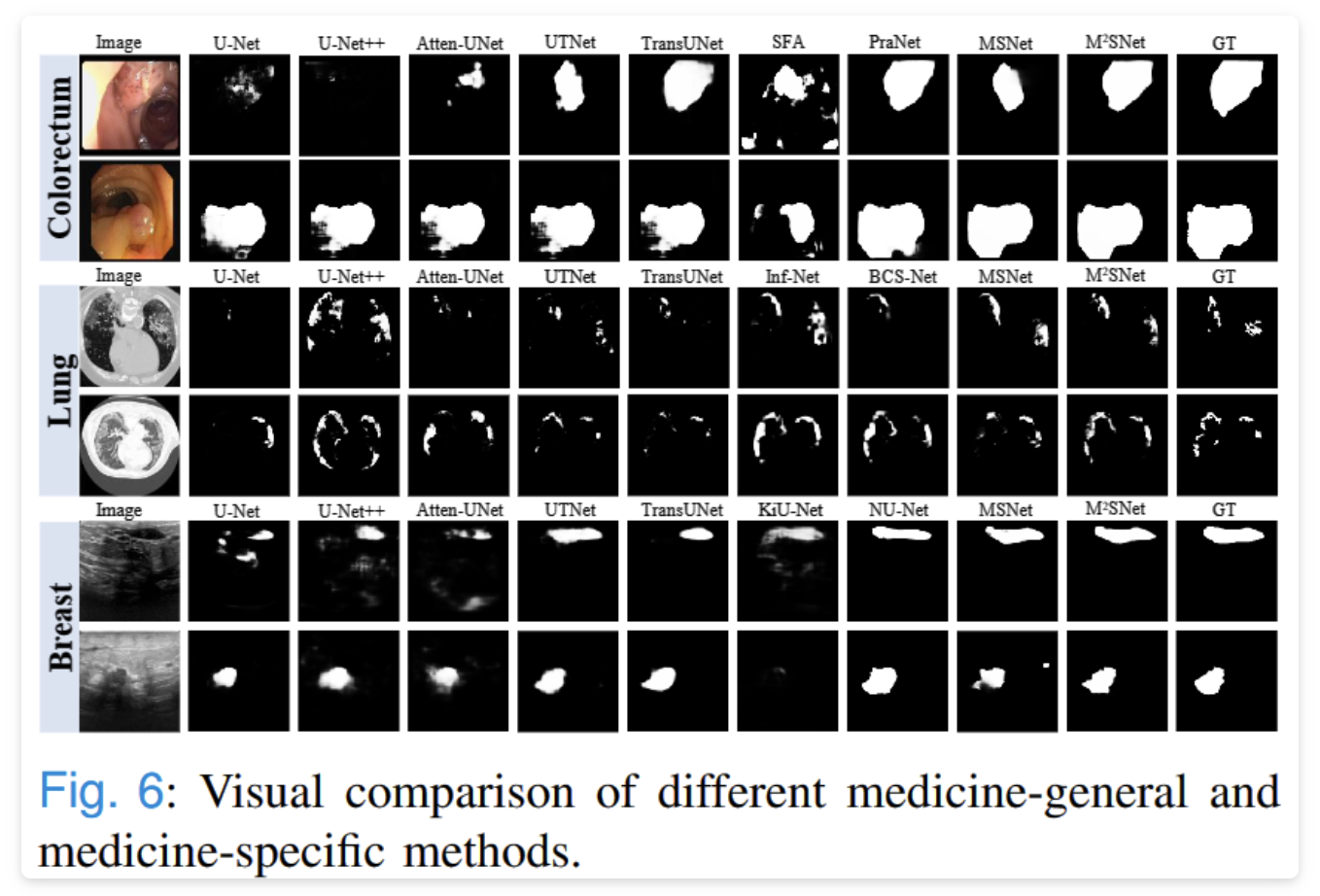

可以很直观地看出,SNet 的分割结果在完整度和细腻度上都比其他的模型表现更好,这更充分地证明了 SNet 在医学图像分割领域中的先进性与通用性。

。

总结

原文:CVHub

作者:派派星

推荐阅读

- CVPR'2023 | Point-NN: 即插即用,无需训练的非参数点云分析网络!

- 【机器学习算法】1、线性回归——深层理解

- 追求极致:Repvgg重参数化对YOLO工业落地的实验和思考

- 【ReID学习笔记】Auto-ReID:ReID结构搜索首次尝试(附单卡代码下载)

更多IC设计技术干货请关注IC设计技术专栏。

迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。