作者注:本文最初发表于2015年12月18日,内容是12月10日在2015中国存储峰会“云计算与业务连续性”分论坛发表开场演讲《云计算本是O2O?》的全程速记,应几位听众的要求,供大家参考。

去年我是在软件定义分论坛做开场,讲的是软件定义存储的基本分类。这一年来,大家见到的软件定义存储的产品有很多了,但从总的定义和分类来说,其实并没有太大的变化。今天我来讲一讲偏硬件的东西,即云计算的基础设施。

大家都知道O2O是Online和Offline,线上和线下的互动。各种外卖各种服务,真正决定你服务质量的还是线下,如果你没有线下,只有很漂亮的网站,其实很多方面是不能让用户满意的。如果说O2O就是把线下的资源搬到线上,我认为云计算(中的IaaS)是相当符合这个定义的。这是一方面,如果我们把线上狭义理解为互联网的风格,把线下理解为传统企业,实际上云计算O2O也体现了互联网思维和传统企业应用相互间的融合。

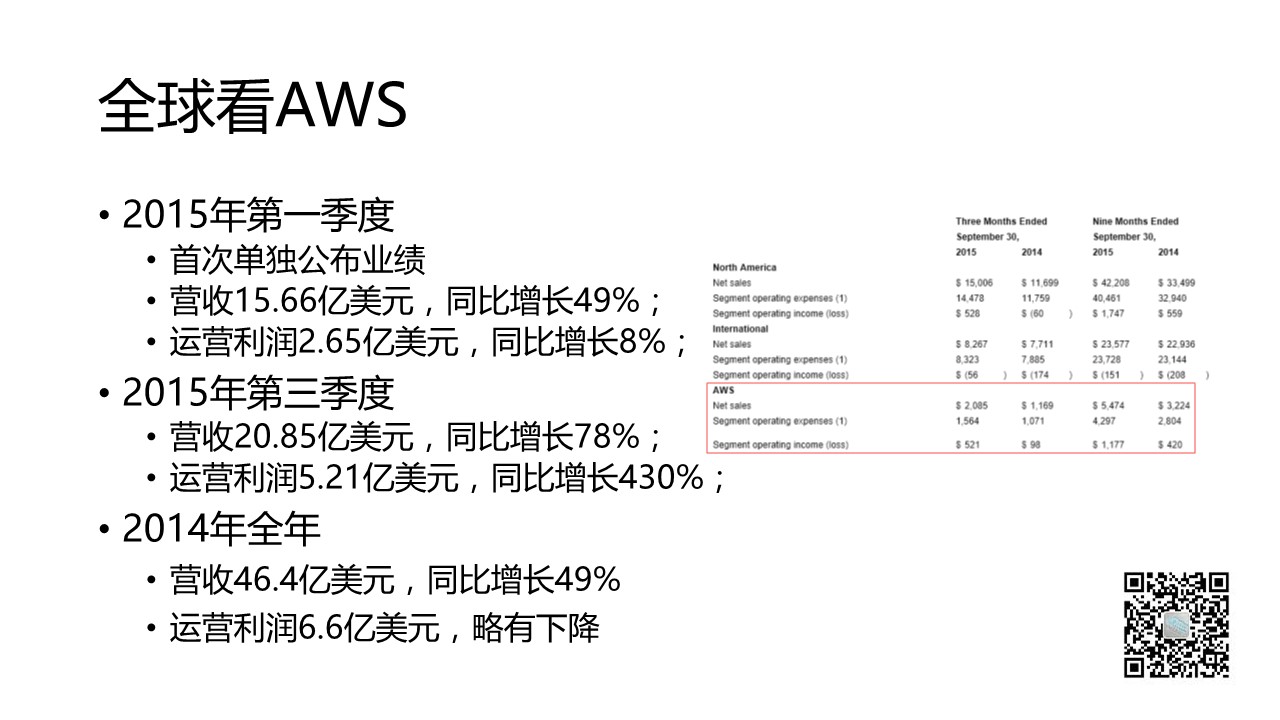

我们大家都知道云计算的领先厂商,AWS,他们从今年开始公布了营收的情况,第一次公布的时候,一个季度的营收不到16亿美元,差不多20%的运营利润,最新的季度营收已经超过20亿美金,利润差不多是25%。关键是增长的空间很大。有比较高的利润,有想象空间,这是很多人都关注的。

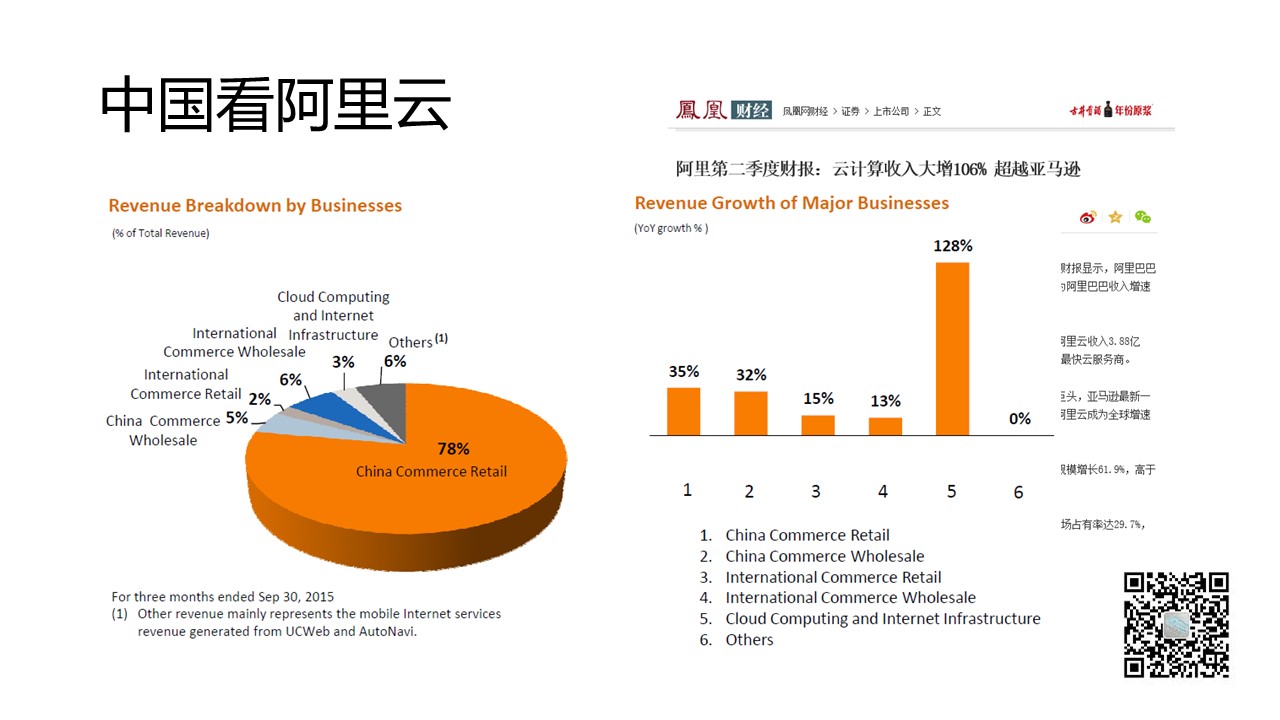

国内从规模来说最像AWS的就是阿里了,尽管阿里云从产品服务的种类上来说,还不能跟AWS相比。阿里第一次在财报中单独列出云计算业务收入比AWS稍晚一点,是上一财年的最后一个财季(今年第一季度),并没有大肆声张,真正声张是第二季度(新财年第一个财季)的财报,(宣传上)很有互联网风格——“超越亚马逊”,增长率很高,但实际营收还不到1亿美金。双十一之前公布上一季度的财报,营收超过了1亿美金,差不多是1亿多一点,大约是AWS的二十分之一,确实增长率很厉害,而占总收入的比例大概是2%~3%的样子。增长率是鹤立鸡群的,但是营收的比例占的很小,这个就有很大空间了。

今天凌晨我刚刚回到北京,昨天参观腾讯在上海新开的数据中心,腾讯云也想挑战阿里云。腾讯云在昨天下午的活动中说,腾讯未来新增的服务器的一半,应该都是为腾讯云准备的。实际上这部分的发展和想象空间也是很大的。云计算确实是一个重资产的行业,这是2014年的时候,去年AWS公布的数据,每天新增服务器的容量可以支持亚马逊(Amazon)年收入70亿美元时的基础设施。刚刚过去的季度亚马逊总收入是250亿美金。(不严谨的计算)要想支撑亚马逊除AWS以外部分的收入,实际上按照这个速度的话,半个月AWS增加的服务器就可以满足亚马逊一年营收规模,而AWS自身要达到70亿美元营业收入差不多要一年,说明这是重投入,短期来说是低产出的行业,但是它的想象空间大。如果云计算真的把传统的IT取代了,把IBM等传统IT厂商的市场全部取代了,几千亿美金的市场,哪怕利润率降到10%也是很不错的。

重资产需要的就是服务器,谷歌(Google)从来没有明确说过服务器的数量,但是据大家的猜测很早就超过了一百万台,现在应该是两百万台。微软(Microsoft)前年7月份,还是鲍尔默在任,宣布服务器总量超过一百万台。从云计算(公有云)角度来说,微软做的比谷歌要早要好,对AWS威胁是最大的。AWS不直接公布服务器数量,(而是说)我有多少可用区,每个可用区可以放多少服务器,然后大家可以推算出(总量)超过一百万台。AWS re:Invent 2015开过之后,有一个比较大的公众号根据去年(AWS re:Invent 2014)亚马逊公开的演讲资料推算说亚马逊的服务器数量超过了三百万台。当时的演讲我在现场,这个数字显然是根据那里面比较理想的状况,比较大的数值推算的。现在根据比较可靠的推算,亚马逊的服务器数量应该超过了200万台,但是还不到250万台,可能明年就会超过了。其实在百万台的级别,应该还有Facebook,他们大约在一百万台上下,但是不能算是云计算(市场上做)公有云的厂商。

(注:上述公众号依据的资料是2014年11月召开的AWS re:Invent 2014上,AWS副总裁兼杰出工程师James Hamilton的演讲《AWS Innovation Scale》,与会者普遍的感觉是,这可以作为AWS服务器总量超过100万台的证据,再多就不好说了。具体可参考《数据中心即服务器:Google、微软、Amazon三巨头的言与行》一文)

昨天下午腾讯的活动上,腾讯明确宣布了他们的服务器数量超过50万台。百度没有公布过,推算应该是在40~50万台之间,阿里巴巴也应该是40~50万台之间。我不能为这个数据负责,但是这个估算基本上是靠谱的,后面我会详细提一下。

实际上我们有一个可以参考的数字,阿里巴巴在2011年的时候,还主要是电商企业的时候,(当然)它现在也主要是电商的企业(只是阿里云的声音大得多了),服务器数量可能只有两三万台,它在这几年,(伴随着阿里云的快速发展)基本上每年买10万台到15万台,所以说现在基本上接近50万。腾讯在2011年的时候,服务器数量是(BAT里)最多的,差不多接近10万台。昨天我看腾讯在青浦的数据中心有4个建筑构成,现在第一个建筑开始往里放服务器了,这4个建筑差不多可以放10万台服务器,他们用同样的方法,在广东是6个建筑可以放15万台服务器。重庆的在建设,天津的数据中心我也去过,就是前几个月被爆炸波及过的滨海数据中心,那个数据中心(规划)可以放20万台。腾讯4个中心建筑,在青浦的,每个建筑是2万5千台,差不多一年就可以放满,但是分布在各地都有,(所以)一年10多万台的采购量是有的。亚马逊的服务器数量增长也主要是在AWS业务起来以后,有消息说,这两三年来,每年买50万台,我们知道全球的服务器,一年的销售量不到一千万台。

服务器应该有地方放。我昨天在朋友圈里发腾讯服务器数量超过50万台之后,有人评论说,阿里早就超过一百万台了,我们不得不说阿里比较善于公关,但是这个判断有可能不太真实。因为服务器要有地方放,从已有的数据中心的数量(和规模),还有从服务器的采购量来说,阿里都还没有那么大。

实际上来说,这就是AWS推算出来的,全球有30个可用区,最大的可用区有6个数据中心。AWS说典型的数据中心可以放5~8万台服务器,这么一算,30×6是180,再乘以5就是900万台,但这是不可能的,不是每个可用区都有6个数据中心。譬如在中国,北京有AWS的可用区了,但是那些数据中心不是它自己的,容量也没有那么大。

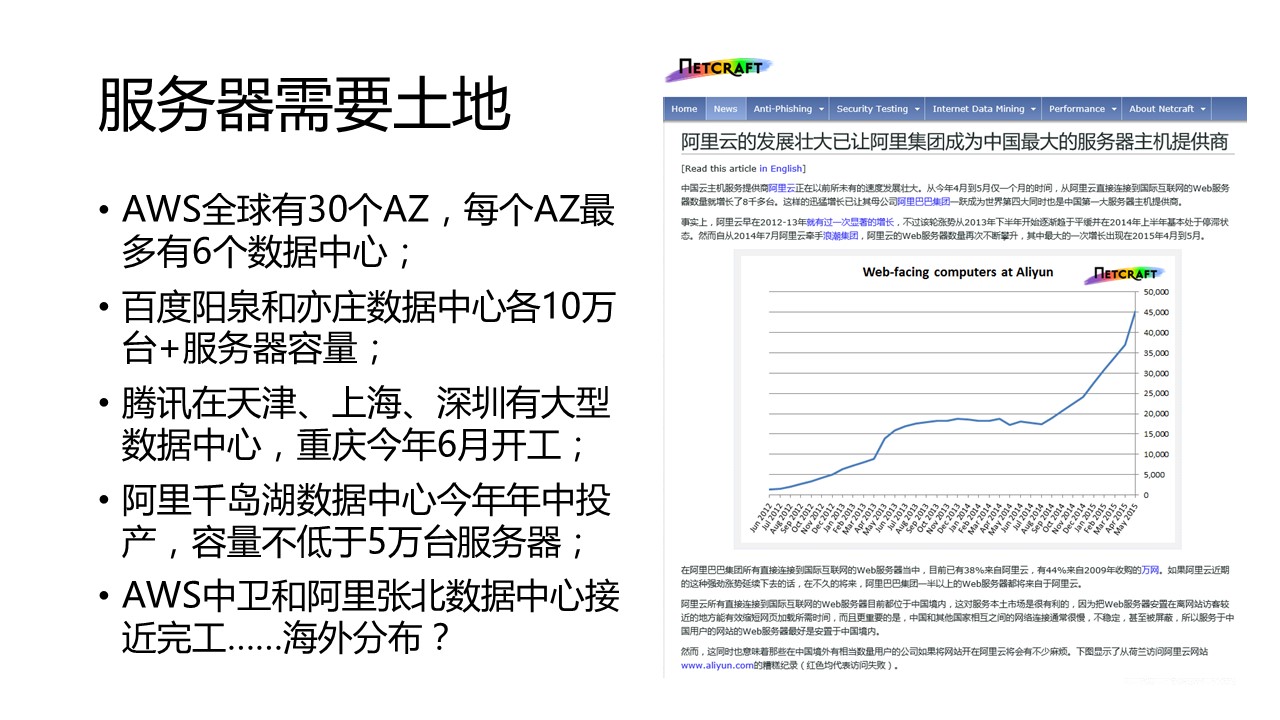

去年年初在宁夏中卫动工的数据中心,土建已经竣工了,百度阳泉和亦庄数据中心可以各放10万台,腾讯的说过了。阿里在千岛湖的数据中心9月初我也参观过,根据用电量,根据电能和空间可以算出来,大概能放5万5千台。阿里正在张北建大型数据中心,3月份开工,土建差不多竣工了,大约明年5月份才能投入使用。阿里张北数据中心分三期,每期放20万台服务器。

这个(NetCraft)是统计网上Web服务器的网站,这是英文的网站,今年5月份发了一篇文章以后,又专门放了一个中文版,我看该网站近期的文章只有这一篇有中文版。当然Web服务器的数量不一定等同物理机的数量。“不久的将来阿里巴巴集团一半以上的Web服务器都来自于阿里云。”这里面有好处,有不好的地方,虽然BAT都开始有国外的数据中心的合作,但是主要的数据中心都在国内。如果你是国外的用户,又不是中国的公司在海外开展业务,用阿里云的可能性不是很大,其中数据中心的位置就是一大问题。在开放市场,AWS和微软的服务目前可能是最好的:从全球分布来说,比如说Facebook这样的公司,在欧洲的瑞典和美国都有自己的数据中心,AWS在日本、欧洲、美国都有数据中心,包括微软、谷歌,他们在全球分布做的很好。

(注:这里插入AWS官网上的全球基础设施分布图作为参考,其中印度区域将于2016年第二季度开通,俄亥俄区域将于第三季度开通。宁夏区域也是即将开通,但土建早已完成的中卫数据中心,未必能早于前面两个投入使用,而这与AWS在中国的发展速度息息相关……“云计算未动,数据中心先行”)

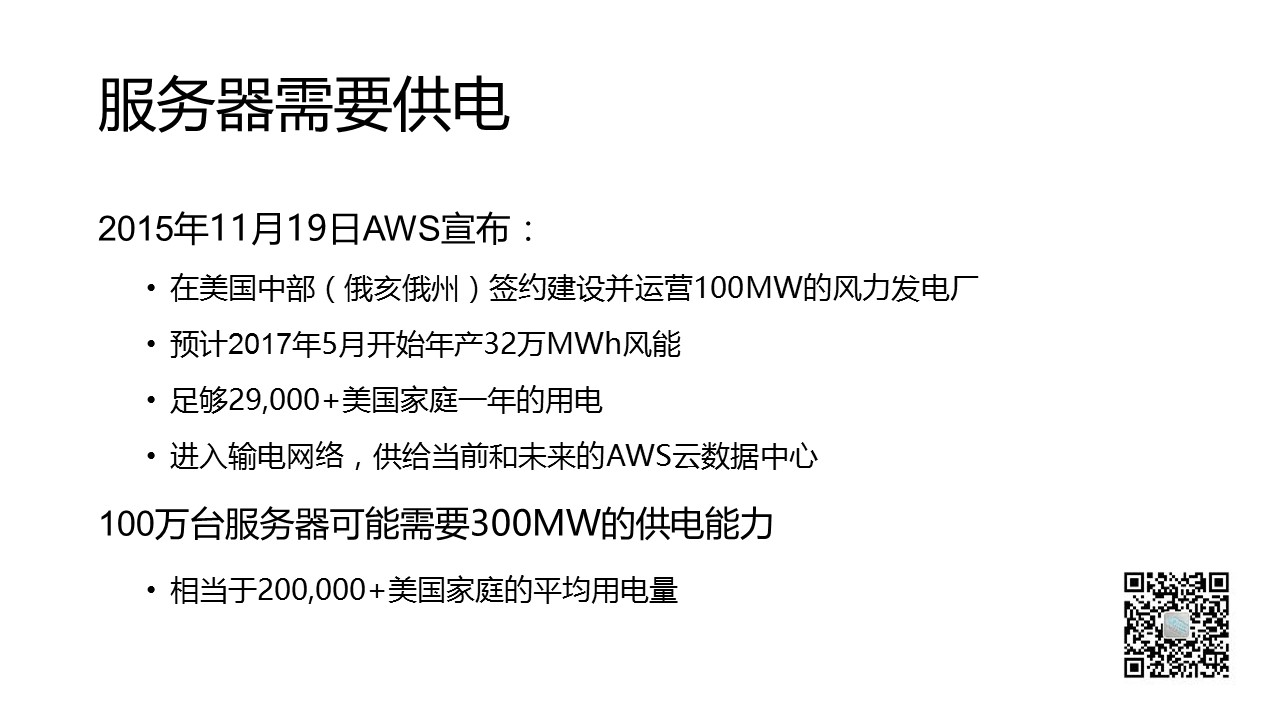

服务器需要供电。我们粗略算一下,如果一台服务器的能耗是200多瓦的话,一百万台服务器就需要300兆瓦(MW)的供电能力,相当于20万家美国家庭的平均用电量,美国人用电比咱们还是要费的。服务器多了,用电,对环境肯定是有影响的。我把腾讯云服务器数量发到朋友圈里,下面就有人说,是不是PM2.5也有腾讯的很大贡献?要做事就会有影响,关键是怎么尽量减小不良影响。实际上在数据中心建设的领域,大家都在讲新能源,新能源对环境破坏少一些,比如说现在水电很难说它完全是新能源,因为水库也会破坏生态环境,但是风电和太阳能都是比较好的自然能源,实际上AWS,就是上个月刚刚官方宣布的,在美国中部建一个风力发电厂,正好与俄亥俄区域的开通相呼应。包括谷歌,美国的公司比较注重这一点,就是环保的投入。

(注:在今年10月初举行的AWS re:Invent 2015上,AWS负责基础设施的副总裁Jerry Hunter发表演讲《AWS Infrastructure Innovation》,除了公布AWS印度区域和俄亥俄区域的开通时间,还简要介绍了亚马逊的其他三个新能源项目,分别是2015年1月印第安纳的150MW风电、6月东弗吉尼亚的80MW太阳能电厂、7月北卡罗莱纳的208MW风电)

在国内的公司,百度阳泉的数据中心我没有去过,但是它的数据中心应该在屋顶有太阳能发电板(光伏板),这个满足少部分供电的需求。昨天我去的腾讯数据中心,因为他们还在建设过程中,但是每栋建筑是六千多平米,在楼顶有三千平米以上的空间是为太阳能发电板准备的。包括阿里的千岛湖的数据中心,楼顶有几百平米的太阳能发电板。我们知道在国内,尤其是在这些大城市,我觉得太阳能还不是很可靠的电能,因为我们经常有雾霾。张召忠说,雾霾的好处可以对抗美军的激光武器,那当然也会影响太阳能。另外一个方式就是风电,在咱们北京这些地方风电也不太靠谱——如果真的刮那么大的风,就不会有雾霾了。在国内新能源也比较苛刻,现在用天然气实现供电,在国内就已经算是新能源了。(注:如果数据中心远离大城市,大家又会抱怨访问速度问题……)

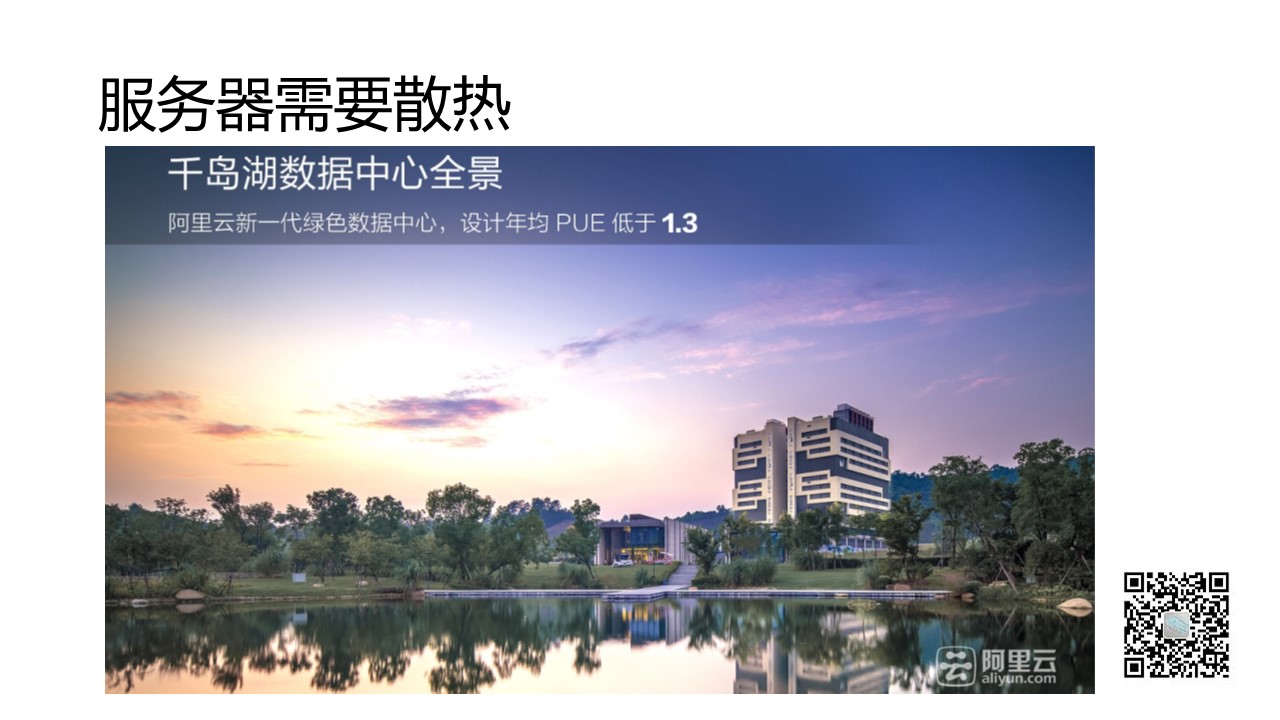

当然服务器还需要散热。大部分的电能都会转化为热量散发,美国情况好一些,因为他们空气比较洁净,谷歌开始比较早,还用一部分的水冷,就是以水作为中间的介质换热,实际上像Facebook,基本上几个大的数据中心都是用新风自然冷却。国内很难有这样的条件,其实雾霾不但人受不了,机器也受不了,所以用水冷(作为中间介质)比较多。

这是阿里千岛湖的数据中心,就是用这个水库的深层水抽上来做冷却,其实在杭州附近纬度的数据中心,PUE低于1.3已经不错了。在国内来说,PUE做到1.1-1.3之间,已经是最高的水平了。腾讯天津数据中心也是这个水平,但是天津的纬度肯定比杭州要高,一年利用自然冷却的时间更多一些,也有利于提升PUE。

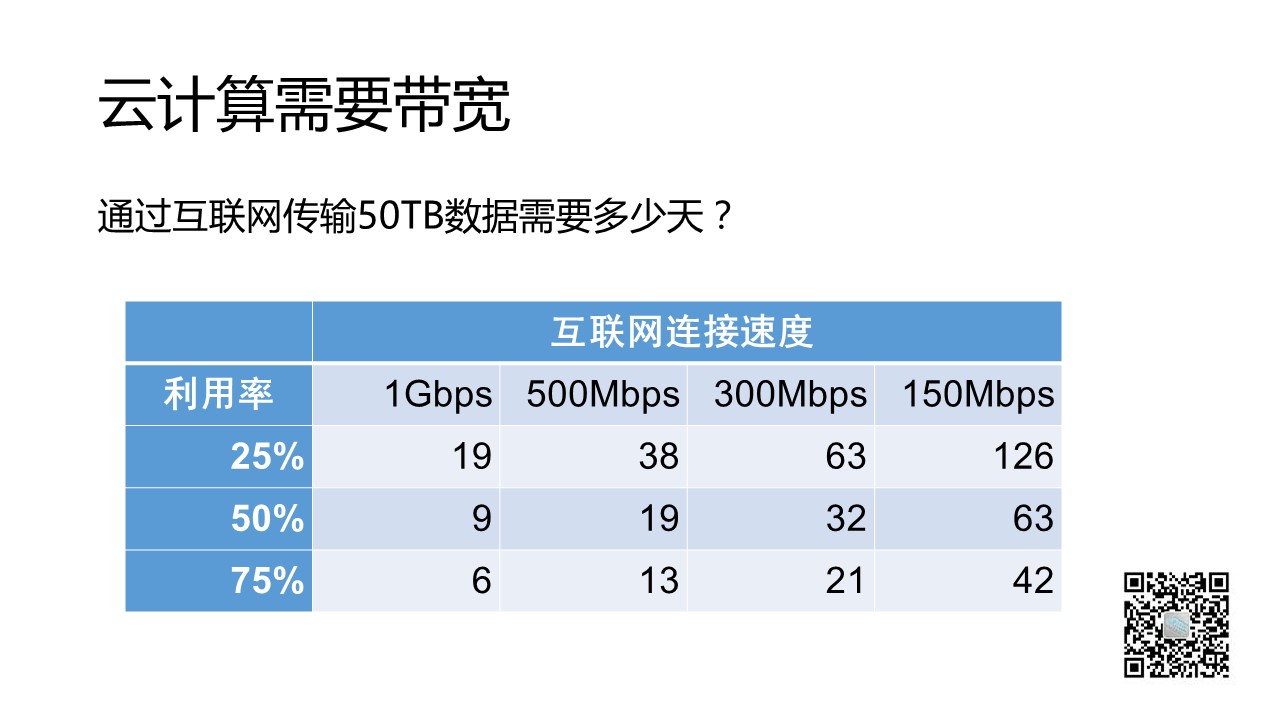

云计算需要带宽。互联网传输50TB的数据需要多长时间?你到公有云的连接达到1Gbps已经是很高的水平了,很多公司内部的网都还不是千兆,即使这样传输50TB的数据也要好几天,更何况带宽是要花钱买的。“永远不要低估一辆卡车的带宽。”数据中心很早就有容灾的需求,要把数据备份到异地,大型的企业通过专线备份数据是备不完的,我们很早把它备份到磁带,有专门的数据公司给你运送到异地存起来,因为备份的数据要存在异地,这样才能实现真正的容灾。

(注:图片来自Trasportando.com)

几年前我在华尔街闲逛的时候,还见过他们运磁带的车,因为那里银行很多。实际上这种思维被AWS借鉴,如果你是一个用户,你有很多的数据,想用AWS公有云,又不想通过专线传上去,其实AWS几年前就推出了一个导入/导出(Import/Export)服务,可以把硬盘拷上数据,然后快递给AWS,他在数据中心用高速的网络直接传给服务器,这也是线下的方式,这样也省去带宽,付一个快递费就可以了。码农们觉得这个跟拷小电影的方式是一样的,很新鲜,其实磁盘就是今天的磁带,以前递磁带,现在递磁盘是一样的。

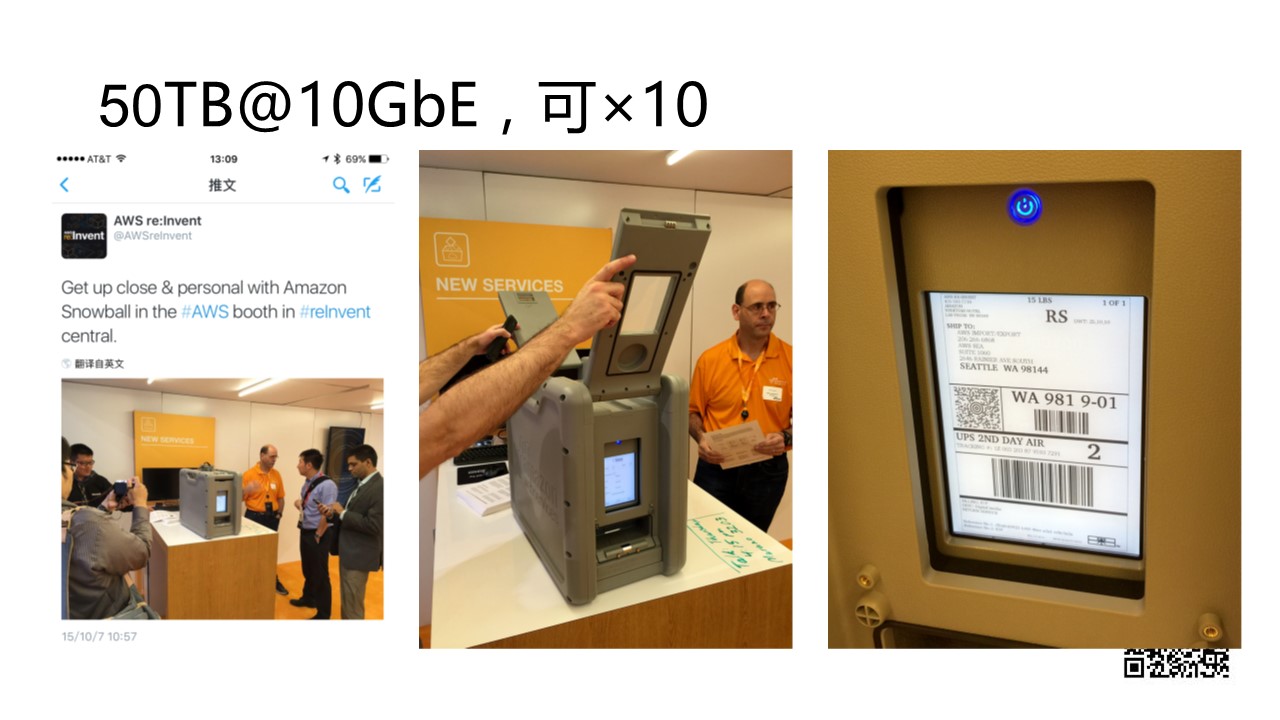

但是从去年到今年,AWS对企业级用户的争夺越来越明显。企业级的用户的数据就不是一个硬盘放得下,快递多个硬盘,拷数据其实是很麻烦的,今年出一个新产品(参见分享实录下面的附文),就是个小盘阵,裸容量是40TB。AWS一向不讲硬件的细节,但只能是盘阵,不会是SSD,差不多40斤,前面有一个小屏幕。用一些压缩技术,保证容量达到50TB,再高就不好保证了。就是通过快递运送的,目前指定的快递是UPS。这个发光的屏幕是Kindle,把母公司(Amazon)的东西用上了,屏幕不亮的时候也可以看到,这就是电子墨水(E-ink)。

用法就是租用的方式,可以找AWS申请,你说我要(向AWS)导入数据,AWS通过UPS快递给你,快递给你两天之内可以到,然后你在10天之内再快递回去就是200美金,如果多用一天多收15美金,用万兆以太网连接,实际上50TB的数据应该说一天之内就能上传完毕。比如说数据很多,你有500个TB可以并联10个一起来做。

AWS很了解电商,很了解快递,所以这个东西,为了考虑对付野蛮装卸,为什么会这么重,加了很多抗震手段,如8.5G冲击,硬盘在没有加电运转情况下抗震能力还是可以的。加上很好的保护外壳,前后挡板一盖,防水防尘,基本上没有什么问题。

这个东西叫雪球(Snowball),雪球这个东西不怕摔或者不怕滚,或者越滚越大。国内有的公司也有这样的想法,但是没有美国人想法那么大,阵列的抗震问题就是问题:我派一个工程师护送,但是互联网讲规模,如果你的用户有很多,你不可能招一堆工程师专门当快递使,美国人做事的方式比较值得我们借鉴,我让这个东西不怕摔,用普通的快递渠道完成就可以了。实际上这个相当于一种O2O,线下把数据传过去(到线上)。

我的观点就是,如果我们不去执着O2O的本意的话,只从字面角度来讲:云计算就是O2O,线下资源对线上能力的支撑。

第二部分就是讲互联网和传统企业做法的融合。

你买的服务器这么多了,你完全就可以走定制化了。我估计我可能讲的有可能超时,我就不(展开)讲定制化了,最后我会给大家推荐参考文章,为什么做定制。定制很关键的一点就是要有量,百万台级别的就可以自己做了。如果按照AWS的做法的话,一年买50万台,已经超过一些国内主流服务器厂商全年的产量。如果没有那么大的量,大家一起团购也行,一起做一个开放的标准,2011年就成立了两个开源硬件的标准。

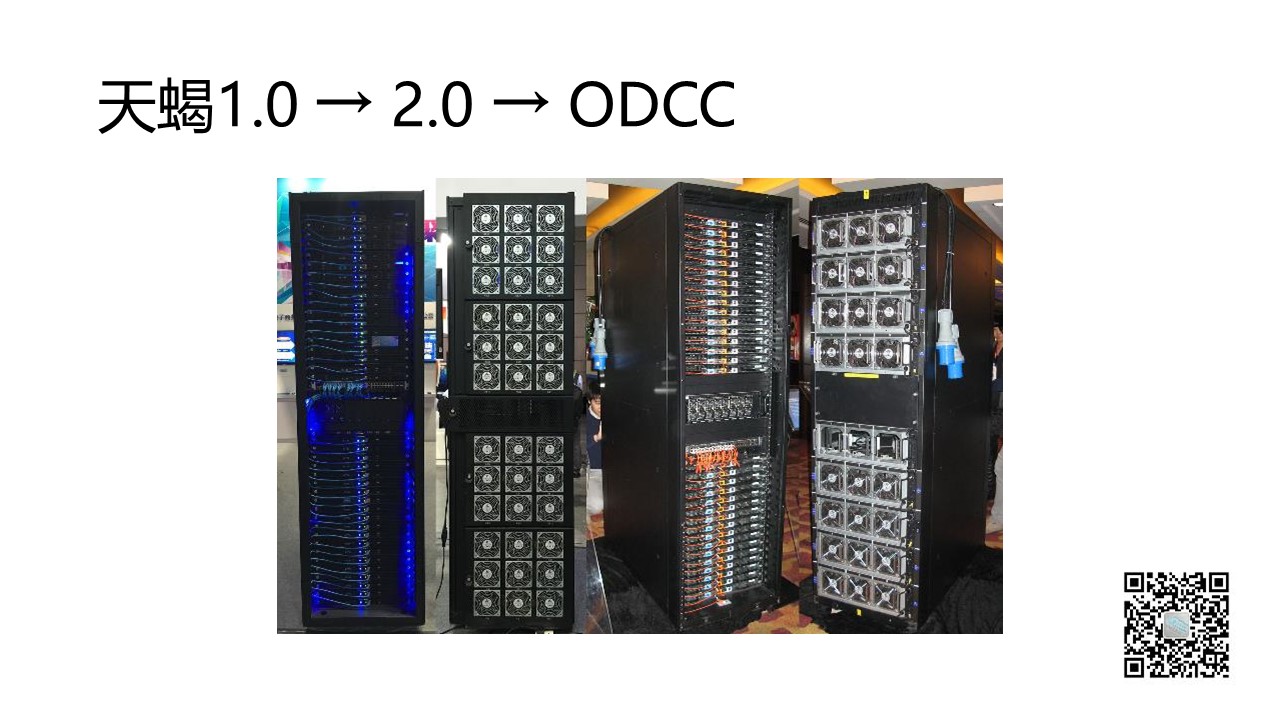

一个是Facebook在4月份发起的,他们发起的时候,服务器数量没有那么多,就是10万台,20万台,去年微软入伙的时候可是百万级。微软其实也是自己做(并且还在自己做),我们就不讨论了。百度、阿里、腾讯也是2011年发起的天蝎项目(Project Scorpion),当时他们服务器都不到10万台,阿里差不多是2万台,腾讯9万多台,百度应该是4、5万台的样子,几年发展很快,都到五十万台量级了。当然,一台和一台是不一样的,腾讯的服务器,当时还有很多单路的服务器,比如说做Web接入。阿里服务器数量不算多,但单台服务器价格比较高。他们(BAT)发起的天蝎项目,去年纳入国家的标准体系(天蝎之路:ODCC服务器发展报告)。

OCP是2011年4月份发起的,这是基金会的董事会成员,大家做开源讲究做基金会。最左边的这位,原来在戴尔工作很多年,在服务器等领域很有经验,当时代表Facebook(任主席),这个人是谷歌公司第一笔投资的投资者,现在在一个网络公司(Arista),这是英特尔公司,高盛可以代表传统的金融企业,云服务公司Rackspace,比Facebook少的。微软去年补进董事会,为什么那么晚还能进董事会?很重要的理由就是量大。

这是今年3月份OCP峰会上公布的成员,这不是完全的成员名单,IBM是去年加入的,惠普是今年加入的,微软也是去年加入的,EMC是前年加入的,VMware加入了,但是没有logo,VMware在这里面的地位是比较高的,应该类似于金牌成员了。这些所谓的传统企业,包括很多硬件定制的厂商都加入OCP。

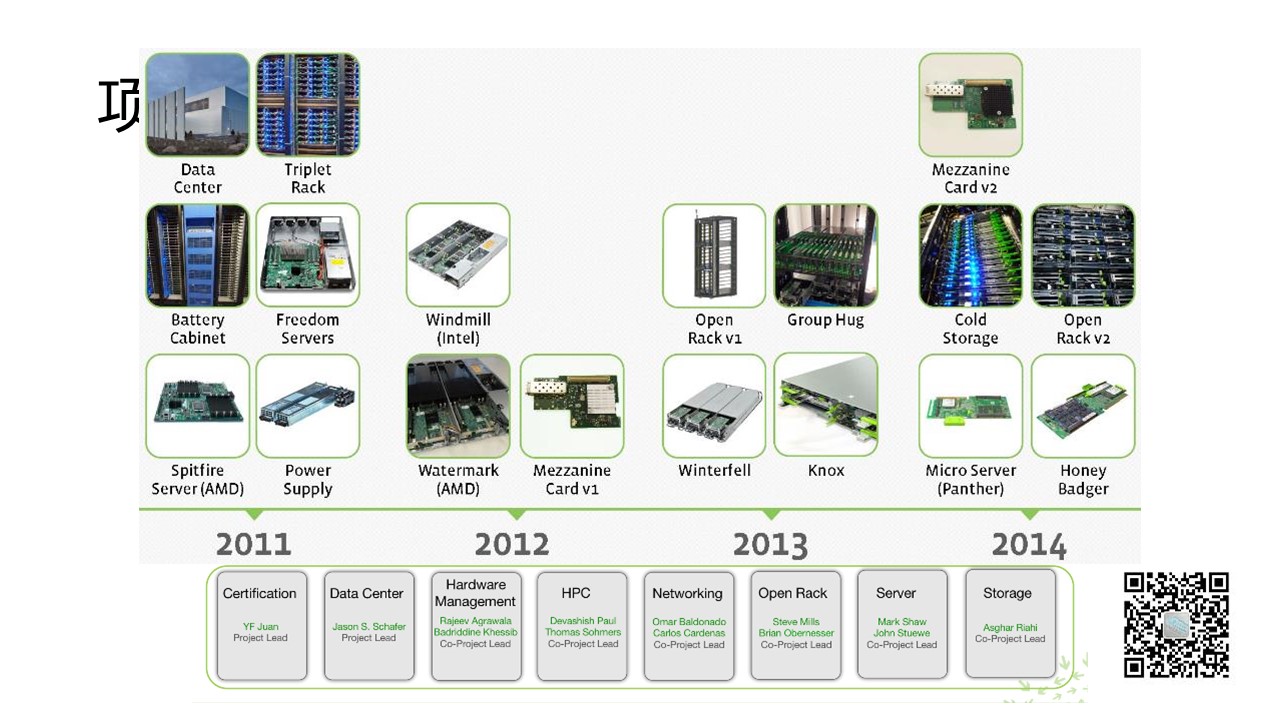

它的项目,最早的项目是服务器,然后是存储,就是傻柜子(JBOD);还有机架就是机柜的标准;数据中心,因为OCP的起源就在于Facebook自建数据中心。高性能计算(HPC)还没有项目出来,网络一开始就有,但是真正开始发展比较快是去年,其实还有电信的工作组,电信工作组(Telco)是今年正式成立的,但是还没有任何的成果,这是基金会的架构,这边是主席。

这是从2011~2014年的成果,这是数据中心,这是机柜,这是服务器,电池柜、电源,跟服务器相关的都做了,微服务器,这个是存储,就是2U的,可以放30个盘的,模块化做的很好,这是服务器。一台这样的服务器,带8个这个(JBOD),双路CPU带240个硬盘做的冷存储,这是新的Open Rack,这是微服务器。OCP为Facebook省了很多钱,今年初的官方说法是四年省了20亿美金(以上部分可参考:Facebook与OCP)。

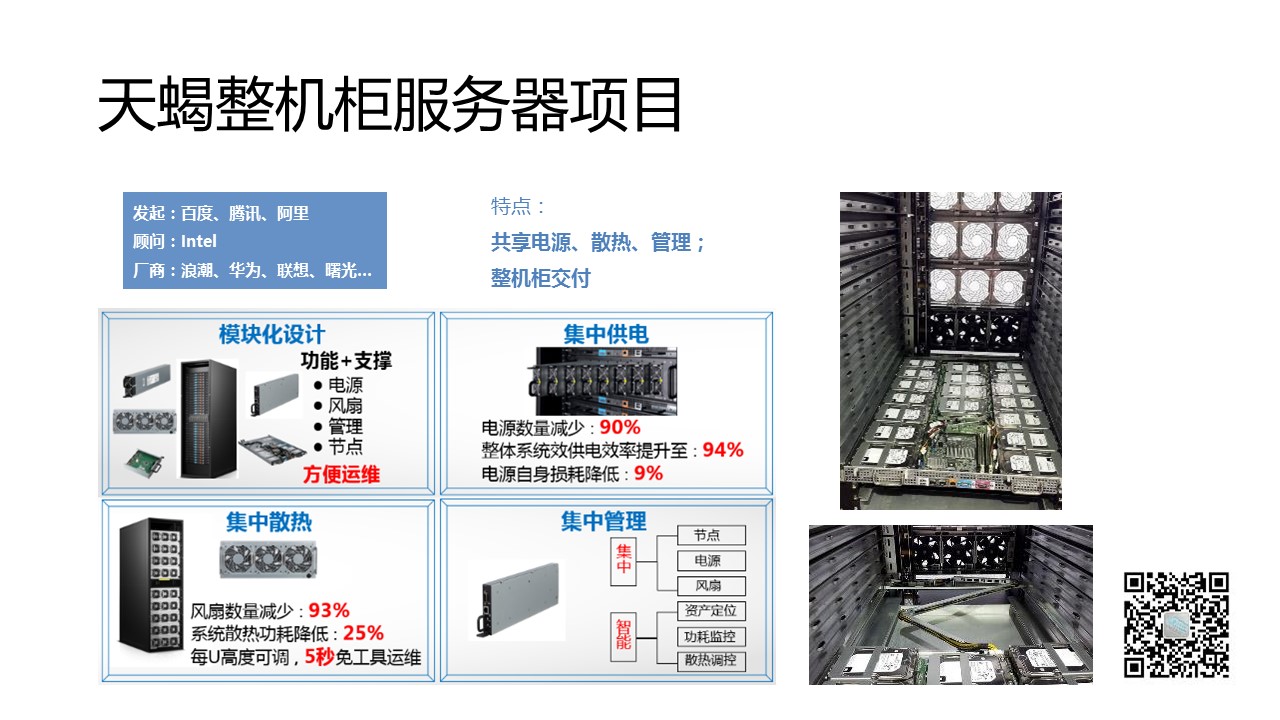

天蝎项目从整机柜开始,有点像Open Rack + OCP Server。发起是BAT,后来电信和移动,电信是2013年加入的,移动是去年加入的。顾问是英特尔。特点就是(比Open Rack增加了)共享散热,模块化设计,六大模块,集中供电,集中散热,集中管理。集中供电和风扇可以减少部件的数量,降低采购的成本,集中了以后,效率会提升,这里就不展开了,后面我给大家介绍一系列的文章(BAT与天蝎的故事),大家可以看一看。

这是阿里整机柜的服务器,这是风扇窗,这是安装的风扇,这是集中供电,每个服务器节点没有电源,服务器可以拉出来从前端做维护,保持不断电。Open Rack只是集中供电。

天蝎1.0和2.0的机柜,1.0的时候很多地方都没有统一。

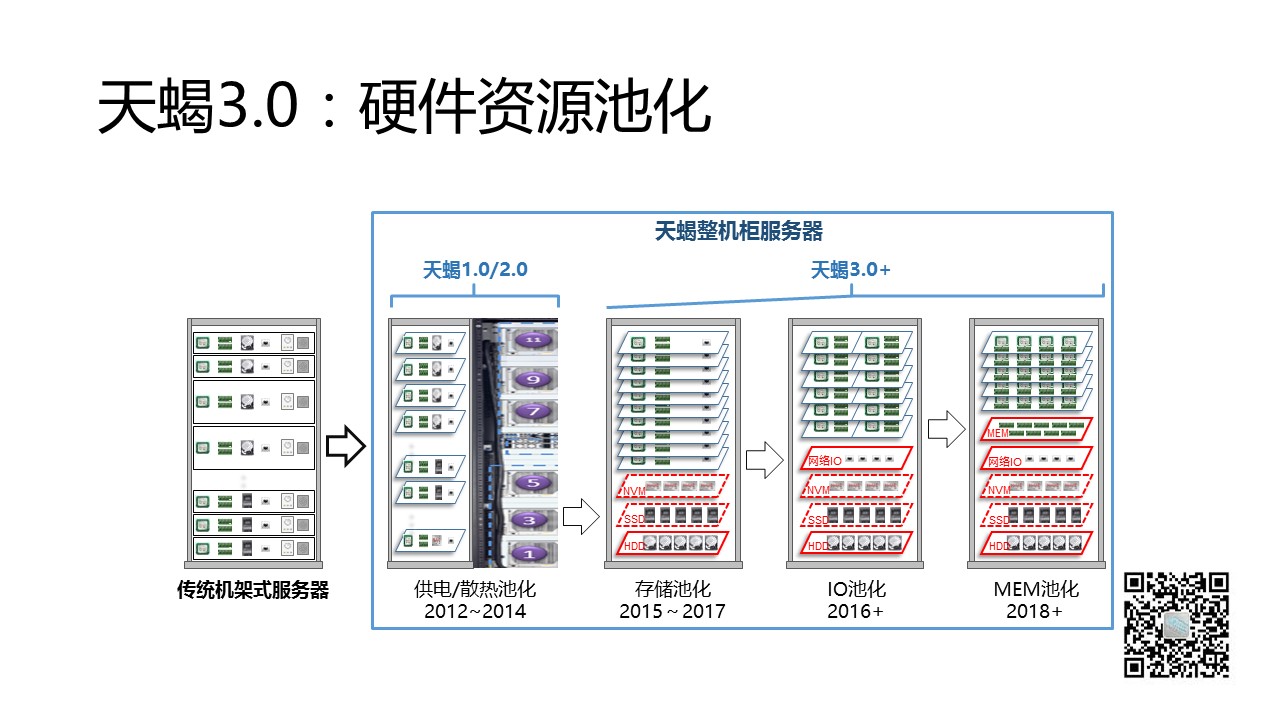

天蝎3.0就是硬件资源池化。1.0只是把电源和风扇做池化,传统意义来说,不属于IT资源,接下来存储池化、IO池化,硬盘池化相对比较简单,内存什么时候能池化?我觉得2018年从量产的角度也很难实现。

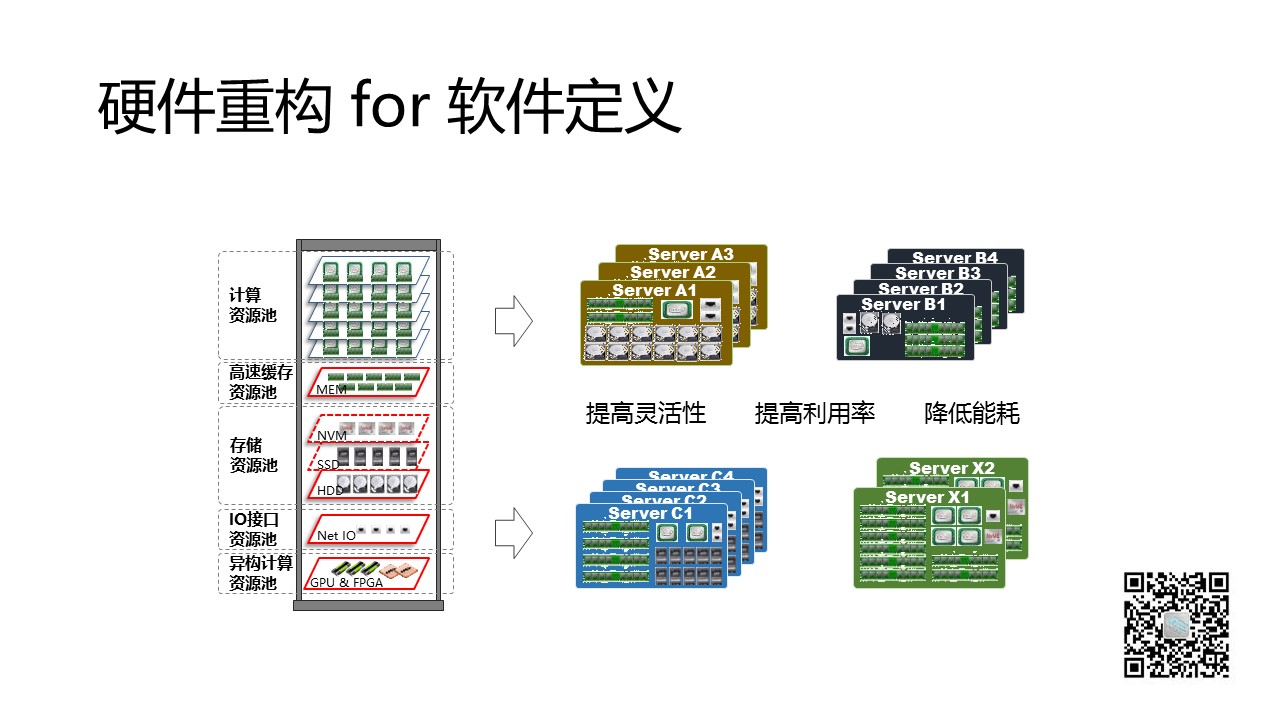

像VMware或者微软做的虚拟化本质上是一样的,CPU做一个资源池,互联网公司不想用这个虚拟化的方案,而是从硬件层面来实现,理论上说损耗小一些,但是这是很艰巨的过程,短期之内,存储的时候,可能在明年看到产品,但是这个就需要软件跟得上。硬件重构以后软件要跟上。

我们从这点来看,大家的诉求都是一样的,只是大家实现的手段不一样。互联网企业采购量大,有能力自己定制这些硬件,传统的企业,更多的要在软件层面上来实现。

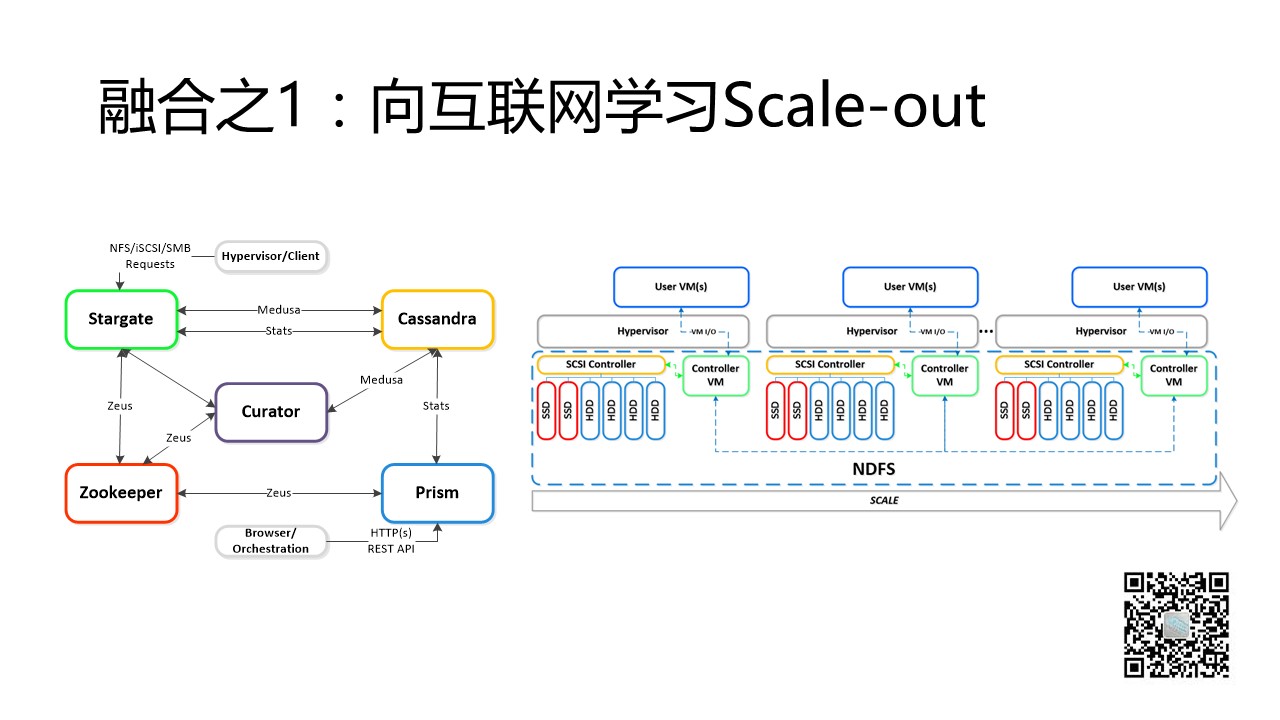

大家可能有一些误解,或者大家认为互联网就是Scale-out(横向扩展),做分布式,做横向扩展。传统企业,传统厂商,比如说IBM之类的公司,做的是单一系统的Scale-up(纵向扩展)不断强化,有一种观点认为这两者是截然对立的,其实不是的,大家都在互相学习。

以Nutanix的超融合系统为例。这是产品的控制架构,ZooKeeper是从Google学的,后来各种方式开源,分布式集群调度。Cassandra是Facebook开源的,Nutanix做的产品是面向传统企业,但是关键组件用的是来自互联网的实践。这是横向扩展,NDFS(Nutanix Distributed File System)名字和Hadoop的HDFS(Hadoop Distributed File System)很像,Nutanix核心团队有一些人有Google的GFS背景,NDFS的资料里面也宣称是“Google-like”。就像当初比尔盖茨跟乔布斯说的一样,我抄的不是你的,咱们抄的都是施乐的。这是传统企业向互联网学习Scale-out的东西。

公有云要争取传统企业的用户,就要支持它的应用,很多企业的应用需要单一系统较大规模。比如说SAP HANA,实际上AWS之前就支持部门级的SAP HANA One,两路节点,最大的一个节点可以支持32个vCPU和244GB内存,严格的HANA的部署应该支持TB级的内存,(目前)这是两路的机器很难做到的,虚拟化不是把两台机器拼成一台用的。AWS在今年宣布,明年上半年会提供X1超大内存实例,内存容量可达2TB。实际上Scale-up和Scale-out没有绝对的好和不好,而是可以相辅相成的。

这是2013年写的报告《数据中心2013:硬件重构与软件定义》,我认为硬件重构主要是互联网厂商主导做的事情,软件定义像VMware这样的公司发起的概念,这是他们各自的代表,但是未来的方向,肯定是硬件重构和软件定义,在双方都要采纳这方面的部分。我很高兴看到去年华为和浪潮先后采用了我提出的“硬件重构和软件定义”的概念。

这有一个现成的例子,VMware提出的SDDC软件定义数据中心,把这个概念化是VMware做到的。这是广达,做服务器ODM的,给Facebook这样的公司做定制,有OCP的整机柜。 VMware有一个EVO RACK。它为了争夺Nutanix的市场,有一个超融合的系统(EVO:RAIL),规模比较小。EVO RACK是机柜机的超融合解决方案,去年是技术预览版,当时用的就是广达OCP硬件平台。今年改为EVO SDDC,有三个认证的硬件供应商,其中有一个就是广达。

大家可以扫描这个二维码,这是我的公众号,你进入到公众号首页,可以看到《天蝎整机柜服务器发展报告(PDF下载)》,这个报告差不多5MB多。《数据中心2013:硬件重构与软件定义(PDF下载)》技术研究报告有较多高清晰度的图片,30多MB,你搜索“企事录”的公众号,可以在网络条件比较好的情况下去下载它。(中间)这个是我对互联网基础设施的分析,包括为什么定制,OCP和天蝎的简单对比。

基本上这就是我演讲的全部内容,谢谢大家!