首发:AI公园公众号

作者:Emil Bogomolov

编译:ronghuaiyang

导读

看看第三种思路的物体检测是什么样的。

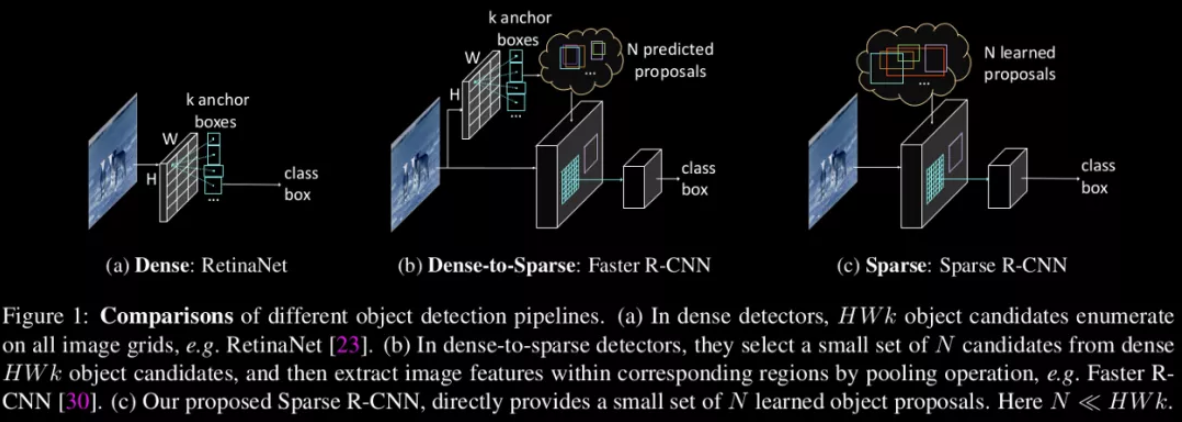

今天我们将讨论一个新的方法称为Sparse R-CNN(不要和处理3D计算机视觉任务的Sparse R-CNN混淆),使用了完全稀疏和可学习的包围框生成来实现最先进的物体检测。

相关的工作

我们先简要介绍一下现有的方法。

Dense方法

单阶段检测器是目前应用最广泛的方法之一,直接预测anchor box的标签和位置,anchor密集覆盖空间位置、比例和宽高比。例如SSD或YOLO。

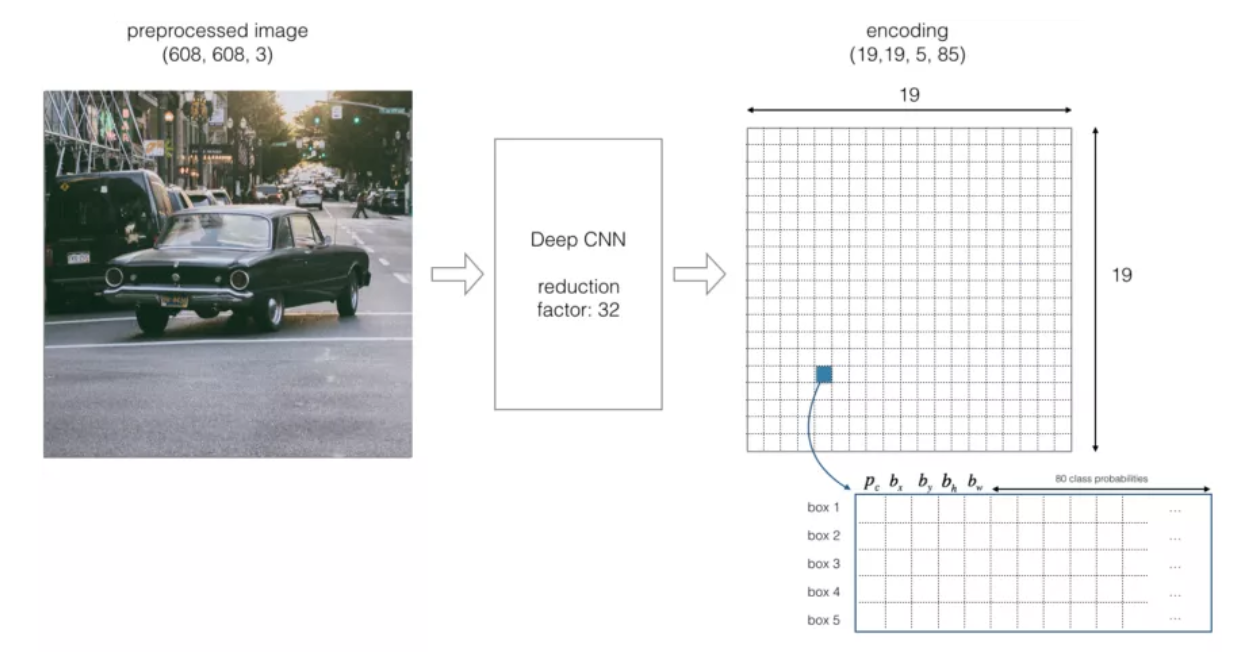

我们来看YOLO算法。最终,它的目标是预测图像上一个目标的类和指定目标位置的包围框。每个包围框可以用四个描述子来描述:

- 包围框的中心点 (bx, by)

- 宽 (bw)

- 高 (bh)

- c为对应目标的类别(比如:车,交通灯等)

此外,我们还必须预测一个pc值,即框中存在目标的概率。它是一个dense的方法,因为它不是在给定的图像中搜索可能包含一个目标的感兴趣的区域。相反,YOLO将图像分割成单元格,使用19×19的网格。但一般来说,单阶段检测器可以产生W x H个cell,每个像素一个。每个单元格负责预测k个边界框(本例中k选为5),因此,对于一张图像,我们会得到大量的W x H x k个边界框。

Dense-to-sparse 方法

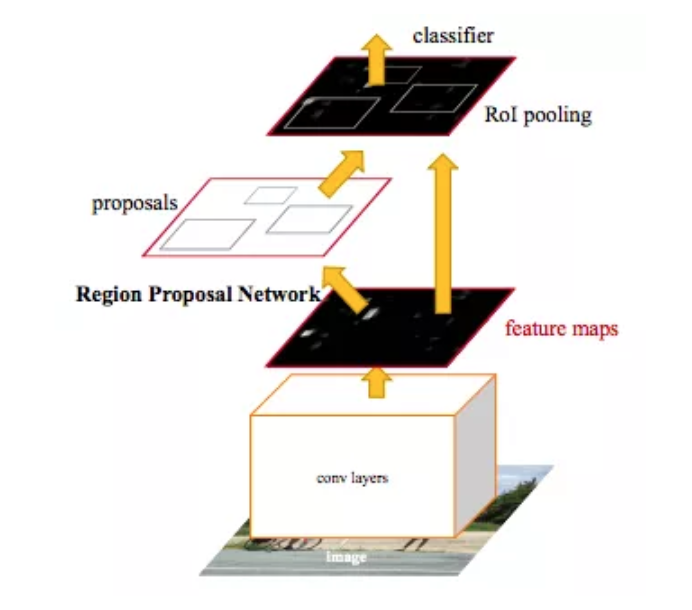

两阶段探测器,利用RPN产生dense的建议框,如Faster R-CNN论文提出的。这些探测器多年来一直主导着物体探测。

利用RPN算法从dense区域候选框中得到稀疏的前景框,然后对每个框的位置进行细化,并预测其具体类别。

与单阶段探测器的方法相似,它不是直接预测目标的类别,而是预测目标的概率。第二阶段通过objectness和包围框的overlap分数来进行预测类别的过滤。

Sparse 方法

本文将其新的Sparse R-CNN范式归类为现有目标检测范式的扩展,该范式包括从完全dense到dense-to-sparse,再加入新的步骤到完全sparse。

在论文中,避免了使用RPN,取而代之的是一组小的建议框(例如每幅图像100个)。这些框是通过网络的可学习的proposal boxes部分和proposal features部分来获得的。这种形式为每个proposal预测_4_个值*(x,y,h,w)*,后者为每个bbox预测一个长度为256的潜在表示向量。学习到的建议框作为一个合理的统计量来执行后续的细化步骤,学习到的建议特征用于引入注意力机制。这种机制与DETR论文中使用的机制非常相似。这些操作是在动态实例交互式head中执行的,我们将在下一节中介绍。

建议模型特征

正如论文的名称所暗示的那样,该模型是端到端的。结构很优雅。它由上述可学习的_proposal boxes_和_proposal features_以及动态实例交互头组成,这是本文神经网络架构的主要贡献。

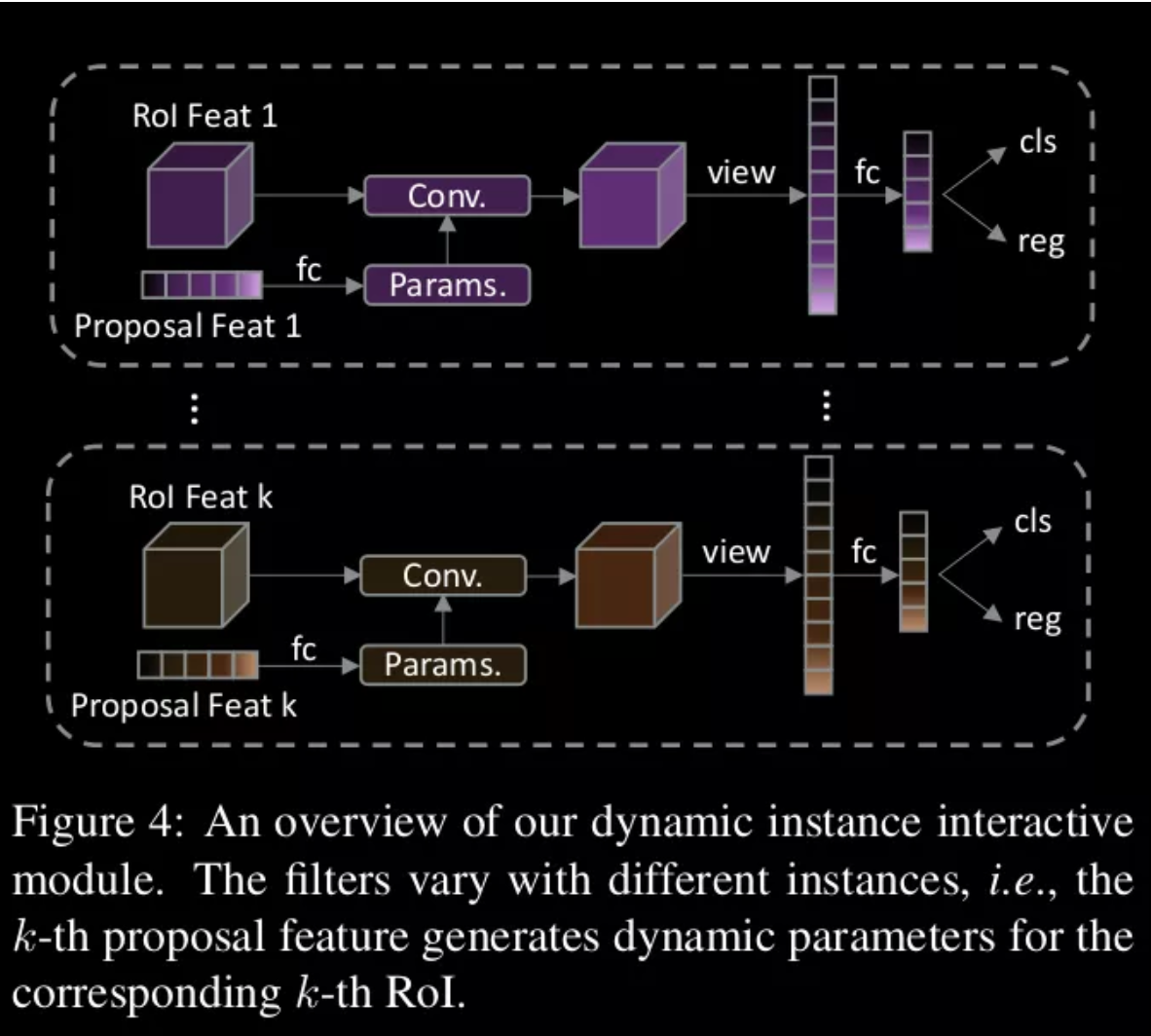

动态实例交互头

给定_N_个建议框,Sparse R-CNN首先利用RoIAlign操作针对每个由建议框定义的区域,从主干中提取特征。每个感兴趣区域的特征被输入到单独的头中用于目标的定位和分类,其中每个头以特定的可学习的建议特征为条件。

建议特征被用作卷积的权重,在上面的图像中它们被称为“参数”。RoI特征由这个产生的卷积来得到最终的特征。这样,那些最具前景信息的框对最终目标的位置和分类产生影响。在动态头部中嵌入自注意模块来推理物体之间的关系,并通过卷积影响预测。

主要结果

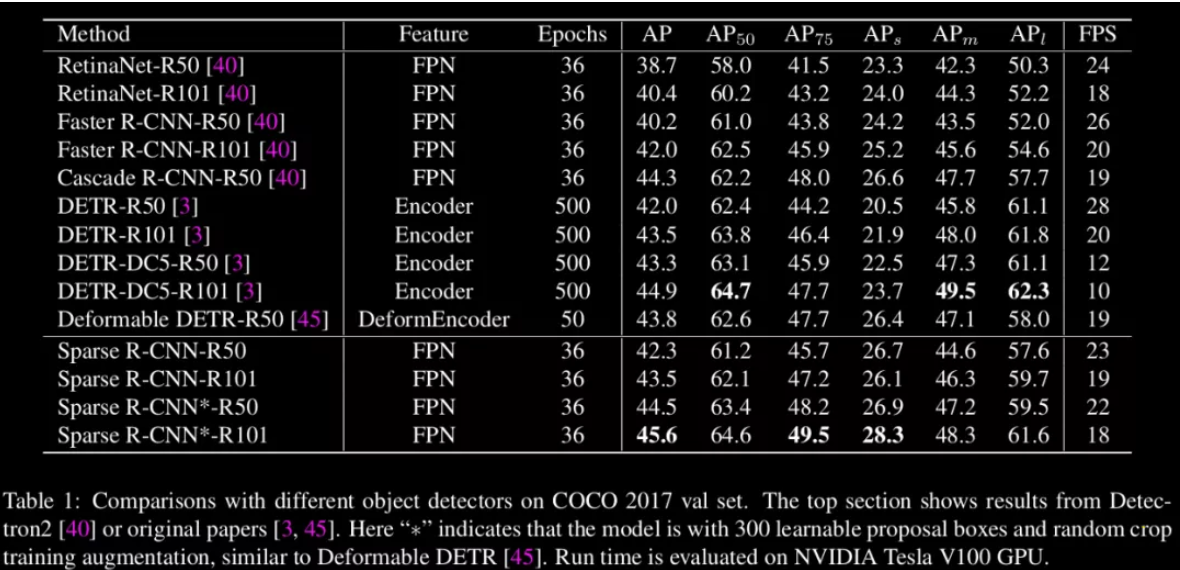

作者提供了几个对比表,显示这种新方法的性能。Sparse R-CNN与RetinaNet,Faster R-CNN和DETR在ResNet50和ResNet100的两个变体上的比较。

在这里我们可以看到稀疏的R-CNN在R50和R100上都比RetinaNet和Faster R-CNN更好,但是它的性能与基于DETR非常相似。

根据作者的观点,DETR模型实际上是密集到稀疏的模型,因为它利用稀疏的目标查询集,与全局(密集)图像特征交互。因此,与DETR相比,这篇文章的新颖之处就出现了。

在这张图片上,你可以看到COCO Dataset上模型推断的结果。在第一列中显示了学习的建议框,它们是对任何新图像的预测。在下一列中,你可以看到从建议中提炼出来的最终bbox。在迭代学习过程中,它们因阶段的不同而不同。

代码

最后,我想说的是,在2020年,我们看到很多论文将transformers应用到图像中。transformers 已经证明了它们在自然语言处理领域的价值,现在它们逐渐进入图像处理领域。这篇文章告诉我们,使用transformers ,有可能创造出快速的单级检测器,在质量方面可与目前最好的两级检测器相媲美。

代码:https://github.com/PeizeSun/S...

—END—

英文原文:https://medium.com/labelme/sp...

推荐阅读

关注图像处理,自然语言处理,机器学习等人工智能领域,请点击关注AI公园专栏。

欢迎关注微信公众号