导读

本文针对小目标检测,在CenterNet上进行了改进,将CenterNet上的一个中心点改成了4个中心点,取得了不错的效果,改动很小,但很有效。

Tiny Object Detection in Aerial Images

摘要:我们基于CenterNet,提出了一种多中心点的网络(M-CenterNet),可以提升小目标的检测能力,并且实验表明,该方法能够明显提升小目标检测效果。

1. 介绍

本文在CenterNet的基础上进行了改进,我们为每个物体定位多个中心点,并预测多个offset和尺度,我们的实验表明,我们的方法可以有效提升AI-TOD数据集上的表现。

本文的贡献如下:

- 我们介绍了AI-TOD,一个航拍小目标检测数据集,我们实验了当前的最先进的物体检测器在这个数据集上的表现。

- 我们提出了多个中心点的物体检测方法,M-CenterNet,用来做小目标检测,在AI-TOD数据集上在AP和oLRP指标上都达到了最好的效果。

2. 数据集

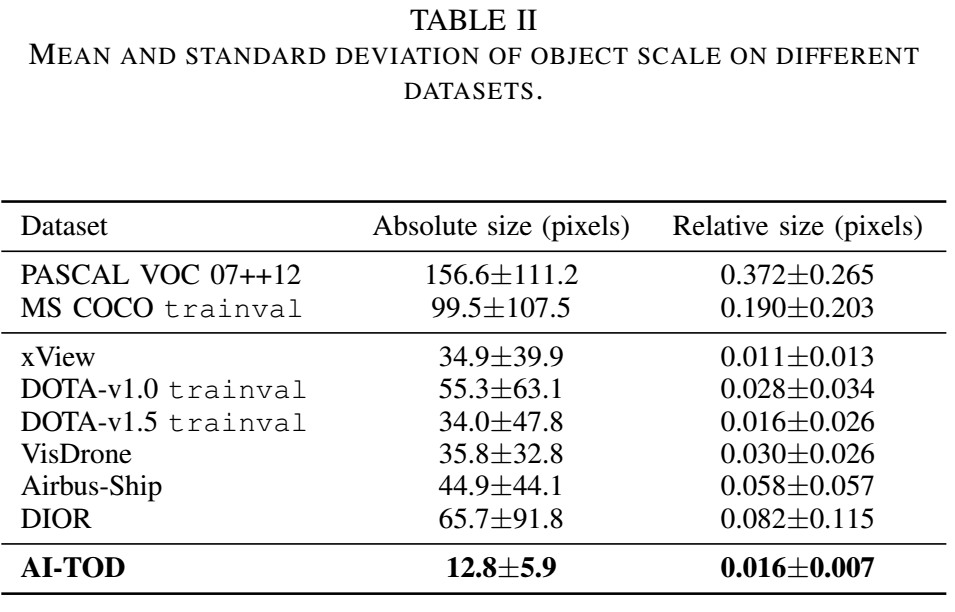

每个类别的数量:AI-TOD数据集包括700,621个标注目标,8个类别。图2a显示了一些不常见的类别,数量相比于其他常见的类别会少很多,这种类别不均衡的现象在航拍图像中是很常见的,在真实世界中也是很重要的。

每张图的目标数:图2b中可见,每张图中的目标数,最大可到2667个,比其他常见的数据集中要多很多。

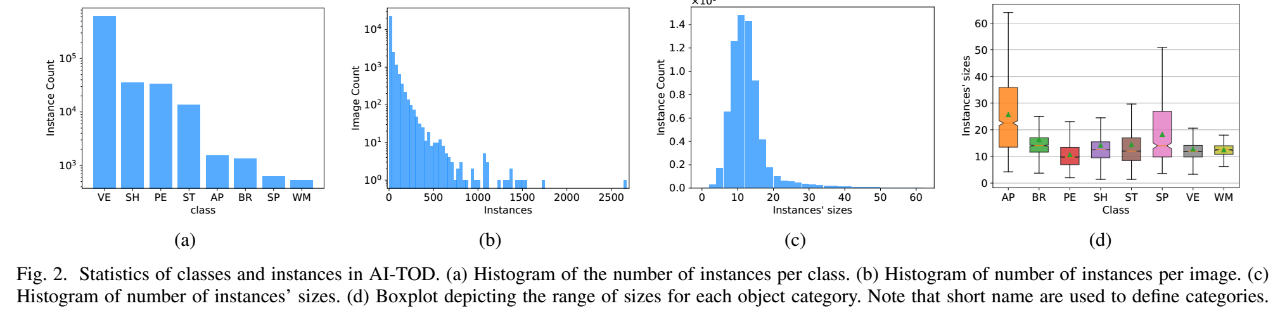

物体尺寸的分布:图2c中显示了尺寸分布的情况,大部分都是12个像素左右,见表2,均值和方差为12.8像素和5.9像素,比其他数据集中的尺寸要小很多。

物体尺寸的分类:我们把2~8像素的成为very tiny,8~16像素的为tiny,16 ~ 32像素的为small,32~64像素的为medium,没有大物体。比例分别为:13.3%,72.3%,12.3%,2.1%,具体见图2d。

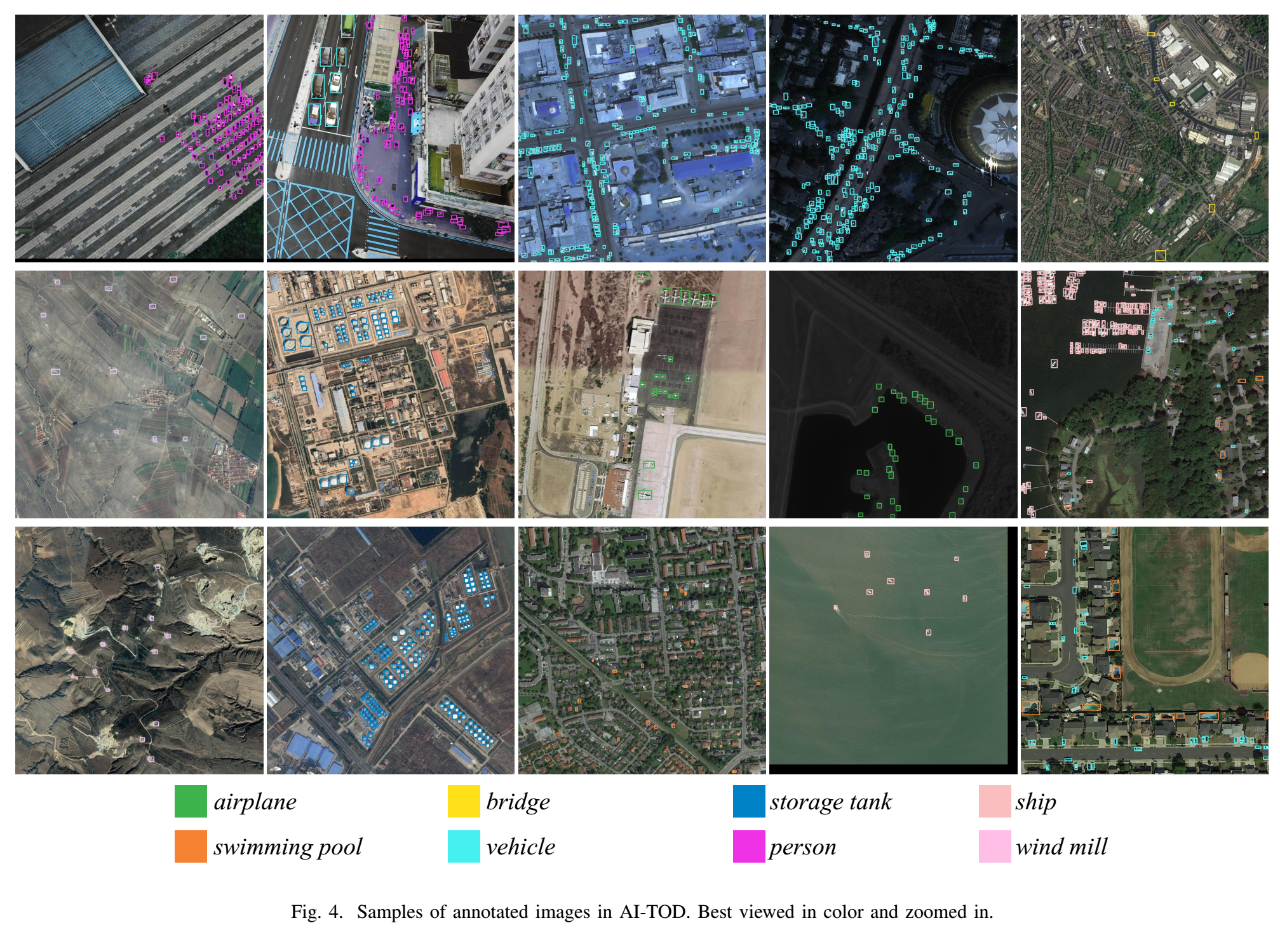

数据集中的一些样例图像如下:

3. 方法

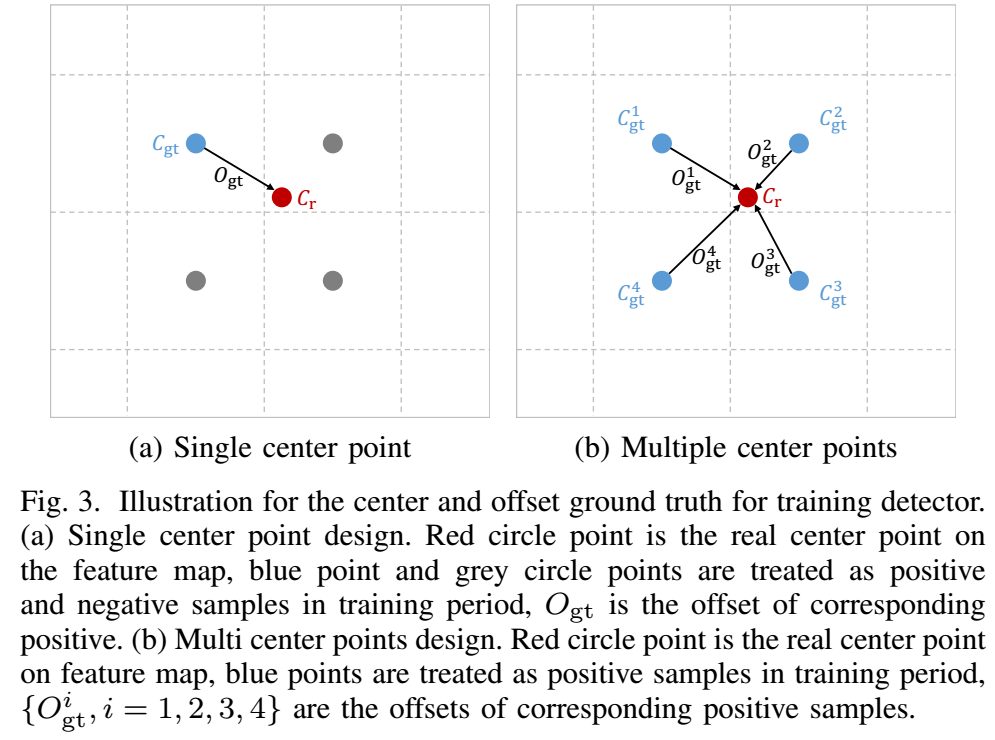

检测小目标需要比较大的分辨率的特征图,关键点预测网络可以输出高质量的高分辨率的特征图。我们提出的M-CenteNet是在CenterNet的基础上的改进。为了可以达到较好的检测效果,需要预测高质量的包围框,这个包围框需要和GT具有很高的IoU,但是,IoU对于小目标是很敏感的。所以,准确的定位对于提升小目标的检测是很重要的。图3是原始的CenterNet,使用了一个中心点作为gt,红点是特征图上的真实中心点,蓝色点和灰色点在训练的时候被分别作为正样本和负样本。是对应正样本的offset。在这种设计中,最多可能会有4个像素的偏差,因此,预测框和GT的IoU可能会小于0.5,这个物体就会漏掉。

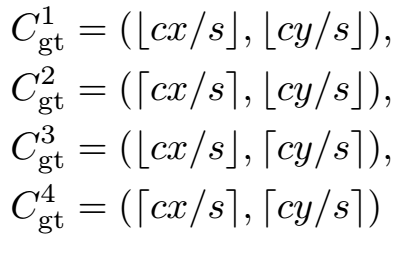

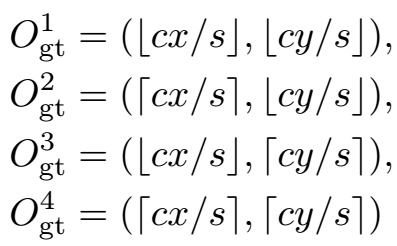

为了解决这个问题,我们使用了多个中心的设计,如图3b所示,我们把4个蓝色点都作为正样本,这4个点分别为:

对应的offset为:

其余的地方和CenterNet保持一致。在推理阶段,我们使用2x2平均池化来找中心点,使用NMS来过滤冗余框。

4. 实验

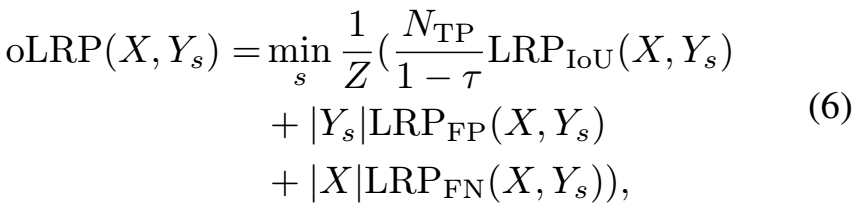

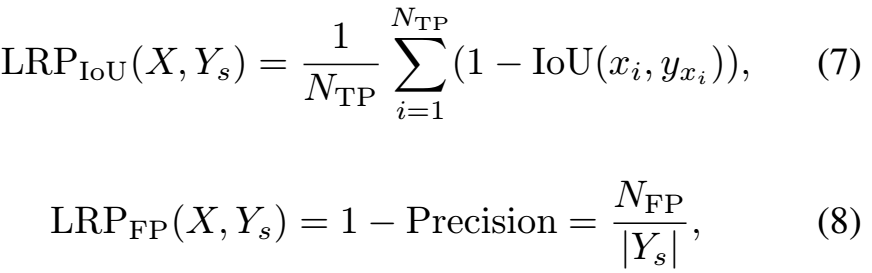

在评估的时候,我们使用了2个指标,一个是AP,另一个是Optimal Localization Recall Precision (oLRP) ,可以更好的评估定位的能力。oLRP的计算方法如下:

其中:

其中,τ是IoU的阈值,,,分别表示TP,FP和FN的数量。。

需要注意的是,AP的指标是越高越好,而oLRP是个错误指标,越低越好。

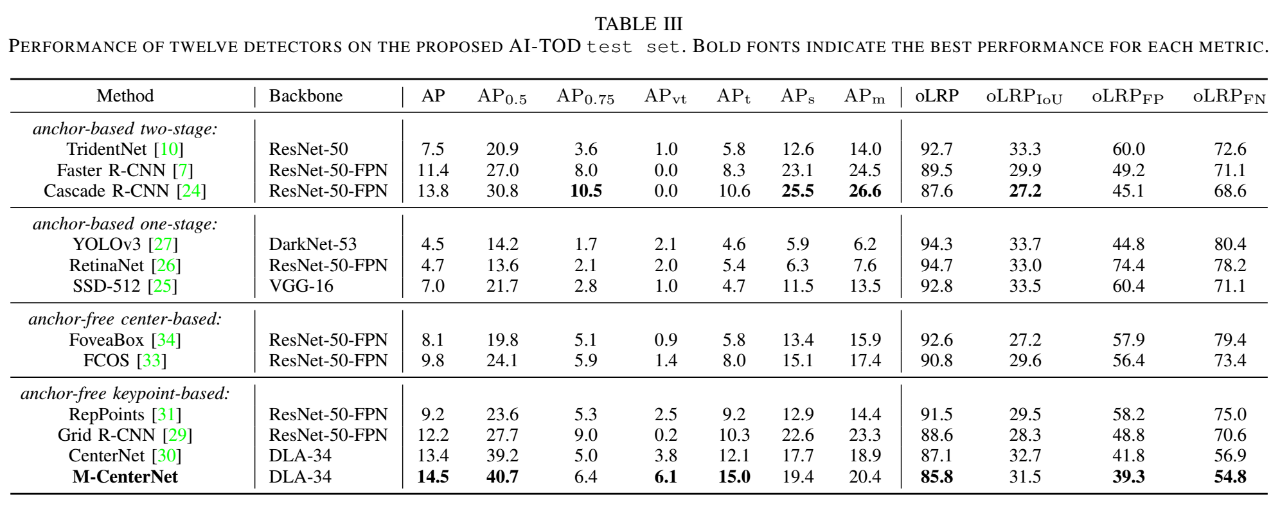

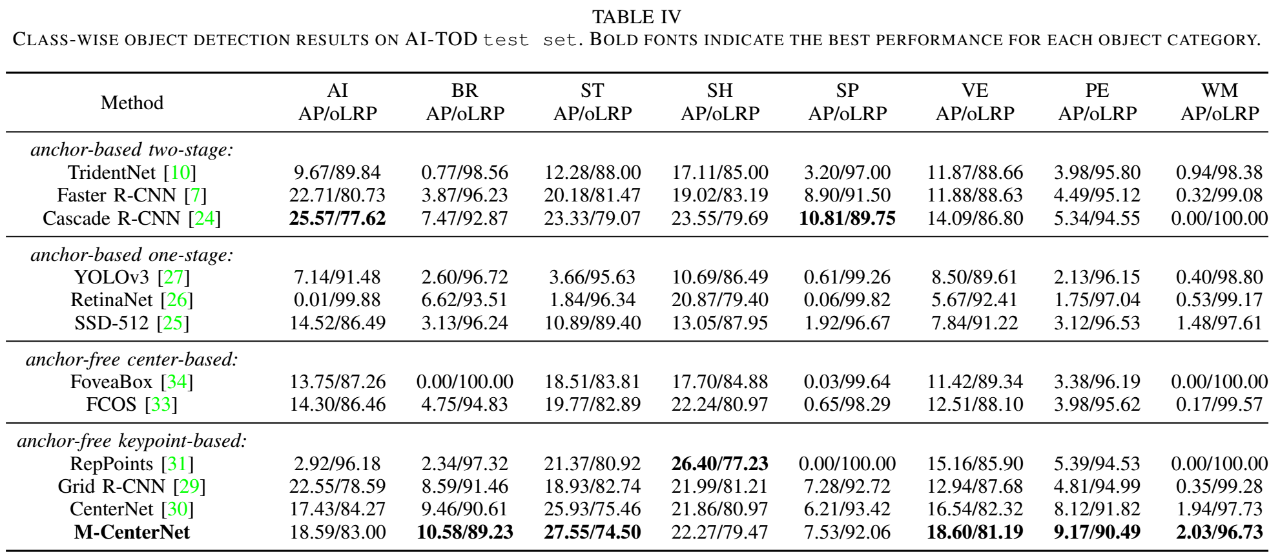

表3和表4是基线模型的结果,可以看到,这些方面在AI-TOD上的结果要比COCO上差很多

总体来说,anchor free的方法要更好一些,因为这些方法并不使用IoU来分配正负样本,而小目标又对IoU非常的敏感。M-CenterNet取得了最好的结果。

首发:AI公园公众号

作者:ronghuaiyang

推荐阅读

关注图像处理,自然语言处理,机器学习等人工智能领域,请点击关注AI公园专栏。

欢迎关注微信公众号