1、YOLOv8_Efficient的介绍

本项目基于ultralytics及yolov5等进行综合参考,致力于让yolo系列的更加高效和易用。

目前主要做了以下的工作:

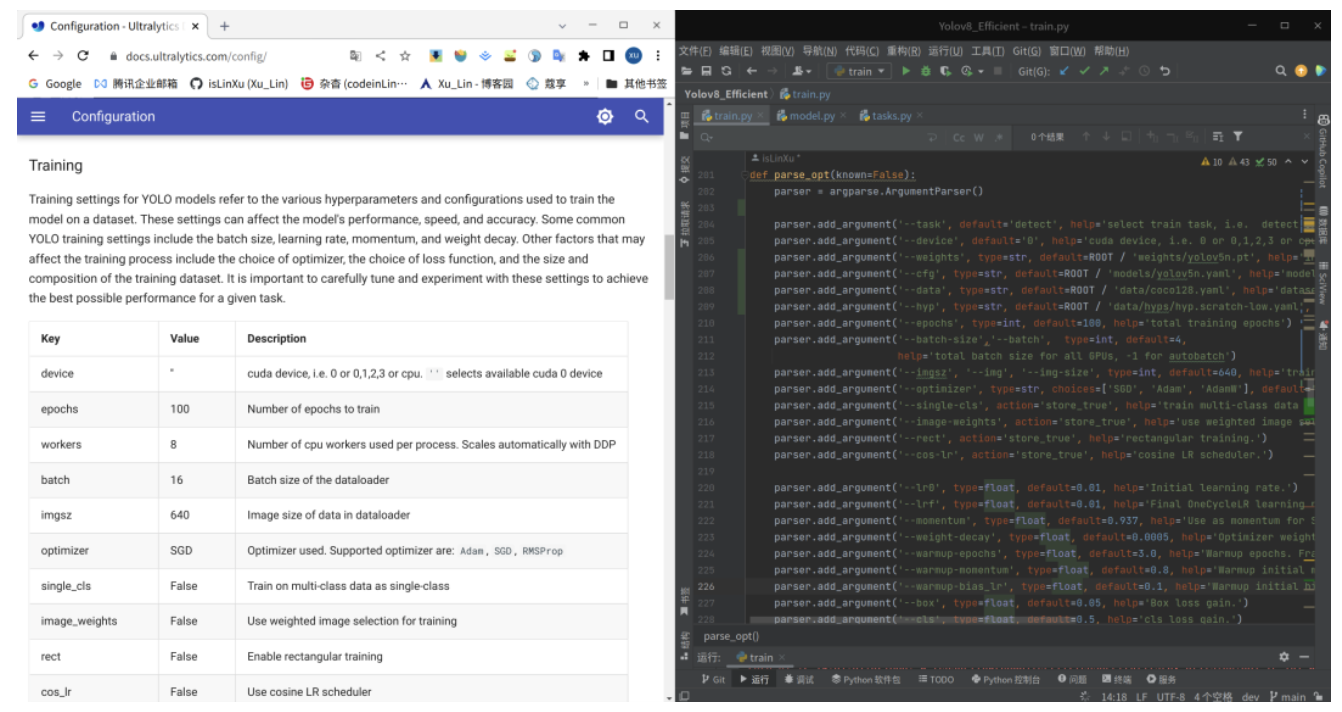

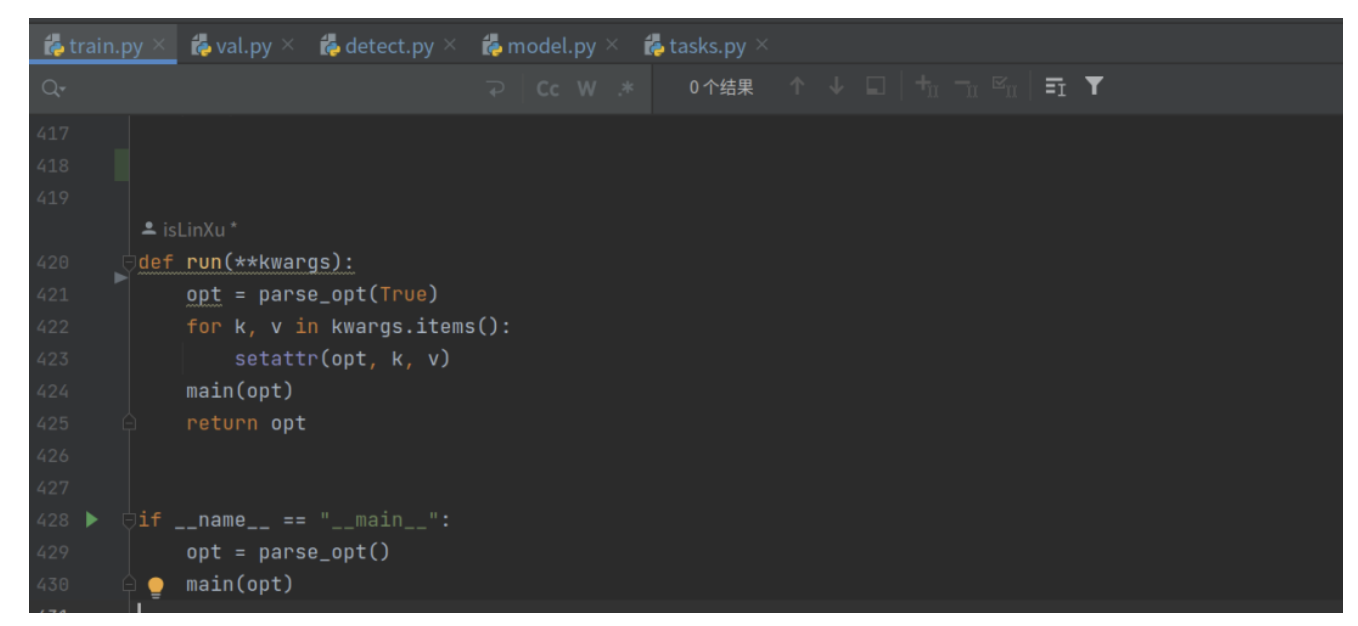

- 参考https://docs.ultralytics.com/config/中的Configuration参数,分别针对train.py、detect.py、val.py等做了相应参数的配置对齐。

- 结合yolov5的使用习惯以及代码结构做了兼容和优化。

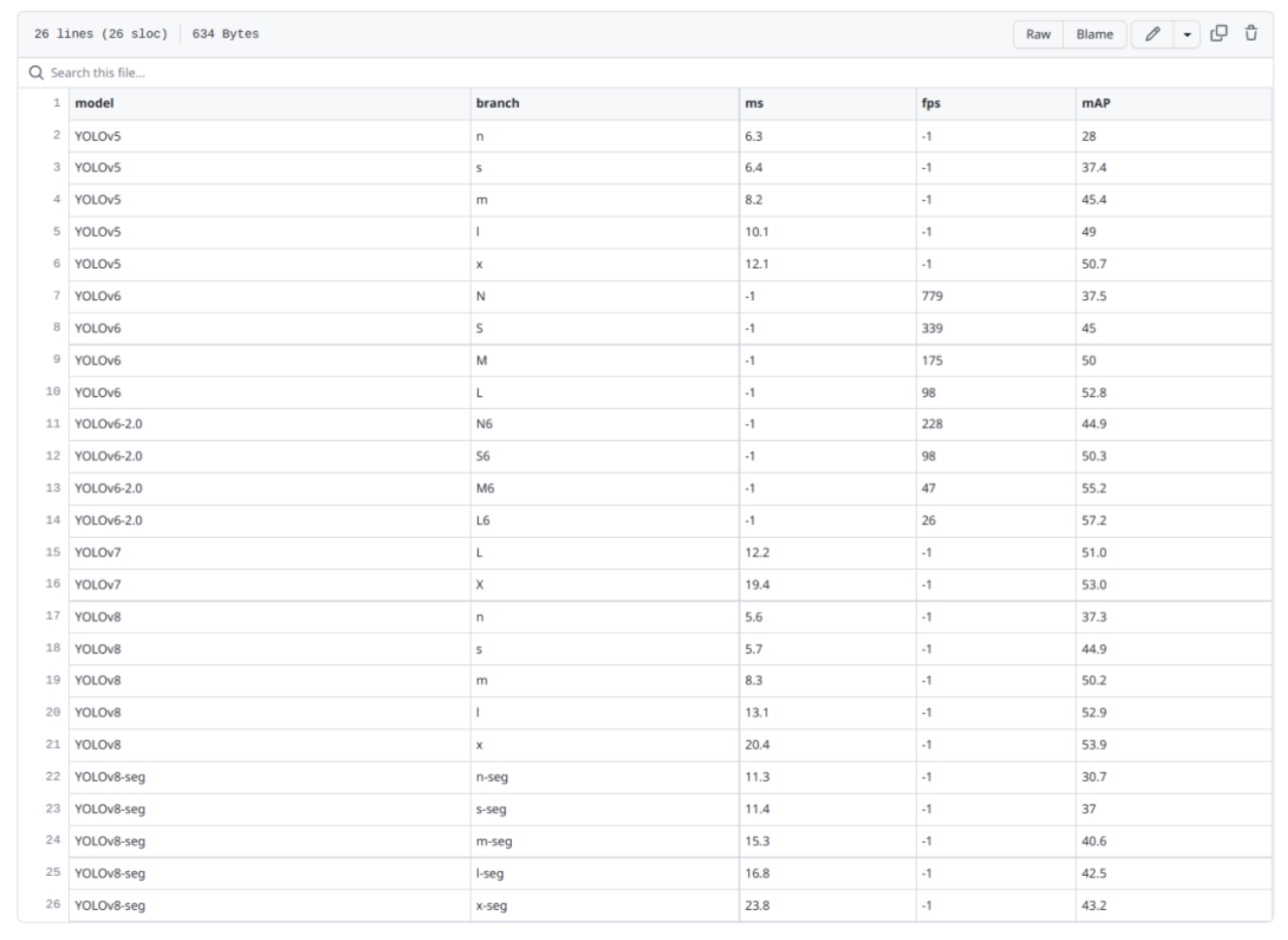

- 通过在coco数据集上在自己的机器上进行验证和计算的权重的指标参数,实验记录存放在https://github.com/isLinXu/YOLOv8\_Efficient/tree/main/log.实验数据记录在:

- 根据计算出来的结果绘制了相应的指标参数对比图,这个绘图程序也开源在https://github.com/isLinXu/model-metrics-plot中。

- 融合其他更多网络模型结构进行集成整合和配置,正在进行中...

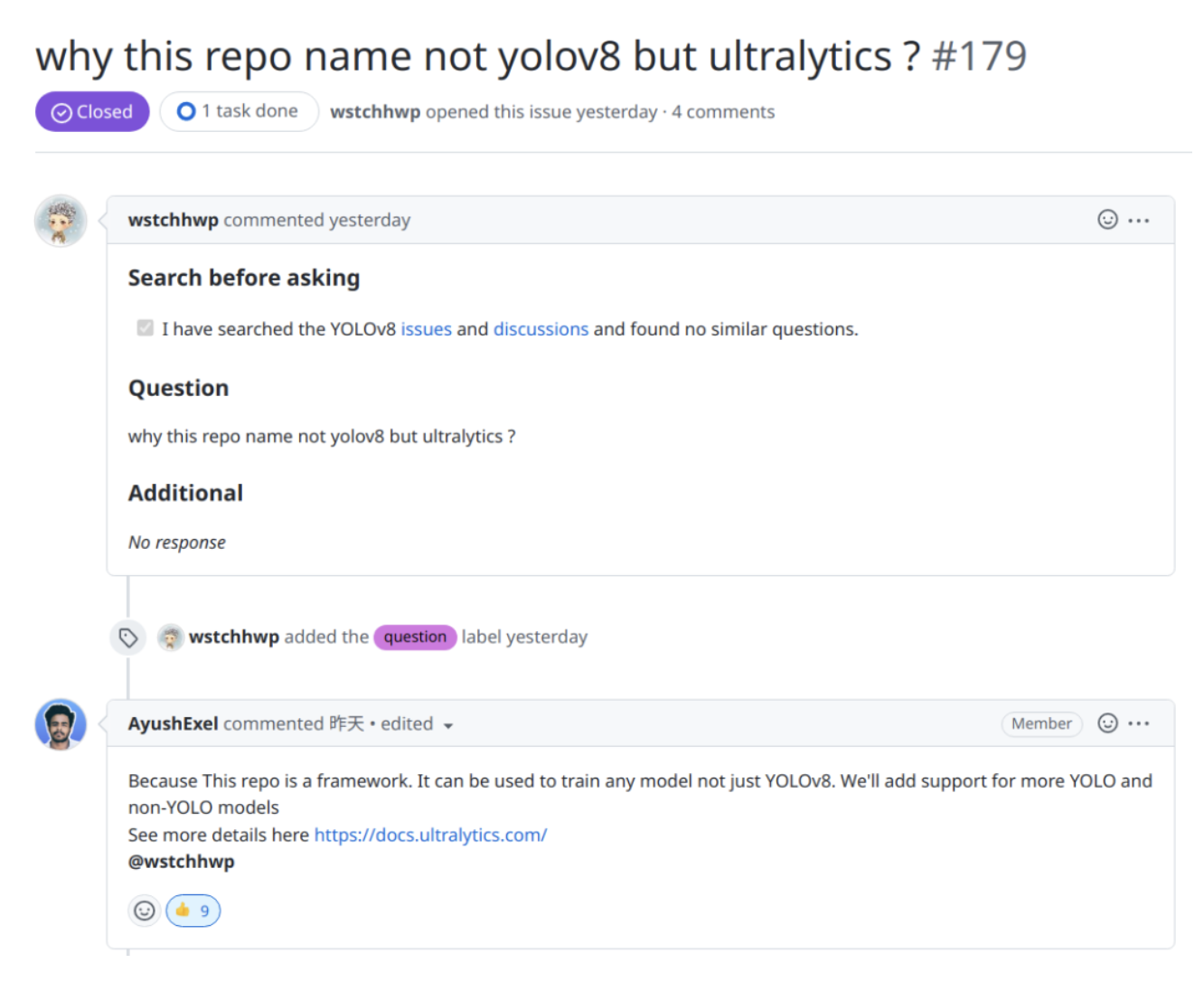

2、关于ultralytics的名字

为什么这个仓库取名为ultralytics,而不是yolov8,结合这个issue,笔者认为主要有以下几个方面的原因:

- 1.因为ultralytics团队希望将这个项目设计和建成一个集合分类,检测,分割等视觉任务的集成训练推理框架,而不仅仅只是yolov8。后续可能会有更多更全的网络模型会集成进来。

- 2.因为pypi.org上的第三方已经把yolov6,yolov7,yolov8等名字给取了,pip install名称的规则是不允许有重复名的。

issue链接:https://github.com/ultralytics/ultralytics/issues/179

3、关于自定义配置模型训练

结合上面的讨论,自然而然会有这个想法,既然ultralytics要建一个集成训练框架,那么能否直接在ultralytics仓库上直接配置和训练yolov5呢,笔者做了下面一系列的尝试:

- 在models中加入相应的.yaml文件和yolov5沿用的模块,如common.py、experimental.py、google_utils.py

- 在

models/common.py中,加入了yolov5所需的网络结构

class C3(nn.Module):

# CSP Bottleneck with 3 convolutions

def __init__(self, c1, c2, n=1, shortcut=True, g=1, e=0.5): # ch_in, ch_out, number, shortcut, groups, expansion

super().__init__()

c_ = int(c2 * e) # hidden channels

self.cv1 = Conv(c1, c_, 1, 1)

self.cv2 = Conv(c1, c_, 1, 1)

self.cv3 = Conv(2 * c_, c2, 1) # optional act=FReLU(c2)

self.m = nn.Sequential(*(Bottleneck(c_, c_, shortcut, g, e=1.0) for _ in range(n)))

def forward(self, x):

return self.cv3(torch.cat((self.m(self.cv1(x)), self.cv2(x)), 1))- 在运行时加入模块用于测试

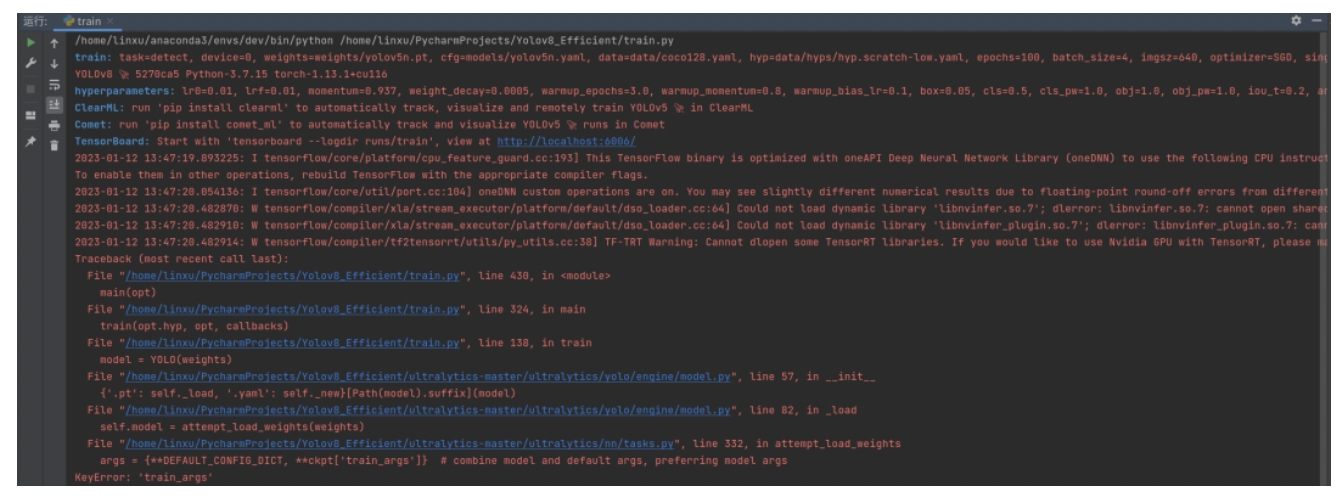

最后一通操作下来,已经可以根据yolov5s.yaml去读取网络结构了,但是在跑的时候还是报错。

报错信息如下:

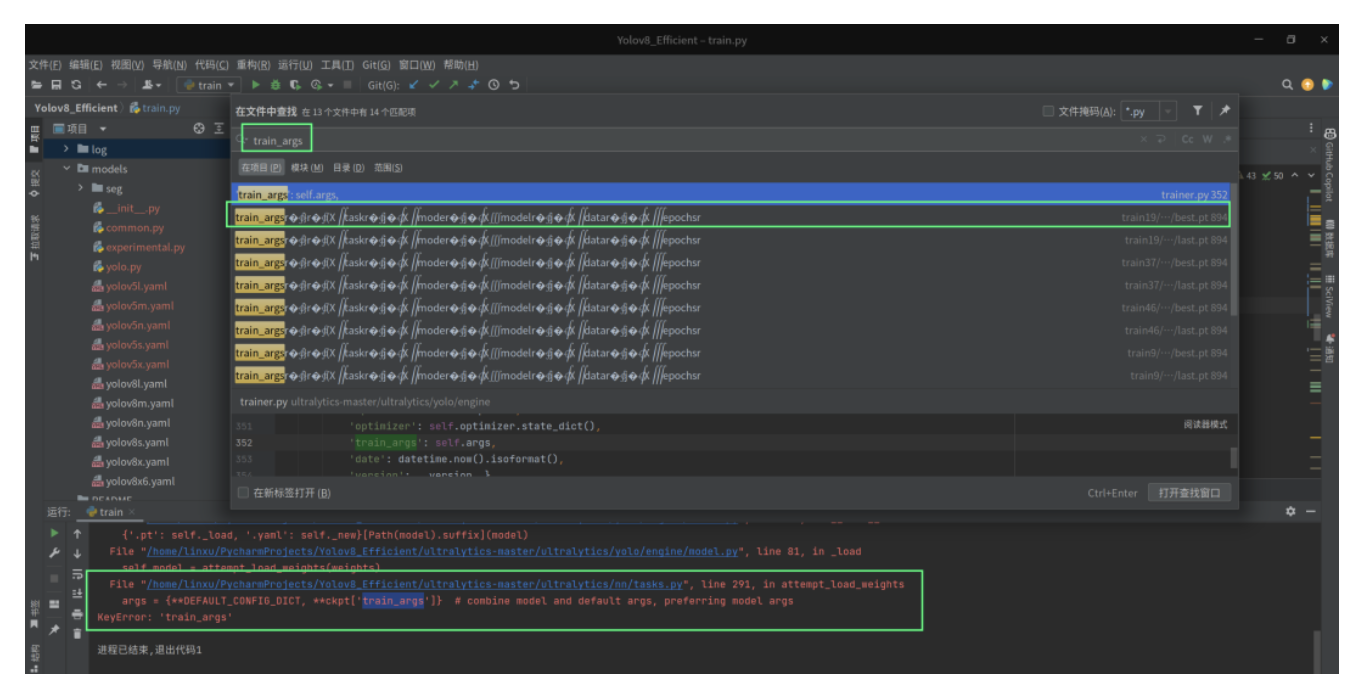

于是针对"train_args"做了一个全局搜索,发现了下面的结果:

可以看到,之前训练出来的v8的权重内包含了"train_args"的信息。顺着程序运行的流程,相应地发现了yolo/engine/model中的"__init__(self)"函数,

def __init__(self, model='yolov8n.yaml', type="v8") -> None:

"""

Initializes the YOLO object.

Args:

model (str, Path): model to load or create

type (str): Type/version of models to use. Defaults to "v8".

"""

self.type = type

self.ModelClass = None # model class

self.TrainerClass = None # trainer class

self.ValidatorClass = None # validator class

self.PredictorClass = None # predictor class

self.model = None # model object

self.trainer = None # trainer object

self.task = None # task type

self.ckpt = None # if loaded from *.pt

self.ckpt_path = None

self.cfg = None # if loaded from *.yaml

self.overrides = {} # overrides for trainer object

self.init_disabled = False # disable model initialization

# Load or create new YOLO model

{'.pt': self._load, '.yaml': self._new}[Path(model).suffix](model)

读取模型和配置是在"__init__"的最后一行:

`# Load or create new YOLO model

{'.pt': self._load, '.yaml': self._new}Path(model).suffix

`

而def _load(self, weights: str):中实际读取模型权重的实现是self.model = attempt_load_weights(weights)。可以看到,相比于yolov5,v8读取权重的函数attempt_load_weights,多了下面这行

args = {**DEFAULT_CONFIG_DICT, **ckpt['train_args']} # combine model and default args, preferring model args 那么,能否直接将v5的项目中,将相应的函数补充过来给v8做适配呢,自然是可以的,当笔者将model.py的_load函数中这行代码:

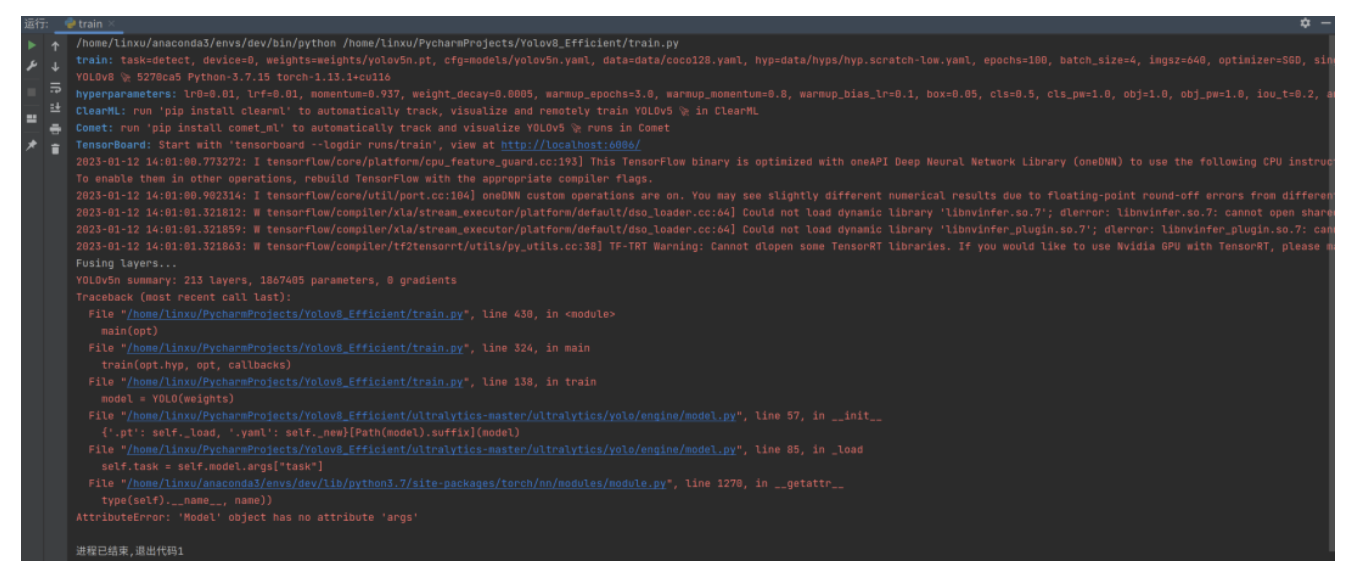

self.model = attempt_load_weights(weights)替换为下面这行时:

self.model = attempt_load(weights) 重新运行了一遍,发现又出现了下面的问题:

错误信息为AttributeError: 'Model' object has no attribute 'args',既然是Model定义和配置上的问题,那么就没有再往下修改的必要了,还是等官方团队的更新和修改吧,等等党永远不亏。

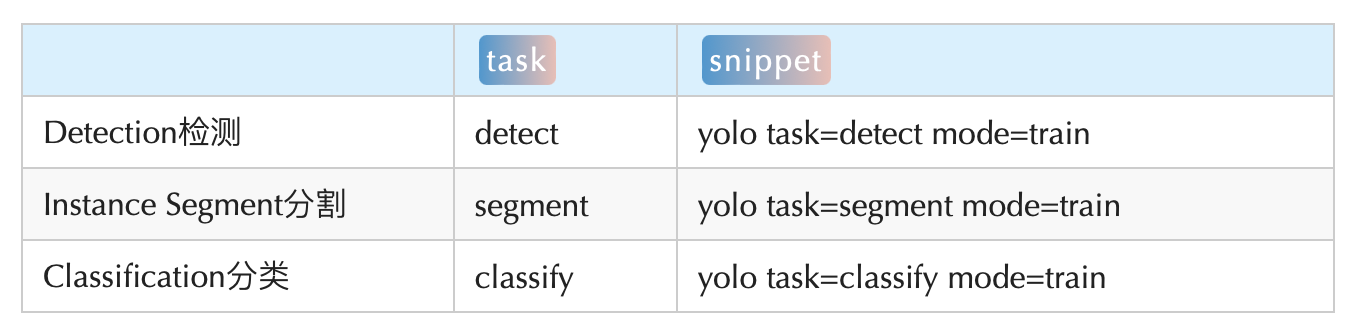

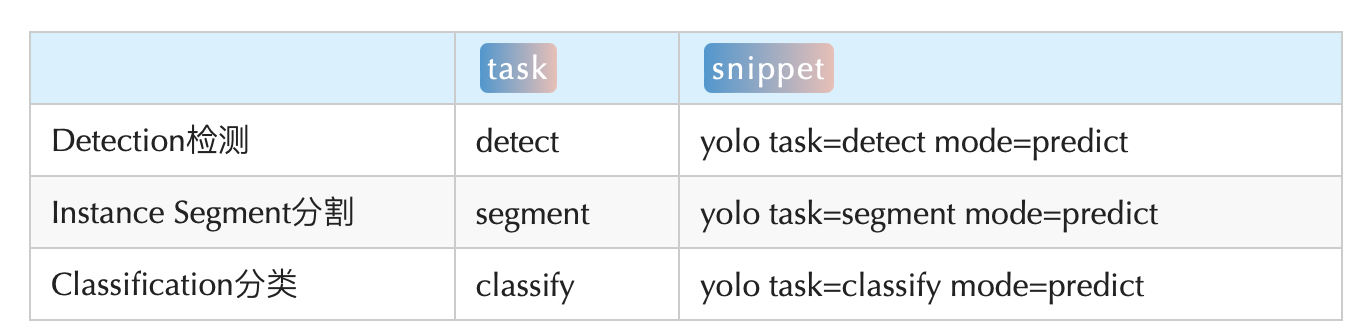

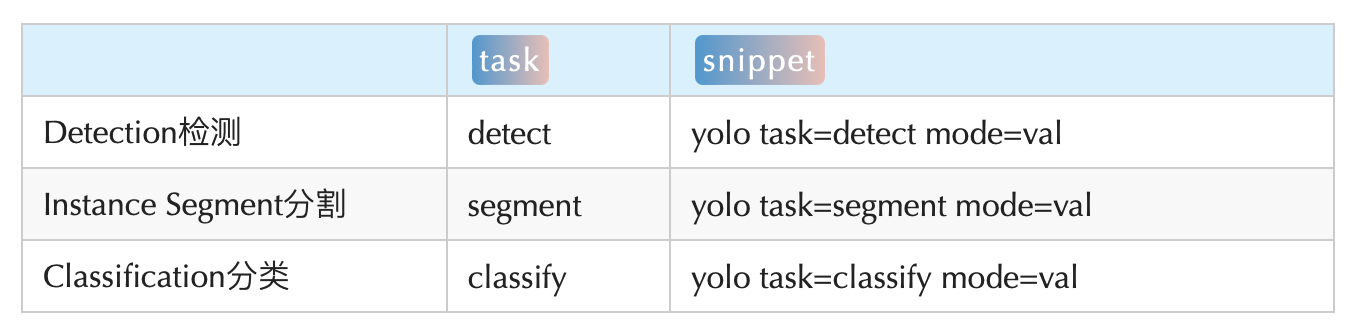

4、关于v8的多任务使用

根据官方的文档介绍,还有对代码的分析,目前v8项目是支持检测、分类和分割的。设定是通过"task"进行区分任务,又通过mode来设置是训练还是检测的模式,如下使用:

yolo task=detect mode=train model=yolov8n.yaml epochs=1 ...

... ... ...

segment predict yolov8n-seg.pt

classify val yolov8n-cls.pt

4.1、训练

4.2、预测

4.3、验证

- !关于这三个任务,YOLOv8\_Efficient项目后续会分别设置相应的模块用于执行,目前正在更新中。

5、附件

5.1、YOLOv8读取权重

def attempt_load_weights(weights, device=None, inplace=True, fuse=False):

# Loads an ensemble of models weights=[a,b,c] or a single model weights=[a] or weights=a

from ultralytics.yolo.utils.downloads import attempt_download

model = Ensemble()

for w in weights if isinstance(weights, list) else [weights]:

ckpt = torch.load(attempt_download(w), map_location='cpu') # load

args = {**DEFAULT_CONFIG_DICT, **ckpt['train_args']} # combine model and default args, preferring model args

ckpt = (ckpt.get('ema') or ckpt['model']).to(device).float() # FP32 model

...

5.2、YOLOv5读取权重

def attempt_load(weights, device=None, inplace=True, fuse=True):

# Loads an ensemble of models weights=[a,b,c] or a single model weights=[a] or weights=a

from models.yolo import Detect, Model

model = Ensemble()

for w in weights if isinstance(weights, list) else [weights]:

ckpt = torch.load(attempt_download(w), map_location='cpu') # load

ckpt = (ckpt.get('ema') or ckpt['model']).to(device).float() # FP32 model

...

6、参考

[1].https://github.com/isLinXu/YOLOv8\_Efficient.

[2].https://github.com/isLinXu/model-metrics-plot.

作者: 小书童

文章来源: 集智书童

推荐阅读

- 目标检测提升技巧 | 结构化蒸馏一行代码让目标检测轻松无痛涨点

- 基于Opencv实现眼睛控制鼠标

- 回顾2022年计算机视觉领域最激动人心的进展

- 量化部署篇 | Vision Transformer应该如何进行PTQ量化?这个方法或许可以参考!

- 自制深度学习推理框架-前言-第一课

- YOLOv6精度提升的又一根稻草,感知量化的重参再设计,QARep值得内卷

更多嵌入式AI干货请关注嵌入式AI专栏。欢迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。