技术信仰 价值务实

在使用自动驾驶 3D 目标检测算法时,你是否困扰于“既想也想”的问题?既想用单模态检测器以节省传感器成本,并且加快检测速度,也想获得其它模态的知识以得到更高的检测精度。为此,旷视研究院 AI 计算组提出了统一的跨模态知识蒸馏框架——UniDistill,它克服了传统知识蒸馏框架的缺陷,不仅支持多种模态组合的蒸馏路径,还能让单模态检测模型的性能大幅提升。下面带领大家感受一下这种全新的跨模态知识蒸馏框架。

开源代码:

https://github.com/megvii-research/CVPR2023-UniDistill

论文链接:

http://arxiv.org/abs/2303.15083

01 背景

根据输入数据的模态,目前的 3D 检测模型可以分为单模态检测模型(camera或LiDAR)与多模态检测模型(camera+LiDAR),其中,单模态检测模型的性能较差,而多模态检测模型设计复杂、计算量大,且在实际使用过程中,若是某一模态出现问题,则会检测失败。提升单模态检测模型性能的一种方式是使用跨模态知识蒸馏,将另一不同模态的 teacher 检测模型的知识迁移至 student 检测模型,然而如下图两种已有的蒸馏框架图所示,目前的知识蒸馏框架存在以下缺陷:

(1)完全统一了 teacher 和 student 检测模型的框架,在输入端对不同模态数据进行变换,损失了该模态数据的深层信息;

(2)完全固定了 teacher 和 student 的模态,实际应用场景会受到限制。

为此,我们提出了一种在鸟瞰视角(BEV)下进行的统一跨模态蒸馏框架。我们观察到,现在的高性能模型都是在 BEV 下进行检测,并且可抽象成统一的检测流程,生成统一的中间特征,后处理形成最后检测结果。因此可以对这些在 BEV 下的特征进行蒸馏,从而无需限制 teacher 和 student 的模态以及模型。在 nuScenes 数据集下的实验证明,当使用 UniDistill 进行蒸馏后,student 检测器的 mAP 和 NDS 能提升2.0%~3.2%,且基于 LiDAR 的 student 检测器性能超过了现有的一些 SOTA 方法。

02 具体方法

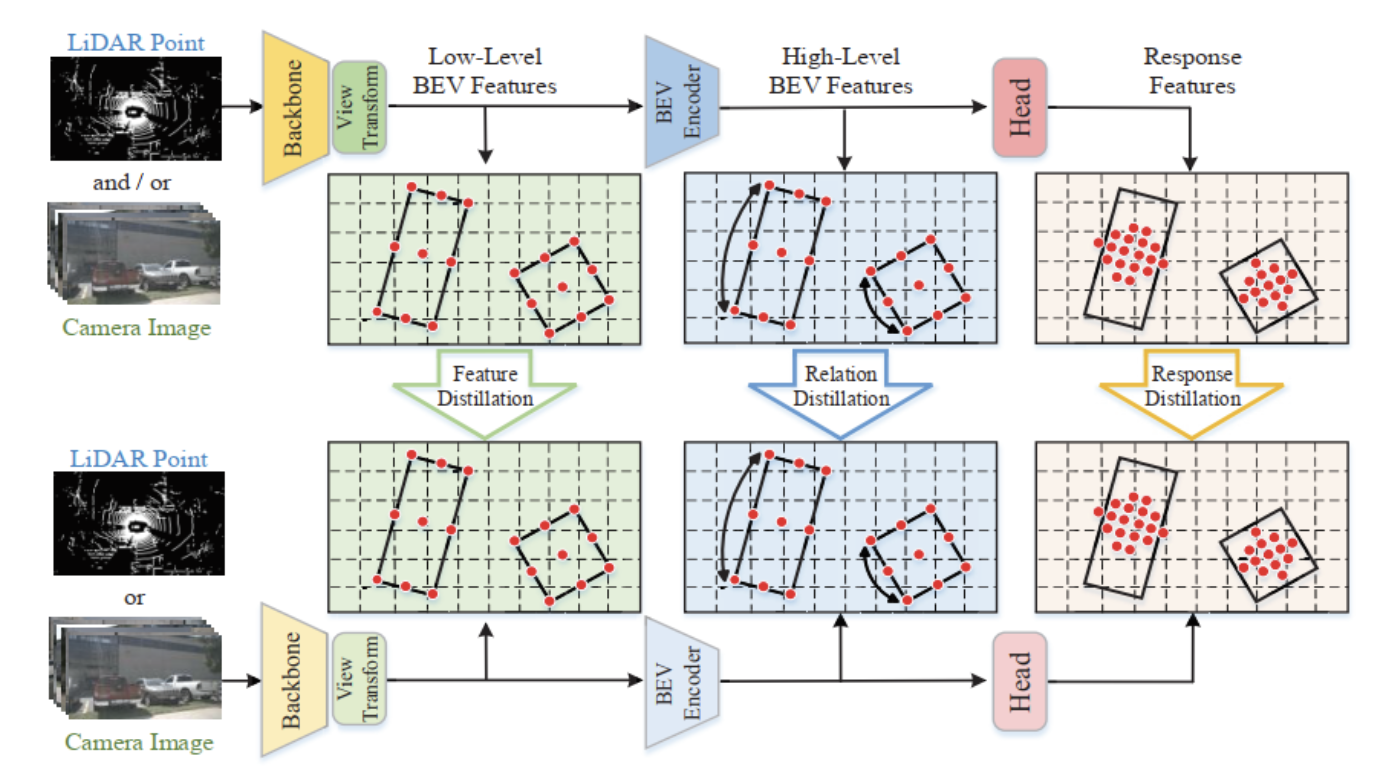

上图是 UniDistill 的主要流程。Teacher 和 student 检测模型都可以抽象成三个阶段:

(1)第一个阶段提取输入特征,通过视角变换投影至 BEV 下,得到浅层 BEV 特征;

(2)第二阶段继续对 BEV 特征进行编码,得到深层 BEV 特征;

(3)检测头根据深层特征生成响应特征,用于后处理形成检测结果。因此可以在这三类特征上进行知识蒸馏,从而统一蒸馏框架。

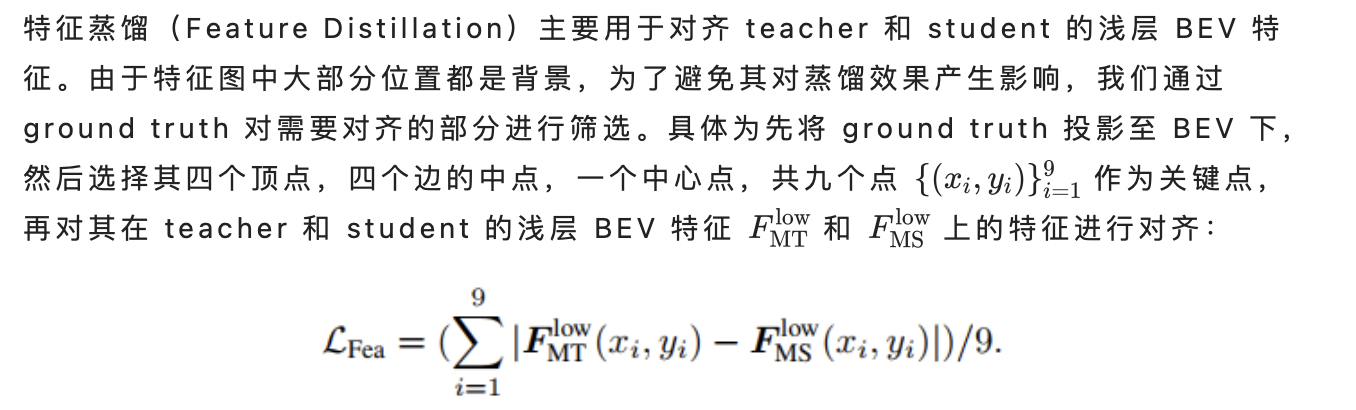

特征蒸馏

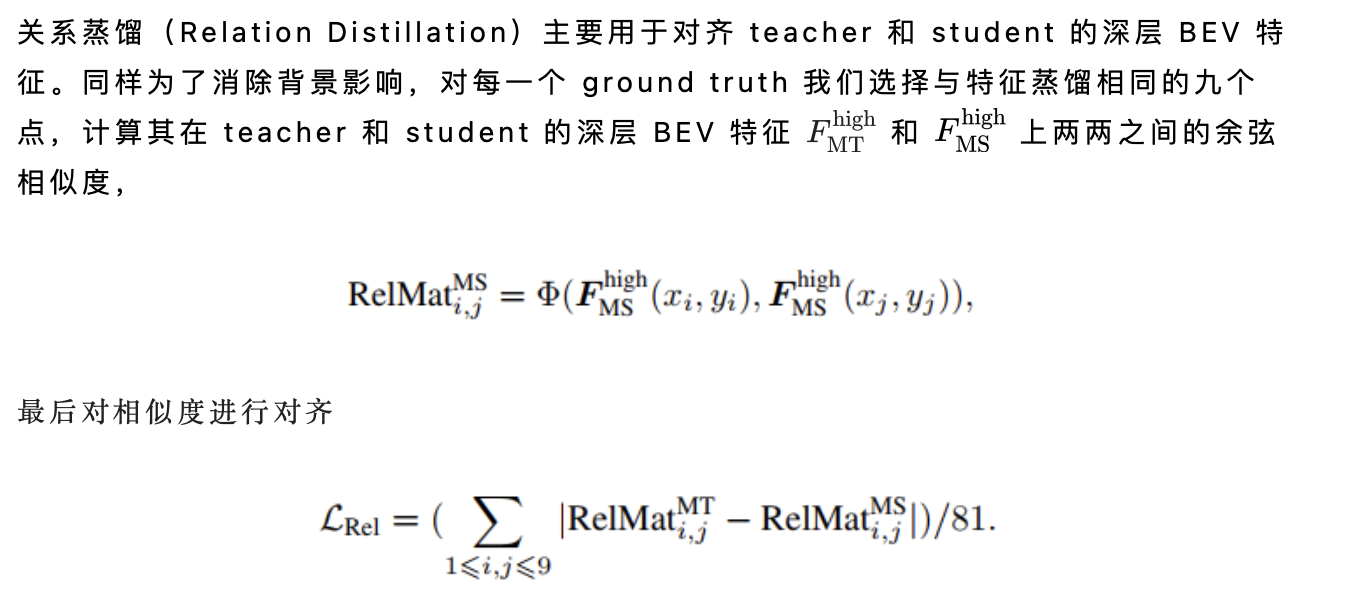

关系蒸馏

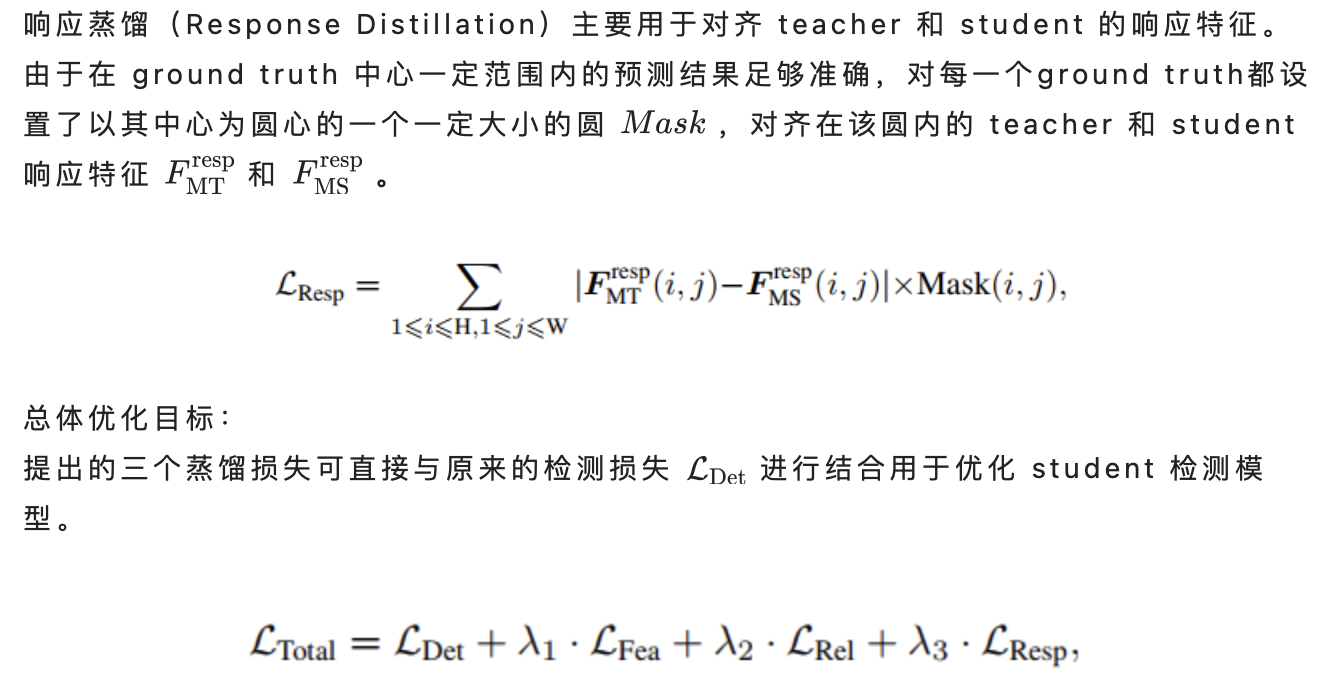

响应蒸馏

03 实验

训练 UniDistill 的过程中,我们选用 Centerpoint [3],BEVDet [4],以及 BEVFusion [5]作为其中的 LiDAR 检测模型,camera 检测模型以及多模态检测模型,并以 nuScenes 作为数据集。

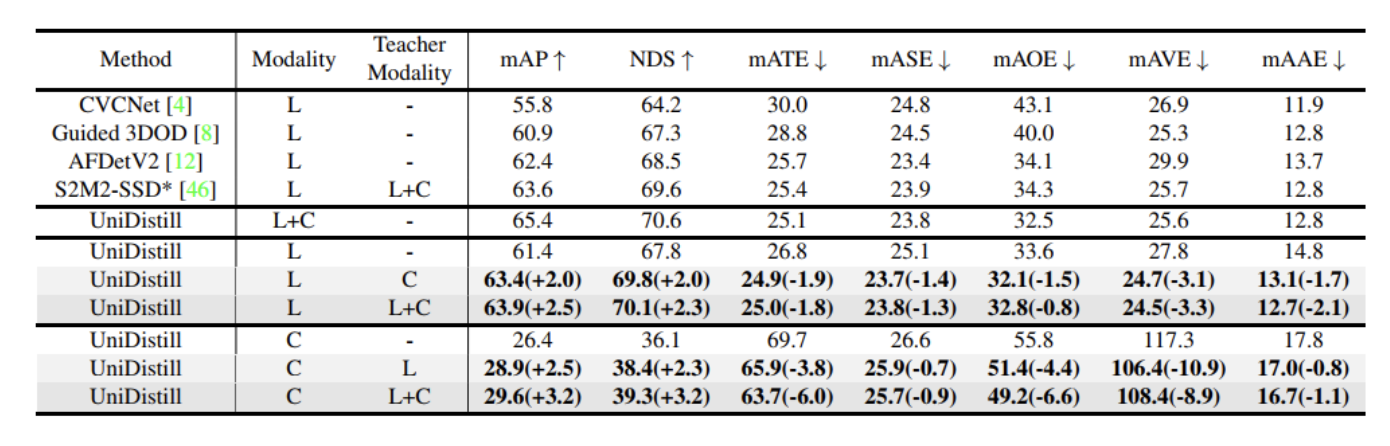

指标对比

上表是在 nuScenes 测试集上的结果,可以看到 UniDistill 能够在不同模态组合的情况下提升 student 检测模型的性能,且蒸馏后的 LiDAR 检测器性能超过了一些 SOTA 方法。

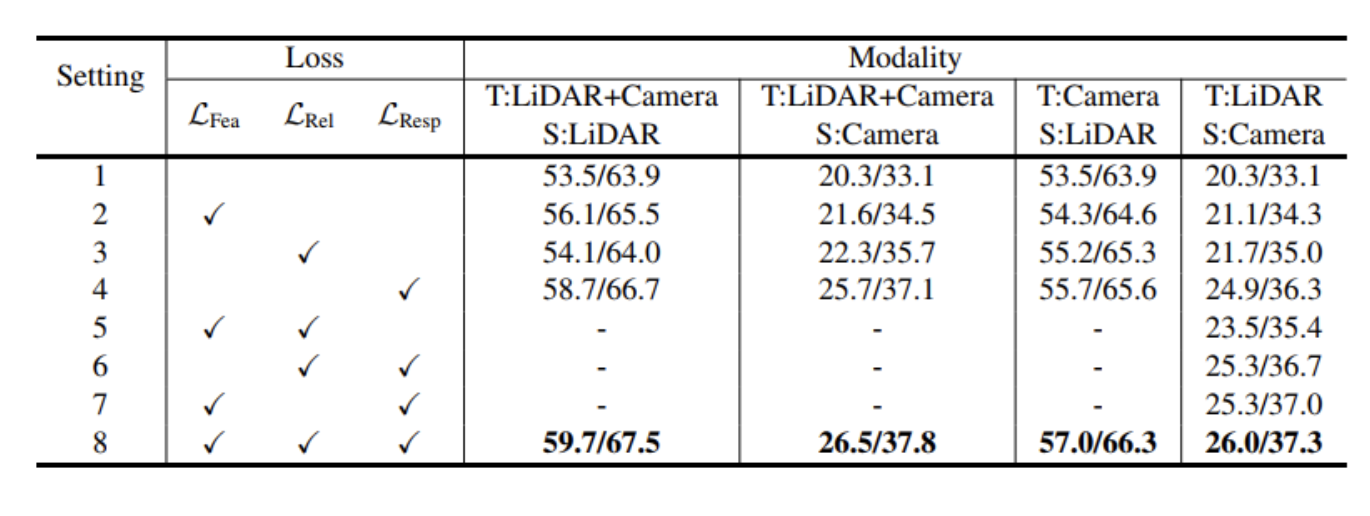

消融实验

上表是在 nuScenes 验证集上的结果,可以看到每一种蒸馏损失都能特征 student 的性能,且相互之间共同使用能进一步提升性能。

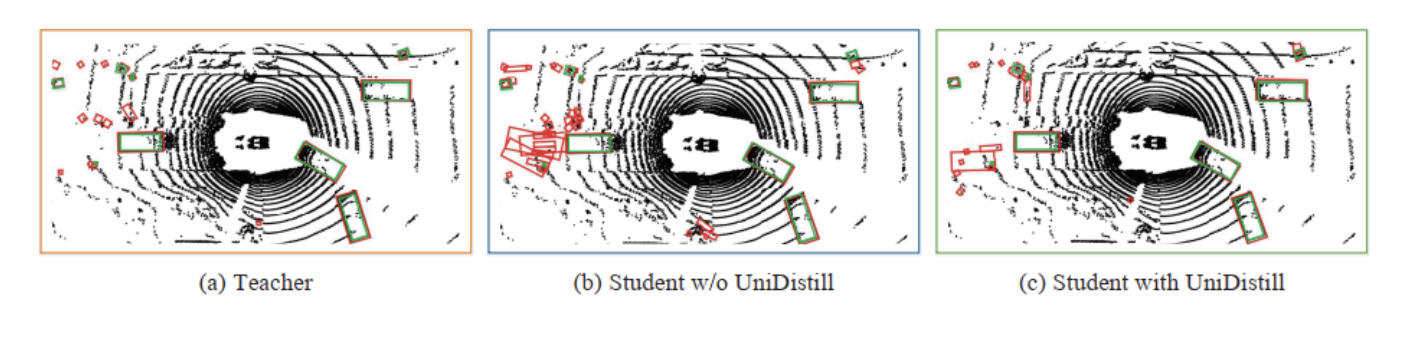

定性实验

上图是在 nuScenes 验证集上的可视化结果。

(a)为 fusion 检测模型作为 teacher 的结果,

(b)是 LiDAR 检测模型作为 student 且不使用 UniDistill 的结果,

(c)为 LiDAR 检测模型作为 student 且使用 UniDistill 的结果。显示了UniDistill 能较好地去除 false positive 预测框。

04 总结

在这项工作中,我们提出了一种在 BEV 下统一的跨模态知识蒸馏框架,将其命名为 UniDistill。我们在 nuScenes 数据集上训练 UniDistill,实验结果表明,UniDistill 能够在多种 teacher 和 student 模态组合的情况下提升 student 检测模型的性能。

引用

[1] Zhiyu Chong, Xinzhu Ma, Hong Zhang, Yuxin Yue, Haojie Li, Zhihui Wang, and Wanli Ouyang. Monodistill: Learning spatial features for monocular 3d object detection. In International Conference on Learning Representations, 2021

[2] Wu Zheng, Mingxuan Hong, Li Jiang, and Chi-Wing Fu. Boosting 3d object detection by simulating multimodality on point clouds. In Proceedings of the IEEE/CVF Conference on Computer Vision and Pattern Recognition, pages 13638–13647, 2022.

[3] Tianwei Yin, Xingyi Zhou, and Philipp Krahenbuhl. Centerbased 3d object detection and tracking. In Proceedings of the IEEE/CVF conference on computer vision and pattern recognition, pages 11784–11793, 2021.

[4] Junjie Huang, Guan Huang, Zheng Zhu, and Dalong Du. Bevdet: High-performance multi-camera 3d object detection in bird-eye-view. arXiv preprint arXiv:2112.11790, 2021

[5] Zhijian Liu, Haotian Tang, Alexander Amini, Xinyu Yang, Huizi Mao, Daniela Rus, and Song Han. Bevfusion: Multitask multi-sensor fusion with unified bird’s-eye view representation. arXiv preprint arXiv:2205.13542, 2022.

来源:旷视研究院

作者:旷视研究院

专栏文章推荐

欢迎关注旷视研究院极术社区专栏,定期更新最新旷视研究院成果。欢迎添加极术小姐姐微信(id:aijishu20)加入技术交流群,请备注研究方向。

加入旷视:career@megvii.com