由于大模型的成功经验,整个 AI 领域纷纷转向,要么是将模型架构换为 Transformer,要么是将小模型换为大模型,要么是将建模方式换为自监督、自回归范式等等。

GPT-4 推出后,各种 demo 充斥网络空间,写代码、做游戏、画图、写文案等新奇功能令人印象深刻。基于大模型的办公应用产品在近日已成为产业最热点。

然而,GPT-4 有一些非常明显的缺陷,甚至对简单的数学运算不擅长,即使是加法。如果让其展开推导过程,准确率则会大幅提升。而这两点又是与其序列生成的推理方式极其相关的。

GPT-4 采用了自回归建模方式,自回归是一种序列生成范式,从已输入的 token 序列推理下一个可能出现的 token。微软的学者通过系统的实验后指出,由于序列生成的方式使得 GPT-4 的工作记忆非常短,所以只能解决有成熟方案的问题。即便它能做复杂的微积分推理,面对简单小学数学问题的新颖变化,它也会反应不过来。通过展开解题过程提高准确率的现象,只是序列生成的自然特点。因此,GPT-4 的训练范式有天然的局限性。数学家陶哲轩也认为,GPT-4 是很好用的工具,但也仅限于工具,解决不了新的数学问题。

GPT-4 的训练数据源于互联网,但互联网的数据是否能够完整表达现实世界?我们可以把 GPT-4 生成的文案、作业、小游戏拿去交付,但可以拿它生成的建筑工程方案落地实施吗?归根结底,GPT-4 也处于一个更庞大的信息茧房里。对于现实世界的复杂性,互联网还没有足够的承载空间。

即便大模型已成为行业趋势,人工智能从业者仍然需要扎根经典技术和现实场景来构建准确、高效的人工智能应用,这是数据智能时代的基本实践之道,也是 DataFun 一直不忘的使命。

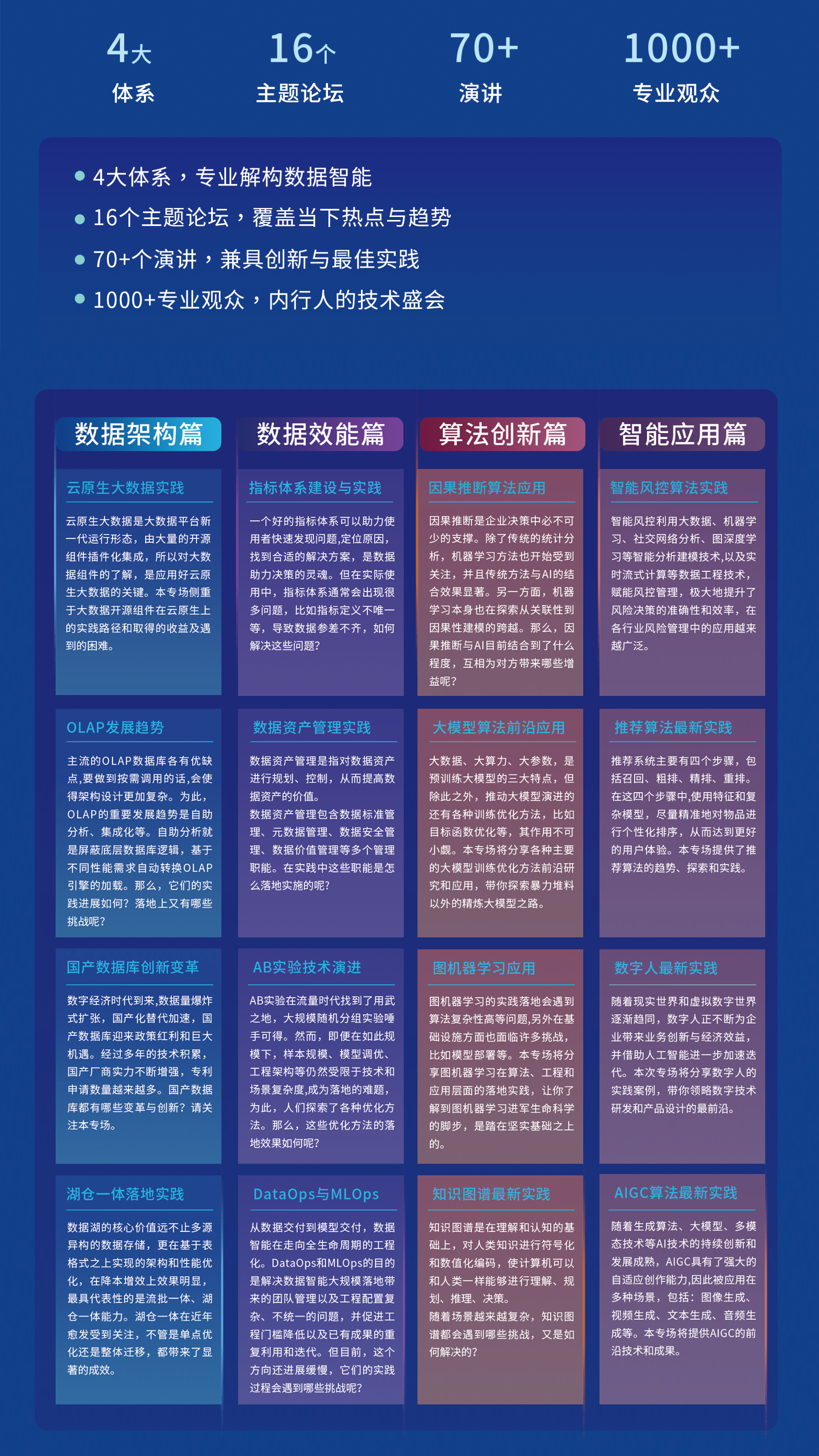

为此,DataFun 将在 DataFunCon 2023 中带来算法创新篇,包含因果推断、大模型、图机器学习、知识图谱四个主题论坛,带你一起见证人工智能实践最前沿。

欢迎大家,点击下方链接,查看更多议题详情👇

DataFunCon2023(北京站):数据智能创新与实践大会