首发:3D视觉工坊微信公众号

作者:Danny明泽

论文下载:https://arxiv.org/pdf/2003.08...

简介:

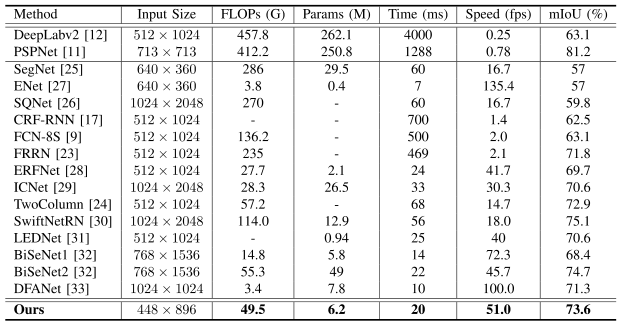

近年来,深度卷积神经网络(DCNNs)在语义图像分割方面表现出了优异的性能。然而,由于使用复杂的网络架构,基于DCNN的语义分割方法往往存在计算复杂度高的问题。这极大地限制了在实时处理的真实场景中的应用。本文提出了一种基于实时高性能DCNN的城市街道场景语义分割方法,在准确性和速度之间取得了良好的平衡。首先使用一个具有空洞卷积和注意力机制的轻量级基线网络(LBN-AA)作为基线网络,有效地获取密集的feature map。利用不同规模的池化操作提取丰富而独特的语义信息,开发了空间金字塔池化算法,实现了多尺度的目标检测。同时,设计了具有浅层卷积层的空间细节保护网络(SPN),生成高分辨率的保留空间细节信息的地形图。最后,利用一种简单实用的特征融合网络(FFN),分别对语义分支(DASPP)和空间分支(SPN)的深、浅特征进行了有效的融合。实验结果表明,在具有挑战性的Cityscapes和CamVid测试数据集上(仅使用一张NVIDIA TITAN X卡),该方法在51.0 fps和39.3 fps的推理速度下,分别实现了73.6%和68.0%的mIoU的准确率。实验结果表明,该方法对城市街道场景的语义分割具有较好的实时性。

本文主要贡献如下:

采用了一个轻量级网络,其改进的MobileNetV2具有Atrous convolution和Attention (LBN-AA),该算法只需较小的内存和少量的参数,可实现快速推理和较好的精度。DASPP利用不同大小的池化操作和每个像素的邻近信息,得到的特征更加丰富。分别采用SPN和FFN来进一步提高算法的精度,同时又不会造成很大的速度损失。SPN能够准确地保留丰富的空间信息,弥补深层空间细节的缺失,而FFN则有效地结合了语义分支(DASPP)和空间分支(SPN)的深、浅特征。

相关知识:

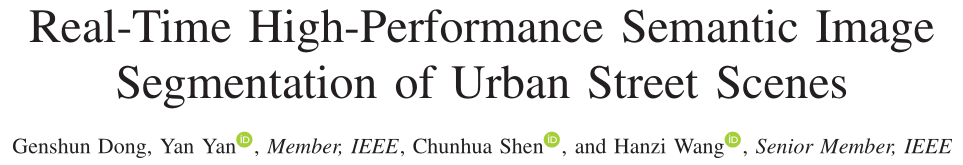

2D空洞卷积下不同的空洞率:

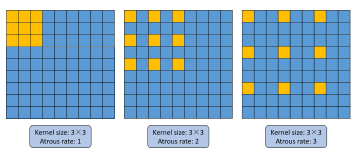

数据城市景观数据集上具有挑战性的多尺度变化的说明:从图片中可以看出,同一类别的物体(如人或车)在尺度上有很大差异。

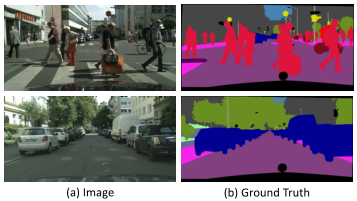

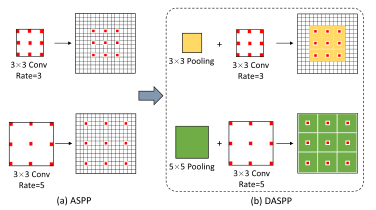

空间金字塔池ASPP:利用多个具有不同速率的并行分支来捕获多尺度的上下文。

方法:

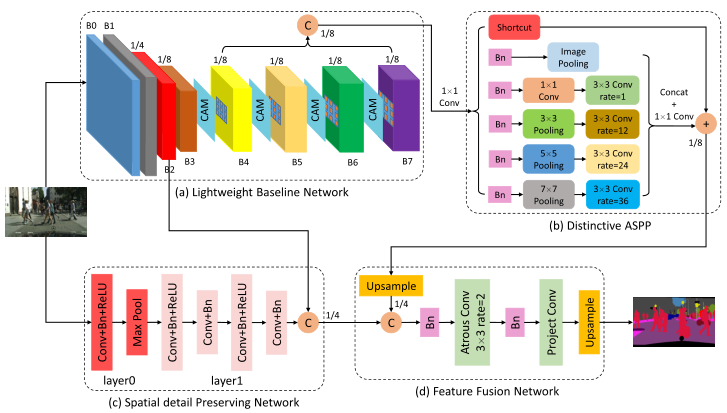

实时高性能语义分割方法由四个主要部分组成:带孔卷积和注意力机制的轻量级基线网络(LBN-AA)、DASPP、细节保留网络(SPN)和特征融合网络(FFN)。如下图所示。

(a)是提出的Atrous Convolution and Attention的轻量级基线网络(LBN-AA)。(b)是独特的空间金字塔池(DASPP)。(c)为空间细节保护网络(SPN)。(d)为特征融合网络(FFN)。

可以看到在MobileNetV2采用带孔卷积,特征图尺寸最小为1/8,而不会丢失太多信息。

进一步在改进的MobileNetV2中添加了几个卷积注意模块(CAM)来选择信息通道。利用CAM生成的权值来指导网络学习,从而得到加权特征图。这种方法有利于突出重要信息,抑制不相关信息。

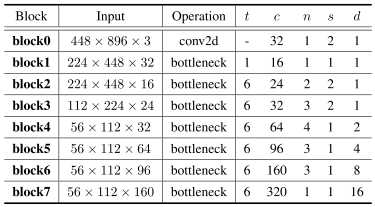

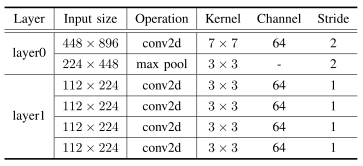

具体配置参数如图所示:

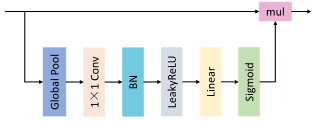

CAM:通道注意力机制

CAM首先采用全局平均池化和1×1卷积,再采用批处理归一化和LeakyReLU将输出特征的重要性编码为一个向量。注意,输入通道的数量减少了1×1卷积操作,有效地提高了凸轮的效率。然后,全连通层和Sigmoid函数得到关注向量。最后,根据注意向量对特征图的不同通道进行加权。

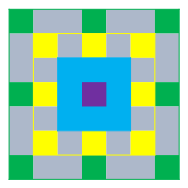

由于只采样非零值的位置,接受域覆盖了棋盘格模式的区域,导致一些邻近信息丢失(见上中的灰色网格)。因此,LBN-AA可以通过将这些块的特征图连接起来,生成一个稠密的采样图,其中不同块的相邻信息可以进行互补。

独特的空间金字塔池DASPP:

在并行的带孔卷积分支中,分别采用池大小为3×3、5×5和7×7。三个支路的3×3 带孔卷积运算对应的atrous率分别为12、24和36。将ASPP中原始的1×1卷积分支改为1×1卷积和3×3卷积运算,有效地提高了特征提取的能力。仍然采用图像级池化层来捕获全局上下文信息。如下图所示:

空间细节保护网络(SPN)

使用一个精简版的ResNet-18前两层为SPN(详见下表)。将LBN-AA中的layer1和block2的输出连接起来作为SPN的最终输出。SPN最终输出的feature map是原始输入图像大小的1/4,包含88个通道。虽然SPN得到的feature map分辨率较大,但计算代价较小(因为压缩版ResNet-18只使用了浅卷积层)。

特征融合网络(FFN)

首先将两个分支的特征图沿通道连接起来。然后应用BN操作缩短特征距离,平衡特征尺度。两个特征图相同位置的像素不一定相似,它们可能与该位置上相邻的像素相似。采用size为3×3,arous rate d = 2的带孔卷积来融合特征。该操作能够有效地结合目标像素周围相邻像素的特征信息,而不是仅仅依赖于一个位置。然后用大小为1×1的投影卷积将输出通道的数量减少到语义类别的数量(216个减少到19个-标签的类别个数)。在带孔卷积和投影卷积之间也使用了BN层。最后,利用简单而高效的双线性插值,直接将融合结果上采样到原始输入图像的大小。双线性插值只需要很少的参数,可以达到与转置卷积相似的精度。

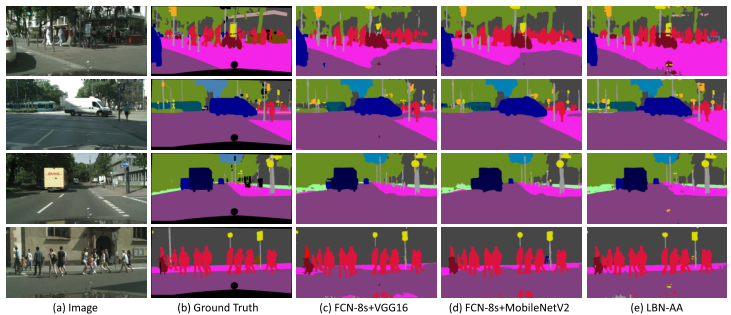

在Cityscapes数据及上获取的结果如下图:

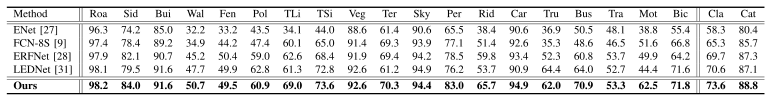

与其他先进网络的结果对比:

对于每个类的分类正确性比较:

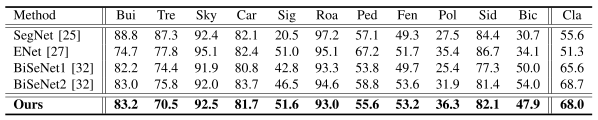

在CmaVid数据集上的比较结果:

总结:

在本文中,提出了一种新的实时高性能语义分割方法,以实现在准确性和速度之间的平衡。该方法由四个主要部分组成:LBN-AA、DASPP、SPN和FFN。LBN-AA利用轻量化网络、卷积、卷积关注模块提取特征,得到密集的特征图。DASPP增加了输入特征的多样性,利用丰富的上下文信息有效地解决了语义分割的多尺度问题。SPN的设计是为了保留丰富的空间信息,弥补细节的缺失。FFN负责融合高级和低级特性。这些组件通过紧密耦合和联合优化来保证语义分割的有效性。在城市景观和CamVid数据集上的定性和定量结果证明了该方法的有效性和效率。该方法中的一些模块不仅可以用于实时语义分割,而且可以用于精确的语义分割。

本文仅做学术分享,如有侵权,请联系删文。

推荐阅读

- FuseSeg:用于自动驾驶领域的RGB和热成像数据融合网络

- CVPR 2020 oral 首次提出VPSnet用于分割界新问题-视频全景分割

- 汇总|目标检测中的数据增强、backbone、head、neck、损失函数

- 3D目标检测深度学习方法之voxel-represetnation内容综述(一)

重点介绍:1、3D视觉算法;2、vslam算法;3、图像处理;4、深度学习;5、自动驾驶;6、技术干货。 博主及合伙人分别来国内自知名大厂、海康研究院,深研3D视觉、深度学习、图像处理、自动驾驶、目标检测、VSLAM算法等领域。

欢迎关注微信公众号