转载自:3D视觉工坊

编辑:AI深度学习视线

教程来自:https://github.com/PeterH0323/Smart\_Construction

一、YOLO v5训练自己数据集教程

- 1.1 创建自己的数据集配置文件

- 1.2 创建每个图片对应的标签文件

- 1.3 文件放置规范

- 1.4 聚类得出先验框(可选)

- 1.5 选择一个你需要的模型

- 1.6 开始训练

- 1.7 看训练之后的结果

二、侦测

三、检测危险区域内是否有人

- 3.1 危险区域标注方式

- 3.2 执行侦测

- 3.3 效果:在危险区域里面的人体会被 红色框 选出来

四、生成 ONNX

五、增加数据集的分类

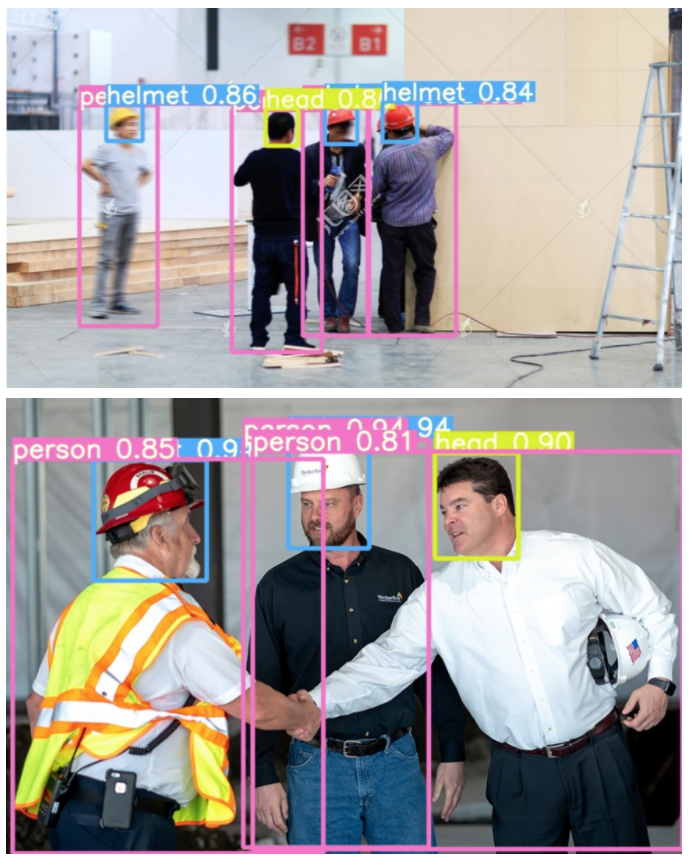

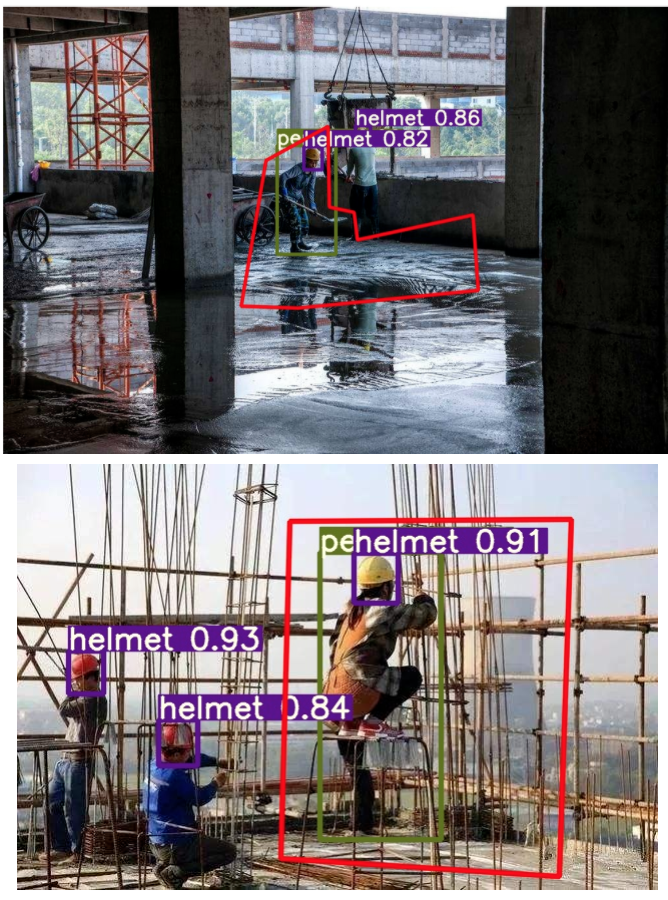

该项目是使用 YOLOv5 v2.x 来训练在智能工地安全领域中头盔目标检测的应用,先来一波演示!

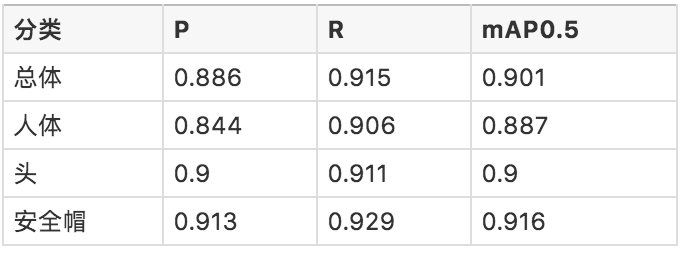

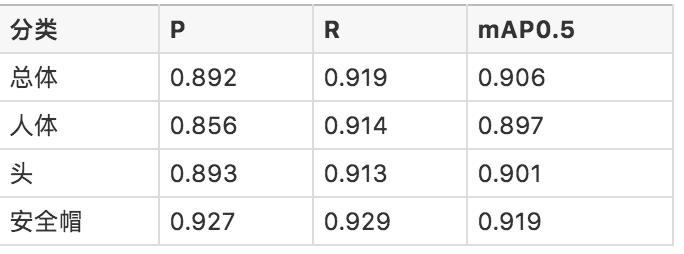

指标

yolov5s 为基础训练,epoch = 50

对应的权重文件:https://pan.baidu.com/share/i...\_5A,提取码: b981

yolov5m 为基础训练,epoch = 100

对应的权重文件:https://pan.baidu.com/share/i...\_vHnPHwEA,提取码: psst

yolov5l 为基础训练,epoch = 100

对应的权重文件:https://pan.baidu.com/share/i...,提取码: a66e

1

YOLOv5训练自己数据集教程

使用的数据集:Safety-Helmet-Wearing-Dataset ,感谢这位大神的开源数据集!

https://github.com/njvisionpo...

本文结合 YOLOv5官方教程 来写

环境准备

首先确保自己的环境:

Python >= 3.7训练自己的数据

提示:

关于增加数据集分类的方法,请看【5. 增加数据集的分类】

1.1 创建自己的数据集配置文件

因为我这里只是判断 【人没有带安全帽】、【人有带安全帽】、【人体】 3个类别 ,基于 data/coco128.yaml 文件,创建自己的数据集配置文件 custom_data.yaml

# 训练集和验证集的 labels 和 image 文件的位置1.2 创建每个图片对应的标签文件

使用标注工具类似于 Labelbox 、CVAT 、精灵标注助手 标注之后,需要生成每个图片对应的 .txt 文件,其规范如下:

- 每一行都是一个目标

- 类别序号是零索引开始的(从0开始)

- 每一行的坐标

class x_center y_center width height格式 - 框坐标必须采用归一化的 xywh格式(从0到1)。如果您的框以像素为单位,则将

x_center和width除以图像宽度,将y_center和height除以图像高度。代码如下:

import numpy as np生成的 .txt 文件放置的名字是图片的名字,放置在 label 文件夹中,例如:

./score/images/train/00001.jpg # image生成的 .txt 例子

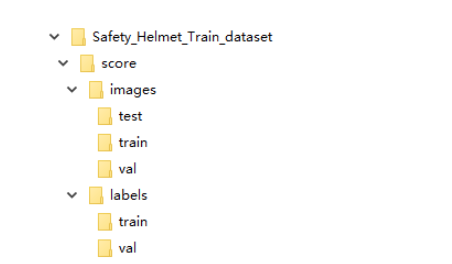

1 0.1830000086920336 0.1396396430209279 0.13400000636465847 0.159159163013100621.3 文件放置规范

文件树如下

1.4 聚类得出先验框(Yolov5 内部已做适配,可选)

使用代码 ./data/gen_anchors/clauculate_anchors.py ,修改数据集的路径

FILE_ROOT = r"xxx" # 根路径跑完会生成一个文件 anchors.txt,里面有得出的建议先验框:

Best Accuracy = 79.72%1.5 选择一个您需要的模型

在文件夹 ./models 下选择一个你需要的模型然后复制一份出来,将文件开头的 nc = 修改为数据集的分类数,下面是借鉴 ./models/yolov5s.yaml来修改的

# parameters1.6 开始训练

这里选择了 yolov5s 模型进行训练,权重也是基于 yolov5s.pt 来训练

python train.py --img 640 --batch 16 --epochs 10 --data ./data/custom_data.yaml --cfg ./models/custom_yolov5.yaml --weights ./weights/yolov5s.pt其中,yolov5s.pt 需要自行下载放在本工程的根目录即可,下载地址 官方权重

1.7 看训练之后的结果

训练之后,权重会保存在 ./runs 文件夹里面的每个 exp 文件里面的 weights/best.py ,里面还可以看到训练的效果

2

推断

侦测图片会保存在 ./inferenct/output/ 文件夹下

运行命令:

python detect.py --source 0 # webcam例如使用我的 s 权重检测图片,可以运行以下命令,侦测图片会保存在 ./inferenct/output/ 文件夹下

python detect.py --source 图片路径 --weights ./weights/helmet_head_person_s.pt3

检测危险区域内是否有人

3.1 危险区域标注方式

我这里使用的是 精灵标注助手 标注,生成了对应图片的 json 文件

3.2 执行侦测

侦测图片会保存在 ./inferenct/output/ 文件夹下

运行命令:

python area_detect.py --source ./area_dangerous --weights ./weights/helmet_head_person_s.pt3.3 效果:在危险区域里面的人体会被 红色框 选出来

生成 ONNX

4.1 安装 onnx 库

pip install onnx4.2 执行生成

python ./models/export.py --weights ./weights/helmet_head_person_s.pt --img 640 --batch 1onnx 和 torchscript 文件会生成在 ./weights 文件夹中

增加数据集的分类

关于增加数据集分类的方法:SHWD 数据集里面没有 person 的类别,先将现有的自己的数据集执行脚本生成yolov5需要的标签文件.txt,之后再用yolov5x.pt 加上 yolov5x.yaml ,使用指令检测出人体

python detect.py --save-txt --source ./自己数据集的文件目录 --weights ./weights/yolov5x.ptyolov5修改 ./data/gen_data/merge_data.py 中的自己数据集标签所在的路径,执行这个python脚本,会进行 person 类型的合并

本文仅做学术分享,如有侵权,请联系删文。

推荐阅读

重点介绍:1、3D视觉算法;2、vslam算法;3、图像处理;4、深度学习;5、自动驾驶;6、技术干货。 博主及合伙人分别来国内自知名大厂、海康研究院,深研3D视觉、深度学习、图像处理、自动驾驶、目标检测、VSLAM算法等领域。

欢迎关注微信公众号