推理模型仓(inference model repository)是 Triton 推理服务器的最基础元件,如同数据库(database)服务器必须先创建一个数据库是类似的道理。要使用 Triton 推理服务器的第一件任务,就是先创建一个模型存储仓来作为服务器的组织中心,将所需的模型、配置文件和其他资源都位于这个存储仓中,才能让 Triton 进行推理任务。

进入 https://github.com/triton-inf... 这个最完整的说明文件区,在 “User Guide” 里的前 5 个步骤,就是为 Triton 服务器创建与管理模型仓的任务,依序如下:

- 创建模型储存仓(Creating a Model Repository)

- 撰写模型配置文件(Writing a Model Configuration)

- 创建模型的流水线(Buillding a Model Pipeline)

- 管理模型可用性(Managing Model Availablity)

- 收集服务器指标(Collecting Server Metrics)

本文先带着读者创建模型存储仓,这是执行 Triton 服务器之前必须执行的环节,另外四个部分会在后续文章中陆续探索。

这个储存仓的要求相对简单,只要是常用的文件系统就行,包括企业内部使用的 Windows NTFS 或 Linux ext3/4 文件服务器,也可以是 Google 云、亚马逊云、微软 Asure 之类的网上储存空间。

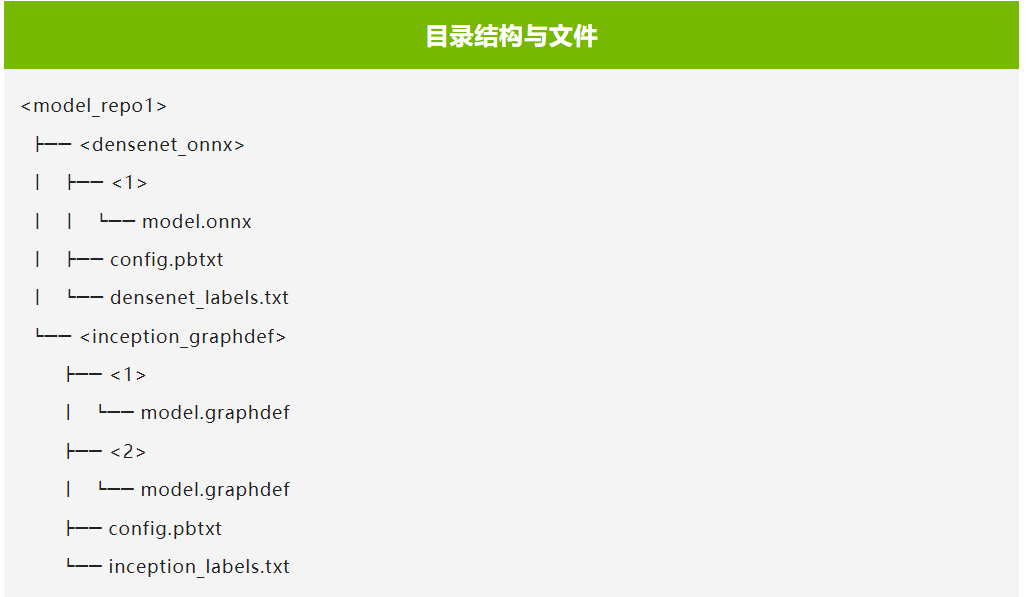

Triton 模型仓是以“目录结构”为主体的方式搭建,将配套的文件放置对应的位置里就可以,下面是一个简单的范例:

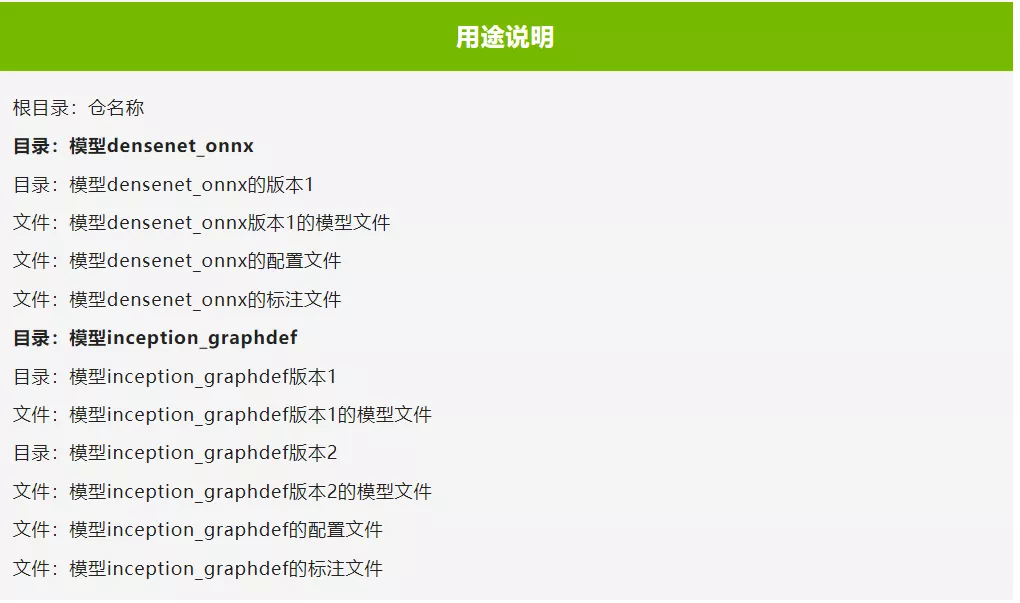

这个模型仓主要分为以下两大部分:

- 目录结构:需要创建以下三层目录,并根据各层定义进行命名

(1) 第一层“仓名称”:简单创建一个文件夹作为模型该模型仓的根路径,一台设备上可以有任意个模型仓,例如 model_repo1、model_repo2;

(2) 第二层“模型名称”:在模型仓下面根据模型名称创建目录,通常习惯使用“神经网络名称_后端种类”的组合格式,例如

densenet_onnx 表示为 ONNX 后端的 densenet 网络模型;

inception_graphdef 表示为 TensorFlow graphdef 后端的 inception 模型。

(3) 第三层“版本号”:用纯数字表示,因为相同的模型可能存在不同训练回合(epoch)、不同精度的多个版本。

- 文件内容:将以下三种文件内容,分别放置在对应的目录下

(1) 配置文件:放在第二层的模型名称目录下,通常命名为 config.pbtxt,每个模型都有各自的配置文件,里面存放着该模型执行推理时所需要的信息与参数,是 Triton 模型仓里最重要的部分,主要内容将在后面有专门文章提供详细说明。

(2) 标注文件(如果有):放在第二层的模型名称目录下,例如 densenet_labels.txt

(3) 模型文件:放在第三层的版本目录下,就是最终执行推理功能的神经网络模型,其附加文件名根据训练时所用的框架而定,如下所列

TensorRT 模型:附加名为 .plan,例如 model.plan

ONNX 模型:附加名为 .onnx,例如 model.onnx

TorchScript 模型:附加名为 .pt,例如 model.pt

TensorFlow 模型:根据存储时的方式有 .graphdef 与 .savedmodel 两种,例如 model.graphdef 或 model.savedmodel

OpenVINO 模型:需要由 .xml 与 .bin 组成,例如 model.xml 与 model.bin

Python 模型:附加名为 .py,例如 model.py

DALI 模型:附加名为 .dali,例如 model.dali

即便是在云存储上,也只要根据上述要求创建目录结构,并将各类文件放置在对应目录下,然后启动 Triton 推理服务器时使用“--model-repostory=”参数,指向模型仓根路径的位置就可以,例如以下状况:

# 在本机上

tritonserver --model-repository=/home/nvidia/triton/repo1

# 在Google云

tritonserver --model-repository=gs://bucket/triton/repo-google

# 在亚马逊S3云

tritonserver --model-repository=s3://IP:端口/triton/repo-amazone

# 微软Azure云

tritonserver --model-repository=as://用户名/容器名/repo-azureTriton 服务器启动时,会将模型仓下的模型载入计算设备的内存之中,并不需要与模型仓所在服务器进行实时数据交换,因此启动之初会消耗比较多时间,开始执行推理计算之后是不会受到网络速度影响推理性能。

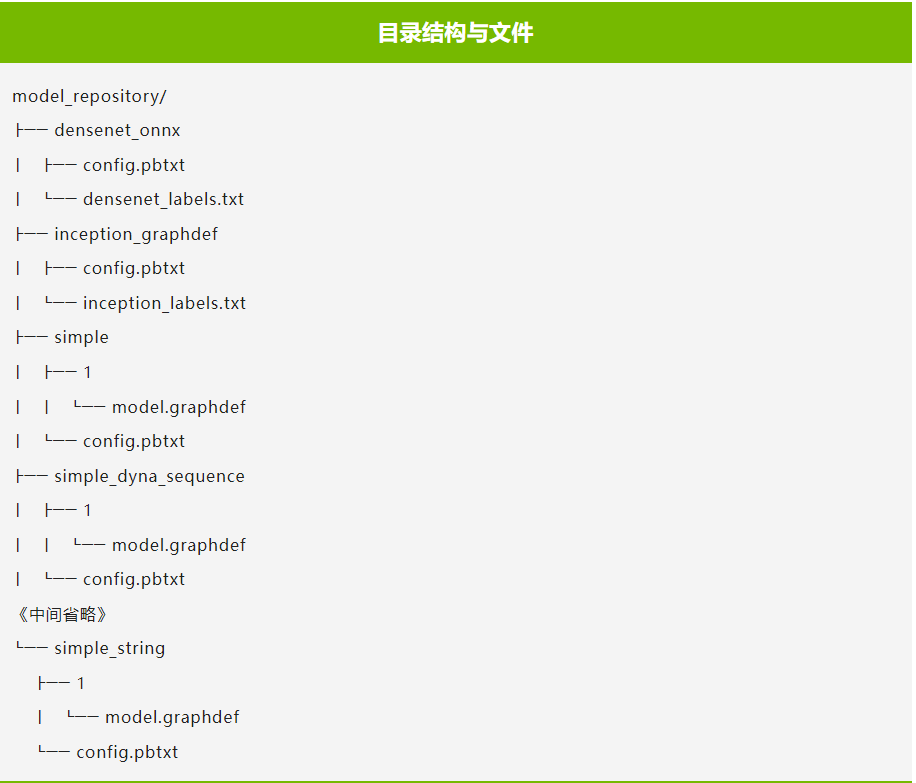

为了协助读者跟容易理解模型仓的使用,我们以 NVIDIA Jetson AGX Orin 设备作为实验平台,先下载 https://github.com/triton-inf... 开源仓,里面的docs目录下有个 examples/model_repository 就是个模型仓范例,里面有 8 个简单的模型,可以做些简单的测试与体验。现在请执行以下指令:

cd $HOME && mkdir triton && cd triton

git clone https://github.com/triton-inference-server/server

cd server/docs/examples

tree model_repository

就会看到如下面左方的列表,共有 8 个模型文件夹:

我们可以看到每个文件夹里面都有 1 个独立的 config.pbtxt 配置文件,而且内容都不尽相同,这是针对不同模型所设置的内容与参数。

在下载的模型仓里的 densenet_onnx 与 inception_graphdef 目录下,并没有提供对用的模型文件,因此需要执行以下指令将这两个模型文件下载,并存放在指定位置里:

$ ./fetch_models.sh现在就能看到在 densenet_onnx 与 inception_graphdef 各生成版本 <1> 目录,并且各有一个 model.onnx 与 model.graphdef 模型文件。

接下去只要安装好 Triton 服务器软件,就能开始使用这个模型仓来进行测试与体验,这是下一篇文章会带着大家进行安装的部分。