首发:3D视觉工坊微信公众号

作者:Danny明泽

论文下载:https://yuxiangsun.github.io/...\_rtfnet.pdf

代码下载:https://github.com/yuxiangsun/RT

简介:

语义分割是自动驾驶车辆的一项基本功能。随着深度学习技术的发展,近年来出现了许多有效的语义分割网络。然而,大多数相机用来获取可见光的RGB图像。在不满足的光照条件下,RGB图像的质量容易降低;例如,光线的暗度和亮度,这对仅使用RGB图像的网络是严峻的挑战。不同于可见光相机,热成像相机是利用热辐射产生产生热图像,能够在各种光照条件下看到东西。与可见光相机不同的是,可见光的光谱范围在0.4到0.7微米之间,它们利用温度高于绝对零度的所有物质发出的热辐射来成像。它的价格要比普通相机贵上好几倍,但要比激光雷达便宜的多,最初是为军事用途而发明的,但近年来价格有所下降。因此,这种摄像机可以越来越多地应用于民用领域,如遥感、自主监控和高级驱动辅助系统(ADAS)等。

动机:

为自动驾驶汽车实现稳健和准确的城市景观语义划分。其核心思想是利用热相机的优势,融合RGB和热信息,以实现优越的性能。

设计理念:

本文采用了编码器-解码器,利用两个编码器ResNet分别对RGB和Thermal图像进行特征提取。在编码阶段,多模态融合是通过RGB和Thermal编码器路径的特征块在元素上的累加来实现的。开发了一种叠堆块解码器来交替保留和增加空间分辨率,同时减少信道计数。

本文主要贡献:

1)开发了一种新的深度神经网络,它融合了RGB和热信息,用于城市场景的语义分割。

2)证明了利用热信息可以提高语义分割的性能。

3)将网络与公共数据集上的技术水平进行比较,获得了优越的性能。

方法:

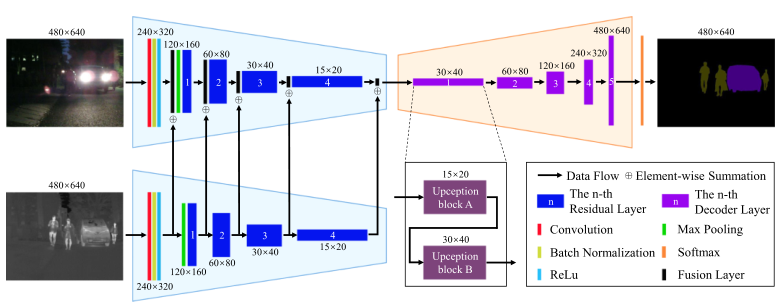

如下图所示,RTFNet由三个模块组成:RGB编码器和Thermal编码器,分别用于提取RGB和热图像的特征;一种解码器,用于恢复特征图的分辨率。RTFNet中的解码器模块不是编码器模块的镜像版本。编码器和解码器是不对称设计的。设计了两个大的编码器和一个小的解码器。在RTFNet的最后,使用softmax层得到语义分割结果的概率图。

编码器:

编码器使用ResNet,去掉平均池和完全连接的层作为特征提取器。热特征图被融合到RGB编码器通过元素的求和。该解码器共有5层,每层依次由Upception块A和b组成。图中是以输入为480×640的为例,层和块的输出分辨率如图所示。

解码器:

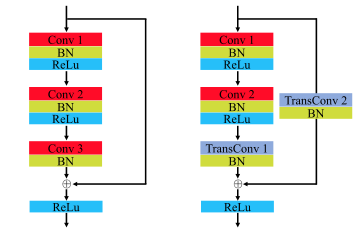

解码器的主要设计目的是得到和原始输入分辨率相同的密集预测。通过解码器,特征图的分辨率逐渐恢复到输入图像的分辨率。提出的Upception网络块,它由Upception block A和Upception block b两个子块组成。A块(左)保持分辨率和feature map通道数量不变; B块(右)增加了特征图的分辨率,减少了通道数量。详细结构如下图所示:

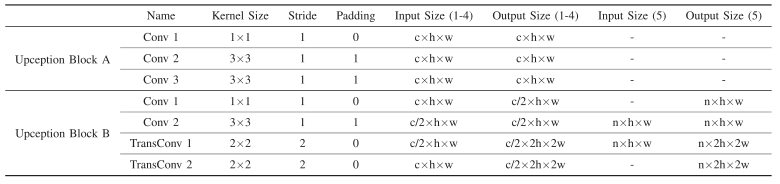

在A块(左)中,有3个卷积层,通过这3个层,特征通道的分辨率和数量都不发生变化。引入从第三批归一化层的输入到输出的shortcut(捷径/远跳)。输入和特征图是元素求和。在B块(右)中,第一卷积层(Conv1)保持分辨率不变,并将特征通道的数量减少2倍。第二卷积层(Conv2)保持特征通道的分辨率和数量不变。与块A相似,输入远跳(残差)到第三批归一化层。由于第一个转置卷积层(TransConv 1)保持通道的数量不变,并增加分辨率2倍,第二转置卷积层(TransConv 2)是需要增加分辨率和减少通道数。否则,特征图的形状将不匹配,无法进行求和操作。Upception块中的神经网络层的详细配置显示在下表中。

数据集的设置:

使用MFnet中发布的公共数据集,它使用InfReC R500相机记录了城市场景,可以同时传输RGB和热图像。数据集包含1569对RGB和thermal图像,其中白天820对,夜间749对。在ground truth中有9个手工标记的语义类,包括未标记的背景类。数据集中的图像分辨率为480×640。我们采用[27]中提出的数据集拆分方案。训练集由50%的白天图像和50%的夜间图像组成。验证集由25%的白天图像和25%的夜间图像组成,其他图像用于测试。

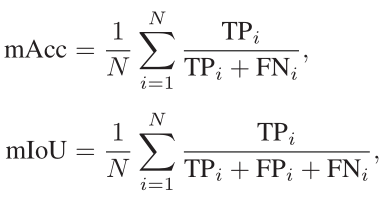

评价指标:

采用两个度量标准来定量评价语义分割的性能。第一个是每个类的准确性(Acc),也称为召回。第二个是每个类的交并比 (IoU)。这两个度量的所有类的平均值分别表示为mAcc和mIoU。公式如下:

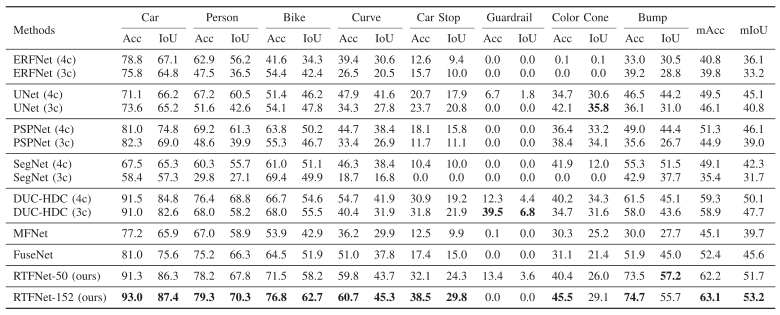

实验结果:

总的实验结果,包括白天和黑天都在一起计算的结果:

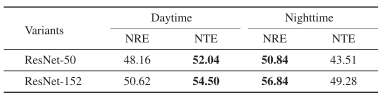

比较设计的两个模型RTFNet-50和RTFNet-152在mAcc指标下的结果:

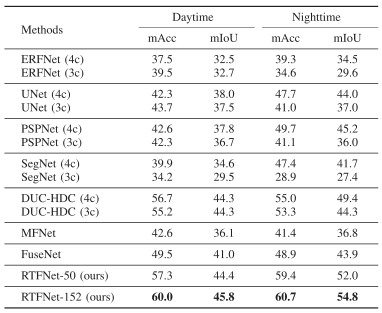

白天黑天单独比较的结果如下:

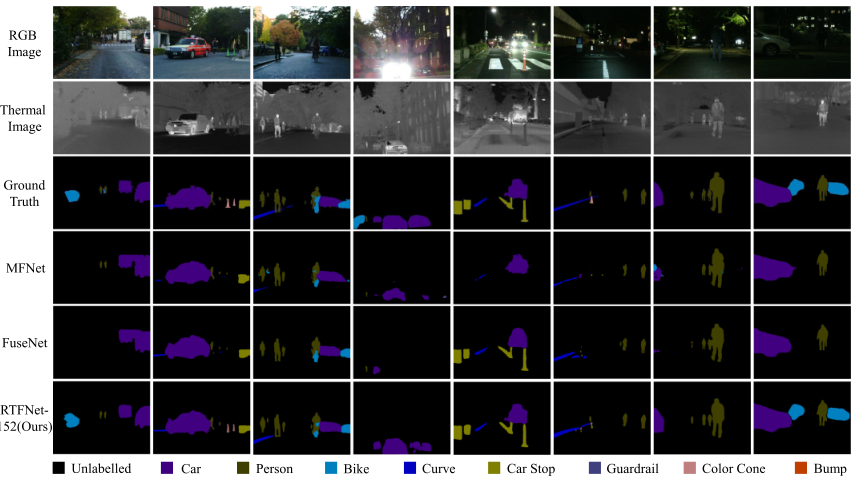

可视化的样例结果图:

总结:

本文提出了一种基于热数据的城市场景语义分割网络。实验结果表明,该网络在各种场景下,甚至在具有挑战性的光照条件下都具有优越性。无论如何,未来仍有几个问题需要解决。首先,推理速度较低,特别是在嵌入平台上,重点是嵌入式平台的优化。其次,网络分割出的目标边界不够清晰。为了产生清晰的边界并保留更详细的信息,将使用short-cut将低级特征映射引入高级特征映射。最后,在某些情况下,RGB图像或热图像可能比其他图像更能提供信息。例如,对于具有相似温度的物体,热象将提供较少的信息,这将是热象机的一个不利方面。对贡献较少的信息给予较低的权重或完全丢弃它将有利于筛选。在未来,将发展判别机制,以发现更有信息量的数据。

本文仅做学术分享,如有侵权,请联系删文。

推荐阅读

重点介绍:1、3D视觉算法;2、vslam算法;3、图像处理;4、深度学习;5、自动驾驶;6、技术干货。 博主及合伙人分别来国内自知名大厂、海康研究院,深研3D视觉、深度学习、图像处理、自动驾驶、目标检测、VSLAM算法等领域。

欢迎关注微信公众号