GAN 论文阅读笔记,欢迎关注。

来源:https://zhuanlan.zhihu.com/p/59538183

作者:林小北

在《从零推导GAN》提到了关于GAN的三个思考:

(1) D(x)的值域一定要是[0,1]吗?如果 D(x)表示的是数据x真实的程度,而不是概率的?

(2) 除了logistic分类器,我们还有别的二分类器选择吗?

(3) 对于所以的G,我们是不是总能以很低的代价,找个一个完美的D?

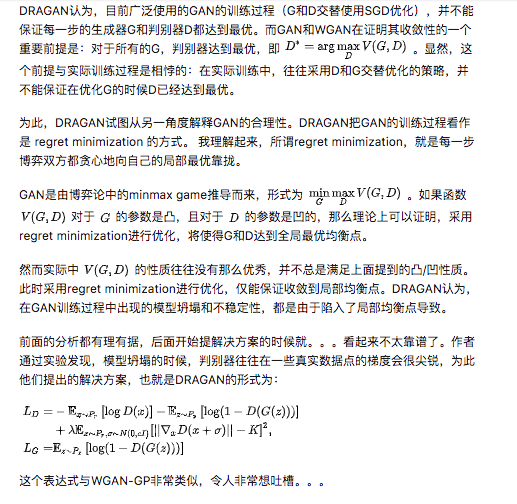

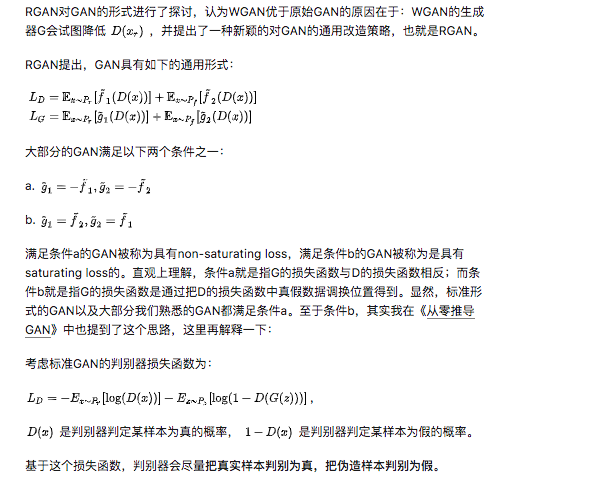

前两个问题在前面的论文笔记中已经有较好的解答了,本文提到的DRAGAN则正视了第三个问题(虽然最后没有给出令人信服的解决方案)。除了DRAGAN,本文还将介绍Relativistic GAN,一种简单又令人耳目一新的GAN的改造方式。

- Deep Regret Analytic GAN

个人认为,DRAGAN虽然形式上看起来并没有太大改进,但是对“完美的D”的质疑是合理的。TTUR从随机优化的角度对GAN进行了解释,个人感觉更为令人信服(但此文数学门槛相当高),并给出了一个形式简单的GAN训练方案,有兴趣的读者自行阅读。

参考链接:

On Convergence and Stability of GANsarxiv.orgGANs Trained by a Two Time-Scale Update Rule Converge to a Local Nash Equilibriumarxiv.org

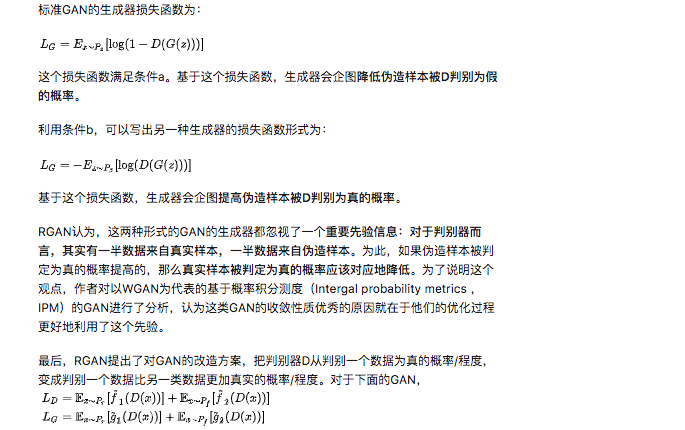

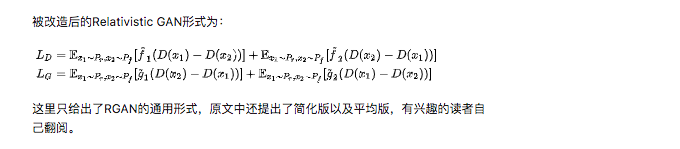

2. Relativistic GAN

参考链接:

The relativistic discriminator: a key element missing from standard GANarxiv.org

3. 总结:

DRAGAN和RGAN都对GAN的收敛性提出了有趣的、新颖的(有别于之前提过的论文)的观点。遗憾的是,DRAGAN提出的解决方案是由其实验观察所得,缺乏理论支撑;而RGAN所提出的观点虽然有新意但感觉也不够有说服力。。。

回想GAN在短短数年的发展,真是迅速异常。在GAN的收敛性方面,感觉已经小坑快被填完的,剩下的大坑都是需要更为强大的数学理论来handle了。。。

本系列阅读笔记:

《GAN论文阅读笔记3:WGAN的各种变体WGAN-GP/CTGAN/SNGAN/WGAN-div》

更多深度学习,GAN相关论文阅读笔记请关注深度学习论文阅读笔记专栏。

关于作者林小北:毕业于清华大学自动化系,京东算法工程师。

欢迎关注知乎专栏:https://zhuanlan.zhihu.com/c\_1080771046889623552