在本篇文章我们将详细讨论推测解码,这是一种可以将LLM推理速度提高约2 - 3倍而不降低任何准确性的方法。我们还将会介绍推测解码代码实...

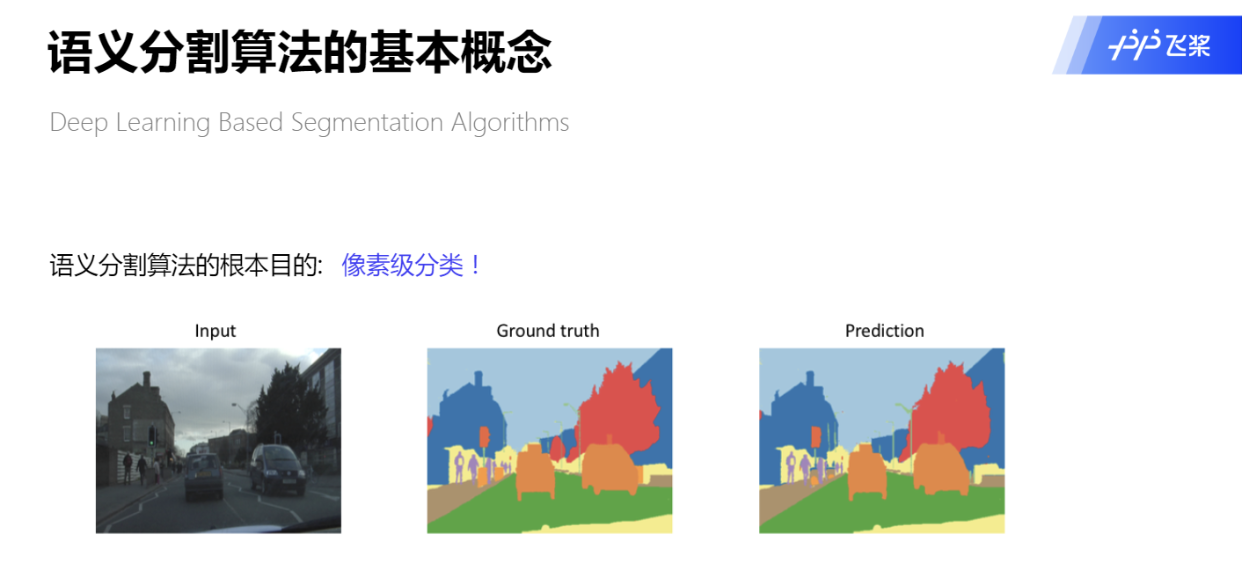

AiStudio是一个很好的学习平台,我相信无时无刻都有很多像我一样的小白出于对人工智能的兴趣,而汇聚在这里。这一次,我想做一个入门级...

2024 年 2 月,OpenAI 又一次站在了镁光灯下,Sora 横空出世并引发热烈讨论,「文生视频」的热潮被那段 60 秒的展示视频再度推高,也使...

如果你一直在关注大型语言模型的架构,你可能会在最新的模型和研究论文中看到“SwiGLU”这个词。SwiGLU可以说是在大语言模型中最常用到的...

近两年来,大模型的热度持续高涨,并且开始在更广泛的领域进行落地探索。随着行业整体的快速发展,越来越多的开源大模型涌入市场,进一...

归一化层是深度神经网络体系结构中的关键,在训练过程中确保各层的输入分布一致,这对于高效和稳定的学习至关重要。归一化技术的选择(B...

分组查询注意力 (Grouped Query Attention) 是一种在大型语言模型中的多查询注意力 (MQA) 和多头注意力 (MHA) 之间进行插值的方法,它的...

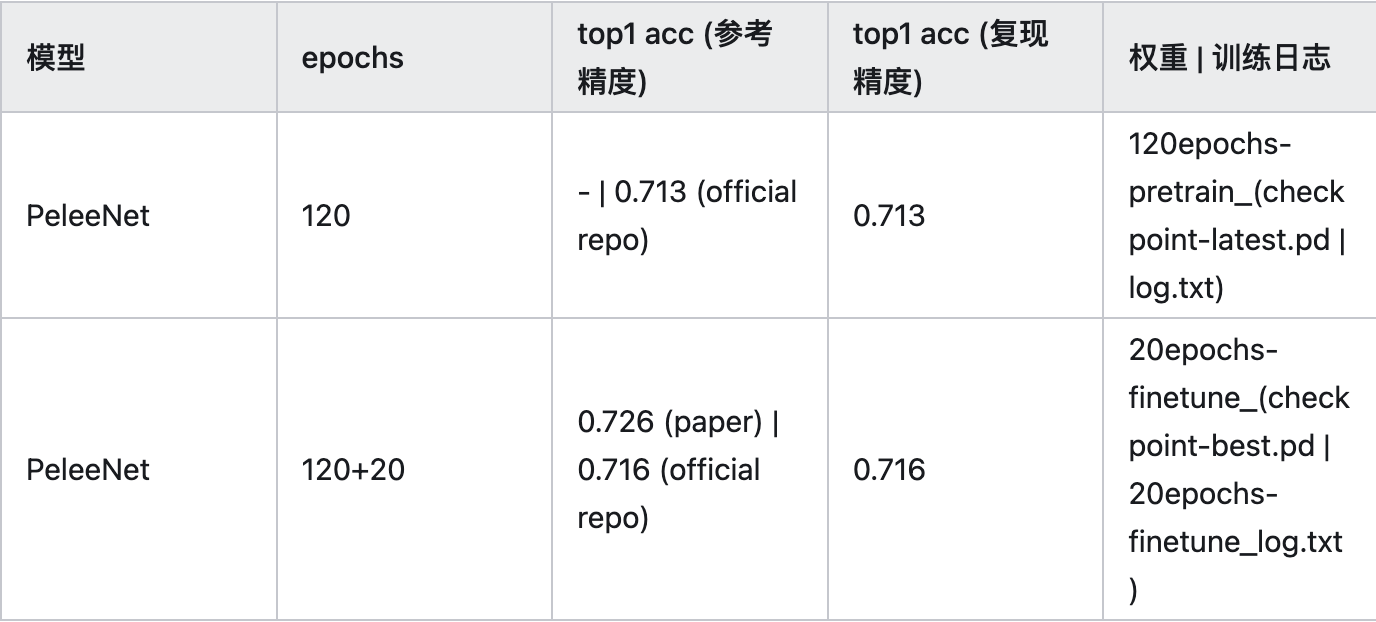

PeleeNet: An efficient DenseNet architecture for mobile devices

在合成生物学领域,研究人员将来自其他生物体的酶基因导入某种宿主体中,构建起新的代谢途径,可以让宿主生产出自己本身不能合成的物质...

这是3月26日新发的的论文,微软的研究人员简化的基于mamba的体系结构,并且将其同时应用在图像和时间序列中并且取得了良好的成绩。

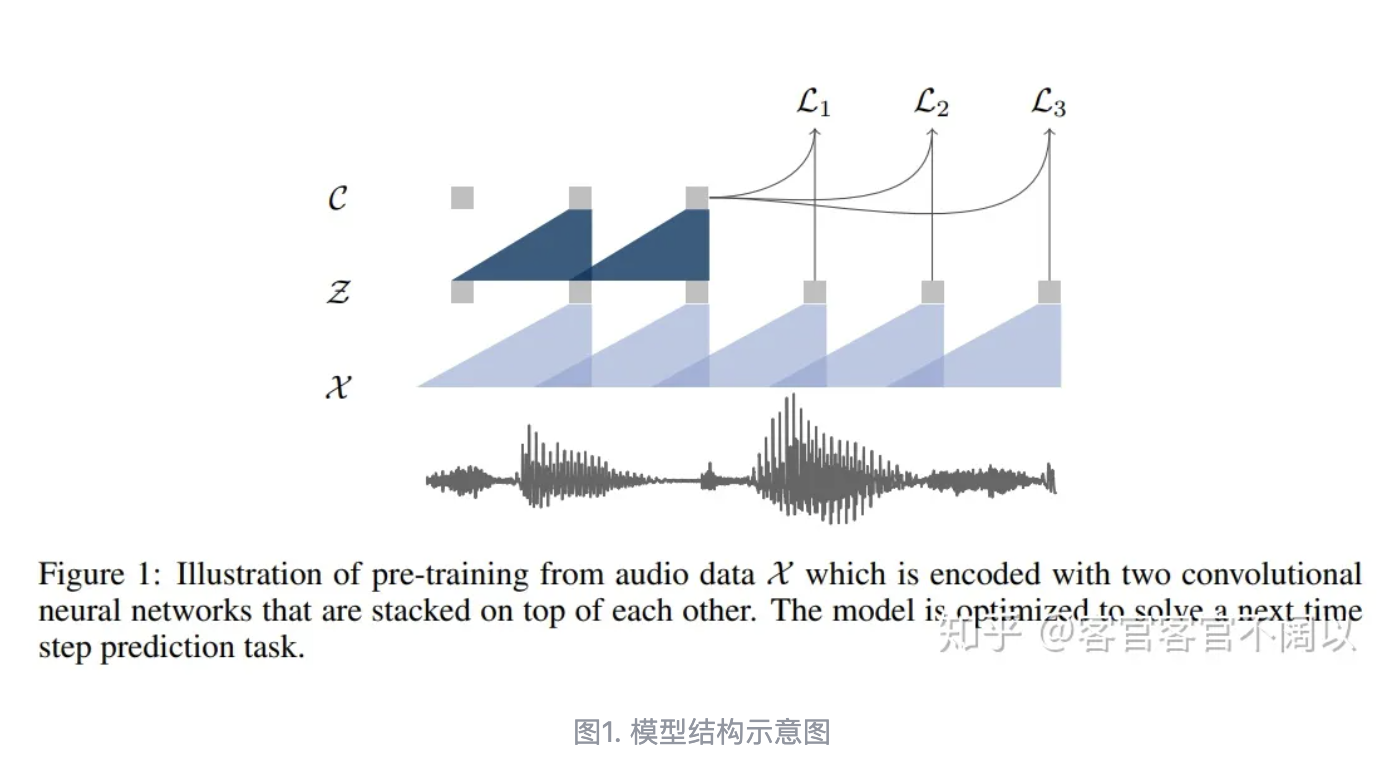

本文主要梳理Facebook AI Research 从2019年开始的发表的wav2vec系列工作,主要包括了Wav2vec、Wav2vec 2.0

城市,是人们安居乐业的故土,是政府开展经济建设的基石,承载着细腻的人文情怀与宏伟的国家发展脉络。长期以来,管理者一直在探寻更加...

自 2017 年发表“ Attention Is All You Need ”论文以来,Transformer 架构一直是自然语言处理 (NLP) 领域的基石。它的设计多年来基本没...

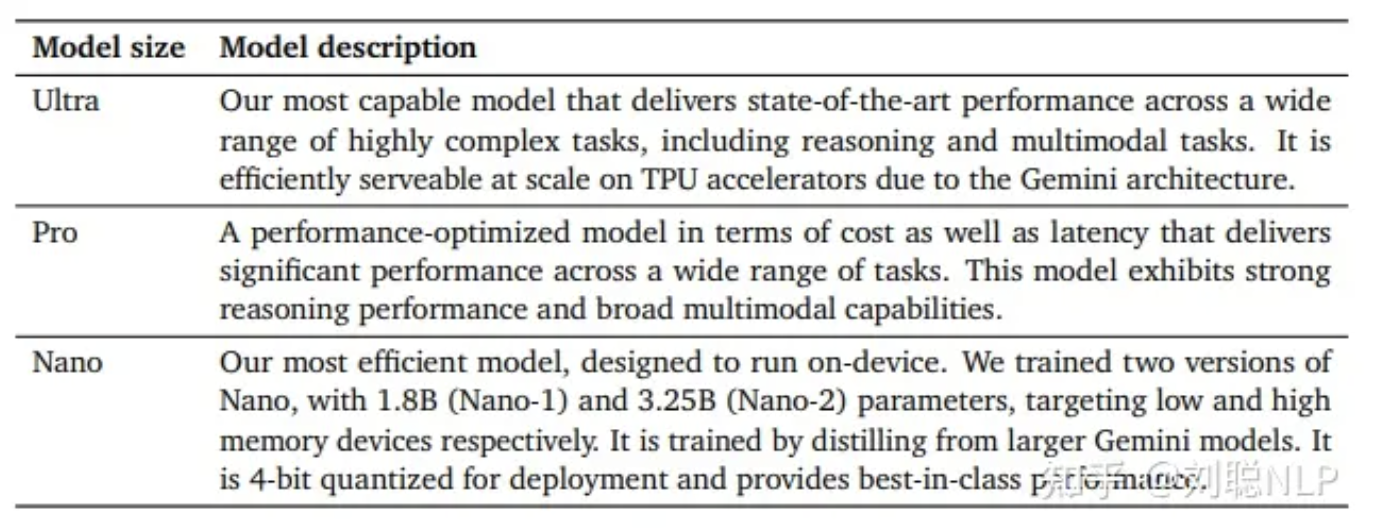

大模型时代,根据大模型缩放定律,大家通常都在追求模型的参数规模更大、训练的数据更多,从而使得大模型涌现出更多的智能。但是,模型...

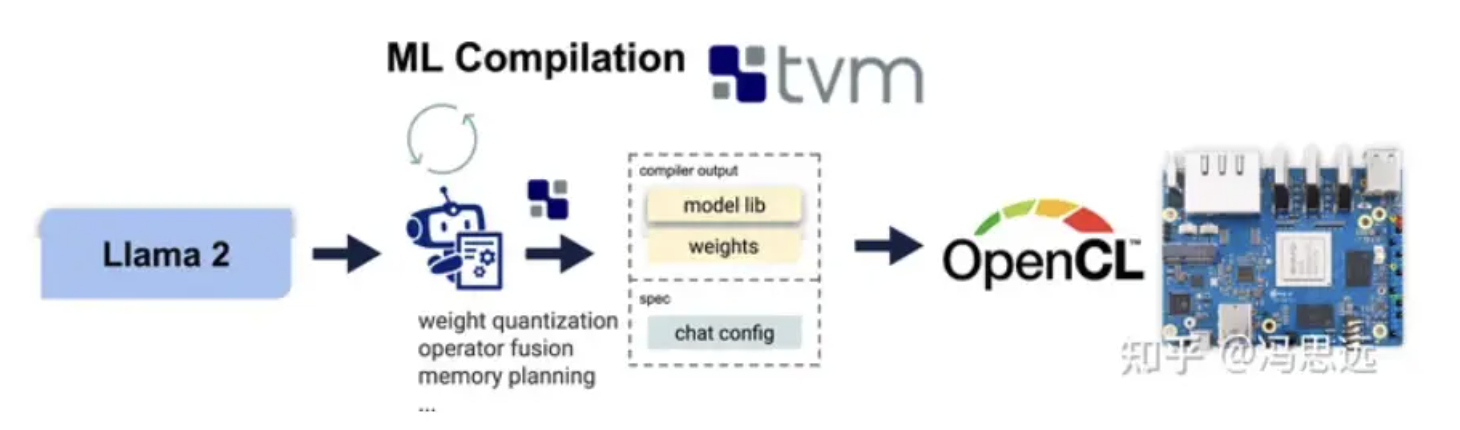

视频中,我们将深入了解利用GPU加速在Orange Pi 5上跑LLMs的精彩世界。最近知乎上的一篇文章《利用GPU加速,在Orange Pi上跑LLMs》引起...

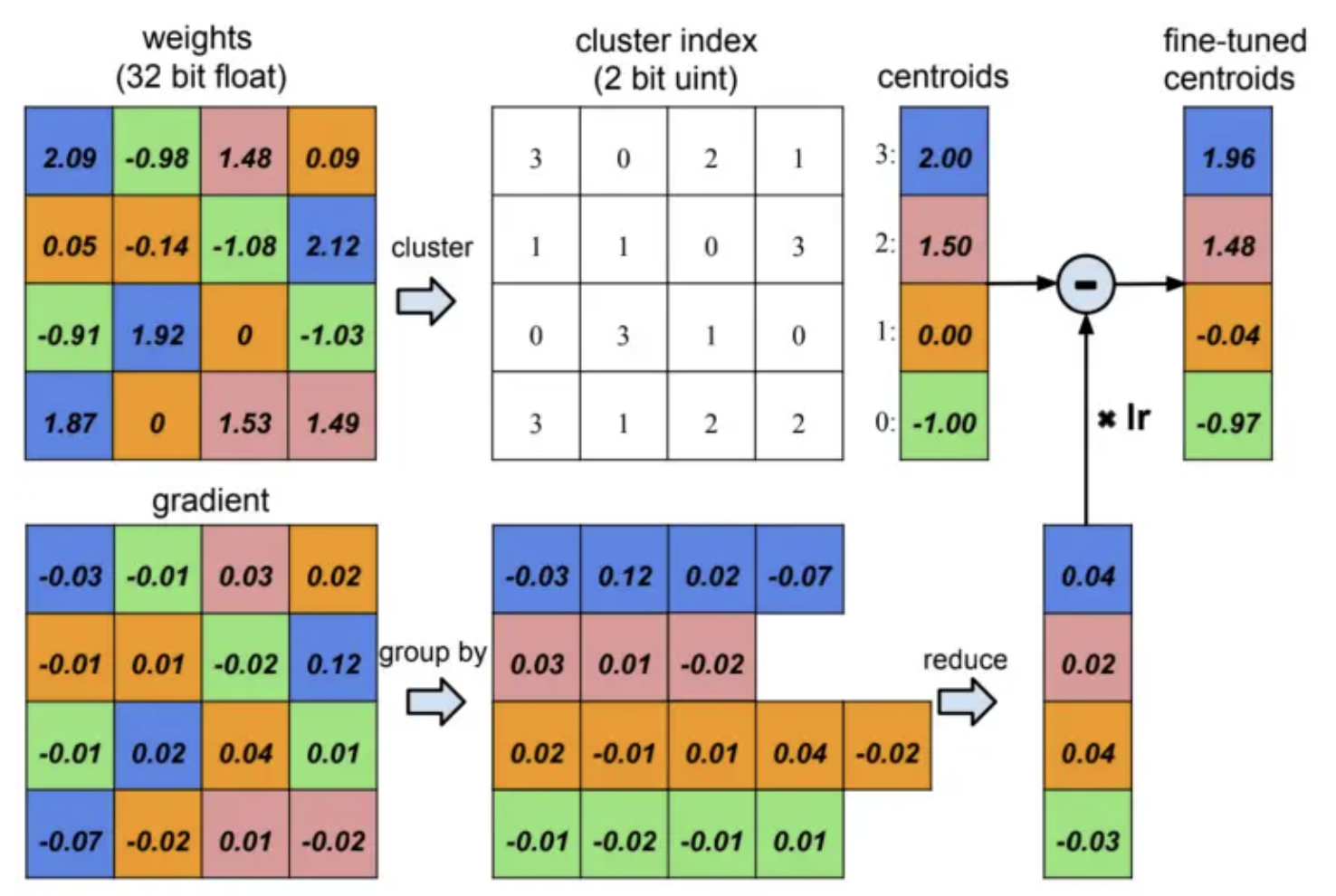

2023年的大型语言模型领域经历了许多快速的发展和创新,发展出了更大的模型规模并且获得了更好的性能,那么我们普通用户是否可以定制我...

在刚刚结束的世界杯预选赛中,国足在天津主场以 4:1 的得分大胜新加坡,一扫上一场在领先优势下被对方逼平的阴霾,也迎来了球队 2024 年...

这是一篇非常有意思的论文,它将时间序列分块并作为语言模型中的一个token来进行学习,并且得到了很好的效果。

深度学习已成为许多机器学习应⽤程序不可或缺的⼀部分,现在可以在⽆数电⼦设备和服务中找到,从智能⼿机和家⽤电器到⽆⼈机、机器⼈和...

2022年7月,美国联邦调查局互联网犯罪投诉中心(IC3)发布了一份新的公告,该公告警告说,越来越多的诈骗分子正在使用“深度伪造”技术在...

现代社会,人类需要跟肿瘤、糖尿病、心血管疾病等日益流行的复杂疾病持续斗争,原有药品已无法完全满足市场需求,新药研发势在必行。然...

提高llm中注意力机制效率的努力主要集中在两种方法上:优化单设备计算和存储能力,如FlashAttention,以及利用多设备的分布式系统,如Rin...

1888 年,爱迪生提交了一项名为「活动电影放映机」的专利,该设备首次实现连续播放静态照片,形成类似动态画面的效果,由此拉开了视频发...

1806 年,23 岁的德国药剂师 Sertürner 从罂粟中首次分离出单体吗啡,现代天然药物化学研究自此起步。在此基础上,德国化学家 Friedrich...

今年春节期间,人工智能有一个天方夜谭般的话题——奥特曼宣称要用7万亿美元扩大芯片产能。业界对这个数字的态度不必在此赘述,但显而易见...

训练大型语言模型(llm),即使是那些“只有”70亿个参数的模型,也是一项计算密集型的任务。这种水平的训练需要的资源超出了大多数个人爱好...

[大语言模型的预训练[3]之Prompt Learning:Prompt Engineering、Answer engineering、Multi-prompt learning详情]([链接])

结构化的思想很普遍,结构化内容也很普遍,我们日常写作的文章,看到的书籍都在使用标题、子标题、段落、句子等语法结构。结构化 Prompt...

AI for Science 的新成果、新动态、新视角——英伟达:有众多 AI for Scinece 领域的战略内容在布局微软携手多家医疗机构推出 TRAINOverje...

CLIP的英文全称是Contrastive Language-Image Pre-training,即一种基于对比文本-图像对的预训练方法或者模型。CLIP是一种基于对比学习...